Hello

正则化基本知识的回顾

正则化(Regularization):减小方差的策略、降低过拟合现象的策略

正则化分为两类

第一类:

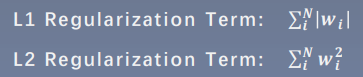

L1、L2正则化

第二类:

drop out

L1、L2正则化:

通过调整模型中的weight,降低weight来减小过拟合。

其实模型中有两个参数可以调整,weight和bias,通过数学公式的推导可以得到,调整一个weight就可以实现降低参数值并实现减小过拟合的目的。

目标函数 = Cost + Regularization Term

L2正则化

又称为权值衰减(weight decay)

红框中取的lambda取二分之一,为了之后求导时只剩下lambda

pytorch中L2正则化的使用:

在优化器中设置weight_decay参数,即lambda参数

optim_wdecay = torch.optim.SGD(net_weight_decay.parameters(), lr=lr_init, momentum=0.9, weight_decay=1e-2)

Drop out

待补充

2221

2221

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?