50多年前,在一个叫欧洲公馆的小区,住着一个人,名叫法国,他是做微商的,每天在朋友圈里更新信息。

有一天晚上他无聊,搜了一下附近的人,一看卧槽原来周围有好多做微商的。

然后他就分别加了这些人好友,平常没事儿把这些人叫出来一起出来撸串,吃点烤韭菜,烤大腰子什么的。

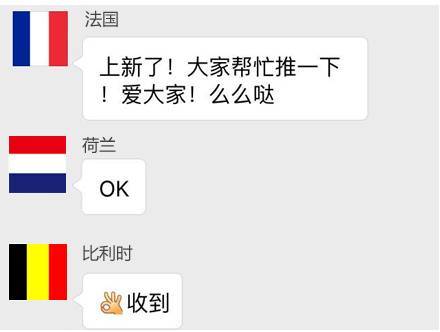

聚了几次后大家都比较熟了,有人提了个建议,既然哥几个都是做微商的,不如咱们合作吧!平常上新之后可以互相推一推啥的,用户资源共享。

大家都觉得这个主意不错,于是大家伙拉了个群,因为大家都住在欧洲公馆小区,所以群名就叫做。

简称欧洲共同体。于是,几个人形成了一个小组织,互相导流量卖东西。

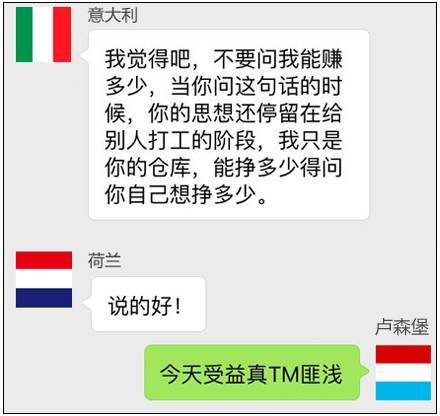

他们经常在群里交流微商心得,让彼此互相成长

虽然有些时候会起一些小争执

但总体上来说大家还是能和睦相处的,几个人紧密合作,互通有无,很快就发展起来,迅速成为当地街道无人不知,无人不晓的组织。

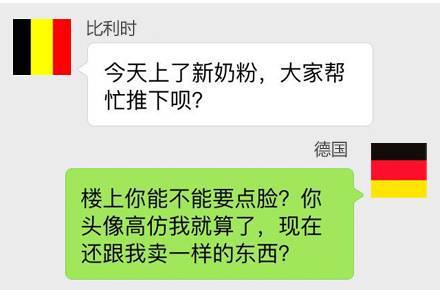

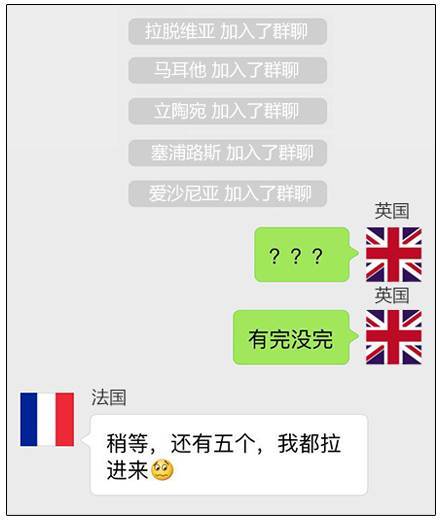

很快,小区里其他几个做微商的人慕名而来,也想加入到这个组织,希望跟他们共同发展。

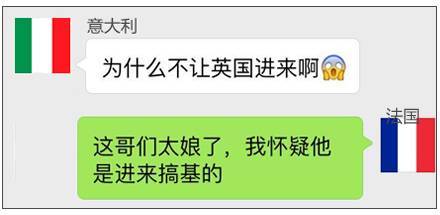

按理说组织正处于发展初期,应该多拉点新人进来,特别是这个英国,个人能力很强,如果他能进来将大大提高组织的实力,但法国一开始死活不同意让英国进群,因为他认为。

其实法国不想拉英国进群的真正原因是,英国有哥们是网红,他俩关系特别好。有次法国发了条微博@了这个网红,结果…

敌人的朋友就是敌人…

但法国最终还是让英国进群,毕竟组织的发展更重要。

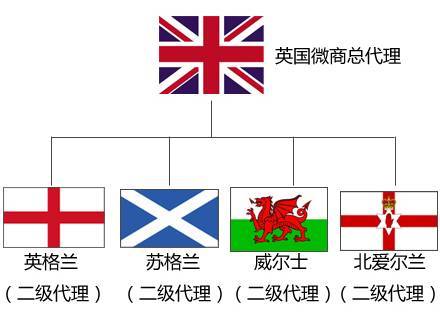

其实英国这哥们家里很有钱,贵族出身,旗下还有四个微商的二级代理。

就算他不加入这个组织自己也能干的很好,他加群的目的纯碎是闲着无聊。

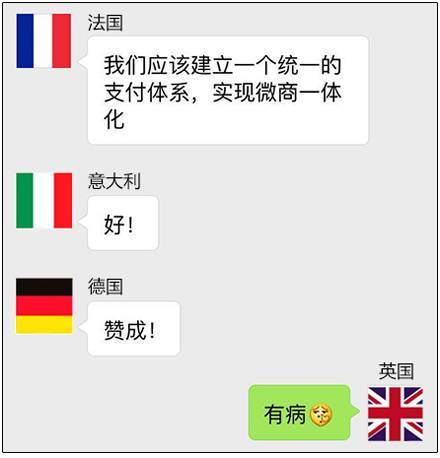

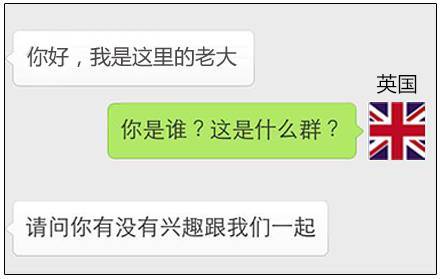

因为英国是贵族出身,骨子里有一种骄傲感,经常在群里说一些莫名其妙的话。

作为一个微商大号,英国希望自己在这个组织树立威信,让大家都听他的,但法国和德国也是大号,而且还是创始人,所以话语权一直掌握在法国和德国手里。

但毕竟英国的个人实力很强,大家还是会给他点面子。很快又有其他新人加入,大家在群里和睦相处。

群里已经有12个成员了,这时大家觉得应该把群名改一下,之前的名字太土了了.于是大家商量了一下,将群名改为

简称欧盟。同时群主还规定,以后大家不能光在群里聊天和互推,还要发红包,考虑到群里每个人的实力不同,每个人发红包的多少是根据自己每天做微商的收入乘一个比例来计算的。所以有的人发的多,有的人发的少。

这让英国很不爽,凭什么让我要发更多钱,老子是来做微商还是来扶贫啊,但英国还是忍了,因为通过这段时间的合作他发现这种互推的方式还挺有效的,但没过多久,让他更不爽的事情发生了。

在欧洲公馆东边有个穷逼小区,叫华约家园,前段时间这个小区物业的头跑路了,剩下几个员工没事干。这时欧盟正好需要人手,干脆把这些人全拉进来做微商。

英国非常不爽,老子是贵族,你拉进来的都是什么人。但组织的扩张还在继续,很快就把周围做微商的全都拉进来了,一共28个人。

英国的内心开始变化,他发现有的人发红包,1块钱拆成28份发,有的人只抢不发,有的人甚至拿Q币充数。这些都让英国对这个群产生了一些抵触心理。

对群里人提出的一些想法,英国永远持观望态度。

在这期间英国下面一个叫苏格兰的二级代理想脱离英国自己出去单干,还好最后被英国劝回来了。

然后接下来的几年,在中国、美国等网红的冲击下,微商越来越不好做了,大家的生意都很惨淡。然而按照群规,英国每天还要往群里发数额不菲的红包。

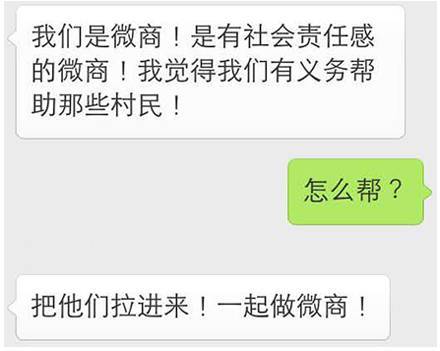

在欧洲公馆的东南方向有个村子叫叙利亚村,村里有几个神经病,见人就打,所以村子的很多居民搬出了村子,有些村民就在欧洲公馆小区里闲逛。有一天群主在群里对大家说。

于是他们把这些村民拉进来,做他们的二级代理。英国不干了,凭什么!然后英国下面的几个二级代理也不干了,现在本来市场就不好,又来了这么多人跟我们来分钱,宝宝们不同意!英国甚至威胁群主说

其实英国并不想退群,因为他知道一旦退出对他影响很大,他只是想威胁一下群主争取更多的话语权,但没想到他下面几个二级代理有不同意见,有些强烈要求他退群,有些觉得不退出也挺好的,英国犹豫不决。

最后他们决定,采用一种公平的方式来决定。

没办法,最终英国只好选择了退群

第二天,英国被拉进了另外一个群

http://mt.sohu.com/20160627/n456463186.shtml

天啦,这才是英国退欧的真相!

最新推荐文章于 2022-04-12 17:01:25 发布

3009

3009

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?