这里给出在单机环境下Spark History Server配置

首先修改两个配置文件

vim spark-env.shexport SPARK_MASTER_IP=***.***.***.***

export SPARK_HISTORY_OPTS="-Dspark.history.ui.port=18080 -Dspark.history.retainedApplications=10 -Dspark.history.fs.logDirectory=file:///home/zzx/spark-1.1.0-bin-hadoop1/historylogs"

export SPARK_CONF_DIR=/home/zzx/spark-1.1.0-bin-hadoop1/confvim spark-defaults.confspark.eventLog.enabled true

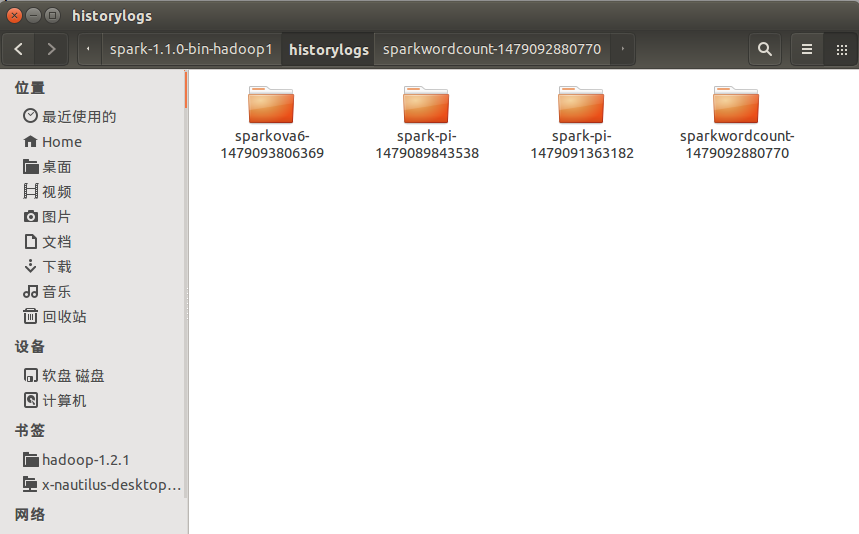

spark.eventLog.dir file:///home/zzx/spark-1.1.0-bin-hadoop1/historylogs

spark.history.fs.logDirectory file:///home/zzx/spark-1.1.0-bin-hadoop1/historylogs

配置完后记得source一下 这里文件路径原本是HDFS路径 但是在后面测试过程中无论运行多少次程序,History Server页面一直是空白状态,后面改成本地文本路径就行了

然后启动spark,以及Spark History Server

sbin/start-all.sh

sbin/start-history-server.shjps查看状态

在CLI命令行界面测试运行spark自带的例子SparkPi

bin/run-example SparkPi运行多次程序后,根据SPARK_MASTER_IP加上端口号18080即可访问页面

在eclipse运行程序的时候,记得加上一段代码,因为eclipse提交程序不像CLI会查看spark的conf文件,所以这里需要手动加入,注意程序最后记得关闭sc,如下:

val conf = new SparkConf().setAppName("SparkWordCount")

.setMaster("local")

.set("spark.eventLog.enabled","true")

.set("spark.eventLog.dir","/home/zzx/spark-1.1.0-bin-hadoop1/historylogs")

val sc = new SparkContext(conf) //设置sc

sc.stop //关闭sc在配置的文件路径下也可以查看到历史记录信息:

830

830

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?