1. DeepSeek-R1 本地部署全流程

DeepSeek-R1 是一款大型预训练语言模型,本文将带您完成从安装 Ollama 到启动 DeepSeek-R1 模型的全过程。

步骤 1:下载与安装 Ollama

- 访问 Ollama 官网(Ollama)进行下载安装。

- 根据操作系统选择合适的版本,按提示完成安装。

步骤 2:选择适合的 DeepSeek-R1 模型版本

- 在 Ollama 命令行界面运行以下命令启动 DeepSeek-R1 模型:ollama run deepseek-r1:7b

- 模型选择:根据显卡配置,选择合适的模型版本。如果显卡性能较低,可以先尝试 1.5B 版本。

步骤 3:解决常见问题

- 如果在启动时遇到 GPU 使用率低且推理速度慢的问题,通常是由于 Ollama 版本较旧导致。建议重新下载最新版本并安装。

2. 安装 Page Assist 插件:为本地模型添加 Web UI 操作界面

Page Assist 插件可以为您的本地 AI 模型提供一个方便的 Web UI 界面。下面是安装和配置的步骤:

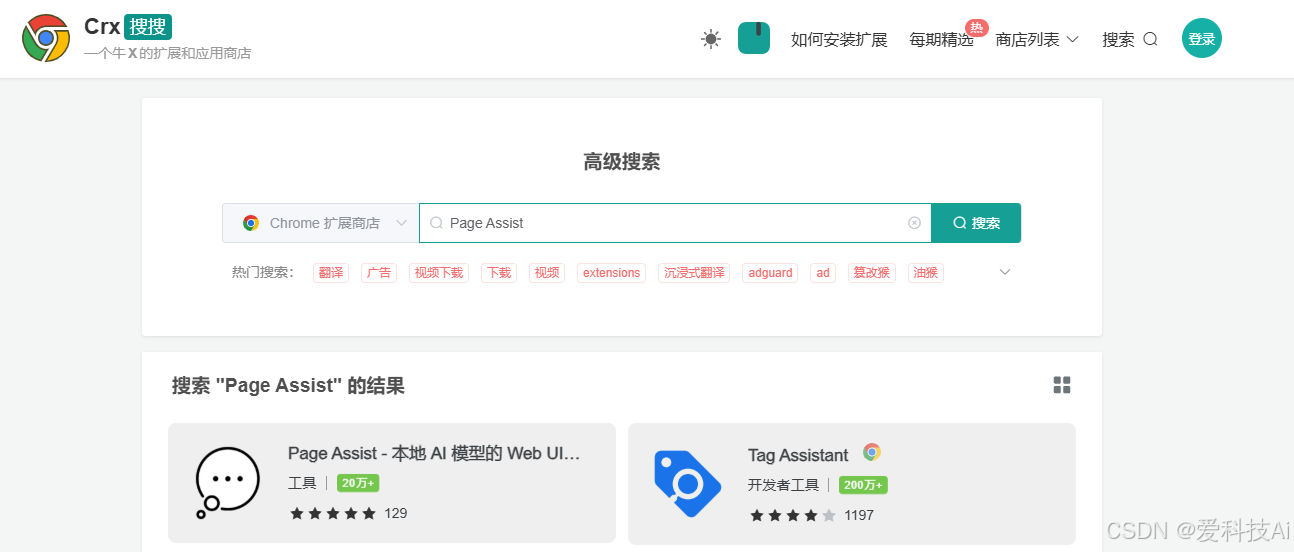

步骤 1:下载 Page Assist 插件

- 访问 Crx搜搜 网站(Crx搜搜 - 一个牛X的扩展和应用商店),搜索 Page Assist 插件。

- 下载插件文件(CRX 格式)。

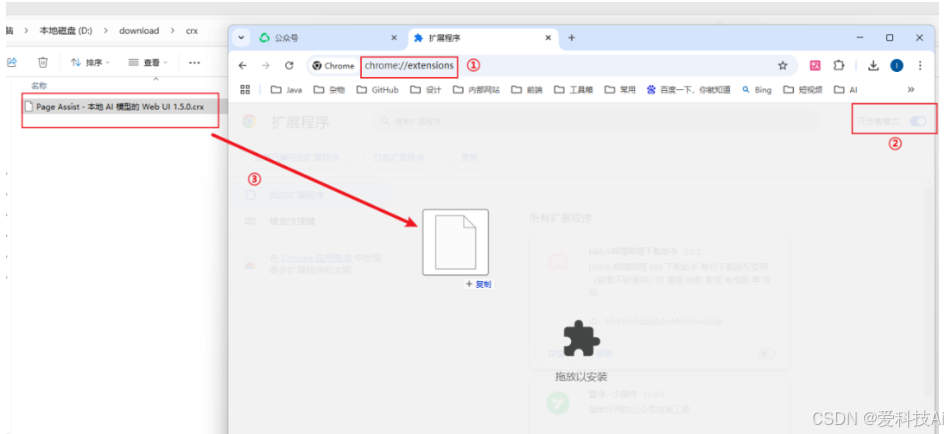

步骤 2:安装插件

- 打开 Chrome 浏览器,在地址栏输入

chrome://extensions/。 - 开启 开发者模式,然后将下载的 CRX 文件拖入浏览器进行安装。

步骤 3:配置 Page Assist 插件

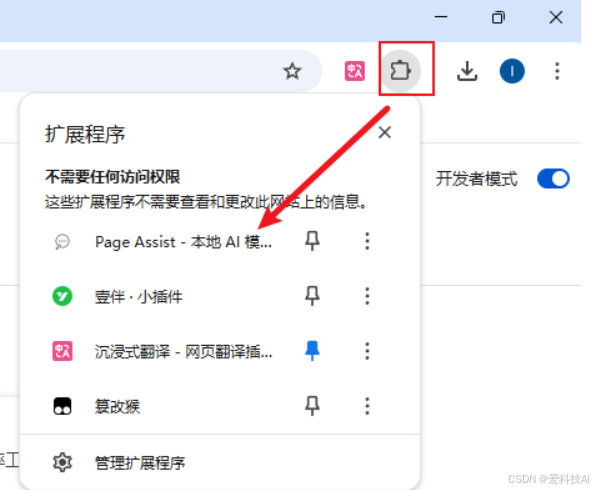

- 在 Chrome 浏览器 的扩展程序列表中找到 Page Assist,点击进入插件界面。

- 在左上角选择 DeepSeek-R1:7b 作为运行的模型。

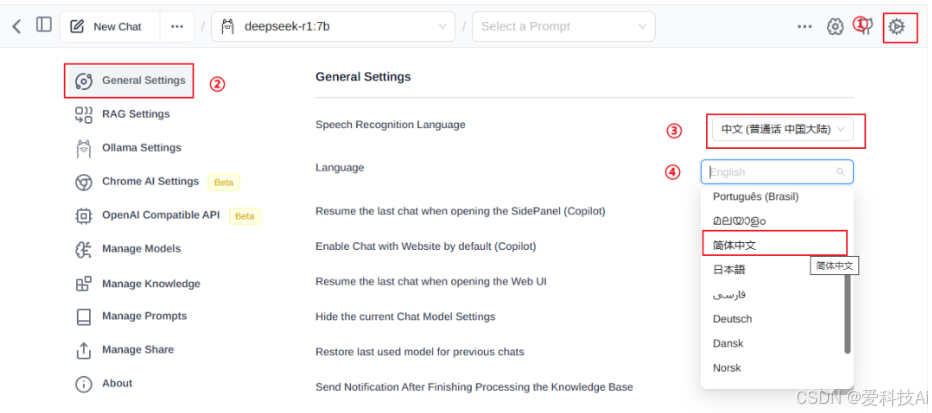

- 配置完成后,首次使用会显示英文界面,点击右上角设置齿轮,选择 简体中文。

3. 配置联网搜索功能

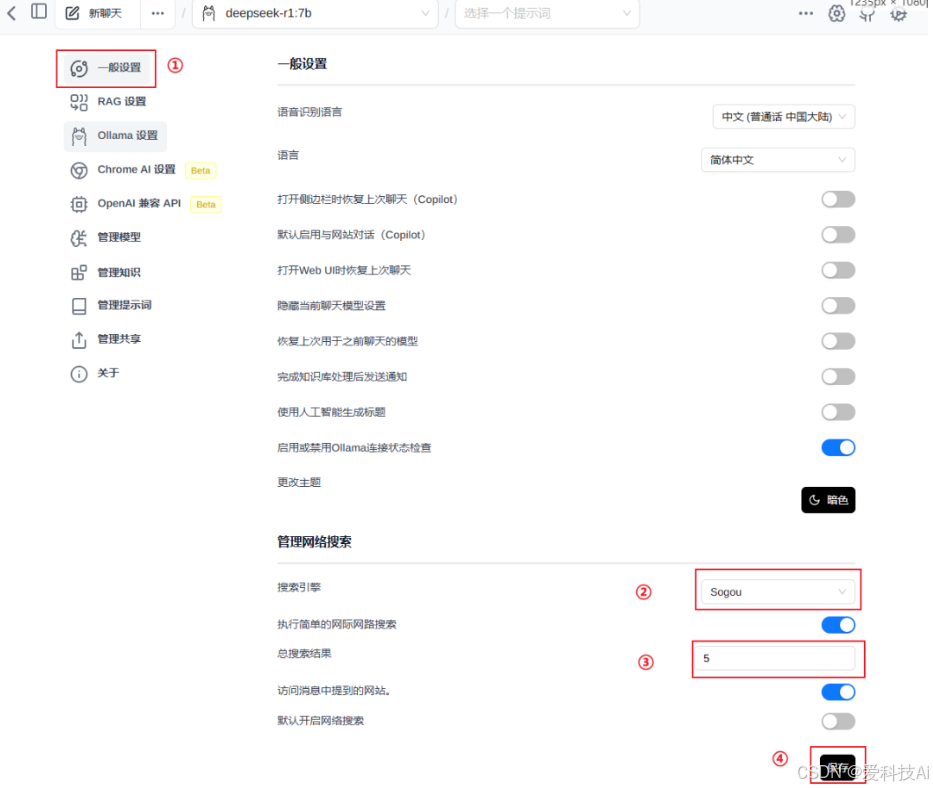

步骤 1:进入设置页面

- 在 Page Assist 插件界面的右上角,点击设置齿轮图标,进入 一般设置。

- 在 管理网络搜索 中,选择合适的搜索引擎。您可以调节默认搜索结果的数量,建议调大以增加联网资源的参考权重。

步骤 2:启用联网搜索

- 在聊天界面下方,打开 搜索互联网 开关。

- 现在,您可以在提问时同时获得本地推理结果和联网搜索的结果。

4. 搭建私人知识库

在本地部署 AI 模型的同时,您还可以通过 AnythingLLM 实现 私人知识库 的搭建。通过简单的几步,您的模型将能够处理并检索本地文档。

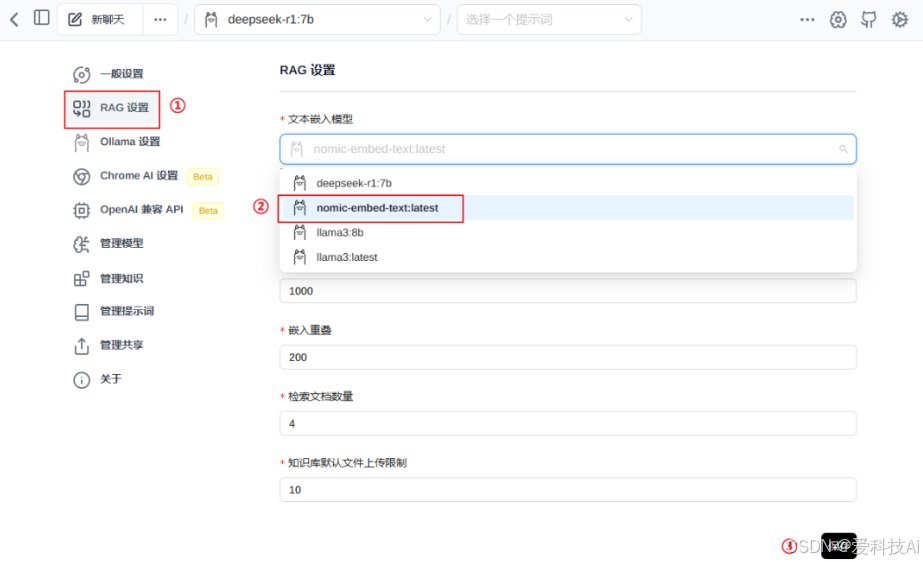

步骤 1:安装文本嵌入模型

-

在 CMD 命令窗口 输入以下命令,下载文本嵌入模型:

ollama pull nomic-embed-text -

回到 设置 页面,选择 RAG 设置,将文本嵌入模型设置为 nomic-embed-text:latest。

步骤 2:上传并管理知识库

- 在 管理知识 菜单中,点击 添加新知识。

- 输入知识的标题,上传相关文档或文本资料。

- 提交后,系统会处理文本资料,直到状态变为 已完成。

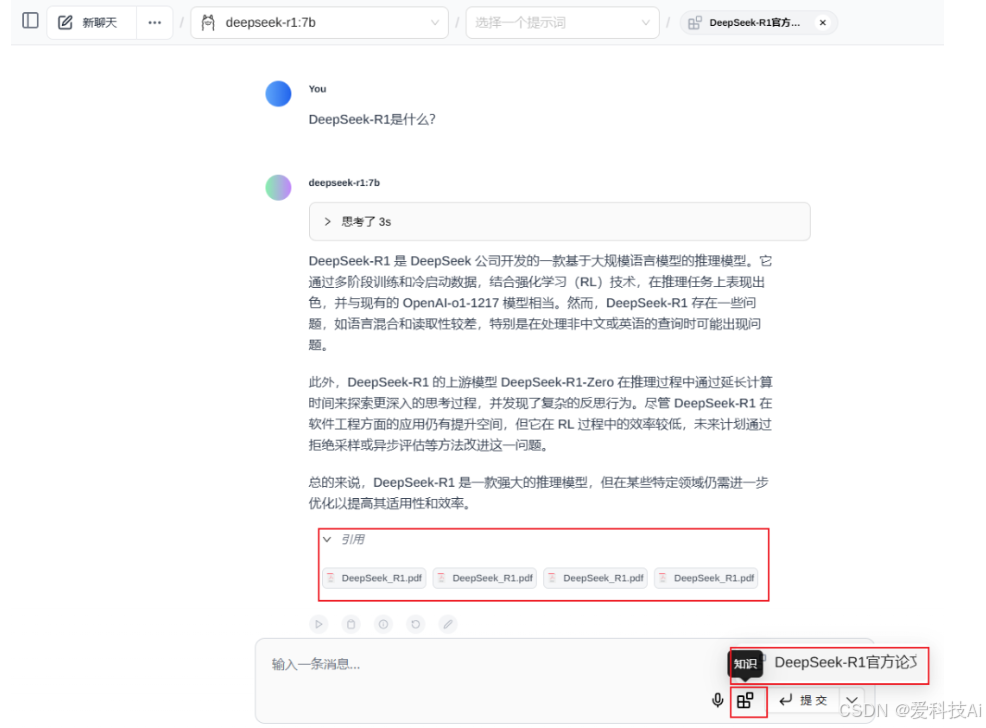

步骤 3:使用知识库

-

回到聊天窗口,右下方将出现刚刚添加的知识库,您可以在提问时选择相关知识库,获得准确的答案。

5. 总结

通过 Ollama、Page Assist 插件 和 私人知识库 的结合,可以轻松完成 DeepSeek-R1 的本地部署,启用联网搜索和构建自己的知识库。无论是中小企业还是个人开发者,这种方案都提供了一个 低成本、高效能 的方式,利用 DeepSeek-R1 强大的推理能力来解决实际问题。

本地部署、联网搜索、知识库管理,通过这些简单的步骤,将能够为自己的项目构建强大的 AI 模型应用。

1717

1717

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?