本文来源公众号“机器学习AI算法工程”,仅用于学术分享,侵权删,干货满满。

原文链接:NLP 实战项目:使用 BERT 进行模型微调,进行文本情感分析

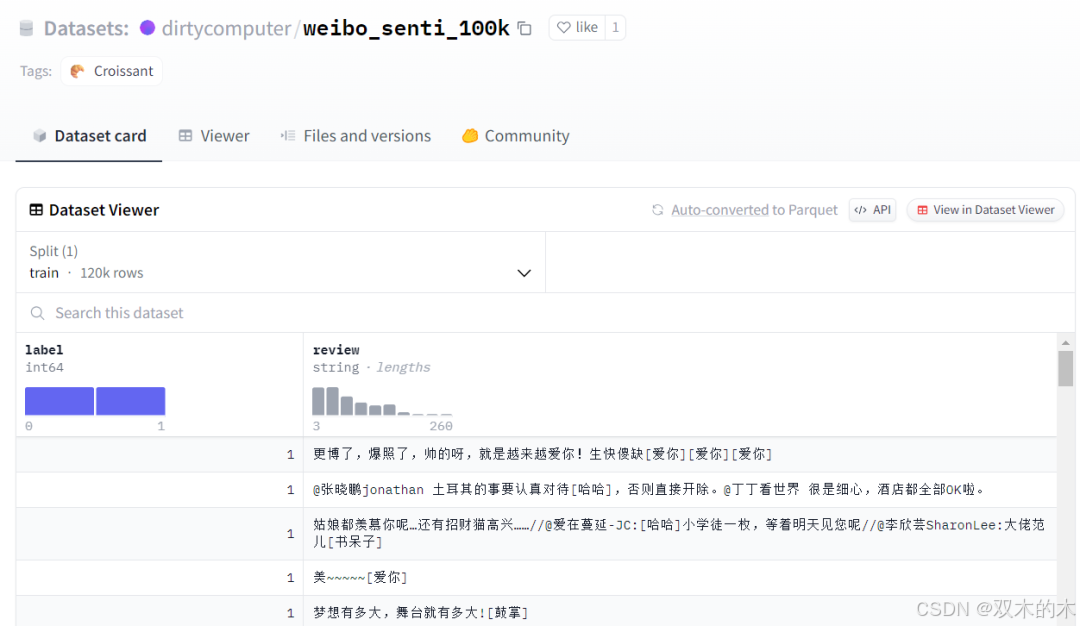

本篇我们使用公开的微博数据集(weibo_senti_100k)进行训练,此数据集已经进行标注,0: 负面情绪,1:正面情绪。数据集共计82718条(包含标题)。如下图:

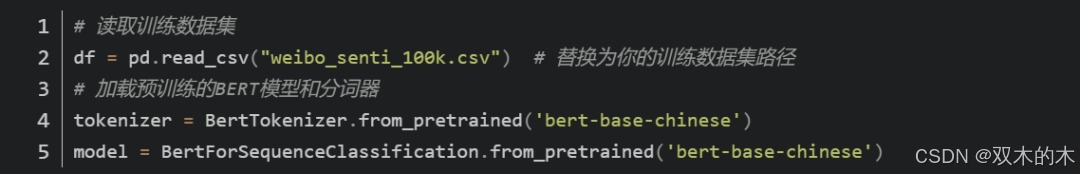

下面我们使用bert-base-chinese预训练模型进行微调并进行测试。

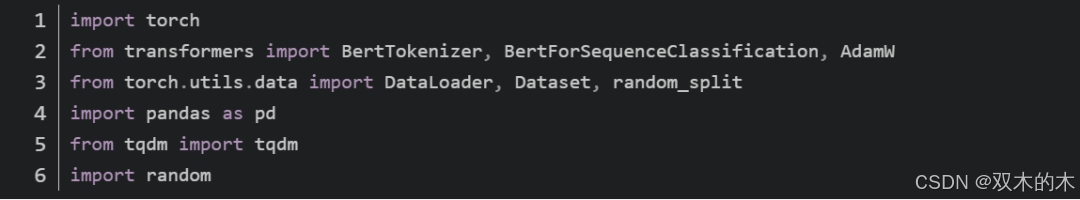

1. 导入必要的库

2. 加载数据集和预训练模型

3. 对数据集进行预处理

注意:此处需要打乱数据行,为了快速训练展示,下面程序只加载了1500条数据。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

847

847

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?