前言

前一篇实现了OpenCV推理ResNet18, 这一篇采用腾讯的NCNN框架实现ResNet18推理。

一、准备

1、 NCNN编译及安装

同OpenCV推理一样,首先需要准备NCNN,NCNN源码编译及安装可参考:

https://www.cnblogs.com/xiaxuexiaoab/p/16416374.html

2、其他环境

Windows10

visual Studio 2019

二、NCNN推理ResNet18

1、模型转换

前面已经讲过如何将训练好的模型转换为ONNX格式,要采用NCNN完成推理,还需要进一步将ONNX格式模型转换成NCNN格式,如*.param, *.bin 。

param相应的格式说明可以参考:

https://www.cnblogs.com/xiaxuexiaoab/p/16420002.html

ONNX模型转换为NCNN格式可以参考:

https://www.cnblogs.com/xiaxuexiaoab/p/16638276.html

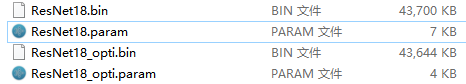

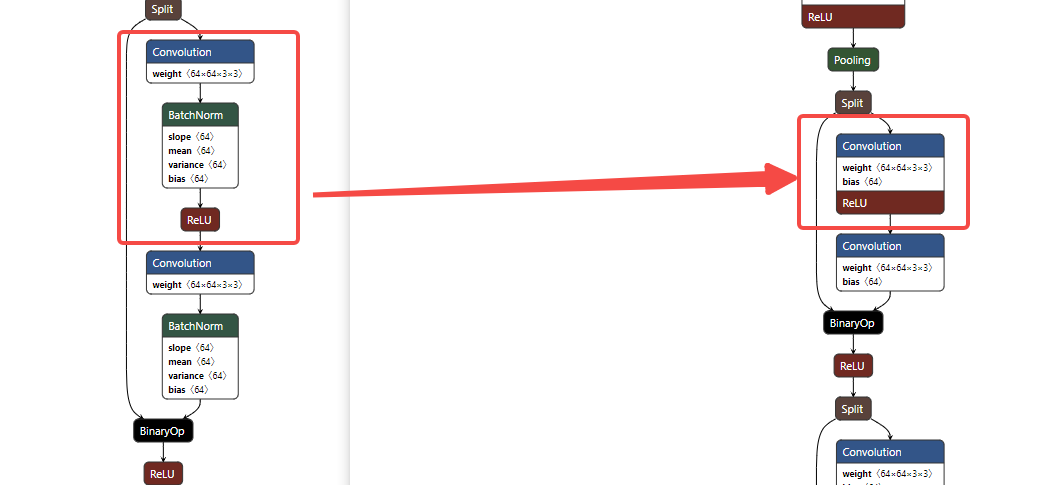

通常转换后都会调用ncnnoptimize对其进行优化,可以看到大小和参数量都会变少,这是因为对ncnn模型中部分算子进行合并优化等

以下是转换为param和简化后param的部分视图

2、模型加载

#include "ncnn/net.h"

ncnn::Net net;

// net.opt.use_vulkan_compute = true;

//// 1.Load model

//// --- method 1 ---

//net.load_param(paramPath.c_str());

//net.load_model(binPath.c_str());

//// --- method 2 ---

//net.load_param_bin(paramBinPath.c_str());

//net.load_model(binPath.c_str());

//// --- method 3 ---

// // need #inlucde "test_sim.mem.h"

//net.load_param(test_sim_param_bin);

//net.load_model(test_sim_bin);

//// --- method 4 ---

// Load Model

// net.opt.use_vulkan_compute = true;

FILE* fp = fopen(modelPath.c_str(), "rb");

net.load_param_bin(fp);

net.load_model(fp);

fclose(fp);

const std::vector<ncnn::Blob>& netBlobs = net.blobs();

const std::vector<ncnn::Layer*>& netLayers = net.layers();

std::cout << " blobs: " << netBlobs.size() << " layers: " << netLayers.size() << std::endl;

最后输出的blobs数量和layers数量能对应上param里面的数据,即表示加载成功。

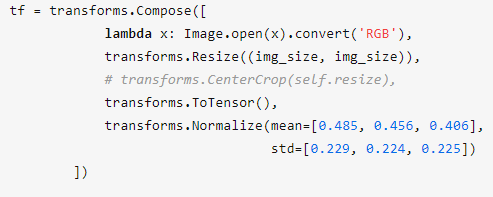

3、数据预处理

还是依照python脚本对数据进行预处理

这里采用NCNN自带的一些处理工具,所以预处理转为C++代码如下所示

cv::Mat cvImg= cv::imread("./test.png");

if (cvImg.empty()) {

// read img failed

return false;

}

ncnn::Mat in = ncnn::Mat::from_pixels_resize(cvImg.data, ncnn::Mat::PIXEL_BGR2RGB, cvImg.cols, cvImg.rows, targetSize, targetSize);

const float MEANS[3] = { 123.675, 116.28, 103.53 };

const float STD[3] = { 1.0 / 58.395, 1.0 / 57.120, 1.0 / 57.375 };

input.substract_mean_normalize(MEANS, STD);

里面from_pixels_resize接口将CV::Mat cvImg 通道格式由BGR转换为RGB,并由(cvImg.cols, cvImg.rows)缩放至(targetSize, targetSize)大小。

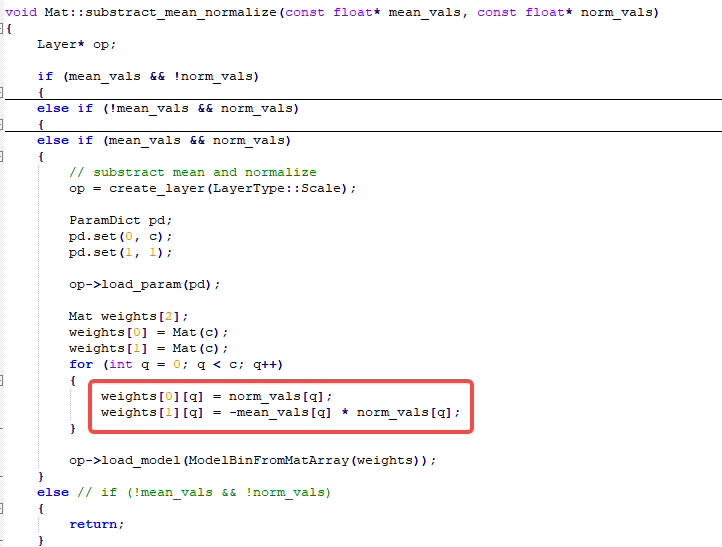

后面substract_mean_normalize接口实现归一化, 注意:这里没有先除255.0将像素值归一化到[0, 1],所以相应的值乘了255,而STD这里采用倒数,是该接口里面是采用乘法

4、模型推理

前面已经加载好了模型,并且数据进行了转换,接下来进行推理

ncnn::Extractor ex = net.create_extractor();

ex.set_num_threads(4);

ex.input("input", input);

ncnn::Mat out;

ex.extract("output", out);

模型的推理结果已经存储到ncnn::Mat out里面,接下来对其进行解析即可得到类型。

ncnn::Layer* sigmoid = ncnn::create_layer("Sigmoid");

ncnn::ParamDict pd;

sigmoid->load_param(pd);

sigmoid->forward_inplace(out, net.opt);

float* outPtr = out.channel(0); // here just deal with 2 class

int classId;

if (outPtr[0] > outPtr[1]) {

classId = 0;

}

else {

classId = 1;

}

以上操作对结果进行了sigmoid操作,输出的outPtr及对应类别的置信度。

最后

感谢你们的阅读和喜欢,我收藏了很多技术干货,可以共享给喜欢我文章的朋友们,如果你肯花时间沉下心去学习,它们一定能帮到你。

因为这个行业不同于其他行业,知识体系实在是过于庞大,知识更新也非常快。作为一个普通人,无法全部学完,所以我们在提升技术的时候,首先需要明确一个目标,然后制定好完整的计划,同时找到好的学习方法,这样才能更快的提升自己。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

一、全套AGI大模型学习路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、AI大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型商业化落地方案

五、面试资料

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

1342

1342

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?