第二章:BP算法详解

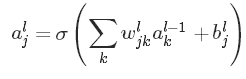

首先需要理解的是权值的含义,wji是连接L-1层的第i个神经元和L层第j个神经元的权值。同时输入层和输出层不存在偏置。由下边公式可知,权值角标的安排是为了更直观的看到上一层的作为下一层的输入。L-1为0时激活值就是输入。

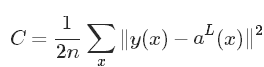

我们再来看目标函数:与第一章一样,仍然运用的是MSE。

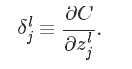

接下来我们来看一个新概念:δji,表示L层第j个单元存在的误差。该单元输入微小的变化∆Zji会导致整体损失变化,可以看到

决定着变化的大小。所以我们以此来可以定义误差:

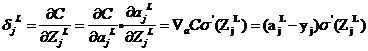

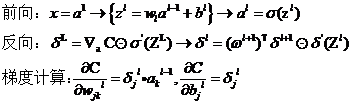

由于BP算法中涉及到误差的反向传播,我们从计算输出层的误差开始。这里需要注意的,输出层的误差很容易计算,所以先计算输出层误差,再反向计算各层各单元误差。 所以,输出层误差计算公式为:

前一张讲到用到的激活函数是sigmoid,当其靠近0或者1时,此函数是十分平滑的,此时它的导数为0,这样就导致最后一层的权值学习变慢,我们把这一现象称为神经元饱和现象,其结果就是权值停止更新,网络也就无法再学习了。

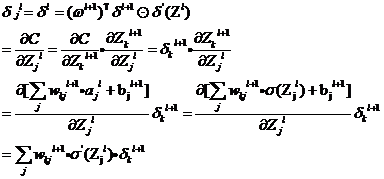

然后我们再来看误差反向传播计算公式:

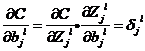

通过上述两个公式就可以算出每个每个神经元的误差了。我们再来看看目标函数相对于偏置微分:

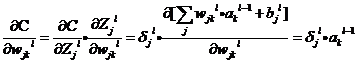

可以看到,目标函数对偏置的微分等于误差。这意味着我们也可以通过偏置来计算误差。同样我们来看看C相对于W的偏微分:

可以看到此偏微分项和上一层的输出及本层的误差正相关。如此,利用上述四个公式,我们就可以写出完整的BP算法了:

将BP算法引用到SGD中就可以加快计算速度了。

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?