监督学习从数据中学习一个分类模型或分类决策函数,称为分类器。分类器对新的输入进行输出的预测,称为分类。可能的输出称为类。分类的类别为多个时,称为多类分类问题,在此讨论二类分类问题常用的评估指标:召回率与正确率。

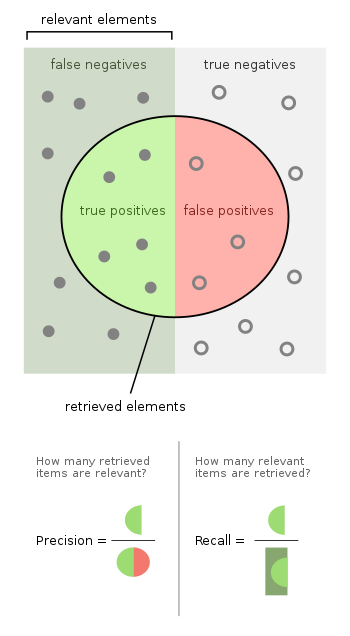

通常关注的类称为正类,其他的称为负类。分类器在测试数据集上预测正确或者不正确的四种情况出现的总数记为:

TP:将正类预测为正类的数目;

FP:将负类预测为正类的数目;

TN:将负类预测为负类的数目;

FN:将正类预测为负类的数目;

精确率定义为: P = TP/(TP + FP)

召回率定义为: R = TP/(TP + FN)

精确率表示所有被预测为正类的数据中,正类所占的比例;

召回率表示所有正类数据中,被预测为正类的比例;

附WiKi图解释[2]:

F1值也是一个评估指标,其为精确率与召回率的调和平均数:

2/F1 = 1/P + 1/R

为何要增加一个F1值呢。

在分类时,当然是希望精确率越高越好,同时召回率越高越好。但是,在某些情况下,两者是有矛盾的。

用一个其他人讲的有趣的称为女友炸裂理论的例子对这种情况进行说明。

传送门:https://www.zhihu.com/question/19645541/answer/206624303

[1] http://charleshm.github.io/2016/03/Model-Performance/

[2] https://en.wikipedia.org/wiki/F1_score

[3] https://www.zhihu.com/question/19645541

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?