1. NiN

LeNet、AlexNet和VGG都有一个共同的设计模式:通过一系列的卷积层与汇聚层来提取空间结构特征;然后通过全连接层对特征的表征进行处理。 AlexNet和VGG对LeNet的改进主要在于如何扩大和加深这两个模块。而NiN模型去除了全连接层模块,保留了特征的空间结构,,在每个像素的通道上面使用1x1卷积层(全连接层)。

1.1 NiN块

回想一下,卷积层的输入和输出由四维张量组成,张量的每个轴分别对应样本、通道、高度和宽度。 另外,全连接层的输入和输出通常是分别对应于样本和特征的二维张量。 NiN的想法是在每个像素位置(针对每个高度和宽度)应用一个全连接层。 如果我们将权重连接到每个空间位置,我们可以将其视为 1×1 卷积层,或作为在每个像素位置上独立作用的全连接层。 从另一个角度看,即将空间维度中的每个像素视为单个样本,将通道维度视为不同特征(feature)。

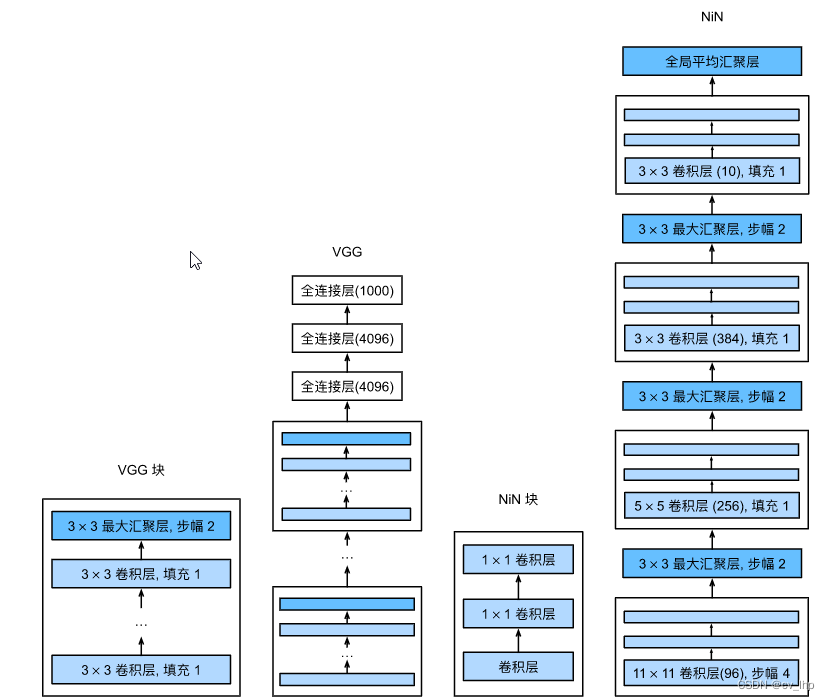

下图为VGG和NiN及它们的块之间主要架构差异。 NiN块以一个普通卷积层开始,后面是两个 1×1 的卷积层。这两个 1×1 卷积层包含了ReLU激活函数。 第一层的卷积窗口形状通常由用户设置,为超参数。 随后的卷积窗口形状固定为 1×1 。

NiN块的实现代码:

#参数为第一个卷积层所需要的超参数

def NiN_blocks(in_channels,out_channels,kernel_size,padding,stride):

return nn.Sequential(nn.Conv2d(in_channels=in_channels,out_channels=out_channels,kernel_size=kernel_size,padding=padding,stride=stride),

nn.ReLU(),

nn.Conv2d(in_channels=out_channels,out_channels=out_channels,kernel_size=1),

nn.ReLU(),

nn.Conv2d(in_channels=out_channels,out_channels=out_channels,kernel_size=1),

nn.ReLU())

1.2 NiN模型

最初的NiN网络是在AlexNet后不久提出的,显然从中得到了一些启示。 NiN使用窗口形状为 11×11 、 5×5 和 3×3 的卷积层,输出通道数量与AlexNet中的相同。 每个NiN块后有一个最大汇聚层,汇聚窗口形状为 3×3 ,步幅为2。

NiN和AlexNet之间的一个显著区别是NiN完全取消了全连接层。 相反,NiN使用一个NiN块,其输出通道数等于标签类别的数量。最后放一个全局平均汇聚层(global average pooling layer),生成一个对数几率 (logits)。NiN设计的一个优点是,它显著减少了模型所需参数的数量(使用卷积层的参数比全连接层参数少很多,因为卷积核参数权重共享)。然而,在实践中,这种设计有时会增加训练模型的时间。

NiN模型代码如下:

def NiN():

net = nn.Sequential(NiN_blocks(in_channels=1,out_channels=96,kernel_size=11,padding=0,stride=4),

nn.MaxPool2d(kernel_size=3,stride=2),

NiN_blocks(in_channels=96,out_channels=256,kernel_size=5,padding=2,stride=1),

nn.MaxPool2d(kernel_size=3,stride=2),

NiN_blocks(in_channels=256,out_channels=384,kernel_size=3,padding=1,stride=1),

nn.MaxPool2d(kernel_size=3,stride=2),

nn.Dropout(0.5),

# 标签类别数是10

NiN_blocks(in_channels=384,out_channels=10,kernel_size=3,padding=1,stride=1),

nn.AdaptiveAvgPool2d((1,1)),

# 将四维的输出转成二维的输出,其形状为(批量大小,10)

nn.Flatten())

return net

NiNNet = NiN()

X = torch.randn(size=(1,1,224,224))

for layer in NiNNet:

X = layer(X)

print(layer.__class__.__name__,"output shape : \t",X.shape)

1.3 小结

- NiN使用由一个卷积层和多个 1×1 卷积层组成的块。

- NiN去除了容易造成过拟合的全连接层,将它们替换为全局平均汇聚层(即对整个通道上面所有位置上进行求和再求平均)。该汇聚层通道数量为所需的输出数量(例如,Fashion-MNIST的输出需要为10)。

- 移除全连接层可减少过拟合,同时显著减少NiN的参数。

- NiN的设计影响了许多后续卷积神经网络的设计。

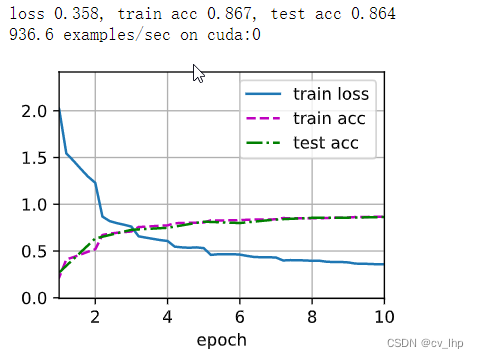

2.NiN模型训练全部代码(学习率lr为0.1,训练轮数epochs为10轮,batch_size为124):

import d2l.torch

import torch

from torch import nn

def NiN_blocks(in_channels,out_channels,kernel_size,padding,stride):

return nn.Sequential(nn.Conv2d(in_channels=in_channels,out_channels=out_channels,kernel_size=kernel_size,padding=padding,stride=stride),

nn.ReLU(),

nn.Conv2d(in_channels=out_channels,out_channels=out_channels,kernel_size=1),

nn.ReLU(),

nn.Conv2d(in_channels=out_channels,out_channels=out_channels,kernel_size=1),

nn.ReLU())

def NiN():

net = nn.Sequential(NiN_blocks(in_channels=1,out_channels=96,kernel_size=11,padding=0,stride=4),

nn.MaxPool2d(kernel_size=3,stride=2),

NiN_blocks(in_channels=96,out_channels=256,kernel_size=5,padding=2,stride=1),

nn.MaxPool2d(kernel_size=3,stride=2),

NiN_blocks(in_channels=256,out_channels=384,kernel_size=3,padding=1,stride=1),

nn.MaxPool2d(kernel_size=3,stride=2),

nn.Dropout(0.5),#注意此处的Dropout()层

# 标签类别数是10

NiN_blocks(in_channels=384,out_channels=10,kernel_size=3,padding=1,stride=1),

nn.AdaptiveAvgPool2d((1,1)),

# 将四维的输出转成二维的输出,其形状为(批量大小,10)

nn.Flatten())

return net

NiNNet = NiN()

X = torch.randn(size=(1,1,224,224))

for layer in NiNNet:

X = layer(X)

print(layer.__class__.__name__,"output shape : \t",X.shape)

#模型训练

lr,num_epochs,batch_size = 0.1,10,128

train_iter,test_iter = d2l.torch.load_data_fashion_mnist(batch_size=batch_size,resize=224)

d2l.torch.train_ch6(NiNNet,train_iter,test_iter,num_epochs,lr,device=d2l.torch.try_gpu())

NiN模型训练和测试输出结果如下图所示:

1210

1210

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?