支持向量机SVM(Support Vector Machine)是一种有监督的学习模型,它的核心有两个:一、核函数(kernel trick);二、序列最小优化算法SMO(Sequential minimal optimization)是John Platt在1996年发布的用于训练SVM的有效算法。本文不打算细化SVM支持向量机的详细推倒算法,只涉及以上两点的内容做一个说明,最后给出算法实现和一个实验对比图。

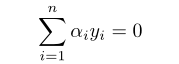

所需要收到的约束条件为:

所需要收到的约束条件为:

![]()

![]()

![]()

核函数

核函数在处理复杂数据时效果显著,它的做法是将某一个维度的线性不可分数据采取核函数进行特征空间的隐式映射到高维空间,从而在高维空间将数据转化为线性可分,最后回归到原始维度空间实施分类的过程,常见的几个核函数如下:

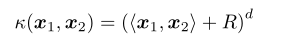

多项式核:

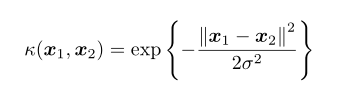

高斯核(径向基函数):

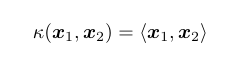

线性核:

即是两个矩阵空间的内积。

SMO算法流程

SMO的主要两个步骤就是:

1、选择需要更新的一对

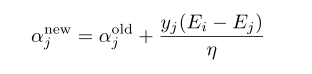

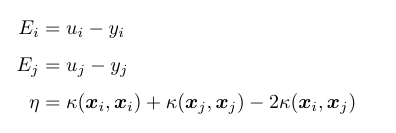

2、将目标函数对

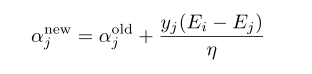

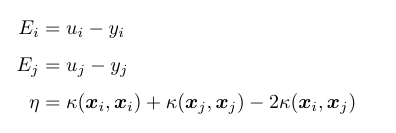

以上是两个基本步骤,实现具体推到公式如下:

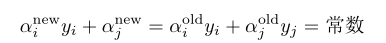

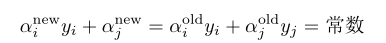

所需要收到的约束条件为:

所需要收到的约束条件为:

同时更新

消去

其中

本文介绍了基于Spark的SVM算法实现,详细讲解了核函数的作用,如多项式、高斯和线性核,以及SMO算法的流程,包括如何选择和更新变量。通过径向基函数的核函数计算,实现了数据的高维映射。最终,通过测试100个二维数据,展示算法达到98%的训练准确率。

本文介绍了基于Spark的SVM算法实现,详细讲解了核函数的作用,如多项式、高斯和线性核,以及SMO算法的流程,包括如何选择和更新变量。通过径向基函数的核函数计算,实现了数据的高维映射。最终,通过测试100个二维数据,展示算法达到98%的训练准确率。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?