目录

1.CNN简介

卷积神经网络(CNN)是一种前馈神经网络,其特点是每一层的的神经元节点只响应前一层局部范围内的神经元。

2.CNN本质特性

2.1 稀疏连接(稀疏互交)

网络的稀疏连接体现了神经网络每一层的神经元节点只响应前一层局部范围内的神经元的特点,处于深层的网络间接的连接了全部或者大部分的图像。

稀疏连接的物理意义,通常图像、文本、语音等数据都具有局部结构,我们可以先学习局部特点的特征,再将局部特征组合起来形成更加复杂抽象的特征。底层神经元提取到图像的细节信息,深层的神经元提取到图像的宏观信息,以人脸举例最底层可以检测出各个角度的边缘特点,位于中间层的神经元可以将边缘信息组合起来得到嘴、鼻子、眼睛等复杂特征,最后的深层网络的神经元可以根据各个器官的组合检测出人脸的特征。

2.2 参数共享

参数共享是指在同一个模型的不同模块中使用相同的参数,它是卷积运算的固有属性。在卷积神经网络中,卷积核中的每一个元素将作用于每一次局部输入的特定位置上。根据参数共享的思想,我们只需要学习一组参数集合,而不需要针对每个位置的每个参数都进行优化,换一句话说,就是同一层的所有神经元共享一组卷积核参数,从而大大降低了模型的存储需求。

参数共享的物理意义是使得卷积层具有平移等变性。如果一个函数满足输入改变,输出也以相同的形式改变这一性质就是等变的,如果函数,我们就说

对于变换

具有等变性,例如先把图像平移再卷积和先卷积再平移得到的结果是一样的,平移不变性的另一种理解是卷积核算子“处处表现相同”。

2.3小结

区别卷积神经网络的稀疏连接和神经网络的全链接的方式。正确理解参数共享是同一层的所有神经元共享一组参数而不是一个神经元共享一个卷积核,所以卷积核的个数不等于通道数。

3.CNN物理机制

3.1线性的卷积

首先我们需要知道卷积运算是线性的:

为函数,

为常数

3.2 离散卷积和相似度

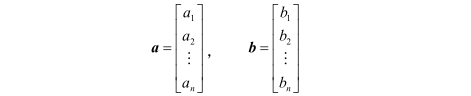

二维卷积的操作大家都非常的熟悉这里不做赘述,由上图可以看出,一个模板数组和一张图像数组逐点相乘后求和,在数学上称为两个数组的“点积”或者“内积”,其结果能反映模版和所覆盖的数组数值分布的相似性或者差异性,这就是隐藏在CNN中最低层的机制。具体地,给定两个数组

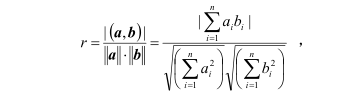

我们可以定义一个指标

能够证明,指标 0 ≤ r ≤ 1(余玄定理), r 是向量 a 和 b 相似性的一个度量,可称为相似度或匹配度,当r=0时完全不相似,r=1时是完全相同。

3.3小结

将卷积操过和相似度度量联系起来,这对用CNN做图像的语义分割会有帮助。

4.CNN的经典模型及特点

4.1经典网络

LeNet,AlexNet ,VggNet,GoogLeNet,ResNet等网络都是经典的网络,这些东西别人都写烂了随便百度下,找本深度学习的书都有,我就不讲了,把图贴一贴。

GoogLeNet

4.2多层CNN卷积的构造

通过观察经典网络的构造,在输入层中使用的卷积核往往是较大的11*11,7*7等,在输入层图像的尺寸是较大的所以需要用大的卷积核来捕捉特征,随着图像在网络中的尺寸越来越小,所需要的卷积核也越来小,1*1的卷积核的作用可以用来做降维减小参数量,也起到了恒等映射的作用。

参考

深度学习 ,Ian Goodfellow

深度学习之入门pytorch, 廖星宇

百面机器学习算法工程师带你去面试 ,诸葛越

卷积神经网络(CNN引导:物理机制和算法结构 ,邹谋炎

990

990

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?