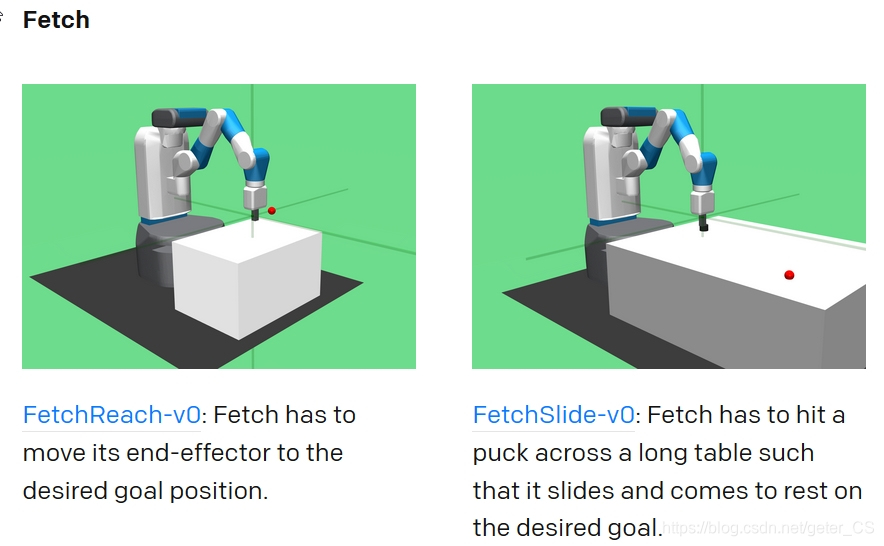

这是GYM上的一类机器人手臂游戏,依赖于MuJoco。包括有FetchReach、FetchSlide、FetchPush、FetchPickAndPlace、HandReach、HandManipulateBlock、HandMainpulateEgg、HandMainpulatePen等八个环境。(这篇教程的前提是有GYM的经验)

八个环境中都有目标(goal)概念,比如FetchPush的描述就是:推动一个盒子直到它到达目标位置(desired goal position)。FetchPickAndPlace-v0的描述是:从桌子上拿起一个盒子,将它放到桌子上的目标位置((desired goal position))。环境默认使用的奖赏时稀疏奖赏(sparse reward),完成任务时0奖赏,其他是-1奖赏,开发者认为稀疏奖赏更加适合实际机器人应用。同Mujoco上的10任务比如Walker2d一样这些都是连续控制型任务。

使用方式

同Atari和Mojoco一样首先我们看看这类任务的动作空间和状态空间:

env=gym.make("FetchPush-v0")

o=env.observation_space

print(o)

a=env.action_space

print(a)

输出:

Dict(achieved_goal:Box(3,), desired_goal:Box(3,), observation:Box(25,))

Box(4,)

可以看到FetchPush动作空间shape是4,而其observation_space却是一个字典,这与mujoco上的不一样,mojoco中每一个step会返回(除了奖赏和结束标志外)一个numpy型的状态,而在Robotics会返回achieved_goal, desired_goal, observation三个numpy。分别表示已到达的目标,实际目标,和observation。我们实际强化学习算法使用的状态,应该是 desired_goal, observation的结合,因此,加上一个语句就可以像Mujoco那样使用:

env=gym.make("FetchPush-v0")

env=gym.wrappers.FlattenDictWrapper(env,dict_keys=['observation','desired_goal'])

o=env.observation_space

print(o)

a=env.action_space

print(a)

输出:

Box(28,)

Box(4,)

或者我们可以在自己的策略参数中输入 desired_goal, observation:

action=policy(obs["observation"],obs["desied_goal"])

obs,reward,done,info=env.step(action)

649

649

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?