关注并星标

从此不迷路

计算机视觉研究院

公众号ID|ComputerVisionGzq

学习群|扫码在主页获取加入方式

今天分享的内容来自CSDN——成都_小吴,该同学撰写的一篇关于Yolov5桌面应用的开发工作,有兴趣的同学可以关注CSDN!具体文章链接:

https://blog.csdn.net/qq_52859223/article/details/122982212

计算机视觉研究院专栏

作者:Edison_G

本文主要讲解几个部分,(适合一些在读的研究生啥也不会然后接到一些项目无从下手,如果是大佬的话就可以跳过了)先看看网络摄像头的效果吧(在2060的电脑上运行 )

YoloV5的训练

很多做深度学习的伙伴肯定有跑过一些网上的目标检测开源项目,比如yolo系列,我跑过YOLOv4(VS编译进行对于我这个小白来说比较麻烦),还是YOLOv5使用pycharm在pytorch的环境下进行训练、测试,之类的(此内容只针对小白)。

先从搭建环境开始,首先你要去官网下载anaconda点击此处进入下载教程,就当你已经下载好anaconda了,然后你要下载一个编译器pycharm(简单的来说就是你编写python代码的一个APP),编译器有了现在就要创建一个虚拟环境了(通过anaconda创建一个虚拟环境,在这个环境里面你可以下载很多库模块,比如python—opencv,torch,tensorflow,Pyqt之类的第三方库你才能运行你的深度学习或者你的界面开发)。

如果你是做深度学习的话肯定有一个不错的GPU,我是下载的GPU版本的torch,所以都是以我自身的计算机能力下载相关配置:

# 创建(建议下载3.7我也不是很清楚)

conda create -n env_name python=x.x

#如果你要创建pytorch环境你可以如下操作(名字可以自己选择)

conda create -n pytorch python=3.7

# 删除

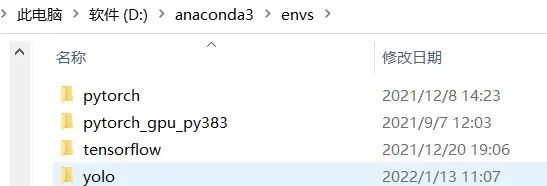

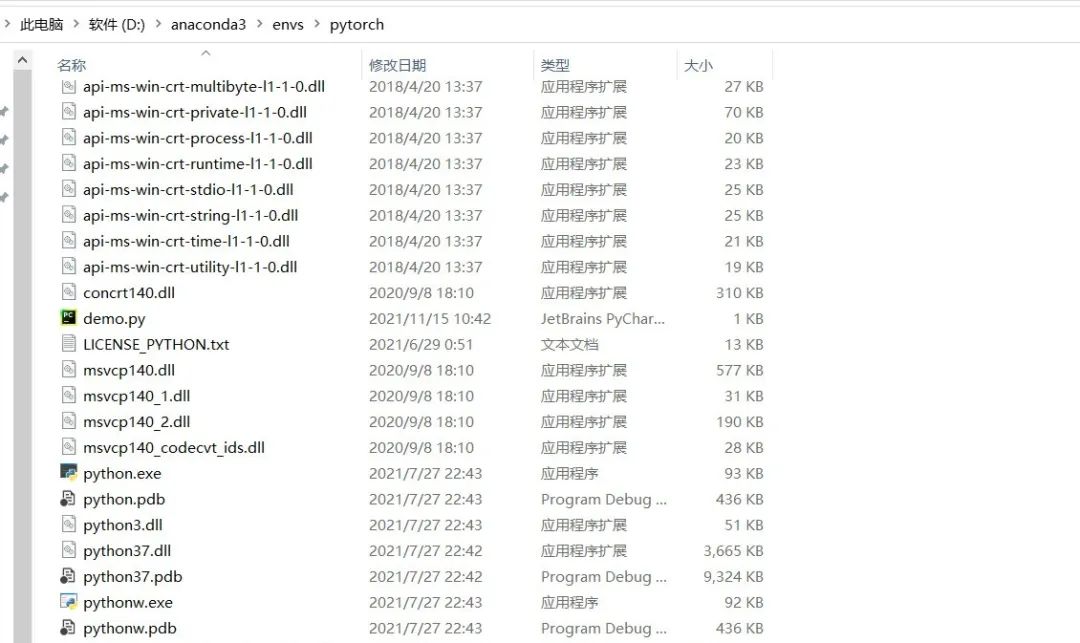

conda remove -n env_name --all创建完虚拟环境后你可以在你的anaconda目录下面找到你创建的环境如下图所示:

环境创好了、编译器也下载好了,大家伙不要着急!马上就要去下载YOLOv5的源码(这里面有一个巨大的坑困扰了我几天后面会告诉大家)

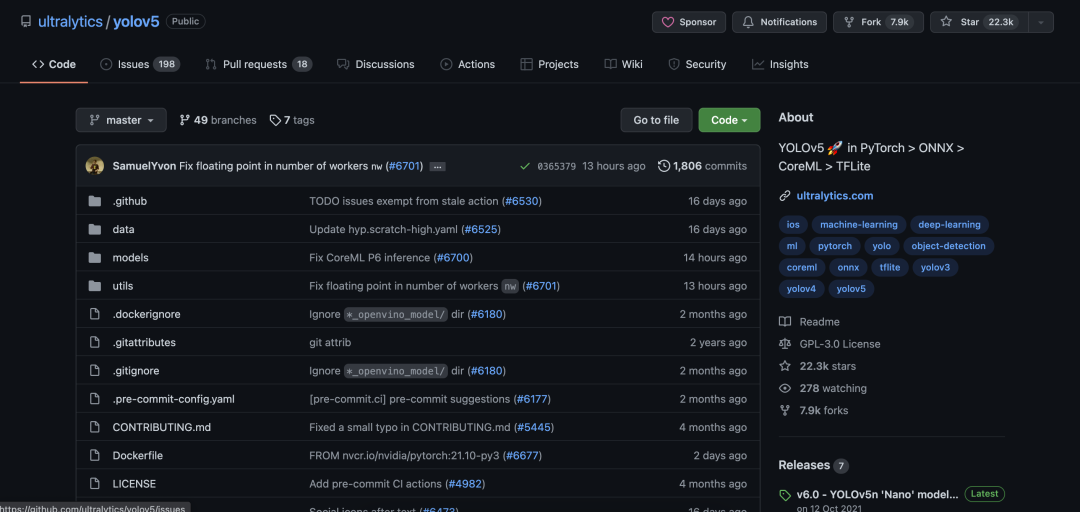

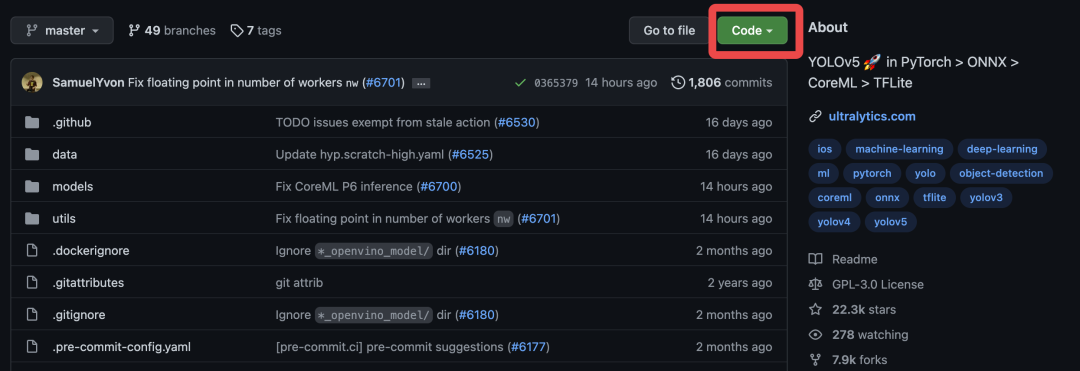

直接去GitHub官网下载点击此处下载YOLOV5源码:https://github.com/ultralytics/yolov5

大家可以看到有很多不同的版本,就是在这里困扰了我很久,我自己下载的是V3.0版本的,但是有一个博主的界面设计使用的源码是V4.0,导致后面加载权重死活加载不出来,界面崩溃;所以大家做界面开发一定要用自己的或者跟博主的一样,好了建议你下载V4.0因为我是4.0版本的如果出现什么问题还可以讨论一下。

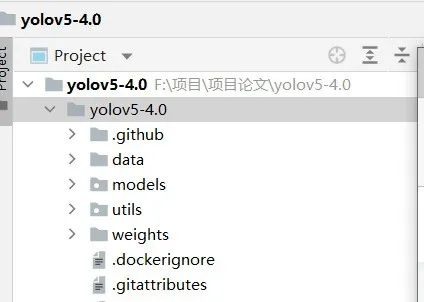

点击右上角的Code,Download就可以了,然后解压到自己的电脑如下:

好了!源码下载好了之后,开始安装YOLOv5需要的库。开始安装上面的一些库,win+r输入cmd进入终端激活你刚刚创建的环境(因为你以后要使用这个环境把所以的第三方库下进去就完事了)

#激活环境(你自己的环境)

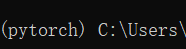

activate pytorch激活之后就会出现:

此时你已经进入了环境就可以下载了。如果你要执行

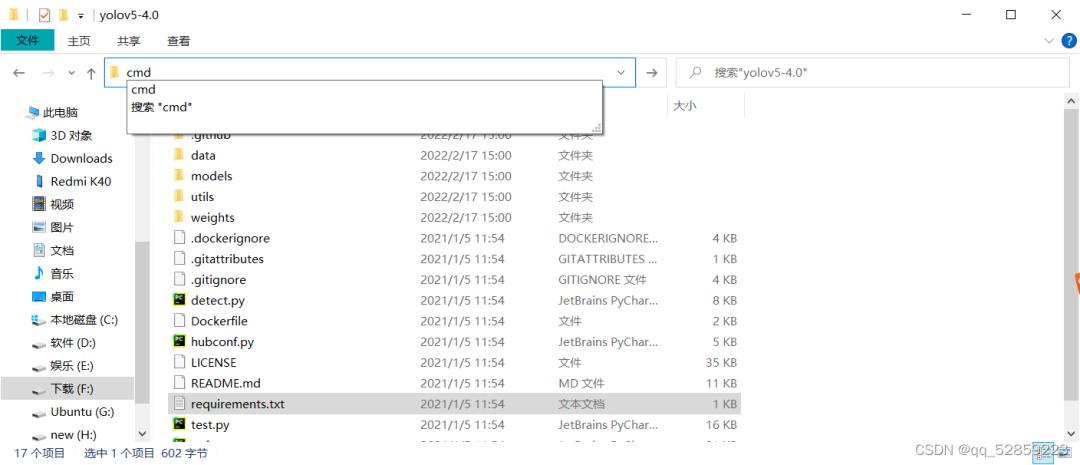

pip install -r requirements.txt你需要进入源码根目录在路径输入cmd如下:

进入终端后直接输入:(torch,和torchvision先不下载)

pip install -r requirements.txt

#一般情况下都不会成功反正我是这样的所以我是一个一个下载的

#这里忘了告诉大家pip下载是访问外网进行下载所以速度非常慢,加入国内镜像源下载如下:

pip install -i https://pypi.tuna.tsinghua.edu.cn/simple matplotlib>=3.2.2(默认下载最新版本)就这样一个一个的下载很笨的方法,gpu-torch官网上可以下载但是对于小白来说很容易失败,或者根本下载不了非常慢,所以我把我的gpu-torch发给大家。我的CUDA版本是11.1(至于cuda是什么我也不解释了自己百度一下就知道了),我会把CUDA、CUDNN、torch,这一套都放在百度网盘:

链接:https://pan.baidu.com/s/15GASd44zuYZXDhrR-bnzbA

提取码:7eit

CUDA的安装大家可以看一下其他教程,cuda一定要安装在C盘默认位置记住这个位置。

上图是CUDNN这个很难下载在官网,大家直接在我的网盘里面下载完之后把几个文件夹里面的东西拷贝到CUDA的对应文件夹即可,系统变量一般在安装时会自动添加。这里你的CUDA就安装成功了。

下一步安装torch(这个东西在官网下载非常的慢所以用我的梯子)

大家把torch-1.8.0+cu111-cp37-cp37m-win_amd64.whl和另一个torchvision-0.9.0+cu111-cp37-cp37m-win_amd64.whl解压到你刚刚创建的环境里面,解压好之后在路径输入CMD进入终端,进入终端后:

pip install torch-1.8.0+cu111-cp37-cp37m-win_amd64.whl

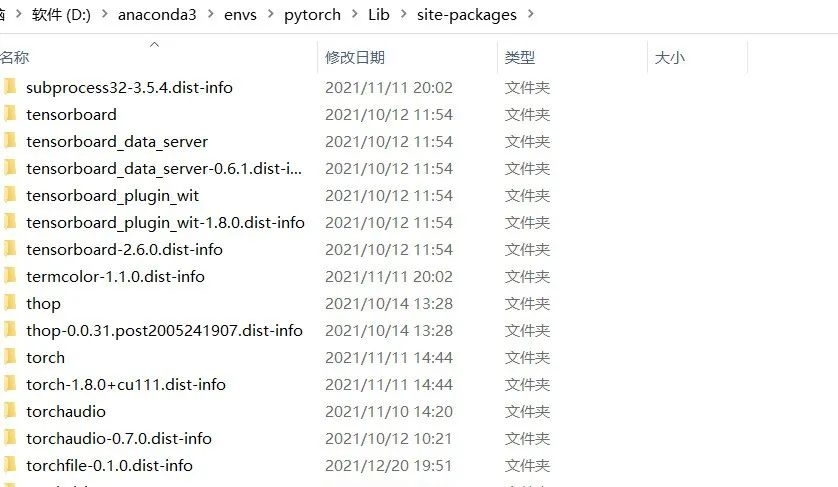

pip install torchvision-0.9.0+cu111-cp37-cp37m-win_amd64.whl等待几分钟就会下载好,在你的:

这里面基本都是你以后下载的所以三方库!可以测试一下你的gpu-torch是否可以调用:

#进入你的环境

activate pytorch

#输入

python

import torch

torch.cuda.is_available()

#如果输出的结果是

Ture(表示你安装成功了)如果没什么大问题我们就可以直接进入pycharm运行yolov5代码试一试!点击file-open打开项目点击我们刚刚下载的YOLOv5源码的文件:

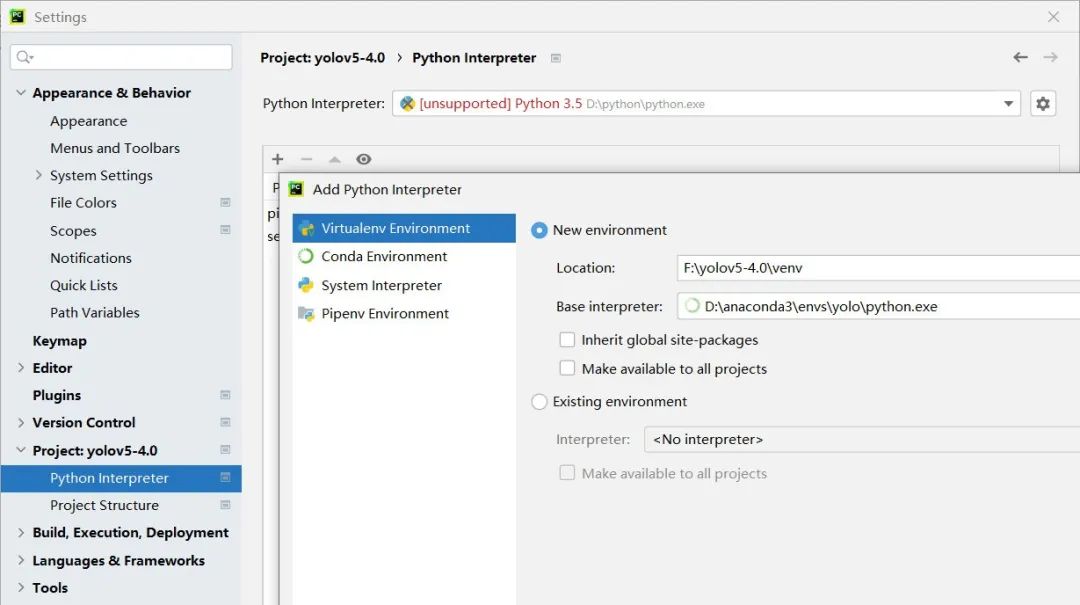

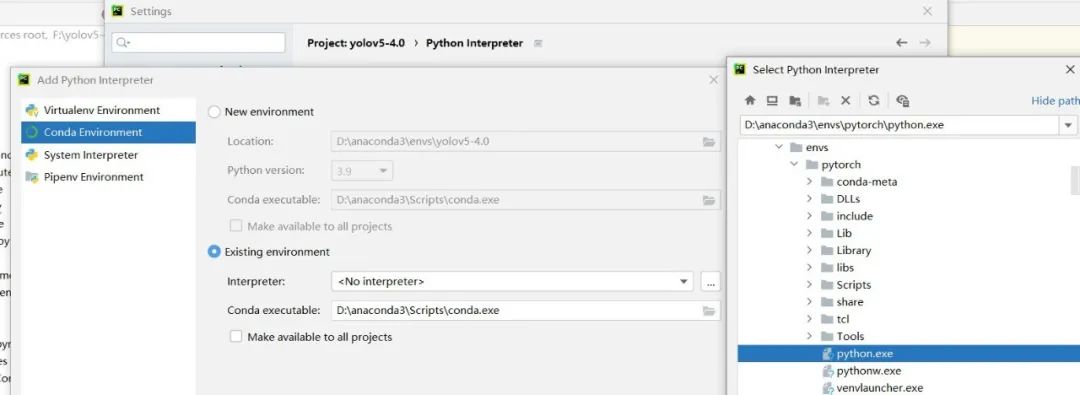

大家像这种都保存在英文路径下。导入我们刚刚的环境点击file-setting-projict-python编译器-点击设置就进入到此界面,然后点击conda-environment

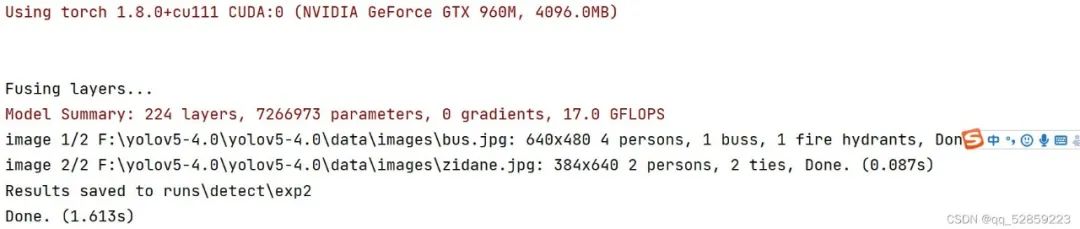

等待几分钟让他配置环境。完成之后就可以进行测试了,运行detect.py,设置device=0

if __name__ == '__main__':

parser = argparse.ArgumentParser()

parser.add_argument('--weights', nargs='+', type=str, default='yolov5s.pt', help='model.pt path(s)')

parser.add_argument('--source', type=str, default='data/images', help='source') # file/folder, 0 for webcam

parser.add_argument('--img-size', type=int, default=640, help='inference size (pixels)')

parser.add_argument('--conf-thres', type=float, default=0.25, help='object confidence threshold')

parser.add_argument('--iou-thres', type=float, default=0.45, help='IOU threshold for NMS')

parser.add_argument('--device', default='0', help='cuda device, i.e. 0 or 0,1,2,3 or cpu')

parser.add_argument('--view-img', action='store_true', help='display results')好的在意料之中:报错了,没有YOLOV5S.pt权重文件,大家可以在网上下载V4.0的。

下载好你的权重文件放在根目录,如果没有问题的话就像下面这样:

恭喜你你已经入门了!(关于如何训练自己的权重文件网上有很多教程直接进入下一个板块)。

感谢大家的阅读和关注,下一期我们一起来进行yolov5的界面开发(Pyqt5)和将整个项目打包成EXE。

© THE END

转载请联系本公众号获得授权

计算机视觉研究院学习群等你加入!

计算机视觉研究院主要涉及深度学习领域,主要致力于人脸检测、人脸识别,多目标检测、目标跟踪、图像分割等研究方向。研究院接下来会不断分享最新的论文算法新框架,我们这次改革不同点就是,我们要着重”研究“。之后我们会针对相应领域分享实践过程,让大家真正体会摆脱理论的真实场景,培养爱动手编程爱动脑思考的习惯!

扫码关注

计算机视觉研究院

公众号ID|ComputerVisionGzq

学习群|扫码在主页获取加入方式

往期推荐

🔗

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?