在看待解决一分类问题时候,在相关概率已知的条件下,贝叶斯决策论考虑如何基于这些概率把(期望损失)风险 降到最低,从而得到最优的类别标记,即 期望风险最小化。

假设由

N

N

N种可能的类别标记为

y

=

{

c

1

,

c

2

.

.

.

c

n

}

y=\{c_1,c_2...c_n\}

y={c1,c2...cn},

λ

i

j

\lambda_{ij}

λij是一个将真实标记为

c

j

c_j

cj误分类为

c

i

c_i

ci所产生的损失,则基于后验概率

P

(

c

i

∣

x

)

P(c_i|x)

P(ci∣x)可得到将样本分类为

c

i

c_i

ci的风险,即在样本上面的条件风险,可表示为:

R

(

c

j

∣

x

)

=

∑

j

=

1

N

λ

i

j

P

(

c

i

∣

x

)

,

其

中

λ

i

j

=

0

,

i

f

i

=

j

;

λ

i

j

=

1

,

o

t

h

e

r

w

i

s

e

;

R(c_j|x)=\sum_{j=1}^N \lambda_{ij}P(c_i|x),其中\lambda_{ij}=0,if\ i=j\ ;\lambda_{ij}=1, otherwise;

R(cj∣x)=j=1∑NλijP(ci∣x),其中λij=0,if i=j ;λij=1,otherwise;

显然

i

=

j

i=j

i=j时分类正确,风险为0,如若分类错误则在风险会随后验概率

P

(

c

i

∣

x

)

P(c_i|x)

P(ci∣x)的变化而变化,即基于后验概率

P

(

c

i

∣

x

)

P(c_i|x)

P(ci∣x)预测错误类别的概率越大风险越大。

以上为样本

x

x

x一条样本产生的风险,

E

E

E表示总体样本集合,则总体风险可表示为:

R

(

h

)

=

E

x

[

R

(

h

(

x

)

∣

x

)

]

=

E

x

[

∑

j

=

1

N

λ

i

j

P

(

c

i

∣

x

)

]

R(h)=E_x[R(h(x)|x)]=E_x[\sum_{j=1}^N \lambda_{ij}P(c_i|x)]

R(h)=Ex[R(h(x)∣x)]=Ex[j=1∑NλijP(ci∣x)]

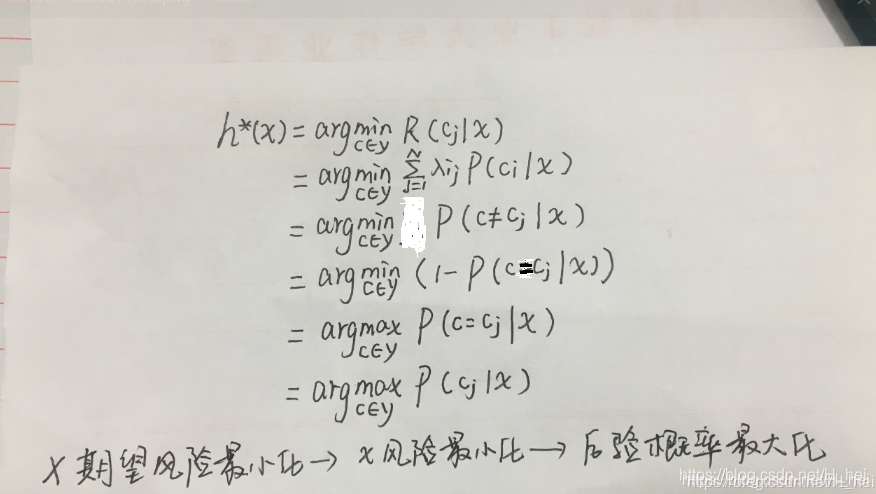

显然我们如果能最小化条件风险,则总体风险自然也将最小化,下面是

x

x

x 样本期望风险最小化过程:

以上我么由 期望风险最小化 进而得出 后验概率最大化准则,这就是朴素贝叶斯法所采用的原理。即我们只需要去求:

h

∗

(

x

)

=

a

r

g

m

a

x

P

(

c

∣

x

)

=

a

r

g

m

a

x

P

(

c

)

P

(

x

∣

c

)

P

(

x

)

,

c

∈

y

h^*(x)=argmaxP(c|x)=argmax\frac{P(c)P(x|c)}{P(x)}, c\in y

h∗(x)=argmaxP(c∣x)=argmaxP(x)P(c)P(x∣c),c∈y

即可求得最优的类别标记。

朴素贝叶斯详细内容可参考:https://blog.csdn.net/H_hei/article/details/84327975

仅为个人的浅显理解,欢迎大家指正交流。

5164

5164

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?