AI Fairness 360:打造更公平的人工智能

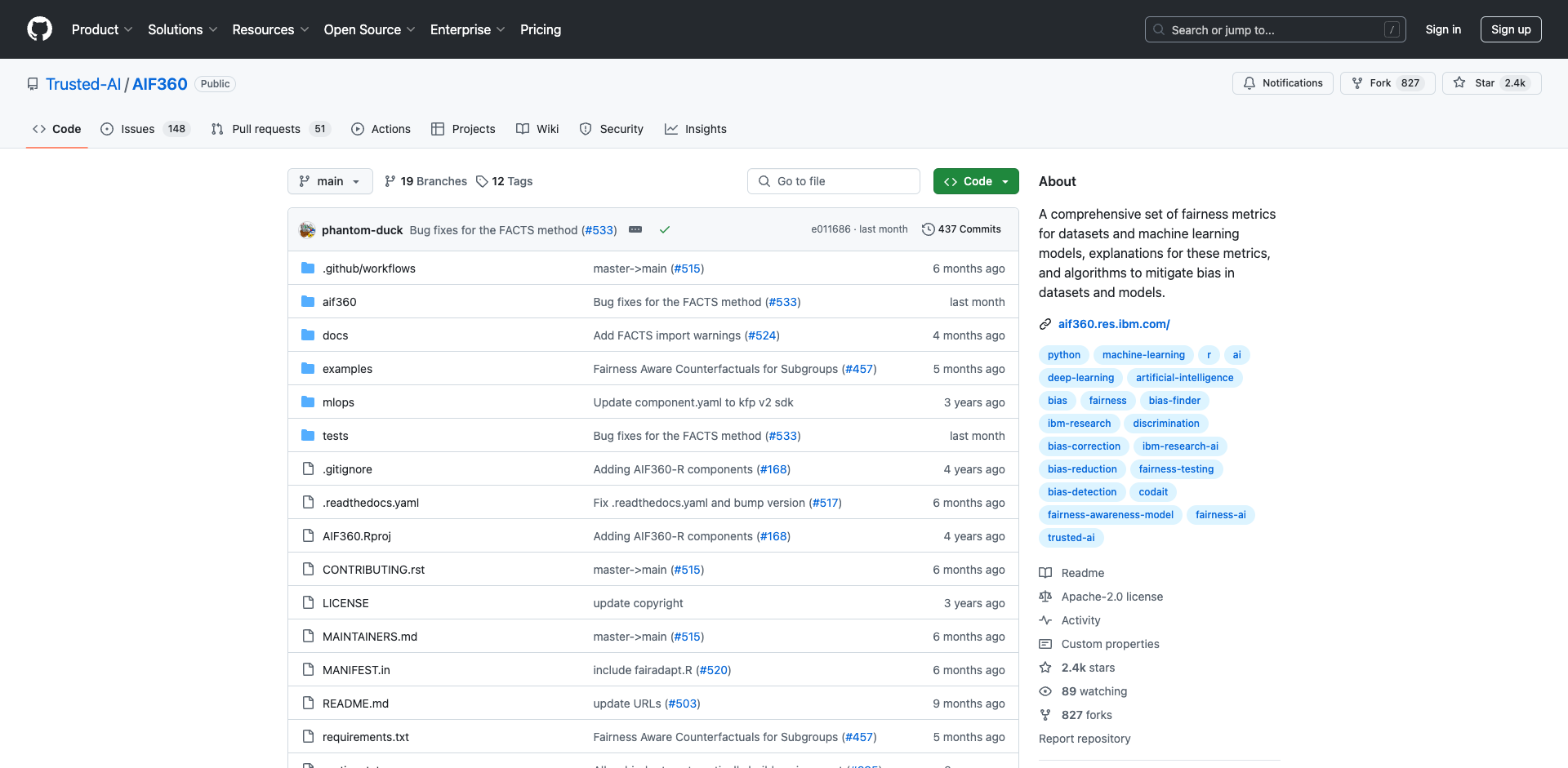

在人工智能快速发展的今天,如何确保AI系统的公平性已成为一个日益重要的问题。IBM研究院开发的AI Fairness 360(简称AIF360)工具包应运而生,为开发人员和数据科学家提供了一套全面的解决方案,用于检测和缓解机器学习模型中的偏见。

AIF360的核心功能

AIF360是一个开源的Python库,提供了三大核心功能:

- 全面的公平性指标集:用于评估数据集和模型中的偏见

- 指标解释工具:帮助理解各种公平性指标的含义

- 偏见缓解算法:用于减少数据集和模型中的偏见

这些功能使AIF360成为一个强大而灵活的工具包,可以应用于金融、人力资源管理、医疗保健和教育等多个领域。

支持的偏见缓解算法

AIF360提供了多种先进的偏见缓解算法,包括:

- 优化预处理(Optimized Preprocessing)

- 差异影响消除器(Disparate Impact Remover)

- 均等机会后处理(Equalized Odds Postprocessing)

- 重新加权(Reweighing)

- 拒绝选项分类(Reject Option Classification)

- 偏见消除正则化(Prejudice Remover Regularizer)

- 学习公平表示(Learning Fair Representations)

- 对抗性去偏(Adversarial Debiasing)

- 公平分类元算法(Meta-Algorithm for Fair Classification)

这些算法涵盖了预处理、训练中处理和后处理三个阶段,为用户提供了多种选择。

公平性指标

AIF360还提供了丰富的公平性指标,包括:

- 基于选择率和错误率的群体公平性指标

- 样本扭曲指标

- 广义熵指数

- 差异公平性和偏见放大

- 基于多维子集扫描的偏见扫描

这些指标可以全面评估模型在不同群体间的公平性表现。

易用性和扩展性

AIF360的设计注重易用性和扩展性:

- 提供了交互式教程和示例,方便用户快速上手

- 支持Python和R两种编程语言

- 采用模块化设计,便于用户添加新的指标和算法

- 与scikit-learn兼容,可以无缝集成到现有的机器学习工作流中

应用场景

AIF360可以应用于多个领域,例如:

- 金融服务:确保信贷评分模型不会对特定群体产生歧视

- 人力资源:帮助招聘系统避免性别或种族偏见

- 医疗保健:确保诊断模型对不同人群都能公平准确

- 教育:帮助入学筛选系统避免社会经济背景的偏见

社区支持

作为一个开源项目,AIF360欢迎来自学术界和工业界的贡献。用户可以:

- 在GitHub上提交问题和建议

- 贡献新的指标、解释器和去偏算法

- 参与Slack社区讨论

结语

AI Fairness 360为构建更加公平的AI系统提供了强大的工具支持。随着人工智能在社会中的应用日益广泛,确保AI的公平性变得越来越重要。AIF360不仅为开发人员和研究人员提供了实用的工具,也推动了公平AI这一重要领域的发展。通过使用AIF360,我们可以更好地理解和缓解AI系统中的偏见,为创造一个更加公平和包容的数字世界贡献力量。

文章链接:www.dongaigc.com/a/ai-fairness-360-fairness-evaluation-bias-mitigation

https://www.dongaigc.com/a/ai-fairness-360-fairness-evaluation-bias-mitigation

www.dongaigc.com/p/Trusted-AI/AIF360

https://www.dongaigc.com/p/Trusted-AI/AIF360

451

451

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?