一篇文章详细了解XR设备之传感器

XR(扩展现实)头戴设备的核心竞争力在于其对物理世界与虚拟空间的精准感知与交互能力,而这一能力的实现高度依赖传感器技术的突破。本文将从主流设备传感器方案、关键技术参数、核心玩家及未来趋势四个维度,系统性拆解XR头戴设备的传感器生态。

一、主流XR设备传感器方案对比

1. Apple Vision Pro:传感器融合的标杆

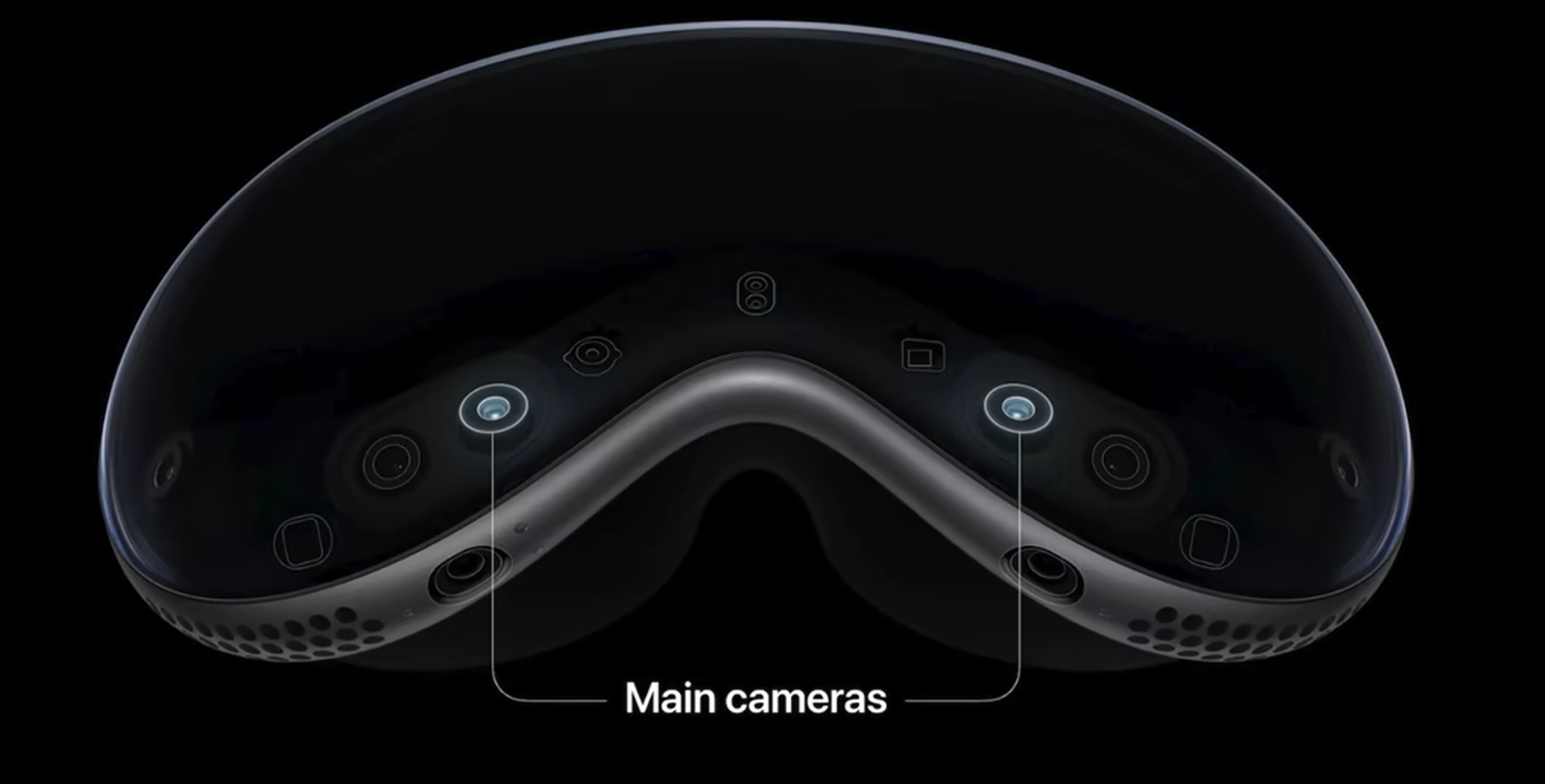

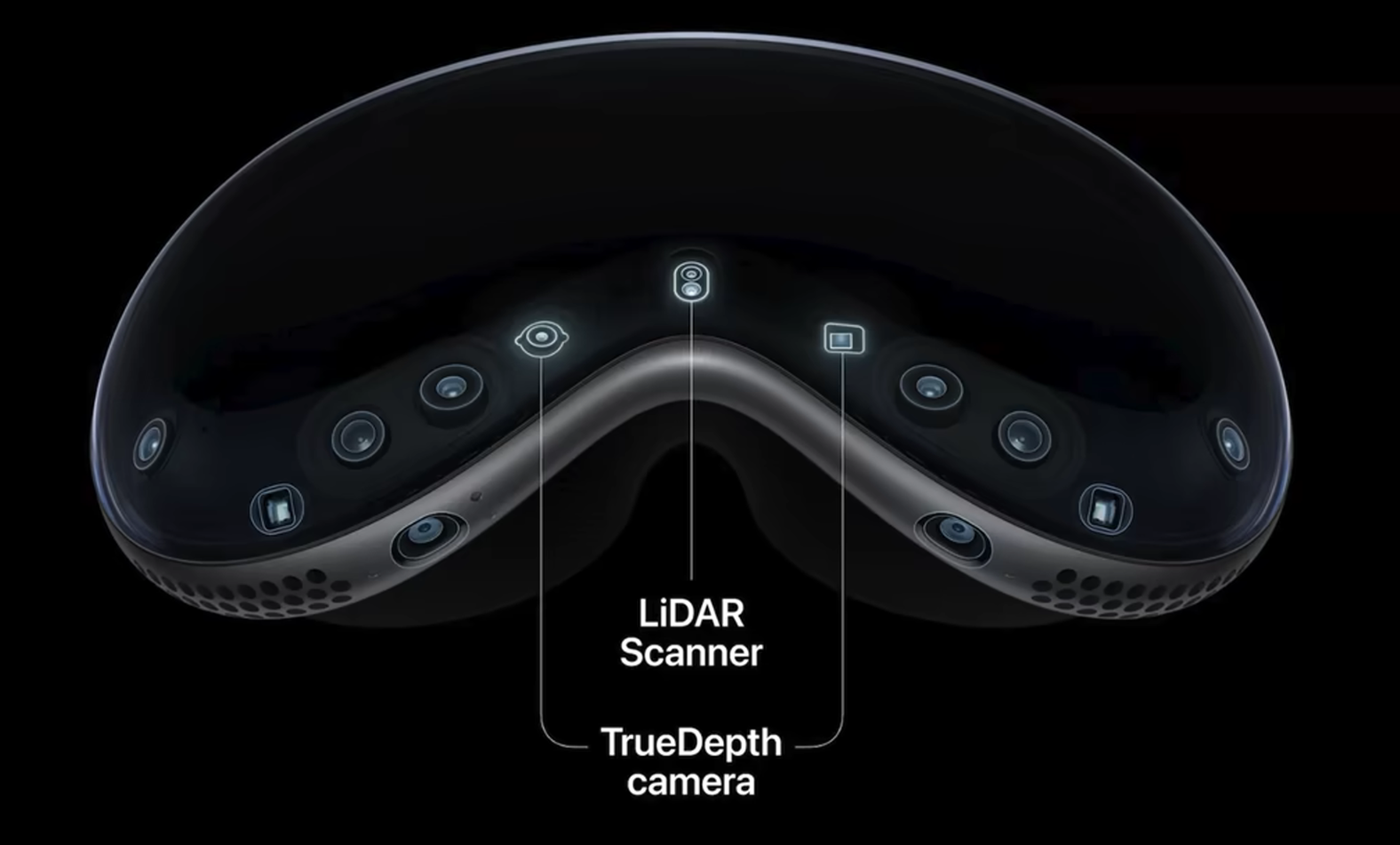

① VST(Video See-Through)系统:双2300万像素RGB主摄像头(10亿像素/秒)配合LiDAR(dToF)实现毫米级环境建模,探测距离10米级。

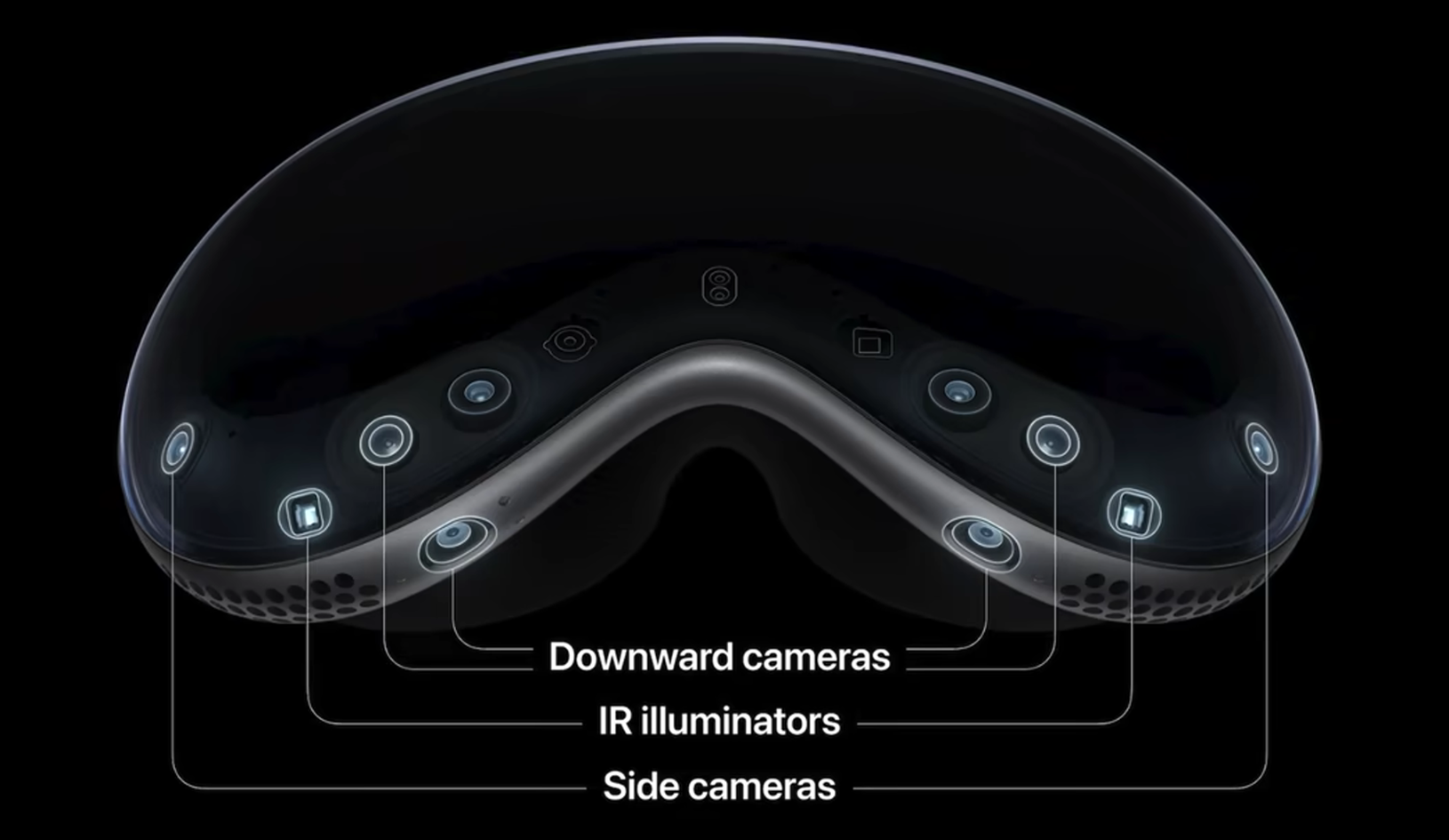

② 眼动追踪:4颗红外摄像头(400×400@120Hz),虹膜识别精度达0.1°。

③ IMU:集成4轴IMU(陀螺仪+加速度计),采样率1kHz。

④ 手势交互:12颗红外摄像头+5颗深度传感器,支持毫米级手部骨骼追踪。

AVP 传感器布局(VST主摄)

AVP 传感器布局(定位 SLAM+手势)

AVP 传感器布局(深度+激光雷达)

AVP 传感器布局(眼动)

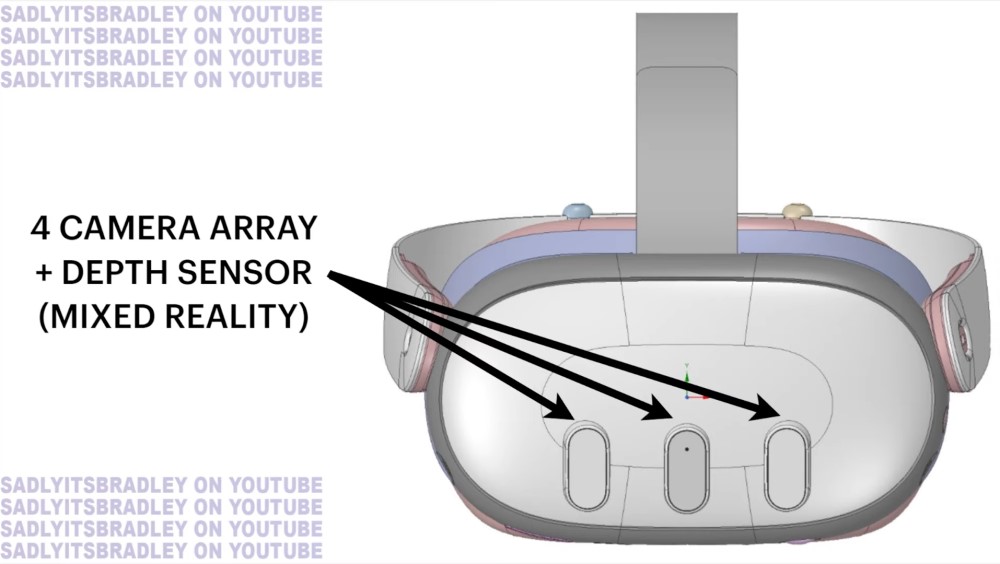

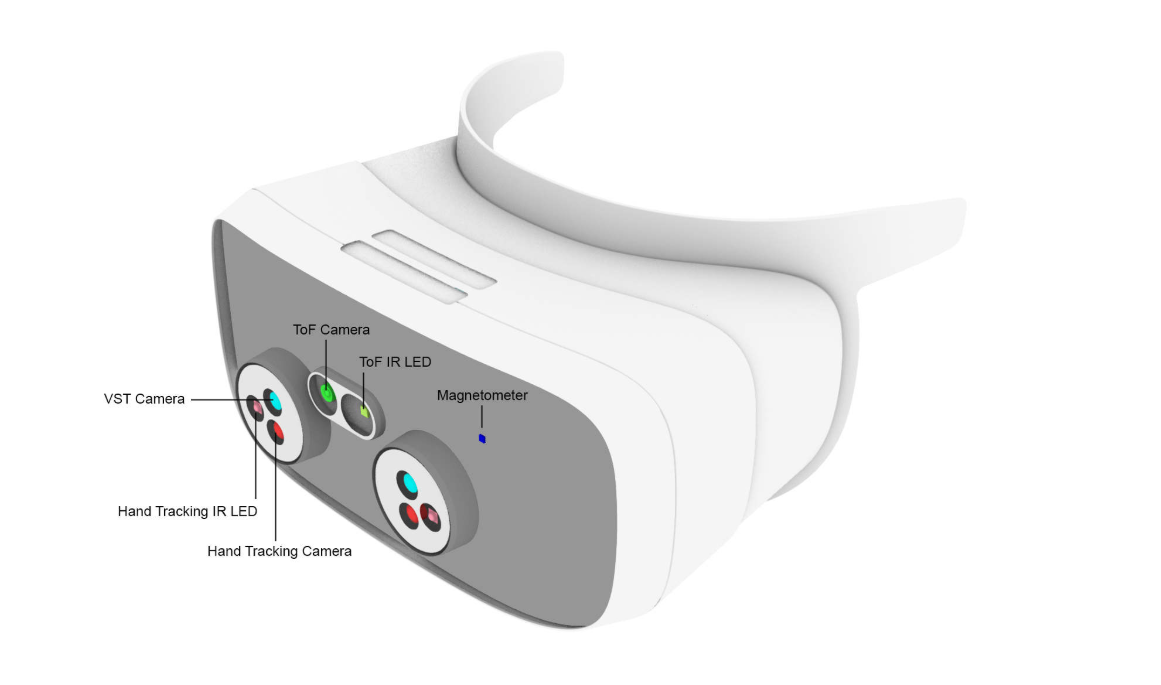

2. Meta Quest Pro/Quest 3:消费级VR的传感器配置

① VST:Quest Pro搭载1600万像素RGB摄像头,Quest 3升级至4MP分辨率。

② 环境感知:双深度传感器(结构光+ToF),支持3D场景重建。

③ IMU:高通XR2 Gen 2芯片集成6轴IMU,采样率1kHz。

④ 眼动追踪:Quest Pro首次引入眼动模块(120Hz采样率),精度0.5°。

Quest 3 传感器布局

3. Pico 4/4 Pro:国产方案的突破

① VST:双目1600万像素RGB摄像头,FOV 105°。

② 手势追踪:4颗红外摄像头+2颗深度传感器,支持28自由度手部建模。

③ IMU:自研6轴IMU(陀螺仪+加速度计+磁力计),零偏稳定性±0.5°/h。

Pico4传感器布局

4. Varjo XR-3:工业级传感器的天花板

① VST:双1200万像素RGB摄像头(8K分辨率),120°×105°超宽视场角。

② LiDAR:300 KPix点云密度,探测距离50米,精度±1cm。

③ 眼动追踪:0.06° RMS精度,支持200Hz高速采样。

VarjoXR-3传感器布局

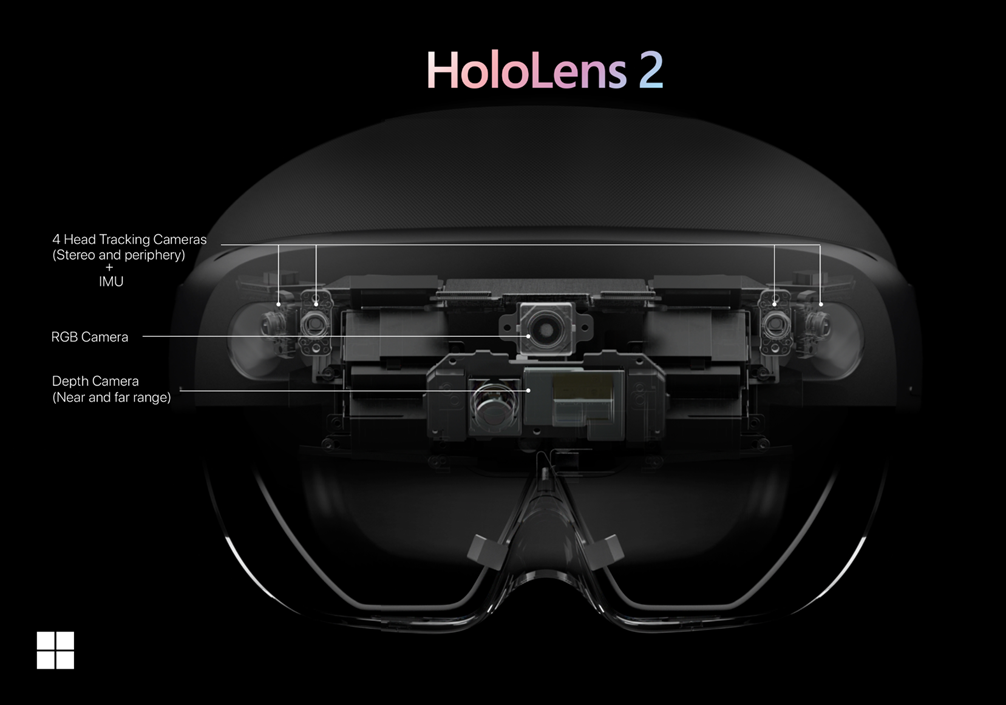

5. AR设备代表:微软HoloLens 2

① 深度感知:Azure Kinect深度传感器(ToF),探测范围0.5-5米。

② 手势交互:4颗红外摄像头,支持5指关节级追踪(延迟<20ms)。

③ 眼动传感器:红外传感器:HoloLens 2 在鼻梁位置配置了 2颗红外摄像头,镜框周围分布 12颗红外LED灯,用于照亮眼球并捕捉高对比度图像,通过“角膜反射暗瞳技术”实现追踪。

④ 环境光传感器:自适应亮度调节(0.1-10000 Lux)。

Hololens2 传感器布局

二、核心传感器技术参数与玩家分析

1. VST(视频透视)主摄像头

① 技术参数:分辨率(4K→8K)、帧率(60→120Hz)、HDR动态范围(>120dB)。

② 核心玩家:索尼(IMX系列)、三星(ISOCELL)、豪威科技(OV48C)、舜宇智能光学(彩色透视模组)。

2. 红外传感器

① 技术参数:波长(850nm/940nm)、功率(Class 1人眼安全)、探测距离(0.1-10米)。

② 核心玩家:ams OSRAM(多光谱方案)、STMicroelectronics(集成式模组)、舜宇智能光学(SLAM空间定位模组)。

3. 深度传感器

① 技术参数:

- ToF:探测距离(0.1-200米),精度(±1cm)。

- 结构光:点云密度(30万点/秒),抗干扰性(阳光下可用)。

② 核心玩家:舜宇智能光学(手势识别模组)、索尼(dToF)、Lumentum(VCSEL光源)、禾赛科技(固态LiDAR)。

4. IMU(惯性测量单元)

① 技术参数:

- 陀螺仪零偏稳定性:±0.1°/h(消费级)→±0.01°/h(工业级)。

- 加速度计量程:±16g(VR)→±200g(工业防冲击)。

② 核心玩家:Bosch(BMI270)、TDK(ICM-42688-P)、STMicroelectronics(LSM6DSO)。

5. 激光雷达(LiDAR)

① 技术参数:

- 探测距离:消费级(10-50米),车规级(200米)。

- 角分辨率:0.1°(机械式)→0.01°(固态)。

② 核心玩家:Velodyne(机械式)、禾赛科技(半固态)、Ouster(数字LiDAR)。

6. 眼动追踪

① 技术参数:

- 精度:0.5°(消费级)→0.06°(工业级)。

- 采样率:120Hz→2000Hz(科研级)。

② 核心玩家:Tobii(Pro Spectrum)、七鑫易维(aGlass DKII)、EyeTech(DS系列)。

三、未来技术趋势

1. 微型化与集成化

① 传感器尺寸缩减:MEMS工艺IMU体积缩小50%,LiDAR模组厚度<5mm。

② 多传感器融合:IMU+摄像头+LiDAR的片上系统(SoC)。

2. 眼动追踪的智能化升级

① 注视点渲染:动态调节渲染分辨率(中心区域8K+边缘2K)。

② 生物识别:虹膜认证(Apple Vision Pro)与疲劳监测融合。

3. 环境感知的增强

① 语义SLAM:LiDAR+AI实现实时物体分类(如识别椅子、门窗)。

② 毫米波雷达:穿透雾/雨环境探测(24GHz/60GHz频段)。

4. 触觉反馈的传感器闭环

压电致动器:微米级振动(频率5-500Hz),配合力反馈手套实现纹理触感。

四、领域核心玩家图谱

| 传感器类型 | 头部厂商 | 技术优势与布局 |

| VST摄像头 | 索尼、三星、舜宇智能光学 | 舜宇量产Pancake短焦模组(体积缩小50%)、自研800万像素车载模组,支持超低反镀膜和高动态范围成像 |

| 深度传感器 | 索尼、Lumentum、舜宇智能光学 | 自研VGA级ToF传感器(毫米级精度),结合RGB-D视觉融合技术,抗强光干扰能力突出,应用于扫地机器人、XR设备避障等场景 |

| 眼动追踪 | Tobii、七鑫易维、舜宇智能光学 | 双向扫描眼球追踪专利(双向红外光分束技术),减少器件数量,支持120Hz采样率,精度达0.1°,集成于AR/VR头显设备 |

| LiDAR | Velodyne、禾赛、舜宇智能光学 | 全固态激光雷达模组(超大视场角+小型化设计)、长距激光雷达模组(覆盖L4级自动驾驶),核心技术包括发射/接收端模组量产优化 |

| 光学防抖(OIS) | Bosch、TDK、舜宇智能光学 | 自研三轴闭环OIS马达技术,应用于车载镜头、激光雷达及XR设备,混动防抖模组(OIS+Lens OIS)提升XR成像稳定性 |

结语

XR头戴设备的传感器技术正在经历从“单一功能”到“多模态融合”、从“被动感知”到“主动理解”的跨越。随着Apple Vision Pro引领的VST革命,以及Varjo在工业级传感器上的持续突破,未来的XR设备将更深度地融合物理与数字世界,成为人类感知能力的延伸。

274

274

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?