在企业界幻灯片无处不在,它经常被用作交流想法和成就的方式。我个人在过去的四年里一直在大型跨国公司工作,制作幻灯片是大多数人每周都会做的事情。

如果幻灯片能够有效利用时间,那就不是什么大问题了。有很多人会贬低这一点,但在我看来,幻灯片在大多数公司中消耗了太多时间。员工本可以利用这段时间来实际执行项目和构建东西。

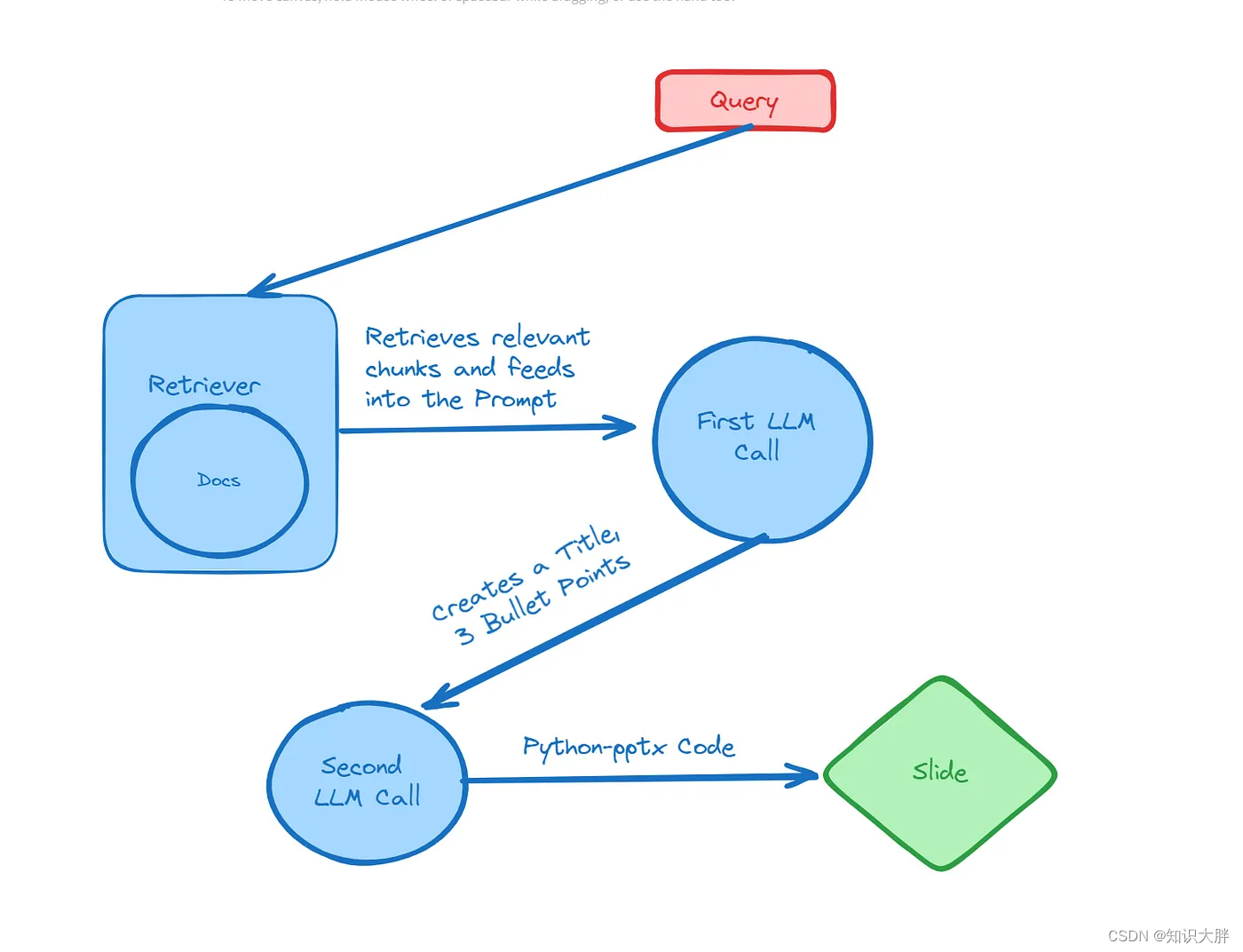

RAG管道

Python 有一个名为 Python-pptx 的库,它允许用户以编程方式创建 PowerPoint 演示文稿。第一步是提示大型语言模型使用该库并生成可执行代码。

在这个管道中,我们将获取一个信息库,在本例中是一本关于 CFA 考试的书。本练习的最终目标是加载页面、提取文本并使用 LLM 生成为页面创建幻灯片的代码。

from llama_index.core import SimpleDirectoryReader

#you can use any PDF/text document for this excercise

reader = SimpleDi

本文介绍了如何使用 Llama-3 和 Python-pptx 库自动化创建 PowerPoint 幻灯片。首先,通过 RAG 管道和 LLM 生成可执行代码,然后对信息库进行预处理,再通过 Groq 和 llama-3 模型进行检索。最后,将 LLM 输出转换为 python-pptx 代码,以结构化方式生成幻灯片。

本文介绍了如何使用 Llama-3 和 Python-pptx 库自动化创建 PowerPoint 幻灯片。首先,通过 RAG 管道和 LLM 生成可执行代码,然后对信息库进行预处理,再通过 Groq 和 llama-3 模型进行检索。最后,将 LLM 输出转换为 python-pptx 代码,以结构化方式生成幻灯片。

订阅专栏 解锁全文

订阅专栏 解锁全文

739

739

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?