1 自动下载并转化MNIST数据集格式到TF中

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

#载入MNIST数据集,如果不存在,将自动在默认网址下载,并被TF简单处理

mnist = input_data.read_data_sets("MNIST_data",one_hot=True)

#导入数据集后,60000个数据,自动分为了55000 train_data 10000 test_data.

# 50000 train_data中有分出5000个作为训练过程的valiadtion

n_train =mnist.train.num_examples

n_test =mnist.test.num_examples

n_validtion=mnist.validation.num_examples

image_data =mnist.train.images[0]

label_data =mnist.train.labels[0]

print ("n_train,n_validtion,n_test",n_train,n_validtion,n_test)

#输出(55000,5000,10000)

print("image_data",image_data)

#输出28*28的矩阵,值为[0,1]之间

print("image_label",label_data)

#输出[0.,0.,0.,0.,0.,0.,0.,1.,0.,0.]

#数据集从数据集中提取出一小部分随机训练

batch_size=100

xs,ys=mnist.train.next_batch(batch_size)

print("X shape:",xs.shape) #输出 [100,784]

print("Y shape:",ys.shape) #输出 [100,10]

2.训练结果与完整代码

# -*- coding: utf-8 -*-

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

#载入MNIST数据集,如果不存在,将自动在默认网址下载

mnist = input_data.read_data_sets("MNIST_data",one_hot=True)

#导入数据集后,60000个数据,自动分为了55000 train_data 10000 test_data.

# 50000 train_data中有分出5000个作为训练过程的valiadtion

n_train =mnist.train.num_examples

n_test =mnist.test.num_examples

n_validtion=mnist.validation.num_examples

image_data =mnist.train.images[0]

label_data =mnist.train.labels[0]

#print ("n_train,n_validtion,n_test",n_train,n_validtion,n_test)

##输出(55000,5000,10000)

#print("image_data",image_data)

##输出28*28的矩阵,值为[0,1]之间

#print("image_label",label_data)

##输出[0.,0.,0.,0.,0.,0.,0.,1.,0.,0.]

#数据集从数据集中提取出一小部分随机训练

batch_size=100

xs,ys=mnist.train.next_batch(batch_size)

print("X shape:",xs.shape) #输出 [100,784]

print("Y shape:",ys.shape) #输出 [100,10]

#定义简单的神经网络,784个输入节点,10个输出神经元,即单层神经网络

INPUT_NODE = 784

OUTPUT_NODE= 10

x=tf.placeholder(tf.float32,[None,INPUT_NODE])

y=tf.placeholder(tf.float32,[None,OUTPUT_NODE])

W1=tf.Variable(tf.zeros([INPUT_NODE,OUTPUT_NODE]))

b1=tf.Variable(tf.zeros([OUTPUT_NODE]))

prediction=tf.nn.softmax(tf.matmul(x,W1)+b1)

#二次代价函数

loss=tf.reduce_mean(tf.square(y-prediction))

#使用梯度下降法优化

train_step=tf.train.GradientDescentOptimizer(0.2).minimize(loss)

#将预测结果与便签结果的对比值存于布尔列表里

#tf.arg_max按行输入最大值的索引

correct_prediction=tf.equal(tf.arg_max(prediction,1),tf.arg_max(y,1))

#求神经网络的准确率

accuracy=tf.reduce_mean(tf.cast(correct_prediction,tf.float32))

#训练神经网络

with tf.Session() as sess:

#初始化变量

sess.run(tf.global_variables_initializer())

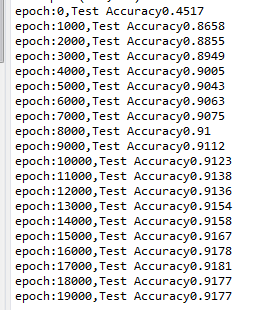

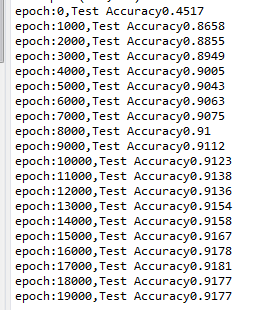

for epoch in range(10000):

xs,ys=mnist.train.next_batch(batch_size)

sess.run(train_step,feed_dict={x:xs,y:ys})

if epoch % 1000==0:

acc=sess.run(accuracy,feed_dict={x:mnist.test.images,y:mnist.test.labels})

print("epoch:"+str(epoch)+",Test Accuracy"+str(acc))

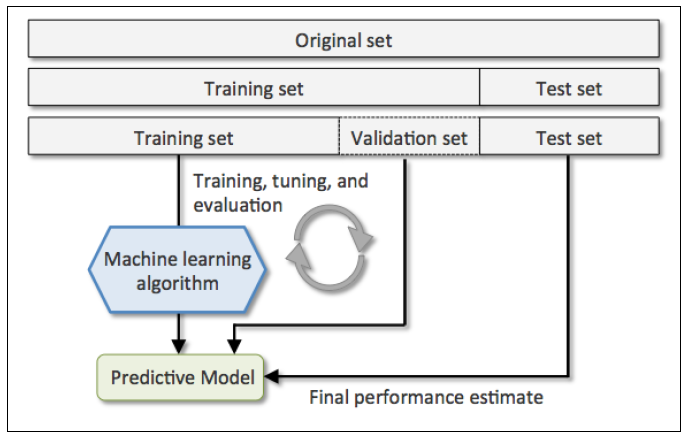

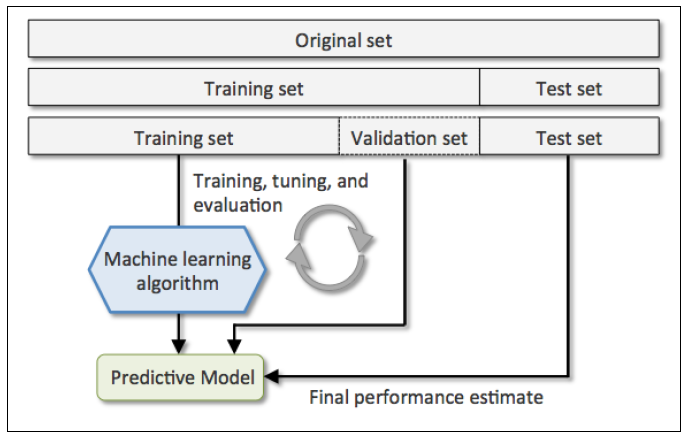

训练数据,验证数据和测试数据关系【参考链接1】

- 训练数据(Training Data):用于模型构建

- 验证数据(Validation Data):可选,用于辅助模型构建,可以重复使用。

- 测试数据(Test Data):用于检测模型构建,此数据只在模型检验时使用,用于评估模型的准确率。绝对不允许用于模型构建过程,否则会导致过渡拟合。

tensorflow tf.argmax() 用法简介【参考链接2】

- tf.argmax(input, axis=None, name=None, dimension=None)

- 对矩阵按行或列计算最大值

- 四个参数:

- 1).input:输入值

- 2).axis:可选值0表示按列,1表示按行求最大值。axis两个参数的区别是:0是每个数组对应位置之间的比较,而1则是数组内部元素之间的比较。

- 3).name

- 4).默认使用axis即可.

扩展链接

-

-

1607

1607

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?