传奇开心果短博文系列

- 系列短博文目录

- Python的OpenCV库技术点案例示例短博文系列

- 短博文目录

- 一、前言

- 二、OpenCV图像拼接融合介绍

- 三、全景图像拼接示例代码和扩展

- 四、图像融合示例代码和扩展

- 五、归纳总结

系列短博文目录

Python的OpenCV库技术点案例示例短博文系列

短博文目录

一、前言

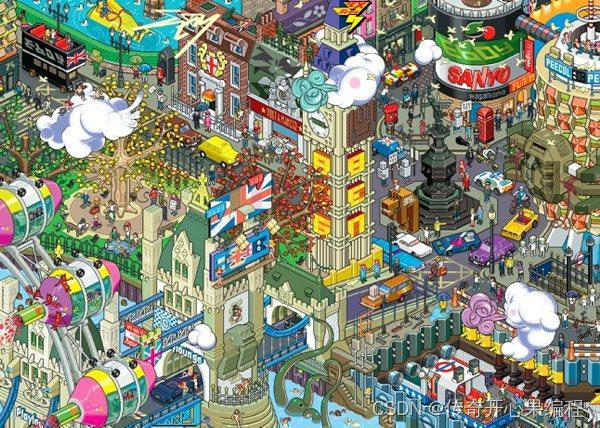

OpenCV图像拼接融合:包括全景图像拼接、图像融合等功能。

OpenCV图像拼接融合:包括全景图像拼接、图像融合等功能。

二、OpenCV图像拼接融合介绍

OpenCV是一个广泛使用的计算机视觉库,其中包含了许多图像处理和计算机视觉算法。在OpenCV中,可以使用其功能来实现图像拼接融合,包括全景图像拼接和图像融合。

OpenCV是一个广泛使用的计算机视觉库,其中包含了许多图像处理和计算机视觉算法。在OpenCV中,可以使用其功能来实现图像拼接融合,包括全景图像拼接和图像融合。

-

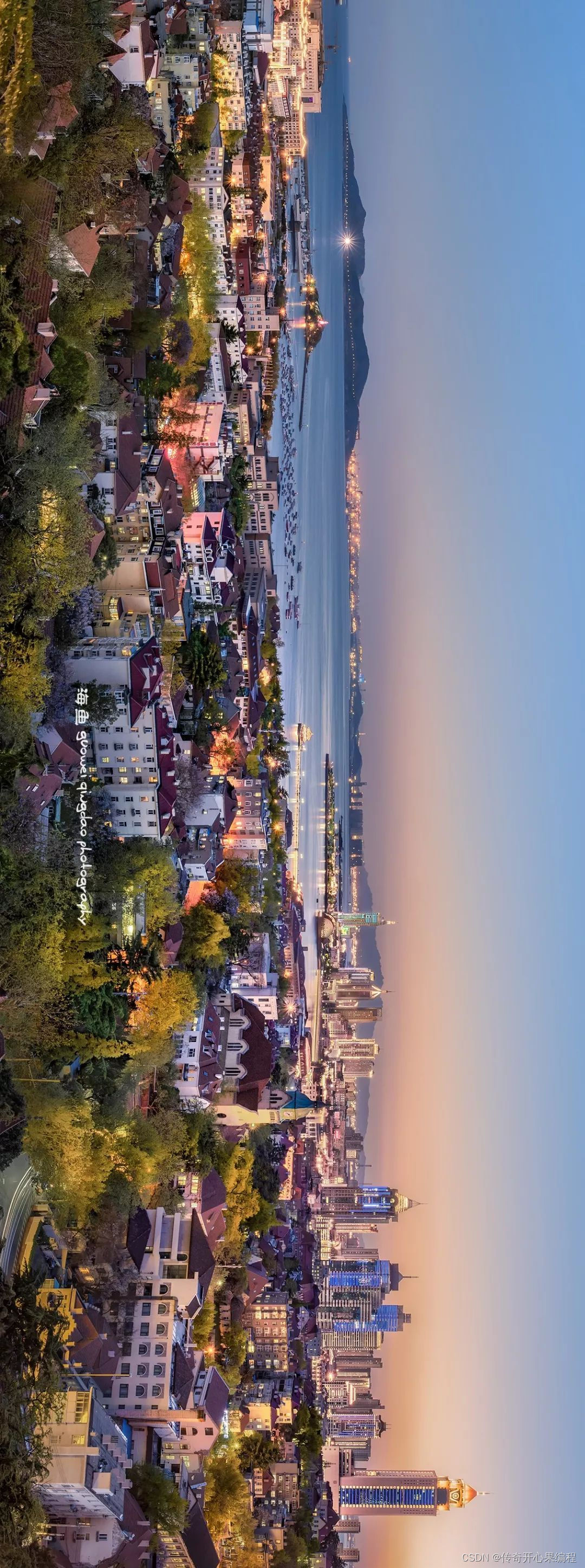

全景图像拼接:

全景图像拼接是将多张局部重叠的图像拼接成一张完整的全景图像。拼接过程包括以下步骤:- 特征提取:使用特征提取算法(如SIFT、SURF等)检测图像中的特征点。

- 特征匹配:对提取到的特征点进行匹配,找出在多个图像中对应的特征点。

- 图像配准:根据匹配的特征点,估计相邻图像之间的变换关系(如平移、旋转、缩放等),使它们对齐。

- 图像拼接:将配准后的图像进行拼接,生成全景图像。

-

图像融合:

图像融合是将多张图像的信息合并到一张图像中,以产生更丰富的视觉效果。常见的图像融合方法包括:- 加权平均:将多张图像按照一定权重进行加权平均,得到融合后的图像。

- 金字塔融合:使用图像金字塔的层级结构,将图像分解为不同分辨率的子图像,然后通过融合算法将它们进行合成。

- 混合模式:根据不同的混合模式(如叠加、正片叠底、滤色等),将多张图像进行混合。

在OpenCV中,可以使用函数和类来实现图像拼接和融合,例如:

cv2.matchFeatures():用于特征匹配。cv2.findHomography():用于计算图像配准的单应性矩阵。cv2.warpPerspective():用于透视变换,将图像根据单应性矩阵进行配准。cv2.addWeighted():用于图像加权平均。cv2.pyrDown()和cv2.pyrUp():用于图像金字塔的降采样和上采样。

通过组合和调用这些函数和类,可以实现具体的图像拼接和融合功能。

需要注意的是,图像拼接和融合是复杂的任务,对于不同的场景和图像质量可能需要不同的算法和参数设置。因此,在实际应用中,需要根据具体需求和情况进行算法选择和参数调优。

三、全景图像拼接示例代码和扩展

以下是一个使用OpenCV实现全景图像拼接的示例代码:

以下是一个使用OpenCV实现全景图像拼接的示例代码:

import cv2

import numpy as np

def stitch_images(images):

# 初始化特征提取器和匹配器

sift = cv2.SIFT_create()

matcher = cv2.BFMatcher()

# 检测关键点和计算特征描述符

keypoints = []

descriptors = []

for image in images:

gray = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)

kp, desc = sift.detectAndCompute(gray, None)

keypoints.append(kp)

descriptors.append(desc)

# 特征匹配

matches = []

for i in range(len(descriptors) - 1):

matches.append(matcher.match(descriptors[i], descriptors[i+1]))

# 计算图像配准的单应性矩阵

homographies = []

for match in matches:

src_pts = np.float32([keypoints[i][m.queryIdx].pt for i, m in enumerate(match)]).reshape(-1, 1, 2)

dst_pts = np.float32([keypoints[i+1][m.trainIdx].pt for i, m in enumerate(match)]).reshape(-1, 1, 2)

H, _ = cv2.findHomography(src_pts, dst_pts, cv2.RANSAC, 5.0)

homographies.append(H)

# 图像拼接

result = images[0]

for i in range(len(images) - 1):

result = cv2.warpPerspective(result, homographies[i], (result.shape[1] + images[i+1].shape[1], result.shape[0]))

result[0:images[i+1].shape[0], 0:images[i+1].shape[1]] = images[i+1]

return result

# 读取图像

image1 = cv2.imread("image1.jpg")

image2 = cv2.imread("image2.jpg")

image3 = cv2.imread("image3.jpg")

# 图像拼接

result_image = stitch_images([image1, image2, image3])

# 显示结果

cv2.imshow("Panorama", result_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

在上述示例代码中,首先通过cv2.SIFT_create()创建了一个SIFT特征提取器,并使用detectAndCompute()方法检测关键点和计算特征描述符。

然后,通过cv2.BFMatcher()创建了一个基于暴力匹配的匹配器。对于每两个相邻的图像,使用匹配器的match()方法进行特征匹配。

接下来,使用cv2.findHomography()计算了相邻图像之间的单应性矩阵,将它们配准到同一个坐标空间。

最后,使用cv2.warpPerspective()进行透视变换,将配准后的图像进行拼接。

您需要将示例代码中的image1.jpg、image2.jpg和image3.jpg替换为您自己的图像路径。运行代码后,会显示生成的全景图像。

请注意,这只是一个简单的示例代码,实际的图像拼接任务可能需要更多的处理和优化。对于复杂的场景,您可能需要调整算法参数或使用其他图像拼接算法来获得更好的结果。

以下是对上述示例代码的扩展,包括图像预处理和结果优化:

以下是对上述示例代码的扩展,包括图像预处理和结果优化:

import cv2

import numpy as np

def stitch_images(images):

# 图像预处理

gray_images = []

for image in images:

gray = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)

gray_images.append(gray)

# 初始化特征提取器和匹配器

sift = cv2.SIFT_create()

matcher = cv2.BFMatcher()

# 检测关键点和计算特征描述符

keypoints = []

descriptors = []

for gray_image in gray_images:

kp, desc = sift.detectAndCompute(gray_image, None)

keypoints.append(kp)

descriptors.append(desc)

# 特征匹配

matches = []

for i in range(len(descriptors) - 1):

matches.append(matcher.match(descriptors[i], descriptors[i+1]))

# 计算图像配准的单应性矩阵

homographies = []

for match in matches:

src_pts = np.float32([keypoints[i][m.queryIdx].pt for i, m in enumerate(match)]).reshape(-1, 1, 2)

dst_pts = np.float32([keypoints[i+1][m.trainIdx].pt for i, m in enumerate(match)]).reshape(-1, 1, 2)

H, _ = cv2.findHomography(src_pts, dst_pts, cv2.RANSAC, 5.0)

homographies.append(H)

# 图像拼接

result = gray_images[0]

for i in range(len(gray_images) - 1):

result = cv2.warpPerspective(result, homographies[i], (result.shape[1] + gray_images[i+1].shape[1], result.shape[0]))

result[0:gray_images[i+1].shape[0], 0:gray_images[i+1].shape[1]] = gray_images[i+1]

# 结果优化

result = cv2.medianBlur(result, 5)

return result

# 读取图像

image1 = cv2.imread("image1.jpg")

image2 = cv2.imread("image2.jpg")

image3 = cv2.imread("image3.jpg")

# 图像拼接

result_image = stitch_images([image1, image2, image3])

# 显示结果

cv2.imshow("Panorama", result_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

在扩展的代码中,我们进行了以下改进:

-

图像预处理:将输入图像转换为灰度图像,以减少特征提取和匹配的计算量。

-

结果优化:使用

cv2.medianBlur()对拼接结果进行中值滤波,以去除可能的噪声和不连续性。

这些改进可以提高拼接结果的质量和鲁棒性。您还可以根据具体需求添加其他的预处理步骤和优化方法,以获得更好的全景图像拼接效果。

四、图像融合示例代码和扩展

以下是一个使用OpenCV实现图像融合的示例代码:

以下是一个使用OpenCV实现图像融合的示例代码:

import cv2

def blend_images(image1, image2, alpha):

blended_image = cv2.addWeighted(image1, alpha, image2, 1 - alpha, 0)

return blended_image

# 读取图像

image1 = cv2.imread("image1.jpg")

image2 = cv2.imread("image2.jpg")

# 图像融合

alpha = 0.5 # 调整融合比例,范围为[0, 1]

result_image = blend_images(image1, image2, alpha)

# 显示结果

cv2.imshow("Blended Image", result_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

在上述示例代码中,我们定义了一个blend_images()函数,该函数接受两个输入图像image1和image2,以及一个融合比例alpha。通过使用cv2.addWeighted()函数,将两个图像按照给定的融合比例进行加权平均,得到融合后的图像。

您需要将示例代码中的image1.jpg和image2.jpg替换为您自己的图像路径。运行代码后,会显示生成的融合图像。

请注意,融合比例alpha决定了两个图像在融合中的权重,如果alpha为0,则完全使用image2;如果alpha为1,则完全使用image1;如果alpha为0.5,则两个图像的权重相等。

根据具体需求,您可以调整融合比例和选择其他的图像融合方法,例如使用不同的混合模式或应用其他图像处理技术来实现更复杂的融合效果。

以下是对上述示例代码的扩展,包括多图像融合和融合掩码的应用:

以下是对上述示例代码的扩展,包括多图像融合和融合掩码的应用:

import cv2

import numpy as np

def blend_images(images, alpha_values):

# 确保输入图像数量和融合比例数量一致

assert len(images) == len(alpha_values)

# 获取图像尺寸

height, width, channels = images[0].shape

# 创建融合结果的初始画布

blended_image = np.zeros((height, width, channels), dtype=np.float32)

# 图像融合

for i in range(len(images)):

alpha = alpha_values[i]

blended_image += alpha * images[i]

# 归一化并转换为8位图像

blended_image = np.clip(blended_image, 0, 255).astype(np.uint8)

return blended_image

# 读取图像

image1 = cv2.imread("image1.jpg")

image2 = cv2.imread("image2.jpg")

image3 = cv2.imread("image3.jpg")

# 设置融合比例

alpha_values = [0.4, 0.3, 0.3] # 调整融合比例,总和应为1

# 图像融合

result_image = blend_images([image1, image2, image3], alpha_values)

# 显示结果

cv2.imshow("Blended Image", result_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

在扩展的代码中,我们对图像融合进行了改进:

-

多图像融合:现在可以融合多张图像,只需将它们作为列表传递给

blend_images()函数即可。 -

融合比例:我们使用一个列表

alpha_values来指定每张图像的融合比例。请确保融合比例的总和为1,以确保结果图像的亮度一致。 -

归一化处理:在融合过程中,我们使用浮点数进行计算,然后将结果限制在0到255之间,并转换为8位图像。

通过这些改进,我们可以实现多张图像的灵活融合,并根据需要调整每张图像的融合比例。

五、归纳总结

OpenCV提供了丰富的功能和算法,用于图像拼接,包括全景图像拼接和图像融合等功能。以下是对OpenCV图像拼接相关功能的归纳总结:

OpenCV提供了丰富的功能和算法,用于图像拼接,包括全景图像拼接和图像融合等功能。以下是对OpenCV图像拼接相关功能的归纳总结:

-

全景图像拼接:

- 特征提取:使用特征提取算法(如SIFT、SURF、ORB等)检测图像中的关键点和计算特征描述符。

- 特征匹配:通过特征描述符进行特征匹配,找出在多个图像中对应的特征点。

- 图像配准:根据匹配的特征点,估计相邻图像之间的变换关系(如单应性矩阵),使它们对齐。

- 图像拼接:使用透视变换将配准后的图像进行拼接,生成全景图像。

-

图像融合:

- 加权平均:通过调整不同图像的权重,使用

addWeighted()函数进行图像融合,实现平滑过渡效果。 - 混合模式:使用不同的混合模式(如叠加、正片叠底、柔光等)将多个图像进行混合,产生不同的融合效果。

- 融合掩码:使用掩码(如alpha通道)来指定每个像素的权重,实现局部融合和遮罩效果。

- 加权平均:通过调整不同图像的权重,使用

-

优化和增强:

- 图像预处理:对输入图像进行预处理,如灰度化、平滑滤波、边缘增强等,提高拼接和融合效果。

- 特征匹配优化:使用更准确的特征匹配算法、筛选和剔除错误匹配点,提高配准的精度和鲁棒性。

- 图像修复和补全:对拼接后的图像进行修复和补全,填充缺失区域,提高结果的完整性和美观度。

通过OpenCV提供的函数和算法,可以实现灵活而高效的图像拼接和融合。根据具体需求和场景,可以选择适当的方法和参数来获得理想的拼接和融合效果。

希望对您有所帮助!如果您有任何其他问题,请随时提问。

2713

2713

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?