本文从总体上介绍一下在使用大模型过程中,关于如何正确的处理自己上传数据中的敏感信息。

本文的目录结构如下,可以直接跳到对应的章节阅读:

AI数据安全危机

DeepSeek、ChatGPT,Qwen,Claude等AI平台工具快速的被接受和使用,用户每天上传的文本数据中潜藏着大量敏感信息,大量的AI服务数据泄漏事件源于未正确处理输入数据。

- 你是否在上传数据到deepseek,chatgpt,通义千问,豆包,腾讯元宝,纳米搜索等平台之前犹豫过?

- 是否纠结如何快速的检查数据中是否存在敏感信息?

- 是否受制于如何快速轻量的对这些数据进行脱敏?

- 你是否担心数据上传到大语言模型等AI平台之后,身份证,手机号,银行卡等会被用于特殊的用途?

- 你是否担心数据不仅会被大模型平台获取,还会被诸多的插件应用获取?

如果你存在上述的问题,本文将为你提供解决的思路和方法。文件数据中最为常见的敏感信息就是姓名,手机号,身份证等,如果直接把这些数据喂给大模型,那在后续大模型更新之后会吸纳这些信息。当其他人再次询问大模型的时候,大模型则可能会回答有关你个人隐私的数据内容。因此有必要对于个人敏感的信息进行脱敏,大致的效果如下:

张三 18800188000 110105203301011234

张* 188****8000 110105***********4

敏感信息的分类

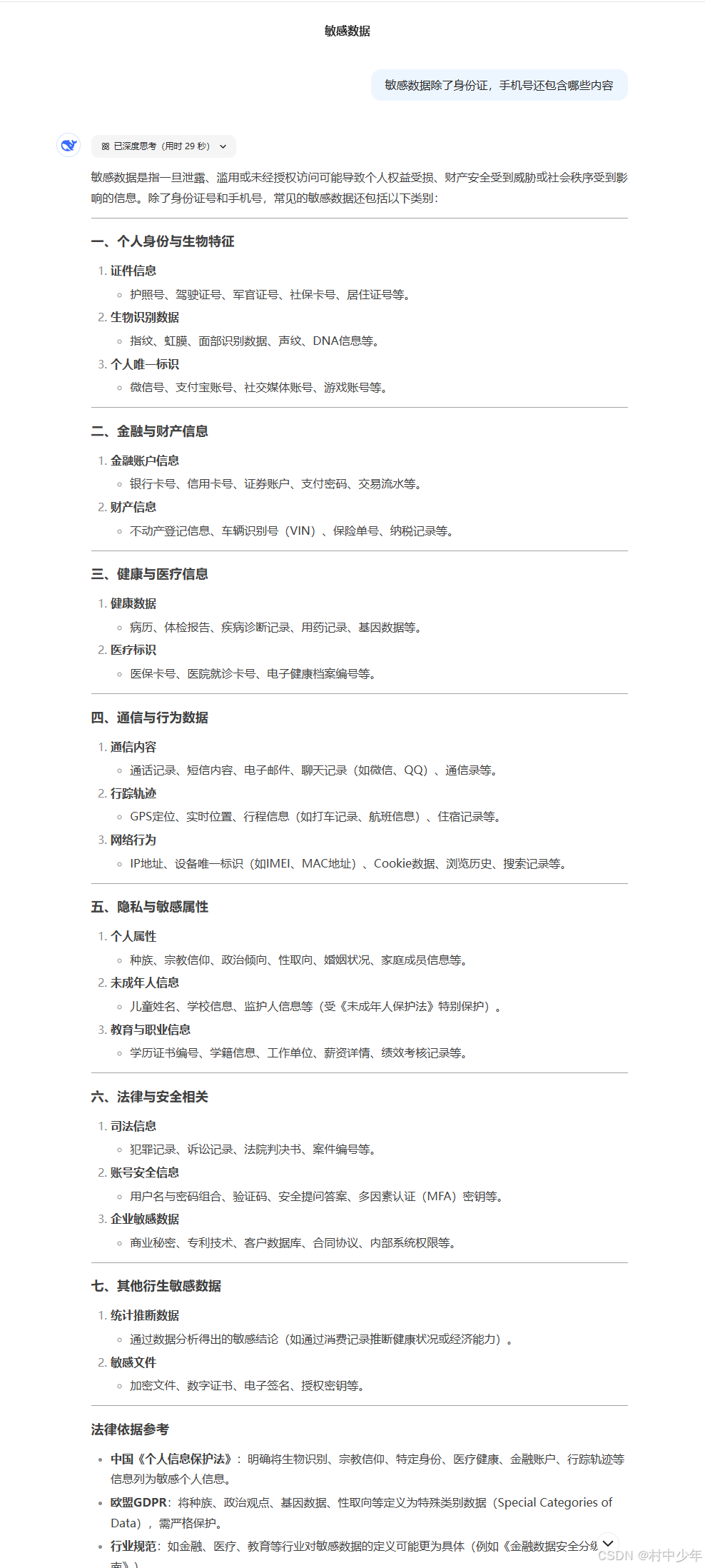

首先,敏感内容的范围非常的广泛,直接询问deepseek即可,如下:

本文不会介绍所有敏感内容的脱敏,只会总体性的介绍姓名,手机号,身份证的脱敏。如果想要了解更多内容的脱敏,详见我的专栏《脱敏Deepseek/Chatgpt等AI大模型中的敏感数据》,这里。

常见信息脱敏手段

通常来说,常见敏感信息的脱敏有如下几种方法:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

304

304

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?