交流群 | 进“传感器群/滑板底盘群/汽车基础软件群/域控制器群”请扫描文末二维码,添加九章小助手,务必备注交流群名称 + 真实姓名 + 公司 + 职位(不备注无法通过好友验证)

作者 | 张萌宇

在刚刚过去的CVPR会议上,作为国内唯一一家被邀请登台演讲的造车新势力,小鹏汽车向参会者介绍了小鹏汽车在国内量产辅助驾驶系统的经验。

作为小鹏汽车最新一代的感知架构,XNet在量产中发挥的作用不容小觑。

笔者有幸采访到小鹏汽车自动驾驶中心感知首席工程师 Patrick,更进一步得了解XNet的性能、架构,以及小鹏的自驾团队为搭建XNet所做的努力。

1. XNet实现的性能提升

XNet实现了感知结构的升级,拥有更好的性能,主要包括3个方面。

1.1

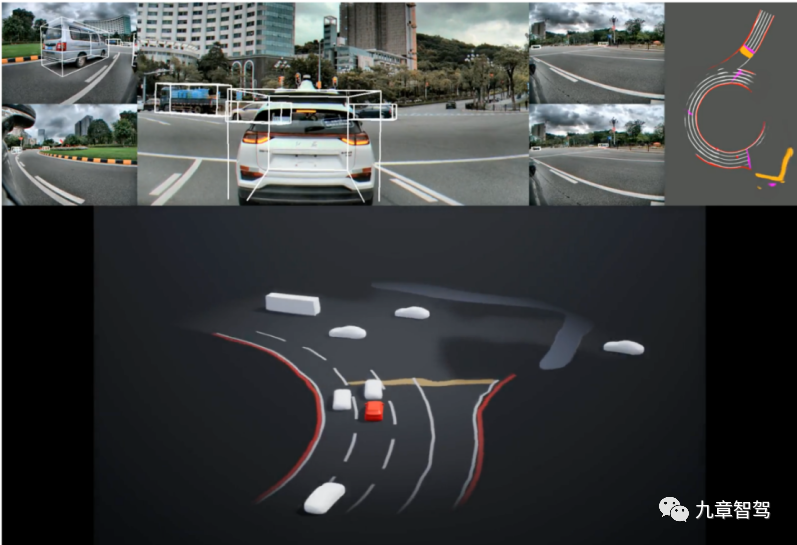

超强环境感知能力,实时生成“高精地图”

XNet可以根据周围环境实时构建“高精地图”。从上图我们可以看到,车辆正在经过一个环岛,图中显示的车道线不是来自于高精地图,而是来自于XNet的感知输出。XNet不光可以输出车道线,还有停止线、人行道、可行驶区域等。这是将来小鹏汽车应对无图场景,做高级别城市辅助驾驶的最核心的能力之一。

1.2

更强的360度感知,博弈更强、变道成功率更高

在上一代感知架构中,盲区问题很难解决。在最靠近本车的地方,尤其是车辆的下边界,感知系统的检测效果往往不好。XNet采用多相机多帧、前融合的感知方案,可以根据图像内的车身信息推测车辆在BEV视角下的3D位置信息,解决了相机上下视野受限的问题;还可以更加有效地同时融合多相机的信息,尤其是分节到两个相机视野中的物体,从而避免盲人摸象式的物体感知。

另外,输入包含时序信息的视频流后,XNet对近车物体的识别能力有大幅提升,可以更加稳定地检测到近车物体。那么,自动驾驶系统的博弈能力就更强,汽车变道的成功率更高。

1.3

小鹏汽车在CVPR会议上分享了其XNet感知架构,该架构提升了辅助驾驶系统的性能。XNet能实时构建高精地图,增强360度感知,更精准识别动态物体速度和意图。通过多相机多帧的前融合方案,解决了盲区问题,提高了变道成功率。此外,文章还介绍了XNet的架构设计,包括BEV视图转换器和时空融合,以及团队在数据采集、标注、训练和部署方面的努力,如全自动标注系统和大规模云端训练。

小鹏汽车在CVPR会议上分享了其XNet感知架构,该架构提升了辅助驾驶系统的性能。XNet能实时构建高精地图,增强360度感知,更精准识别动态物体速度和意图。通过多相机多帧的前融合方案,解决了盲区问题,提高了变道成功率。此外,文章还介绍了XNet的架构设计,包括BEV视图转换器和时空融合,以及团队在数据采集、标注、训练和部署方面的努力,如全自动标注系统和大规模云端训练。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1284

1284

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?