【卷积神经网络】(二)AlexNet

1.简介

在LeNet问世20多年后,AlexNet被发布出来。它⾸次证明了学习到的特征可以超越⼿⼯设计的特征。

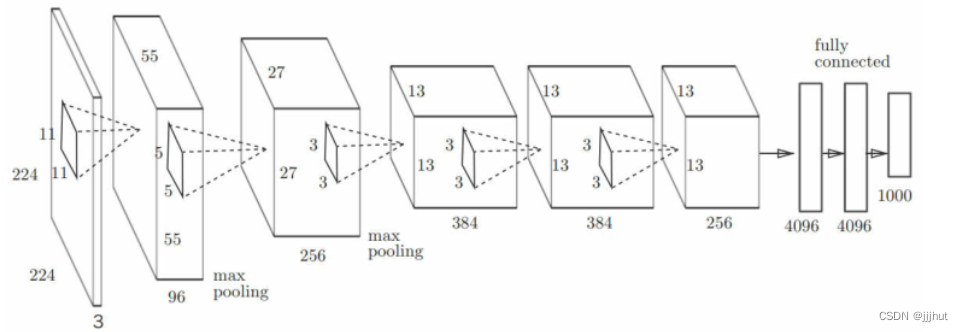

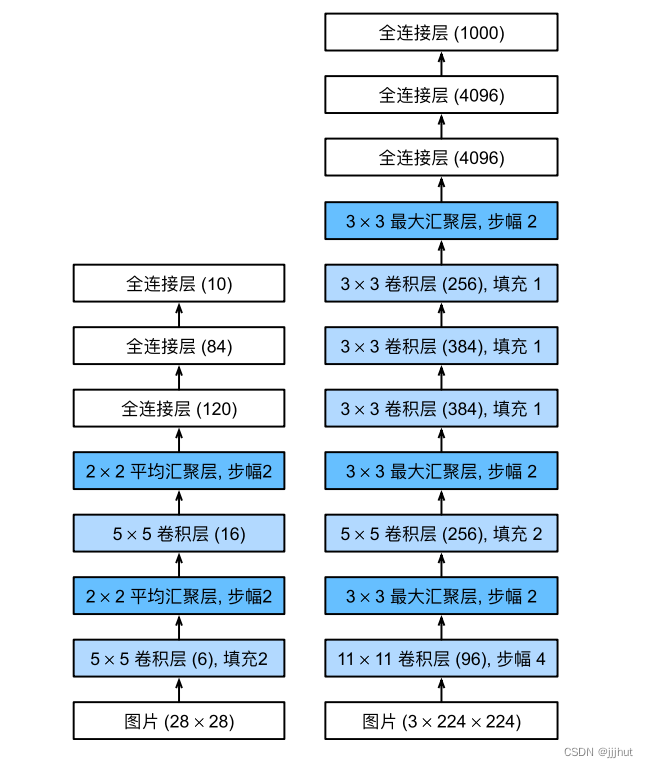

AlexNet使⽤了8层卷积神经⽹络,其网络结构类似于LeNet,如下所示:

AlexNet 叠有多个卷积层和池化层,最后经过由全连接层输出结果。

2.与LeNet 的 差异

- AlexNet⽐相对较⼩的LeNet5要深得多。AlexNet由⼋层组成:五个卷积层、两个全连接隐藏层和⼀个

全连接输出层。 - 激活函数使用ReLU

- 使用进行局部正规化的LRN层

- 使用Dropout

3.基于Pytorch的LeNet实现

3.1 构建模型

import torch

from torch import nn

from d2l import torch as d2l

net = nn.Sequential(

# 这里使用一个11*11的更大窗口来捕捉对象。

# 同时,步幅为4,以减少输出的高度和宽度。

# 另外,输出通道的数目远大于LeNet

nn.Conv2d(1, 96, kernel_size=11, stride=4, padding=1), #[1, 96, 54, 54]

nn.ReLU(), # [1, 96, 54, 54]

nn.MaxPool2d(kernel_size=3, stride=2), #[1, 96, 26, 26]

# 减小卷积窗口,使用填充为2来使得输入与输出的高和宽一致,且增大输出通道数

nn.Conv2d(96, 256, kernel_size=5, padding=2), #[1, 256, 26, 26]

nn.ReLU(), #[1, 256, 26, 26]

nn.MaxPool2d(kernel_size=3, stride=2), #[1, 256, 12, 12]

# 使用三个连续的卷积层和较小的卷积窗口。

# 除了最后的卷积层,输出通道的数量进一步增加。

# 在前两个卷积层之后,汇聚层不用于减少输入的高度和宽度

nn.Conv2d(256, 384, kernel_size=3, padding=1), #[1, 384, 12, 12]

nn.ReLU(), #[1, 384, 12, 12]

nn.Conv2d(384, 384, kernel_size=3, padding=1), #[1, 384, 12, 12]

nn.ReLU(), #[1, 384, 12, 12]

nn.Conv2d(384, 256, kernel_size=3, padding=1), #[1, 256, 12, 12]

nn.ReLU(), #[1, 256, 12, 12]

nn.MaxPool2d(kernel_size=3, stride=2), #[1, 256, 5, 5]

nn.Flatten(), #[1, 6400]

# 这里,全连接层的输出数量是LeNet中的好几倍。使用dropout层来减轻过拟合

nn.Linear(6400, 4096), #[1, 4096]

nn.ReLU(), #[1, 4096]

nn.Dropout(p=0.5), #[1, 4096]

nn.Linear(4096, 4096), #[1, 4096]

nn.ReLU(), #[1, 4096]

nn.Dropout(p=0.5), #[1, 4096]

# 最后是输出层。由于这里使用Fashion-MNIST,所以用类别数为10,而非论文中的1000

nn.Linear(4096, 10)) #[1, 10]

3.2 读取数据集

batch_size = 128

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size, resize=224)

3.3 训练AlexNet

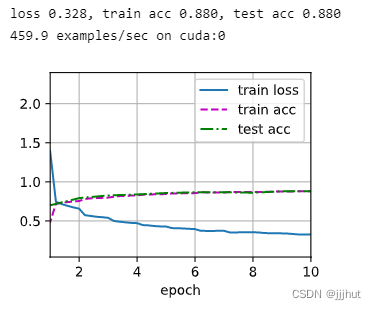

现在AlexNet可以开始被训练了。与LeNet相比,这里的主要变化是使用更小的学习速率训练,这是因为网络更深更广、图像分辨率更高,训练卷积神经网络就更昂贵。

lr, num_epochs = 0.01, 10

d2l.train_ch6(net, train_iter, test_iter, num_epochs, lr, d2l.try_gpu())

3.4 训练结果

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?