朴素贝叶斯法

朴素贝叶斯法(naive Bayes)是基于贝叶斯定理和特征条件独立假设的分类方法。对于给定的训练数据聚集,首先基于特征条件独立假设学习输入输出的联合概率分布;然后基于此模型,对给定的输入x,利用贝叶斯定理求出后验概率最大的输出y。

4.1 朴素贝叶斯法的学习与分类

4.1.1 基本方法

- 朴素贝叶斯法实际上学习到生成数据的机制,所以属于生成模型。

- 条件独立假设等于是说用于分类的特征在类确定的条件下都是条件独立的。

- 朴素贝叶斯法分类时,对给定的输入x,用过学习到的模型计算后验概率分布P(Y=ck|X=x),将后验概率最大的类作为x的类输出。朴素贝叶斯分类器可表示为:

argmax()是一种对函数求参数(集合)的函数。

当有另一个函数y=f(x)时,若有结果x0=argmax(f(x)),则表示当函数f(x)取x=x0的时候,得到f(x)取值范围的最大值。

4.1.2 后验概率最大化的含义

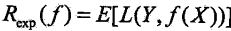

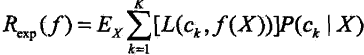

朴素贝叶斯法将实例分到后验概率最大的类中。这等价于期望风险最小化。

假设选择0-1损失函数:

这时期望风险函数为:

取条件期望:

为了使期望风险最小化,只需对X=x逐个极小化:

这样一来,根据期望风险最小化准则就得到了后验概率最大化准则:

4.2 朴素贝叶斯法的参数估计

4.2.1 极大似然估计

在朴素贝叶斯法中,学习意味着估计P(Y=ck)和P(X(j)=x(j)|Y=ck)。可以用极大似然估计法估计相应的概率。

- 先验概率P(Y=ck)的极大似然估计:

- 设第j个特征x(j)可能取值的集合为:

条件概率的极大似然估计:

(1)如果我们的Xj是离散的值,那么我们可以假设Xj符合多项式分布,这样得到P(Xj=X(test)j|Y=Ck) 是在样本类别Ck中,特征X(test)j出现的频率。即:

(2)如果我们我们的Xj是非常稀疏的离散值,即各个特征出现概率很低,这时我们可以假设Xj符合伯努利分布,即特征Xj出现记为1,不出现记为0。即只要Xj出现即可,我们不关注Xj的次数。这样得到P(Xj=X(test)j|Y=Ck) 是在样本类别Ck中,X(test)j出现的频率。此时有:

其中,X(test)j取值为0和1。

(3)如果我们我们的Xj是连续值,我们通常取Xj的先验概率为正态分布,即在样本类别Ck中,Xj的值符合正态分布。这样P(Xj=X(test)j|Y=Ck)的概率分布是:

其中μk和σ2k是正态分布的期望和方差,可以通过极大似然估计求得。μk为在样本类别Ck中,所有Xj的平均值。σ2k为在样本类别Ck中,所有Xj的方差。对于一个连续的样本值,带入正态分布的公式,就可以求出概率分布了。

4.2.2 学习与分类算法

步骤:

1、 计算先验概率和后验概率

2、 对于给定的实例

计算

3、 确定x的类别

4.2.3 贝叶斯估计

用极大似然估计可能会出现所要估计得概率值为0的情况。这是会影响到后验概率的计算结果,使分类结果产生偏差。解决这一问题的方法是采用贝叶斯估计。

条件概率的贝叶斯估计是: 等价于在随机变量各个取值的频数上赋予一个正数。当其为0时就是极大似然估计。常取其为1,这是称为拉普拉斯平滑(Laplacian smoothing)。

等价于在随机变量各个取值的频数上赋予一个正数。当其为0时就是极大似然估计。常取其为1,这是称为拉普拉斯平滑(Laplacian smoothing)。

同样,先验概率的贝叶斯估计是:

1978

1978

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?