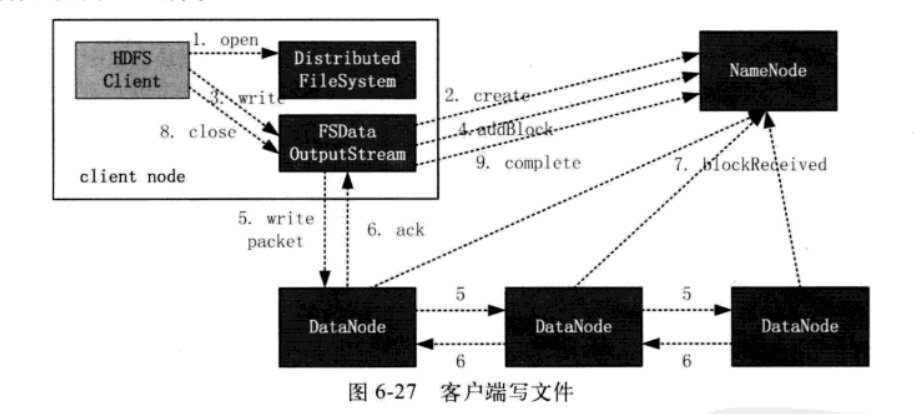

即使不考虑数据节点出错后的故障处理,文件写入也是HDFS中最复杂的流程。本章以创建一个新文件并向文件中写入数据,然后关闭文件为例,分析客户端写文件时系统各节点的配合,如下图所示。

客户端调用DistributedFileSystem的create()方法创建文件,上图的步骤1,这时,DistributedFileSystem创建DFSOutputStream,并由远程过程调用,让名字节点执行同名方法,在文件系统的命名空间中创建一个新文件。名字节点创建新文件时,需要执行各种各样的检查,如名字节点处于正常工作状态,被创建的文件不存在,客户端有在父目录中创建文件的权限等。这些检查都通过以后,名字节点会构造一个新文件,并记录创建操作到编辑日志edits中。远程方法调用结束后,DistributedFileSystem将该DFSOutputStream对象包裹在FSDataOutputStream实例中,返回给客户端。

在上图的步骤3客户端写入数据时,由于create()调用创建了一个空文件,所以,DFSOutputStream实例首先需要向名字节点申请数据块,addBlock()方法成功执行后,返回一个LocatedBlock对象。该对象包含了新数据块的数据块标识和版本号,同时,它的成员变量LocatedBlock.locs提供了数据流管道的信息,通过上述信息,DFSOutputStream就可以和数据节点联系,通过写数据接口建立数据流管道。客户端写入FSDataOutputStream流中的数据,被分成一个一个的文件包,放入DFSOutputStream对象的内部队列。该队列中的文件包最后打包成数据包,发往数据流管道,流经管道上的各个数据节点,并持久化。确认包,上图步骤6逆流而上,从数据流管道依次发往客户端,当客户端收到应答时,它将对应的包从内部队列移除。

DFSOutputStream在写完一个数据块后,数据流管道上的节点,会通过和名字节点的DatanodeProtocol远程接口的blockReceived()方法,向名字节点提交数据块。如果数据队列中还有等待输出的数据,DFSOutputStream对象需要再次调用addBlock()方法,为文件添加新的数据块。

客户端完成数据的写入后,调用close()方法关闭流,步骤8。关闭意味着客户端不会再往流中写入数据,所以,当DFSOutputStream数据队列中的文件包都收到应答后,就可以使用ClinetProtocol.complete()方法通知名字节点关闭文件,完成一次正常的写文件流程。

写数据

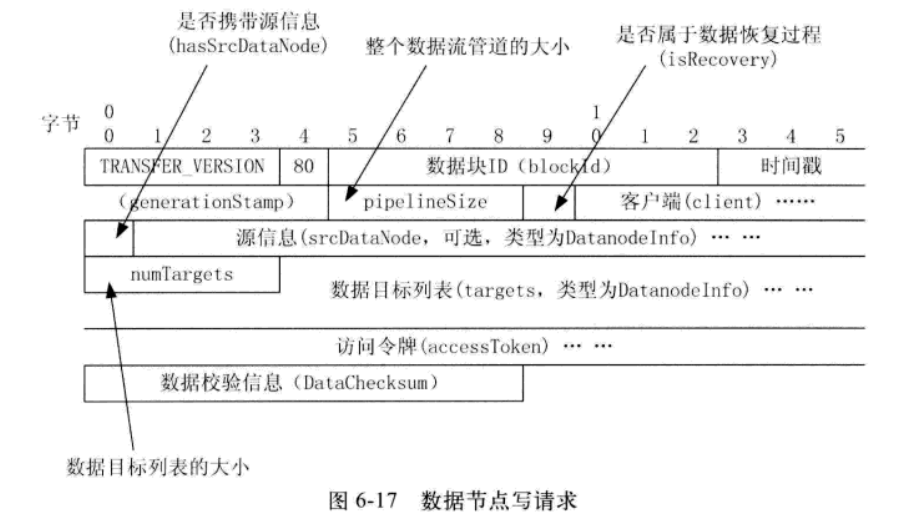

流式接口的写数据实现远比读数据复杂。客户端写HDFS文件数据的操作码为80,请求包含如下主要字段:

blockId(数据块ID):写数据的数据块标识,数据节点通过它定位数据块。

generationStamp(版本号):数据块的版本号,用于进行版本检查。

pipelineSize(数据流管道的大小):参与到写过程的所有数据节点的个数。

isRecovery(是否是数据恢复过程):这个写操作是不是错误恢复过程中的一部分。

clientName(客户端名字):发起写请求的客户端名字,可能为空。

hasSrcDataNode(源信息标记):写请求是否携带源信息,如果是true,则包含源信息。

srcDataNode(源信息,可选):类型为DatanodeInfo,包含发起写请求的数据节点信息。

numTargets(数据目标列表大小):当前数据节点还有多少个下游数据推送目标。

targets(数据目标列表):当前数据节点的下游数据推送目标列表。

accessToken(访问令牌):与安全特性相关,不讨论。

checksum(数据校验信息):类型为DataChecksum,包含了后续写数据数据包的校验方式。

与org.apache.hadoop.hdfs.server.datanode.DataXceiver.java.readBlock类似,上述字段在writeBlock()入口中读取,并保存在对应的方法变量中,然后,构造数据块接收器org.apache.hadoop.hdfs.server.datanode.BlockReceiver对象,

/**

* Write a block to disk.

*

* @param in The stream to read from

* @throws IOException

*/

private void writeBlock(DataInputStream in) throws IOException {

DatanodeInfo srcDataNode = null;

LOG.debug("writeBlock receive buf size " + s.getReceiveBufferSize() +

" tcp no delay " + s.getTcpNoDelay());

//

// Read in the header

//

Block block = new Block(in.readLong(),

dataXceiverServer.estimateBlockSize, in.readLong());

LOG.info("Receiving " + block + " src: " + remoteAddress + " dest: "

+ localAddress);

int pipelineSize = in.readInt(); // num of datanodes in entire pipeline

boolean isRecovery = in.readBoolean(); // is this part of recovery?

String client = Text.readString(in); // working on behalf of this client

boolean hasSrcDataNode = in.readBoolean(); // is src node info present

if (hasSrcDataNode) {

srcDataNode = new DatanodeInfo();

srcDataNode.readFields(in);

}

int numTargets = in.readInt();

if (numTargets < 0) {

throw new IOException("Mislabelled incoming datastream.");

}

DatanodeInfo targets[] = new DatanodeInfo[numTargets];

for (int i = 0; i < targets.length; i++) {

DatanodeInfo tmp = new DatanodeInfo();

tmp.readFields(in);

targets[i] = tmp;

}

Token<BlockTokenIdentifier> accessToken = new Token<BlockTokenIdentifier>();

accessToken.readFields(in);

DataOutputStream replyOut = null; // stream to prev target

replyOut = new DataOutputStream(

NetUtils.getOutputStream(s, datanode.socketWriteTimeout));

if (datanode.isBlockTokenEnabled) {

try {

datanode.blockTokenSecretManager.checkAccess(accessToken, null, block,

BlockTokenSecretManager.AccessMode.WRITE);

} catch (InvalidToken e) {

try {

if (client.length() != 0) {

replyOut.writeShort((short)DataTransferProtocol.OP_STATUS_ERROR_ACCESS_TOKEN);

Text.writeString(replyOut, datanode.dnRegistration.getName());

replyOut.flush();

}

throw new IOException("Access token verification failed, for client "

+ remoteAddress + " for OP_WRITE_BLOCK for " + block);

} finally {

IOUtils.closeStream(replyOut);

}

}

}

DataOutputStream mirrorOut = null; // stream to next target

DataInputStream mirrorIn = null; // reply from next target

Socket mirrorSock = null; // socket to next target

BlockReceiver blockReceiver = null; // responsible for data handling

String mirrorNode = null; // the name:port of next target

String firstBadLink = ""; // first datanode that failed in connection setup

short mirrorInStatus = (short)DataTransferProtocol.OP_STATUS_SUCCESS;

try {

// open a block receiver and check if the block does not exist

blockReceiver = new BlockReceiver(block, in,

s.getRemoteSocketAddress().toString(),

s.getLocalSocketAddress().toString(),

isRecovery, client, srcDataNode, datanode);

//

// Open network conn to backup machine, if

// appropriate

//

if (targets.length > 0) {

InetSocketAddress mirrorTarget = null;

// Connect to backup machine

final String mirrorAddrString =

targets[0].getName(connectToDnViaHostname);

mirrorNode = targets[0].getName();

mirrorTarget = NetUtils.createSocketAddr(mirrorAddrString);

mirrorSock = datanode.newSocket();

try {

int timeoutValue = datanode.socketTimeout +

(HdfsConstants.READ_TIMEOUT_EXTENSION * numTargets);

int writeTimeout = datanode.socketWriteTimeout +

(HdfsConstants.WRITE_TIMEOUT_EXTENSION * numTargets);

LOG.debug("Connecting to " + mirrorAddrString);

NetUtils.connect(mirrorSock, mirrorTarget, timeoutValue);

mirrorSock.setSoTimeout(timeoutValue);

mirrorSock.setSendBufferSize(DEFAULT_DATA_SOCKET_SIZE);

mirrorOut = new DataOutputStream(

new BufferedOutputStream(

NetUtils.getOutputStream(mirrorSock, writeTimeout),

SMALL_BUFFER_SIZE));

mirrorIn = new DataInputStream(NetUtils.getInputStream(mirrorSock));

// Write header: Copied from DFSClient.java!

mirrorOut.writeShort( DataTransferProtocol.DATA_TRANSFER_VERSION );

mirrorOut.write( DataTransferProtocol.OP_WRITE_BLOCK );

mirrorOut.writeLong( block.getBlockId() );

mirrorOut.writeLong( block.getGenerationStamp() );

mirrorOut.writeInt( pipelineSize );

mirrorOut.writeBoolean( isRecovery );

Text.writeString( mirrorOut, client );

mirrorOut.writeBoolean(hasSrcDataNode);

if (hasSrcDataNode) { // pass src node information

srcDataNode.write(mirrorOut);

}

mirrorOut.writeInt( targets.length - 1 );

for ( int i = 1; i < targets.length; i++ ) {

targets[i].write( mirror

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

797

797

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?