本文来源 新智元 编辑:LRS

【新智元导读】EdgeNet可以处理从干净的自然图像或嘈杂的对抗性图像中提取的边缘,产生鲁棒的特征,具有轻量级、即插即用等特点,能够无缝集成到现有的预训练深度网络中,训练成本低。

在深度神经网络时代,深度神经网络(DNNs)在视觉分类任务中展现出了卓越的准确性。然而,它们对额外噪声,即对抗性攻击,表现出了脆弱性。先前的研究假设这种脆弱性可能源于高准确度的深度网络过度依赖于与纹理和背景等无关紧要且不鲁棒的特征。

最近的AAAI 2024学术会议上,悉尼大学的研究人员们揭示了「从图像中提取的边缘信息」能够提供与形状和前景相关的相关性强且鲁棒的特征。

论文链接:https://ojs.aaai.org/index.php/AAAI/article/view/28110

这些特征在帮助预训练深度网络改善对抗鲁棒性的同时,还不影响其在清晰图像上的准确性。

作者们提出了一种轻量级且即插即用的EdgeNet,可以无缝集成到现有的预训练深度网络中,包括Vision Transformers (ViTs),这是最新一代用于视觉分类的先进模型家族。

EdgeNet可以处理从干净的自然图像或嘈杂的对抗性图像中提取的边缘,产生鲁棒的特征,可以注入到预训练好并被冻结的的骨干深度网络的中间层。

值得注意的是,这种方法带来的额外成本极低:使用传统的边缘检测算法(例如文中所用的 Canny 边缘检测器)获取这些边缘的成本与深度网络的推理成本相比微乎其微;而训练EdgeNet 的成本则与使用诸如 Adapter 等技术对骨干网络进行微调的成本不相上下。

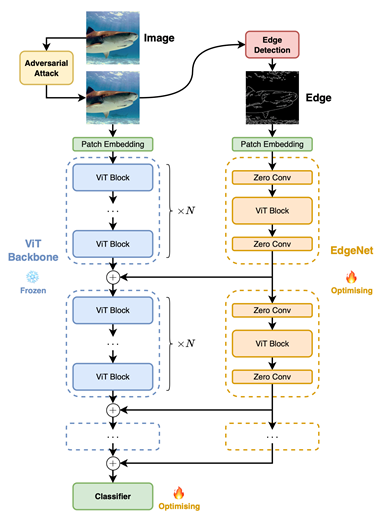

EdgeNet 架构

为了将图像中的边缘信息注入到预训练的骨干网络中,作者引入了一个名为 EdgeNet 的侧支网络。这个轻量级、即插即用的侧枝网络可以无缝地集成到现有的预训练深度网络中,包括像 ViTs 这样的最新模型。

EdgeNet 通过处理从输入图像中提取的边缘信息运行。这个过程产生了一组具有鲁棒性的特征,可以被选择性地注入到预训练好并被冻结的骨干深度网络的中间层。

通过注入这些鲁棒特征,能够提升网络在防御对抗性扰动方面的能力。同时,由于骨干网络是被冻结的,而新特征的注入是有选择性的,所以可以保持预训练网络在识别未经扰动的清晰图像方面的准确性。

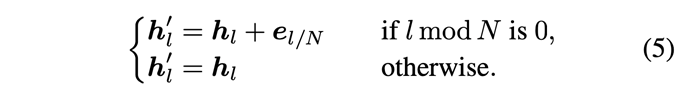

如图所示,作者在原有的构建块 基础上,以一定间隔 N 插入新的 EdgeNet 构建块

基础上,以一定间隔 N 插入新的 EdgeNet 构建块 。新的中间层输出可以由以下公式表示:

。新的中间层输出可以由以下公式表示:

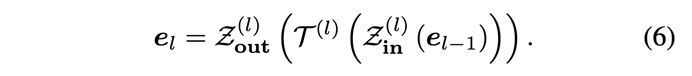

EdgeNet 构建块

为了实现选择性特征提取和选择性特征注入,这些 EdgeNet 构建块采取了一种“三明治”结构:每个块的前后都添加了零卷积(zero convolution)来控制输入与输出。在这两个零卷积之间是一个具有随机初始化的、与骨干网络架构相同的 ViT block

利用零输入, 充当提取与优化目标相关信息的过滤器;利用零输出, 充当确定要集成到骨干中的信息的过滤器。此外,通过零初始化,可以确保了骨干内的信息流保持不受影响。因此,对 EdgeNet 的后续微调变得更加简化。

充当提取与优化目标相关信息的过滤器;利用零输出, 充当确定要集成到骨干中的信息的过滤器。此外,通过零初始化,可以确保了骨干内的信息流保持不受影响。因此,对 EdgeNet 的后续微调变得更加简化。

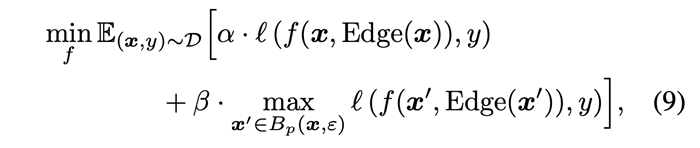

训练目标

在训练 EdgeNet 的过程中,预训练好的 ViT 骨干网络除了分类头均被冻结住,不进行更新。优化目标仅专注于为边缘特征引入的 EdgeNet 网络,以及骨干网络内的分类头。在这里,作者采用了一个非常简化的联合优化目标以保障训练的效率:

在公式 9 中,α 是准确性损失函数的权重,β 是鲁棒性损失函数的权重。通过调整 α 和 β 的大小,可以微调 EdgeNet 训练目标的平衡性,以达到在提升其鲁棒性的同时不显著损失准确性的目的。

实验结果

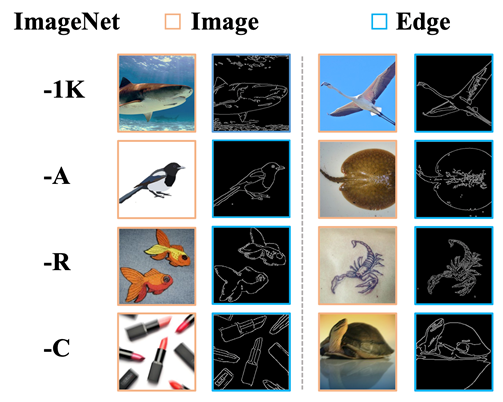

作者们在 ImageNet 数据集上针对两大类鲁棒性进行了测试。

第一类是抵御对抗攻击的鲁棒性,包括白盒攻击与黑盒攻击;

第二类是抵御一些常见的扰动的鲁棒性,包括 ImageNet-A 中的自然对抗样本(Natural Adversarial Examples),ImageNet-R 中的分布外数据(Out-of-Distribution Data)和 ImageNet-C 中的常见数据扭曲(Common Corruptions)。

作者还针对不同扰动下提取到的边缘信息进行了可视化。

网络规模与性能测试

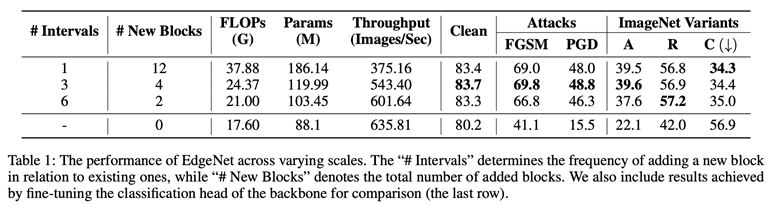

在实验部分,作者首先测试了不同规模 EdgeNet 的分类性能和计算开销(Table 1)。在综合考虑分类性能和计算计算开销后,他们确定 #Intervals = 3的配置为最佳设置。

在这个配置中,EdgeNet 与基准模型相比获得了显著的准确度和鲁棒性提升。它在分类性能、计算要求和鲁棒性之间取得了平衡的妥协。

该配置在保持合理的计算效率的同时,在清晰准确度和鲁棒性方面取得了实质性的增益。

准确性与鲁棒性对比

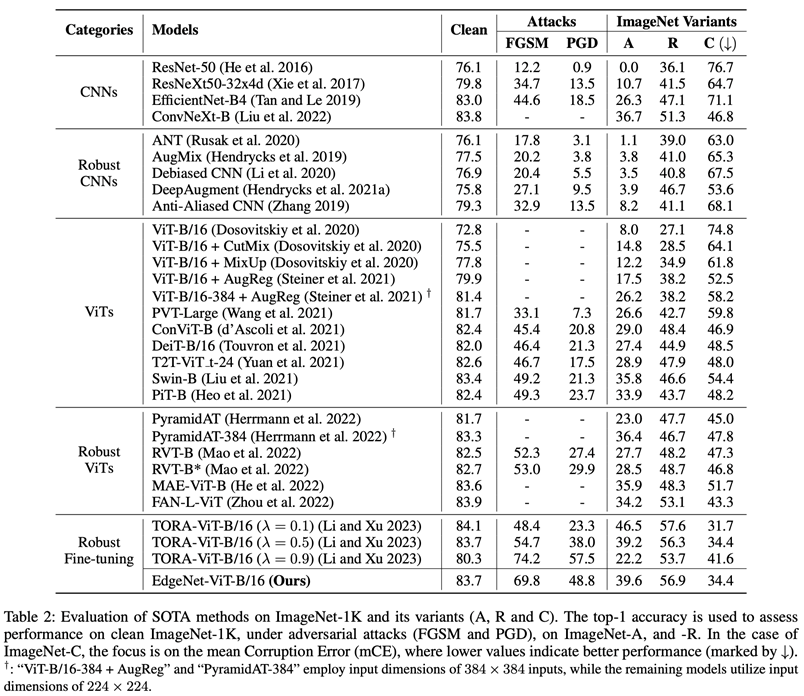

作者将他们提出的 EdgeNet 与5个不同类别的 SOTA 方法进行了对比(Table 2)。这些方法包括在自然图像上训练的 CNNs、鲁棒的 CNNs、在自然图像上训练的 ViTs、鲁棒的ViTs 和经过鲁棒微调的ViTs。

考虑的指标包括在对抗攻击(FGSM 和 PGD)下的准确性、在ImageNet-A上的准确性以及在ImageNet-R上的准确性。

此外,还报告了ImageNet-C 的平均错误(mCE),较低的值表示更好的性能。实验结果表明 EdgeNet 在面对 FGSM 和 PGD 攻击时展现出卓越的性能,同时在清晰的 ImageNet-1K 数据集及其变体上表现出与先前 SOTA 方法相持平的水平。

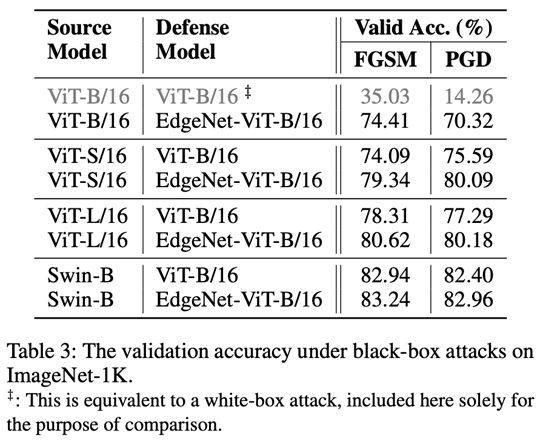

除此之外,作者还开展了黑盒攻击的实验(Table 3)。实验结果表明,EdgeNet 也能十分有效的抵挡黑盒攻击。

结论

在这项工作中,作者提出了一种名为 EdgeNet 的新方法,它通过利用从图像中提取到的边缘信息,可以提升深度神经网络(特别是 ViTs)的鲁棒性。

这是一个轻量级且可以无缝集成到现有网络中的模块,它能够有效的提高对抗性鲁棒性。实验证明,EdgeNet 具有高效性——它仅带来了极小的额外计算开销。

此外 EdgeNet 在各种鲁棒基准上具有广泛适用性。这使其成为该领域引人注目的进展。

此外,实验结果证实,EdgeNet 可以有效抵抗对抗性攻击,并能在干净图像上保持的准确性,这突显了边缘信息在视觉分类任务中作为鲁棒且相关特征的潜力。

值得注意的是,EdgeNet 的鲁棒性不仅限于对抗性攻击,还涵盖了涉及自然对抗性示例(ImageNet-A)、分布之外的数据(ImageNet-R)和常见破坏(ImageNet-C)情景。

这种更广泛的应用凸显了EdgeNet的多功能性,并显示其作为视觉分类任务中多样挑战的全面解决方案的潜力。

参考资料:

https://ojs.aaai.org/index.php/AAAI/article/view/28110

关注公众号【机器学习与AI生成创作】,更多精彩等你来读

不是一杯奶茶喝不起,而是我T M直接用来跟进 AIGC+CV视觉 前沿技术,它不香?!

ICCV 2023 | 最全AIGC梳理,5w字30个diffusion扩散模型方向,近百篇论文!

卧剿,6万字!30个方向130篇!CVPR 2023 最全 AIGC 论文!一口气读完

深入浅出stable diffusion:AI作画技术背后的潜在扩散模型论文解读

深入浅出ControlNet,一种可控生成的AIGC绘画生成算法!

最新最全100篇汇总!生成扩散模型Diffusion Models

附下载 |《TensorFlow 2.0 深度学习算法实战》

《礼记·学记》有云:独学而无友,则孤陋而寡闻

点击跟进 AIGC+CV视觉 前沿技术,真香!,加入 AI生成创作与计算机视觉 知识星球!

3748

3748

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?