机器学习数学基础

文章目录

解释微分、梯度的含义?什么是梯度下降法

微分本质是一个微小的线性变化量,是用一个线性函数作为原函数变化的逼近(或者叫近似)。

梯度的本意是一个向量(矢量),表示某一函数在该点处的方向导数沿着该方向取得最大值,即函数在该点处沿着该方向(此梯度的方向)变化最快,变化率最大(为该梯度的模)。

梯度下降(gradient descent)主要目的是通过迭代找到目标函数的最小值,或者收敛到最小值。所以,它是一种常用的求解无约束最优化问题的方法,在最优化、统计学以及机器学习等领域有着广泛的应用。

用梯度下降法手工求解

- 题目描述

f(x)=f(x1,x2)=1/3x12+1/2x22 - 计算

(1)设置初始点及学习率

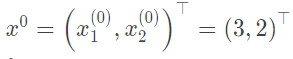

初始点:

学习率: λ λ λ

说明:初始点和学习率是自己随意设置的,这里的学习率可以先不做预设值

计算初始点的梯度

梯度计算

▽ f ( x ) = ( 2 / 3 x 1 , x 2 ) ▽f(x)=(2/3x1,x2) ▽f(x)=(2/3x1,x2)

初始点的梯度(将x0的值带入上面的梯度计算)

▽ f ( x 0 ) = ( 2 , 2 ) ▽f(x^0)=(2,2) ▽f(x0)=(2,2)

3.更新迭代公式

f ( x 1 ) = f ( x 0 − λ ▽ f ( x 0 ) ) = 10 / 3 λ 2 − 8 λ + 5 f(x^1)=f(x^0-λ▽f(x^0))=10/3λ^2-8λ+5 f(x1)=f(x0−λ▽f(x0))=10/3λ2−8λ+5

λ 0 = 6 / 5 λ^0=6/5 λ0=6/5为函数极小点

更新后的迭代公式 x 1 = x 0 − λ 0 ▽ f ( x 0 ) = ( 3 / 5 , − 2 / 5 ) x^1=x^0-λ^0▽f(x^0)=(3/5,-2/5) x1=x0−λ0▽f(x0)=(3/5,−2/5)

重复上面的过程可以得到

x 2 = ( 3 / 5 2 , 2 / 5 2 ) x^2=(3/5^2,2/5^2) x2=(3/52,2/52)

通过总结可以得到 x k = ( 3 / 5 k , ( − 1 ) k 2 / 5 k ) x^k=(3/5^k,(-1)^k2/5^k) xk=(3/5k,(−1)k2/5k)

不断的迭代,直到

x k = ( 0 , 0 ) x^k=(0,0) xk=(0,0)为止

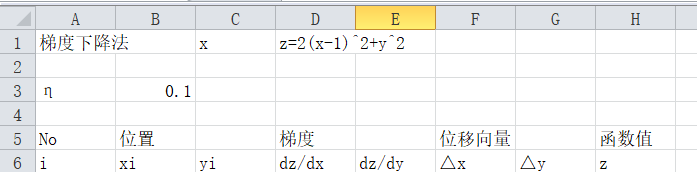

在Excel里用牛顿法、或者梯度下降法求解z=2(x-1)2+ y2

1.设置表格的一些基本内容

2.设置(x,y)的初始值为(2,1)

3.其他表格输入相应的计算公式

dz/dx=4*(x-1);dz/dy=2*y;△x=ηdz/dx; △y=ηdz/dy;

多次迭代结果

当学习率取0.1的时候,迭代2000多次依旧没有出现函数值为0的情况,更改学习率为0.15

结果:

由此可得到其近似值为(1,0),迭代多次才得到想要的结果。

线性回归的python求解

最小二乘法

代码

定义数据与设置参数

from sklearn import linear_model

#可以调用sklearn中的linear_model模块进行线性回归

import seaborn as sns

# 定义数据集的大小 即20个数据点

import numpy as np #导入numpy包

m = 20

# x的坐标以及对应的矩阵

X0 =np.ones((m, 1)) # 生成一个m行1列的向量,其值全是1

X1 =np.arange(1, m+1).reshape(m, 1) # 生成一个m行1列的向量,也就是x1,从1到m

X =np.hstack((X0, X1)) # 按照列堆叠形成数组,其实就是样本数据

# 对应的y坐标

Y = np.array([

3, 4, 5, 5, 2, 4, 7, 8, 11, 8, 12,

11, 13, 13, 16, 17, 18, 17, 19, 21

]).reshape(m, 1)

线性回归结果

#进行线性回归的求解

model = linear_model.LinearRegression()

model.fit(X1,Y)

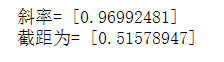

print("斜率=",model.coef_[0])

print("截距为=",model.intercept_)

代码执行结果

线性结果绘制

代码:

# 根据数据画出对应的图像

import matplotlib.pyplot as plt

def plot(X, Y, theta):

ax = plt.subplot(111) # 将画布分为1行1列,取第一个

ax.scatter(X, Y, s=30, c="blue", marker="s")

plt.xlabel("X")

plt.ylabel("Y")

x =np.arange(0, 21, 0.2) # x的范围

y = model.intercept_+ model.coef_[0]*x

ax.plot(x, y)

plt.show()

plot(X1, Y, model.coef_[0])

梯度下降

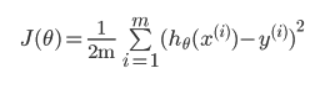

代价函数

2. 代码

定义数据及设置相关数值

from numpy import *

# 定义数据集的大小 即20个数据点

m = 20

# x的坐标以及对应的矩阵

X0 = ones((m, 1)) # 生成一个m行1列的向量,其值全是1

X1 = arange(1, m+1).reshape(m, 1) # 生成一个m行1列的向量,也就是x1,从1到m

X = hstack((X0, X1)) # 按照列堆叠形成数组,其实就是样本数据

# 对应的y坐标

Y = np.array([

3, 4, 5, 5, 2, 4, 7, 8, 11, 8, 12,

11, 13, 13, 16, 17, 18, 17, 19, 21

]).reshape(m, 1)

# 学习率

alpha = 0.01

import matplotlib.pyplot as plt

#绘制出数据集

plt.scatter(X1,Y,color='red')

plt.show()

结果

代价函数定义及代价函数的梯度函数

# 定义代价函数

#损失函数(loss function)或代价函数(cost function)是将随机事件或其有关随机变量的取值映射为非负实数以表示该随机事件的“风险”或“损失”的函数

def cost_function(theta, X, Y):

diff = dot(X, theta) - Y # dot() 数组需要像矩阵那样相乘,就需要用到dot()

return (1/(2*m)) * dot(diff.transpose(), diff)

# 定义代价函数对应的梯度函数

def gradient_function(theta, X, Y):

diff = dot(X, theta) - Y

return (1/m) * dot(X.transpose(), diff)

梯度下降迭代

# 梯度下降迭代

def gradient_descent(X, Y, alpha):

#将[1,1]变为2行1列的形式

theta = array([1, 1]).reshape(2, 1)

#得到代价函数的初始梯度

gradient = gradient_function(theta, X, Y)

#不断迭代的过程

while not all(abs(gradient) <= 1e-5):

#更新迭代公式

theta = theta - alpha * gradient

#更新迭代所用的梯度

gradient = gradient_function(theta, X, Y)

return theta

#梯度下降最终的结果

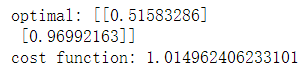

optimal = gradient_descent(X, Y, alpha)

print('optimal:', optimal)

print('cost function:', cost_function(optimal, X, Y)[0][0])

线性结果绘制

# 根据数据画出对应的图像

def plot(X, Y, theta):

ax = plt.subplot(111) # 将画布分为1行1列,取第一个

ax.scatter(X, Y, s=30, c="red", marker="s")

plt.xlabel("X")

plt.ylabel("Y")

x = arange(0, 21, 0.2) # x的范围

y = theta[0] + theta[1]*x

ax.plot(x, y)

plt.show()

plot(X1, Y, optimal)

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?