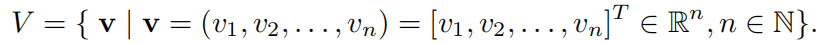

The PCA is based on the statistical representation of a random variable. Suppose we have a finite set of data vectors V , where

主成分分析是基于一个随机变量的统计表示法进行的。假设我们有一个有限的数据向量的V集,其中

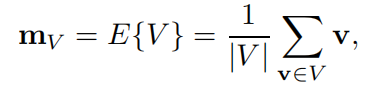

Let mV be the mean of the set V

设mV为集合V的平均值

where |V | denotes the number of elements of the set V (i.e., the cardinal number).

其中,|V|表示集合V的元素数(即基数)。

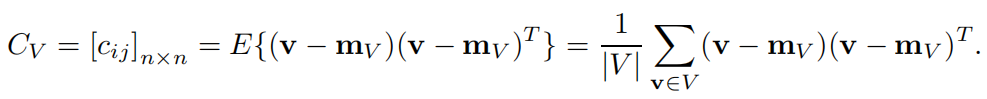

The associated covariance matrix of the same data set is given by

同一数据集的相关协方差矩阵由

Matrix CV is, by definition, symmetric real matrix with non-negative elements.

根据定义,矩阵CV是具有非负元素的对称实矩阵。

Elements cij (i 6 = j) represent the covariances between the components vi and vj (3.2).

元素cij(i6=j)表示组件vi和vj(3.2)之间的协方差。

If two components vi and vj of the data are uncorrelated, then their covariance is zero (cij = cji = 0).

如果数据的两个组件vi和vj不相关,那么它们之间的协方差为零(cij=cji=0)。

The element cii represents the variance of the component vi, which indicates the spread of the component values around its mean

value.

元素cii表示分量vi的方差,表示分量值在其平均值周围的分布。

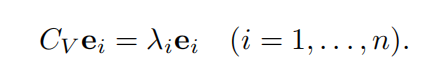

Eigenvalues and eigenvectors of the covariance matrix are used to form an orthonormal basis of the space Rn.

利用协方差矩阵的特征值和特征向量形成了空间Rn的标准正交基。

We recall that the eigenvectors ei (||ei|| = 1)and the corresponding eigenvalues λi are the solutions of equations

我们还记得,特征向量ei(||ei||=1)和相应的特征值λi是方程式的解

We stress that in the case of a symmetric non-negative matrix all eigenvalues are non-negative real numbers.

我们强调,在对称非负矩阵的情况下,所有特征值都是非负实数。

By ordering the eigenvectors according to the order of descending eigenvalues, we obtain an orthonormal basis with the first eigenvector coinciding with the direction of largest variance of the set V (3.2).

通过根据特征值的降序对特征向量进行排序,得到了一个第一个特征向量与集合V(3.2)最大方差方向一致的标准正交基。

Directions of largest variance are usually regarded as directions in which the original data set possesses the most significant amounts of energy.

方差最大的方向通常被认为是原始数据集具有最显著能量的方向。

Let A be a matrix consisting of ordered eigenvectors of the covariance matrix as the row vectors.

设A是一个由协方差矩阵的有序特征向量作为行向量组成的矩阵。

The ordered eigenvectors can be seen as basis of a new coordinate frame with the origin placed at the point mV .

有序特征向量可以看作是一个新的坐标系的原点的基础。

We regard the new coordinate

system as the PCA coordinate system (frame). A data vector v

original system is transformed into the vector p in the PCA frame,

我们将新的坐标系作为PCA坐标系(坐标系)。将数据向量v原始系统转换为PCA框架中的向量p,

特征值与方差成正比

特征值大于等于0

归一化之后距离原点最远的点在正半轴

平移和旋转的标准化

双三角形检查也可以在多边形模型中找到相同的三角形。这些三角形被认为具有相同的顶点,但在三维模型文件中以不同的顺序出现(例如,具有顶点索引(10,422,87)和(422,10,87)的三角形是相同的)。

我们在第4节中测试的3D模型数据集中发现了大量这样的三角形。当呈现一个三维模型时,这些三角形不能被识别出来,但如果考虑到它们,它们可能会影响模型的平移、旋转和尺度归一化。

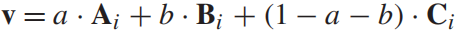

三角面上的点可以表示为:

重心坐标m等于:

为了缓解旋转不变性问题,我们并行地应用了两种可替代的对齐方法。在第一个过程中,我们使用CPCA来计算模型曲面的

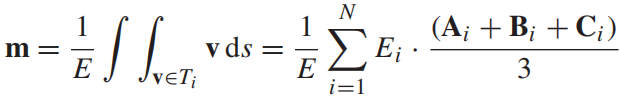

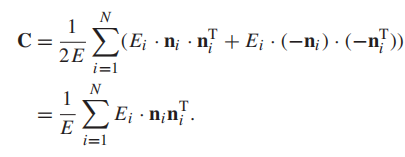

计算协方差矩阵C的两种方法:

方法1:(CPCA)

注:求协方差矩阵时三个顶点与中点的比值为: 1:1:1:9

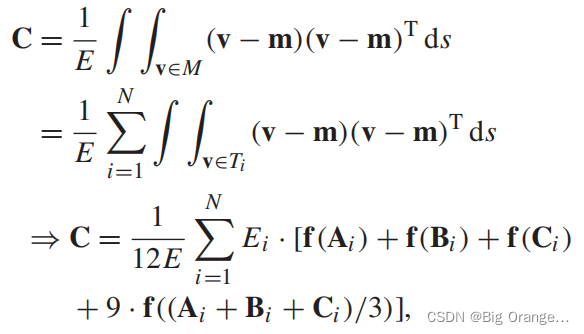

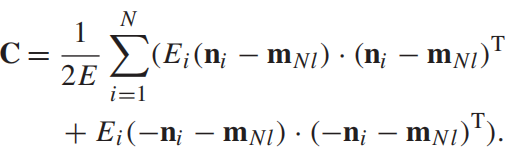

方法2:(NPCA)

n为三角形的法向量

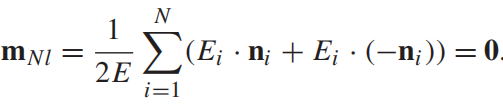

m为平均面法向量,则协方差矩阵计算为

每个三角形被计算两次,使用其法线和与法线方向相反。

这样做是为了避免模型三角形上顶点顺序的可能变化,这将影响方向的符号,而且因为我们可以假设每个三角形都有两个方向相反的边:

单位法向量的终点在球面上

有一个问题NPCA如何求朝向?

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?