📌 扩散模型:视觉AI的新引擎

- 扩散模型正在彻底改变低级视觉任务的处理方式

- 我们精选了4个GitHub开源项目,涵盖超分辨率、低光照增强和恶劣天气图像恢复

- 所有项目均提供完整源码和预训练模型,可直接部署使用

- 无论你是研究人员还是开发者,这些资源都将极大加速你的项目进展

还在用传统方法做图像增强?或许你该换换思路了!扩散模型(Diffusion Models)正在计算机视觉领域掀起一场静悄悄的革命,尤其在那些我们称为"低级视觉任务"的基础图像处理中表现惊艳。

"扩散模型不仅改变了我们生成图像的方式,更正在重塑整个视觉处理流程。" —— 某顶级AI研究机构研究员

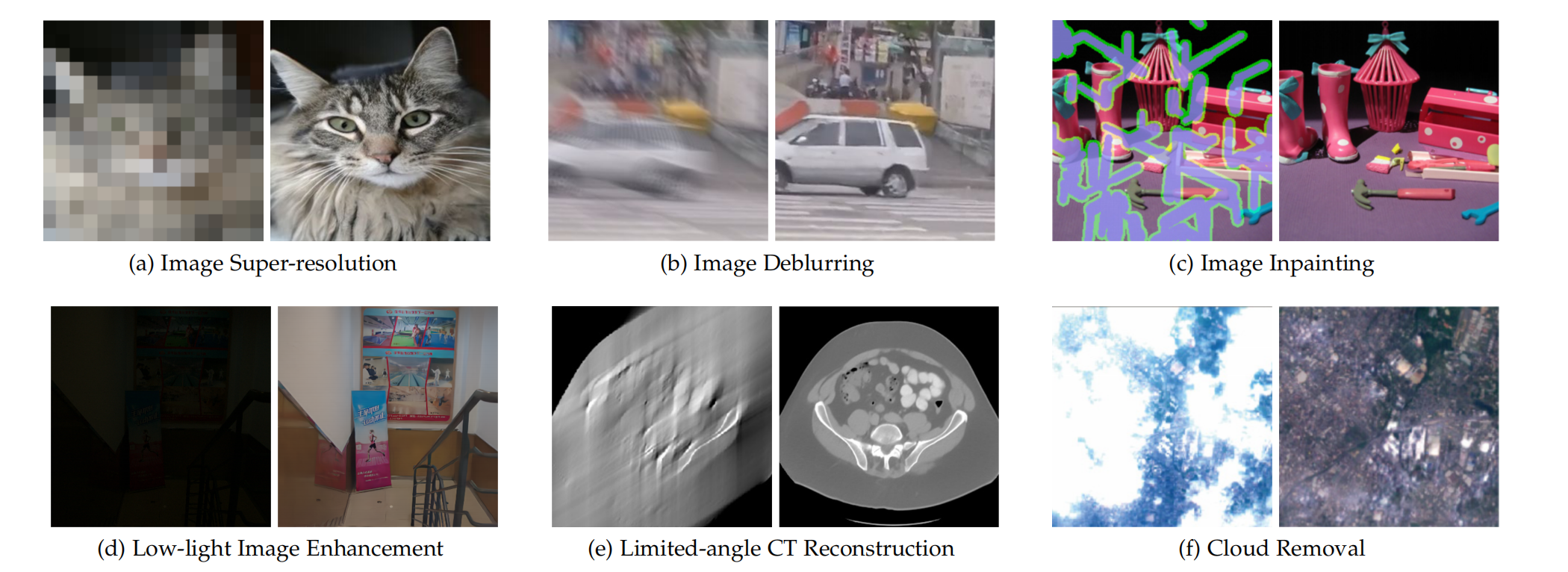

什么是低级视觉任务?

低级视觉任务专注于像素级别的图像处理,目标是增强或恢复图像质量,而非理解图像内容。这些任务包括:

- 超分辨率:将低分辨率图像转换为高清版本

- 去模糊:消除运动或对焦不准导致的模糊

- 去雾/去雨/去雪:移除恶劣天气造成的图像失真

- 低光照增强:让黑漆漆的夜景照片重现光明

- 图像修复:填补破损或缺失的图像区域

- 图像融合:将多张图像无缝合成一张

这些看似简单的任务实际上是许多高级应用的基石,从医疗影像分析到自动驾驶,从卫星图像处理到智能手机摄影,无处不在。

扩散模型:噪声中重生的艺术

扩散模型的工作方式堪称神奇,它们通过两个关键步骤完成任务:

- 正向扩散:系统地向图像添加噪声,直到图像变得完全随机

- 反向去噪:学习如何逐步移除噪声,恢复出原始图像

这种看似复杂的过程赋予了扩散模型惊人的能力,使其能够生成高度逼真的图像,或者将受损图像恢复至原本应有的样子。

💡 五个改变游戏规则的GitHub开源项目

1. StableSR:让超分辨率更稳定

GitHub: GitHub - IceClear/StableSR: [IJCV2024] Exploiting Diffusion Prior for Real-World Image Super-Resolution

⭐ 星标: 1.9k

为什么值得关注?

StableSR不仅仅是另一个超分辨率工具,它利用预训练的文本到图像扩散模型作为先验知识,大幅提升了生成能力。最令人印象深刻的是,它能处理"盲超分辨率"任务——即在不知道图像具体降质过程的情况下进行恢复。

实用亮点:

- 全面的模型库:提供多种预训练权重,适应不同场景

- 详尽的文档:从安装到高级使用,一应俱全

- 优化的性能:在消费级GPU上也能高效运行

谁在用?

多个图像编辑和增强工具已经整合了StableSR,无论是摄影爱好者还是视觉内容创作者,都能从中受益。1.9k的GitHub星标证明了它在社区中的影响力。

2. SR3:学术界的超分新星

GitHub: GitHub - novwaul/SR3: Super Resolution with Diffusion Probabilistic Model

引用数: 1.2k

技术突破:

SR3基于DDPM(去噪扩散概率模型)框架,专为超分辨率任务设计。它在学术界拥有1.2k次引用,影响力不言而喻。

适用场景:

- 研究探索:深入了解扩散模型的原理和实现

- 基准测试:作为评估新方法的比较基准

- 教育目的:学习扩散模型在图像处理中的应用

这是超分辨率领域的经典之作,GitHub仓库提供了完整的模型实现和实验代码,是学术探索的绝佳起点。

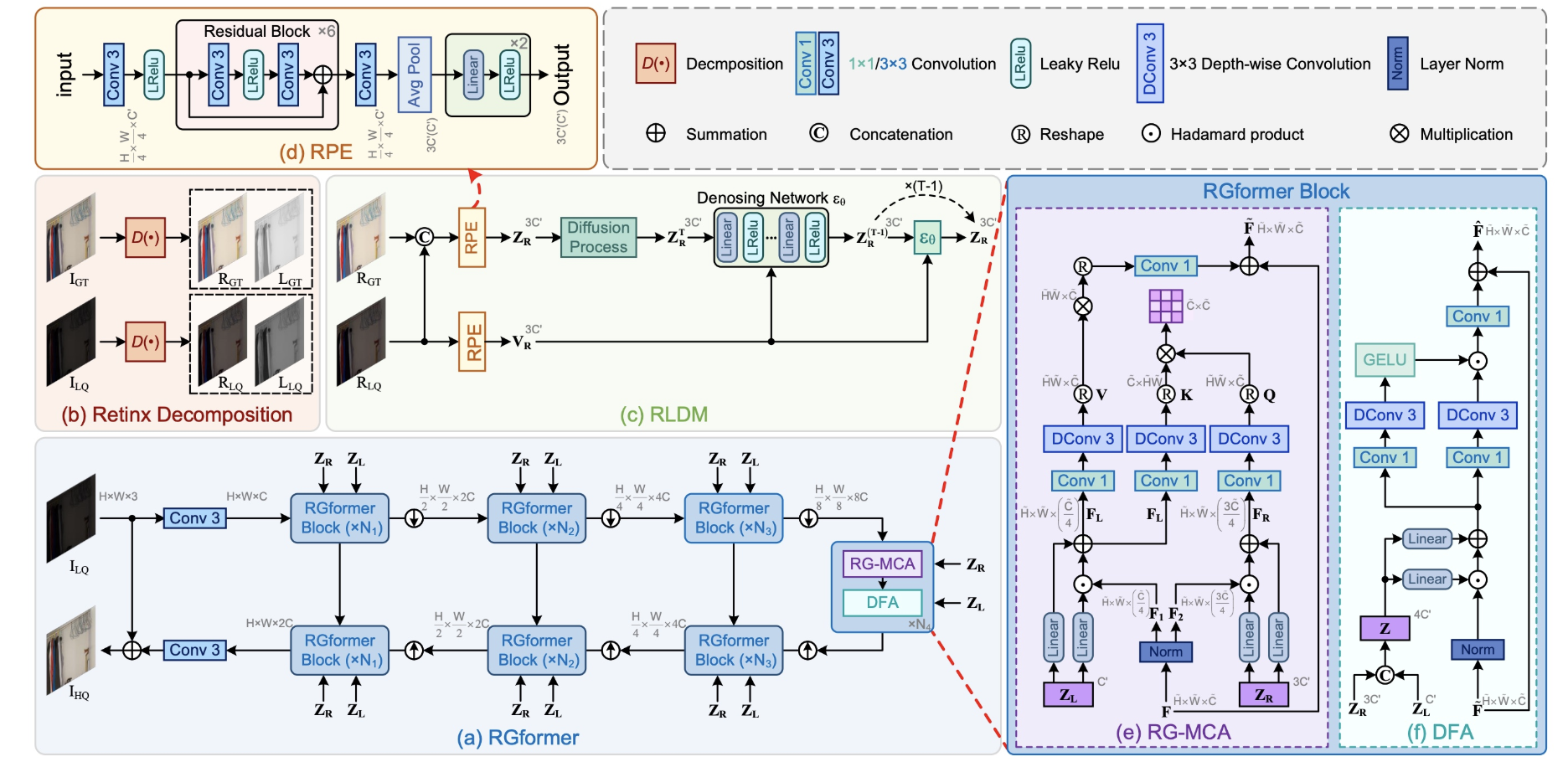

3. Reti-Diff:暗处也要看得清

创新亮点:

Reti-Diff结合了传统的Retinex理论和现代的扩散模型,将图像分解为光照和反射图,从而实现更自然的低光照增强效果。

技术优势:

- 参数优化:模型轻量化,适合资源受限场景

- 高效率:计算量经过精心设计,速度更快

- 自适应:能处理各种复杂的低光环境

应用前景:

这个项目特别适合夜间监控、移动设备摄影和其他低光照场景。轻量级设计使其非常适合嵌入到摄影应用或安防系统中。

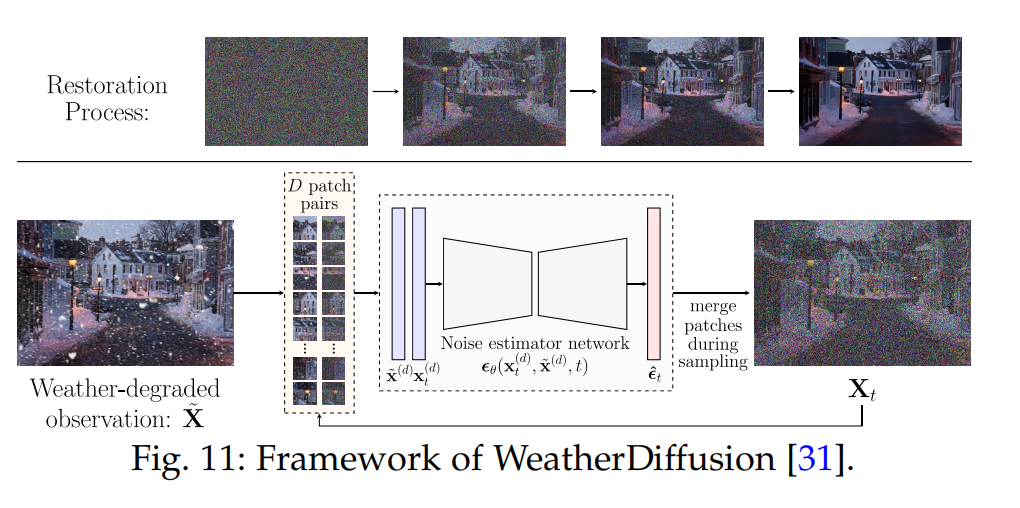

4. WeatherDiffusion:告别恶劣天气的困扰

GitHub链接: WeatherDiffusion

全能天气处理:

WeatherDiffusion基于补丁式去噪扩散模型,专门处理恶劣天气影响下的图像恢复,一个模型搞定多种天气问题:

- 去雪:基于Snow100K数据集训练

- 去雨和去雾:使用Outdoor-Rain数据集

- 去除雨滴:专门处理RainDrop数据集中的场景

实用价值:

这个项目对于户外摄影、视频监控和自动驾驶等领域具有极高的应用价值,能在极端天气条件下保障视觉系统的可靠性。

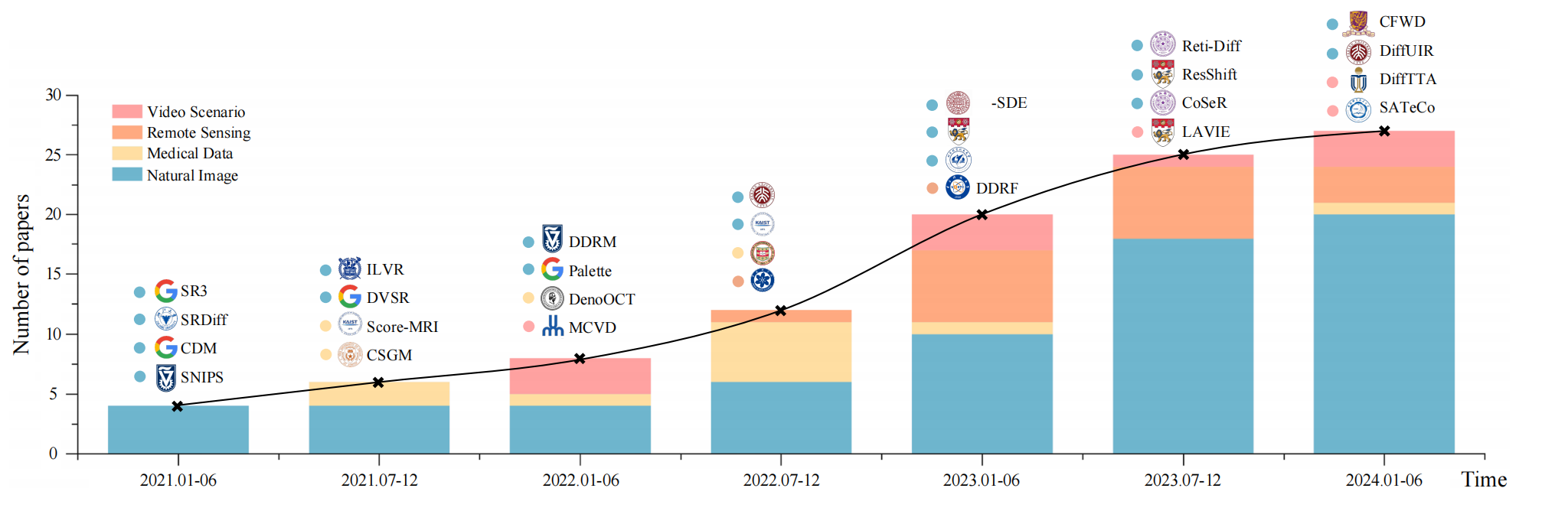

🔮 未来展望:扩散模型的无限可能

这些开源项目仅仅是扩散模型在低级视觉任务中应用的开始。随着技术的发展,我们可以期待:

- 实时处理能力的提升,使扩散模型能够应用于视频流

- 移动端优化,让这些强大的模型在智能手机上运行

- 多模态融合,结合文本指导、深度信息等多种输入

- 领域特化模型的出现,针对医疗、遥感等特定场景进行优化

⚡ 立即行动:从代码到应用

想要将这些强大的技术应用到自己的项目中?这里是快速上手的步骤:

- 选择适合的项目:根据你的需求(超分辨率、低光照增强或天气去除)

- 克隆代码库:使用

git clone命令获取代码 - 安装依赖:通常使用

pip install -r requirements.txt - 下载预训练模型:按照项目README中的指导获取模型权重

- 开始处理:使用示例脚本测试你自己的图像

# 以StableSR为例的简单使用代码

import torch

from models import StableSR

model = StableSR.from_pretrained('stablesr_x4')

input_image = load_image('low_res.png')

with torch.no_grad():

output = model(input_image)

save_image(output, 'enhanced.png')💬 加入讨论:分享你的经验

你有使用扩散模型处理低级视觉任务的经验吗?或者你对这些开源项目有什么问题?欢迎在评论区分享你的想法和经验!

如果这篇文章对你有帮助,别忘了点赞、收藏和分享,让更多人了解这些强大的开源工具!

777

777

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?