注意力机制,自注意力机制学习笔记

1.自主性和非自主性

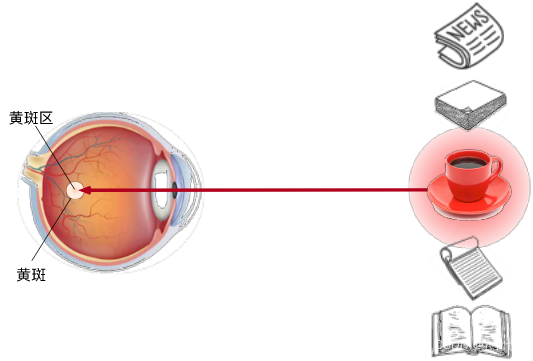

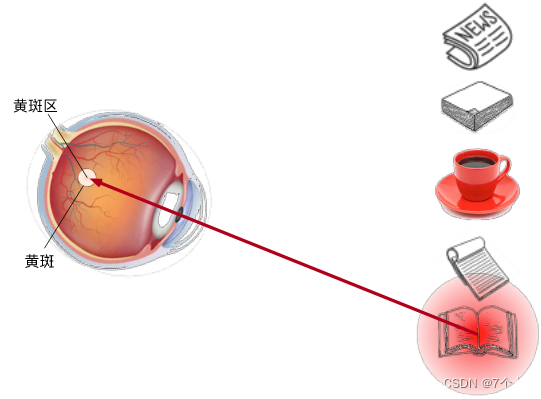

双组件(two-component)的框架受试者基于非自主性提示和自主性提示 有选择地引导注意力的焦点。

自主性和非自主性或者称随意性和非随意性,这里的随意不是指随随便便而是刻意的意思.

- 非自主性提示是基于环境中物体的突出性和易见性,由于突出性的非自主性提示(红杯子),注意力不自主地指向了咖啡杯。

- 自主性是受到了认知和意识的控制,依赖于任务的意志提示(想读一本书),注意力被自主引导到书上。

2.在神经网络上的应用

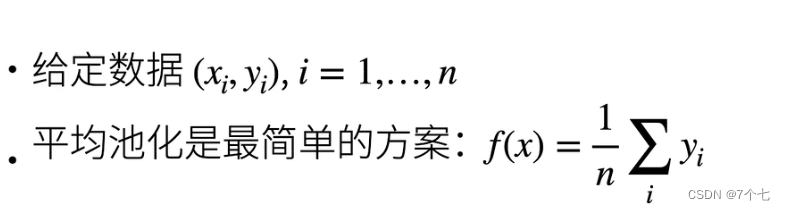

只使用非自主性提示情况下,要想将选择偏向于感官输入, 则可以简单地使用参数化的全连接层, 甚至是非参数化的最大汇聚层或平均汇聚层。

所以是否包含自主性提示”将注意力机制与全连接层或汇聚层区别开来

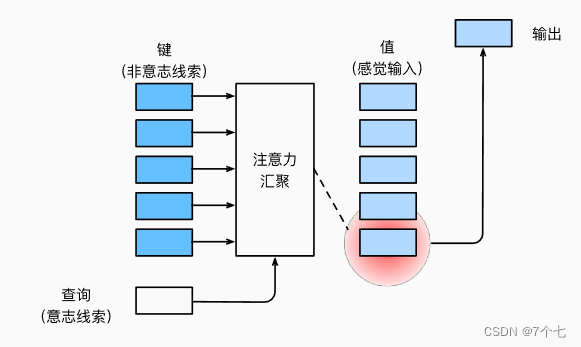

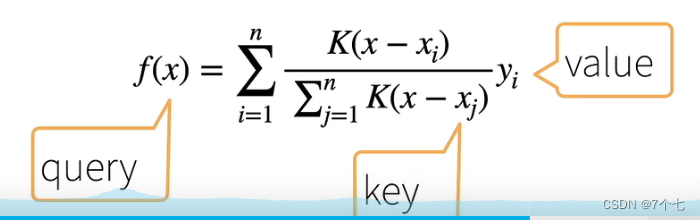

在注意力机制的背景下,自主性提示被称为查询(query)。 给定任何查询,注意力机制通过注意力汇聚(注意力池化层 attention pooling) 将选择引导至感官输入(sensory inputs,例如中间特征表示)。 在注意力机制中,这些感官输入被称为值(value)。 更通俗的解释,每个值都与一个键(key)配对, 这可以想象为感官输入的非自主提示。通过注意力池化层来有偏向性的选择某一些输入。

3.注意力汇聚(注意力池化层):Nadaraya-Watson 核回归

对于很久很久前

显然这里忽略了Xi,这里有更好方案–60年代Nadaraya-Watson 核回归

K是用来衡量X和Xi距离的函数,对这里的公式理解是对于候选的每个Xi,根据X和Xi相差的多少来分配权重,用权重来乘上各自对应的yi,也就是个求个期望。

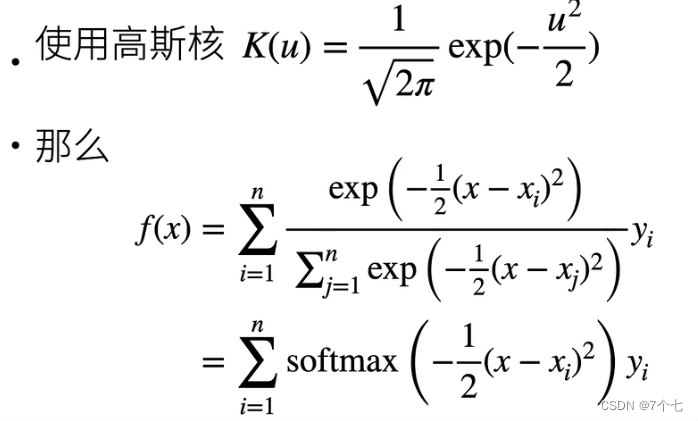

例如如果是使用高斯核

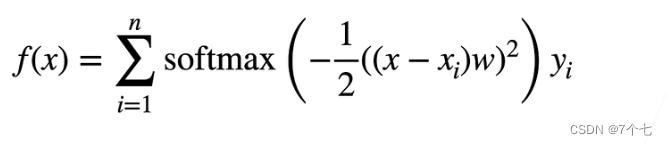

我们可以再此基础上加入一个可以学习的参数w,也就是对于权重分配进行可学习化

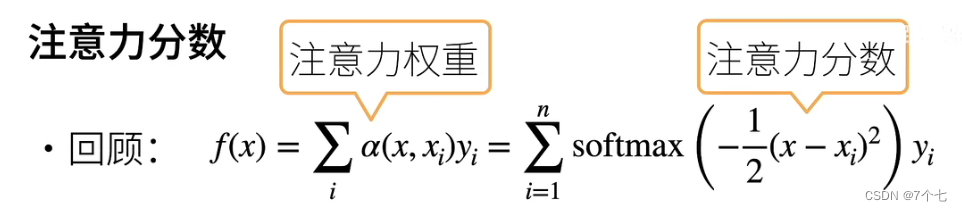

4.注意力分数

上述中用到了高斯核来对查询和键之间的关系建模,高斯核指数部分可以视为注意力评分函数(attention scoring function), 简称注意力分数, 然后把这个函数的输出结果输入到softmax函数中进行运算。 通过上述步骤,将得到与键对应的值的概率分布(即注意力权重)。 最后,注意力汇聚的输出就是基于这些注意力权重的值的加权和

注意力分数代表了key和quiry的相关性,对于key和quiry的相同长度和不同长度一般如下处理

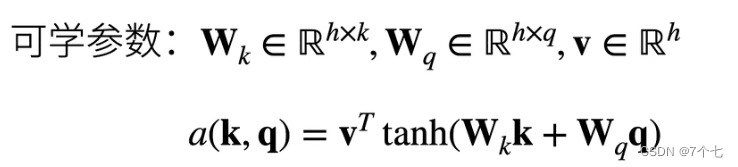

4.1加性注意力

一般来说,当查询和键是不同长度的矢量时,可以使用加性注意力

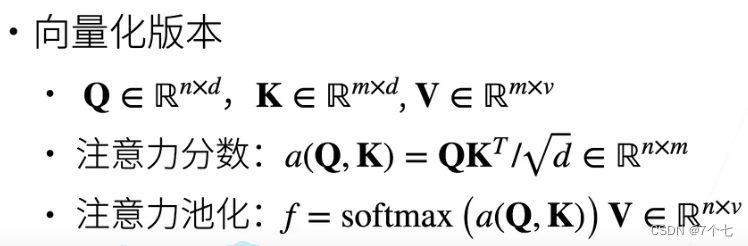

4.2 缩放点积注意力

当查询和键是相同长度的矢量时,用query和key做内积更有效率(内积越大相关性越强)

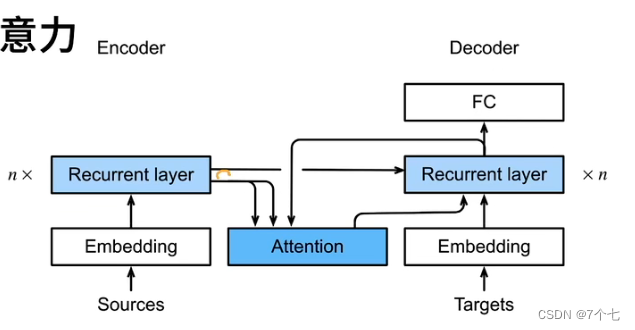

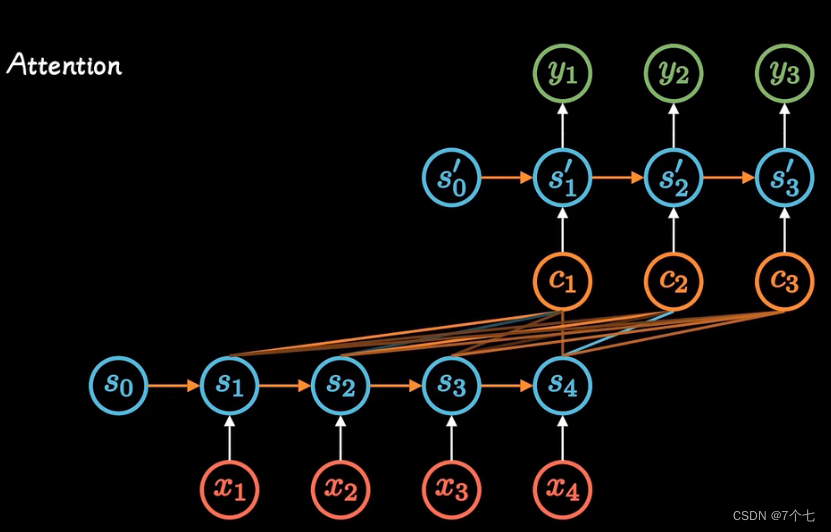

使用注意力机制的seq2seq

编码器对每一个词的输出当做key和value(这里key==value),解码器中对上一个次的输入是query,加入attention池化层

每一个C1有各个词加权和组成,权重由学习得出

自注意力机制

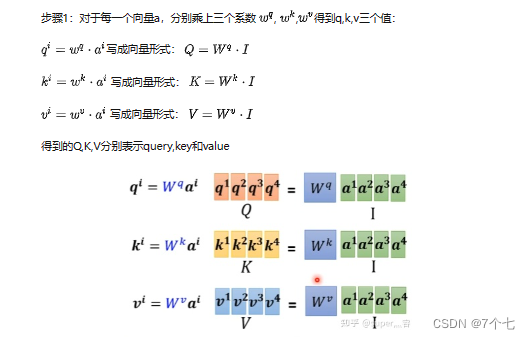

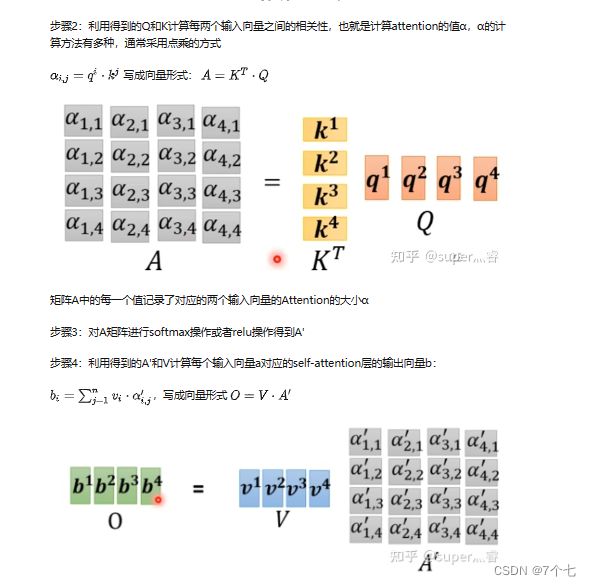

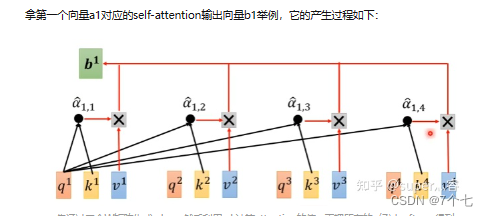

随着GPU的发展,RNN并行程度低的弱点也逐渐明显。在上述问题attention机制其实已经对输入xi进行打分。我们可以实际上可以简化掉RNN状态传递。也就是说对于每个xi,querry

≈

\approx

≈xi,key

≈

\approx

≈xi,value

≈

\approx

≈xi。查询和键是相同长度,则注意力分数用query和key做内积来评价。例如x1和x1,x2…xn做内积来分配权重乘上各自对应的value(xi)得到y1,这里要提前加入一个权重矩阵进行变化,这也是为什么querry

≈

\approx

≈xi。

由于GPU可以并行处理,我们可以将上述一系列操作做化为矩阵运行

自注意力机制中为什么要加入wq,wk,wv?

个人理解是对于每一个词向量是有许多特征构成,当我们根据特征相似度来对各个词向量进行权重分配前我们应该考虑下游任务来对词向量中的特征进行 选取,混合或其他操作(没必要都是取全部特征),所以先乘上一个wq,wk,wv进行投影选出下游任务实际需要的特征来进行分配权重。

另一个角度上来说,加入wq,wk,wv是为了权重分配可学习化。

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?