集成模型:集成多个模型的能力,得到比单一模型更佳的效果。

为什么集成方法通常能够达到比单一模型更好的性能?

1.增强模型的表达能力:单个感知机模型无法正确分类数据,集成三个感知机模型能正确分类数据

2.降低误差:

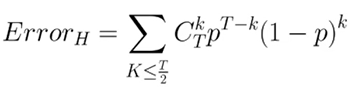

假设单个分类器误差p,分类器之间独立,T个分类器采用投票进行预测,得到集成模型H,集成分类器误差为

T=0.5,p=0.1,ErrorH<0.01。

基模型集成策略:

多数投票方法(majority vote)

平均(averaging)

加权平均(weighted averaging)

典型的集成方法:

Bagging:

对样本或特征随机取样,学习产生多个独立的模型,然后平均所有模型的预测值。主要减小方差,典型代表随机森林

Boosting:

串行训练多个模型,后面的模型是基于前面模型的训练结果(误差),主要减小偏差,典型代表是AdaBoost

2732

2732

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?