Pytorch 深度学习实践(3)

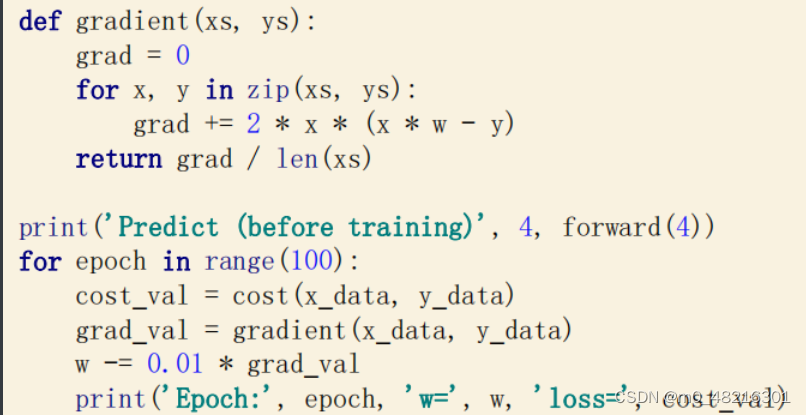

1.梯度下降

如果使用梯度下降训练失败,大概率是学习率太大

问题:计算梯度时,计算整个样本的平均梯度,有可能在鞍点(局部最小值)就停止学习

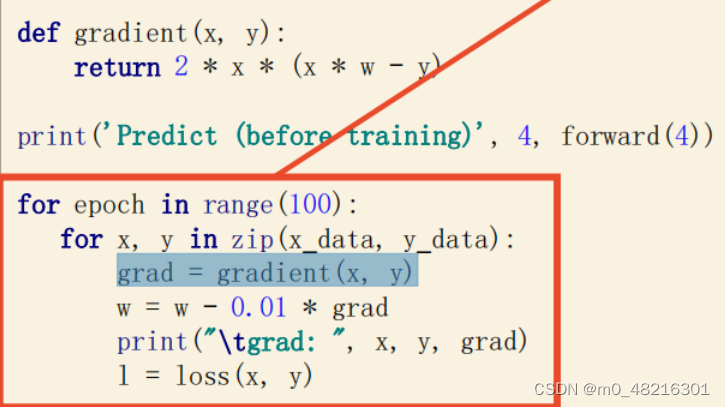

2.随机梯度下降

每个样本计算权重时,是根据上一个样本方向传播算出来的梯度,存在依赖关系。性能较好,更容易找最优解

3.深度学习的折中方案

问题:

(1)使用梯度下降法,需要计算所有样本的平均梯度,然后使用这个平均梯度进行梯度下降

这也就意味着我计算Xi 和 Xi+1 可以并行, 因为他们的梯度下降不存在依赖关系

(2)随机梯度下降虽然性能好,但是他计算每个样本梯度下降时,是使用的上一个样本的梯度,存在依赖关系,无法并行计算

折中方案:使用mini-batch 小批量梯度下降

5万+

5万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?