文章目录

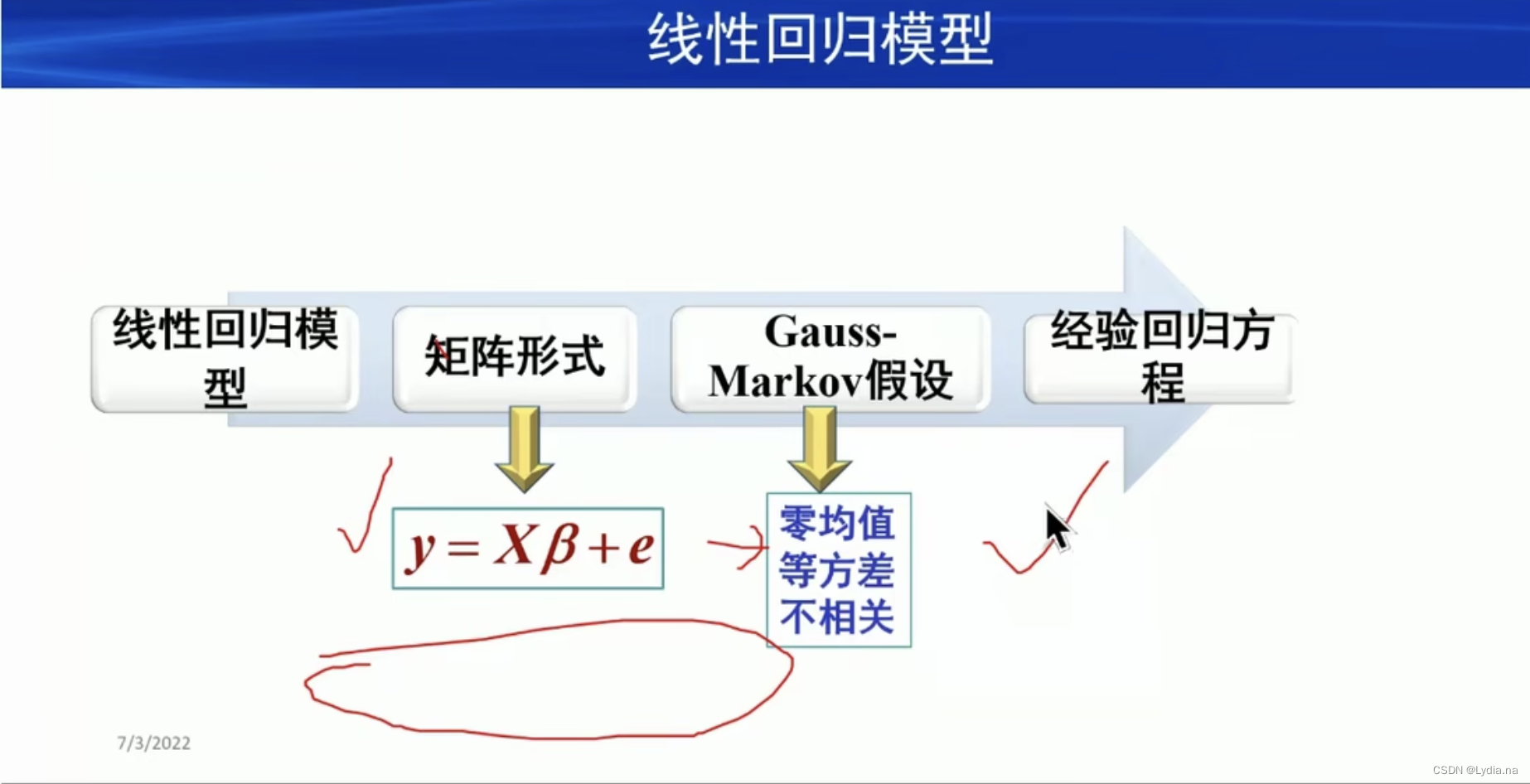

线性回归

简单线性回归、多重线性回归

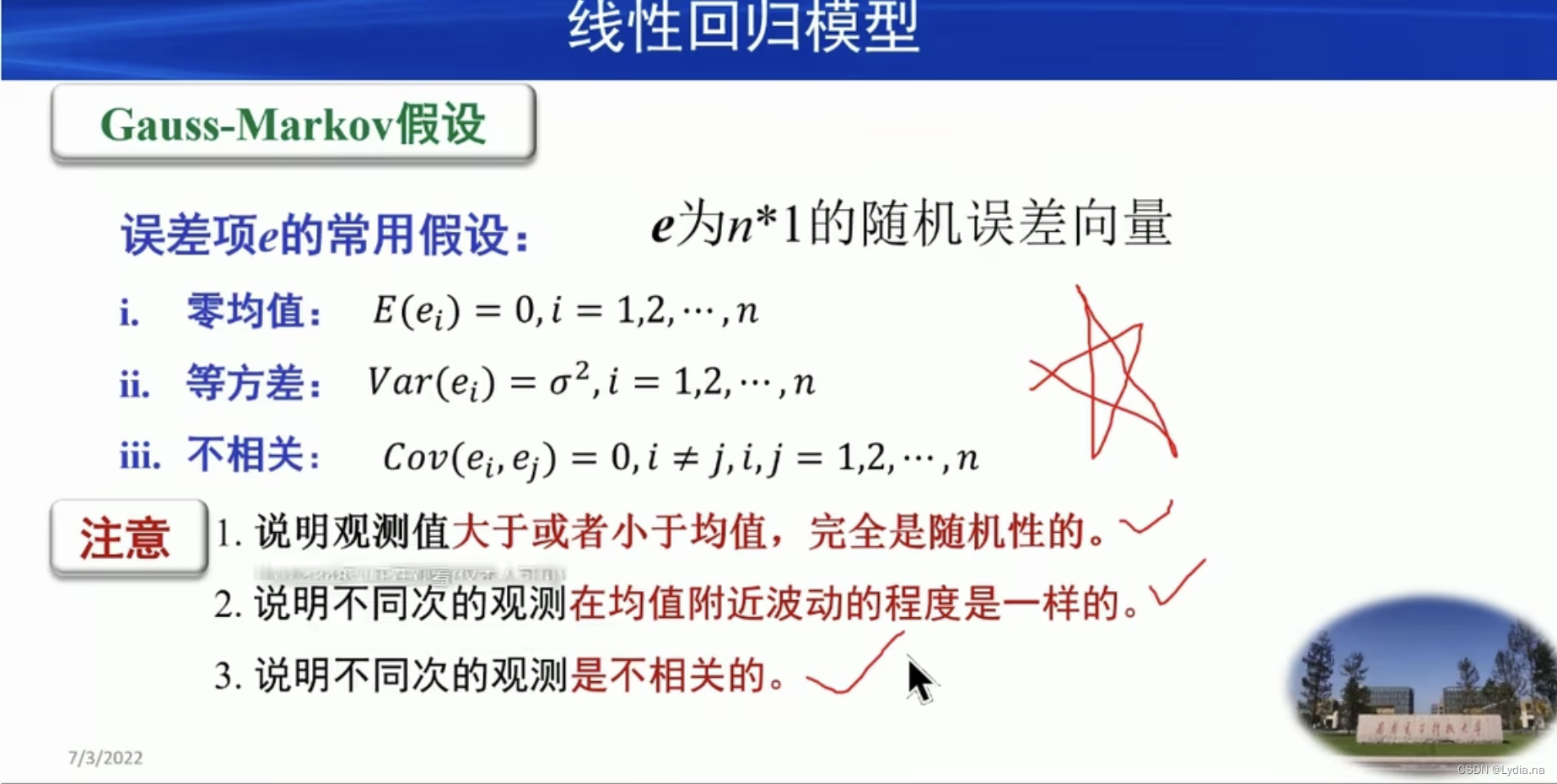

线性回归的前提条件:

- 线性(散点图、散点图矩阵)

- 独立性(DW)

- 正态性(回归分析的过程中可以检验)

- 方差齐性(回归分析的过程中可以检验)

数据处理

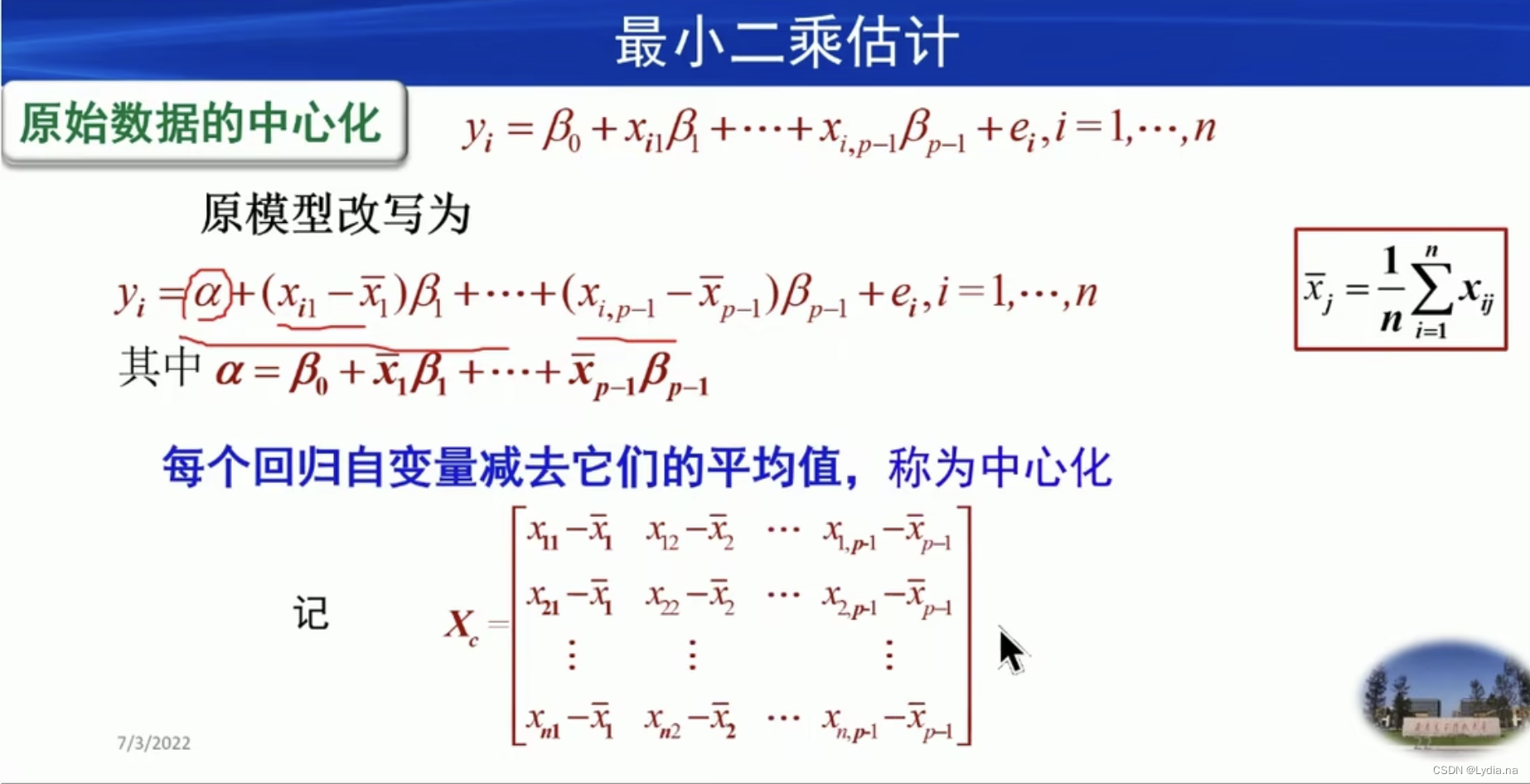

原始数据的中心化

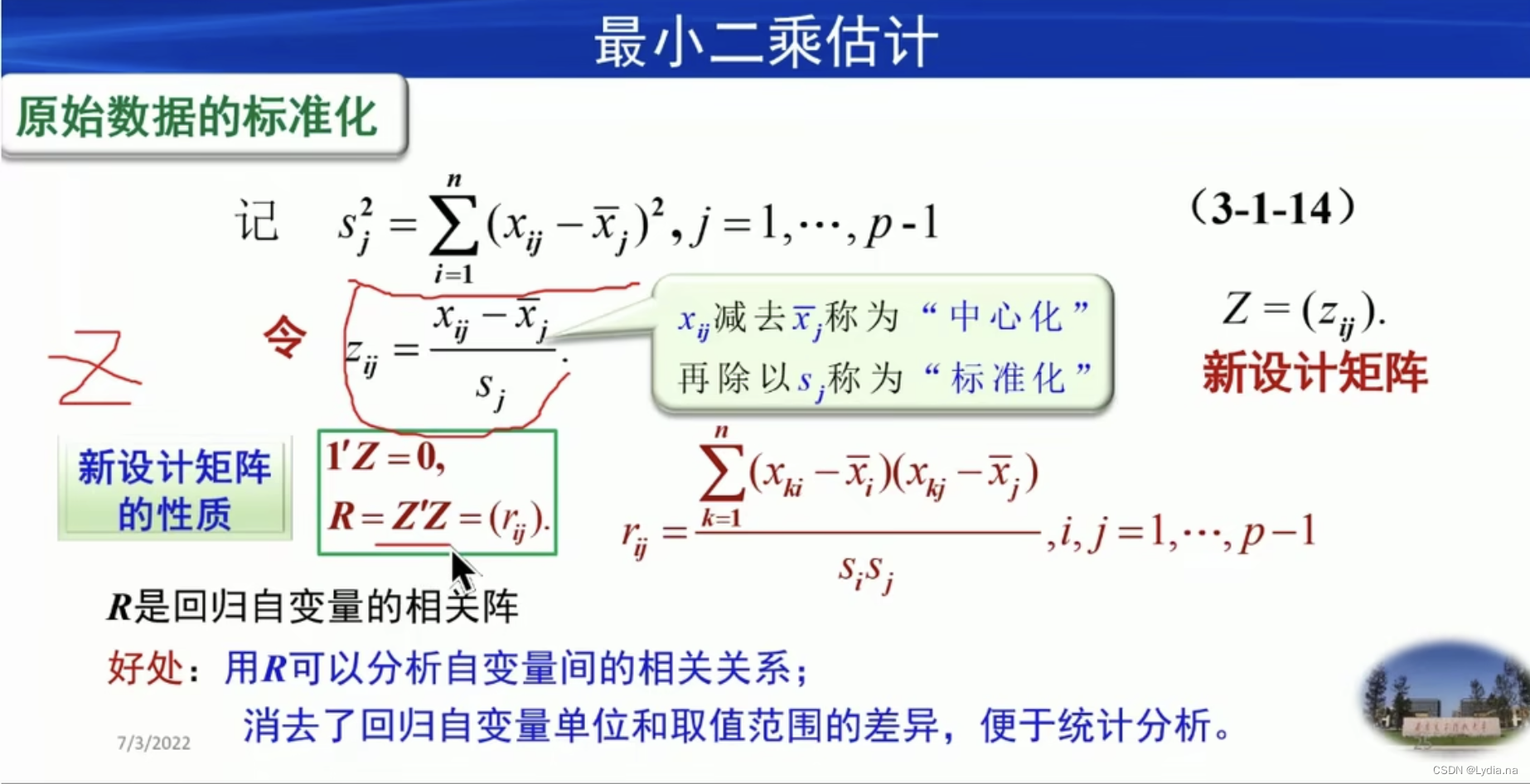

原始数据的标准化

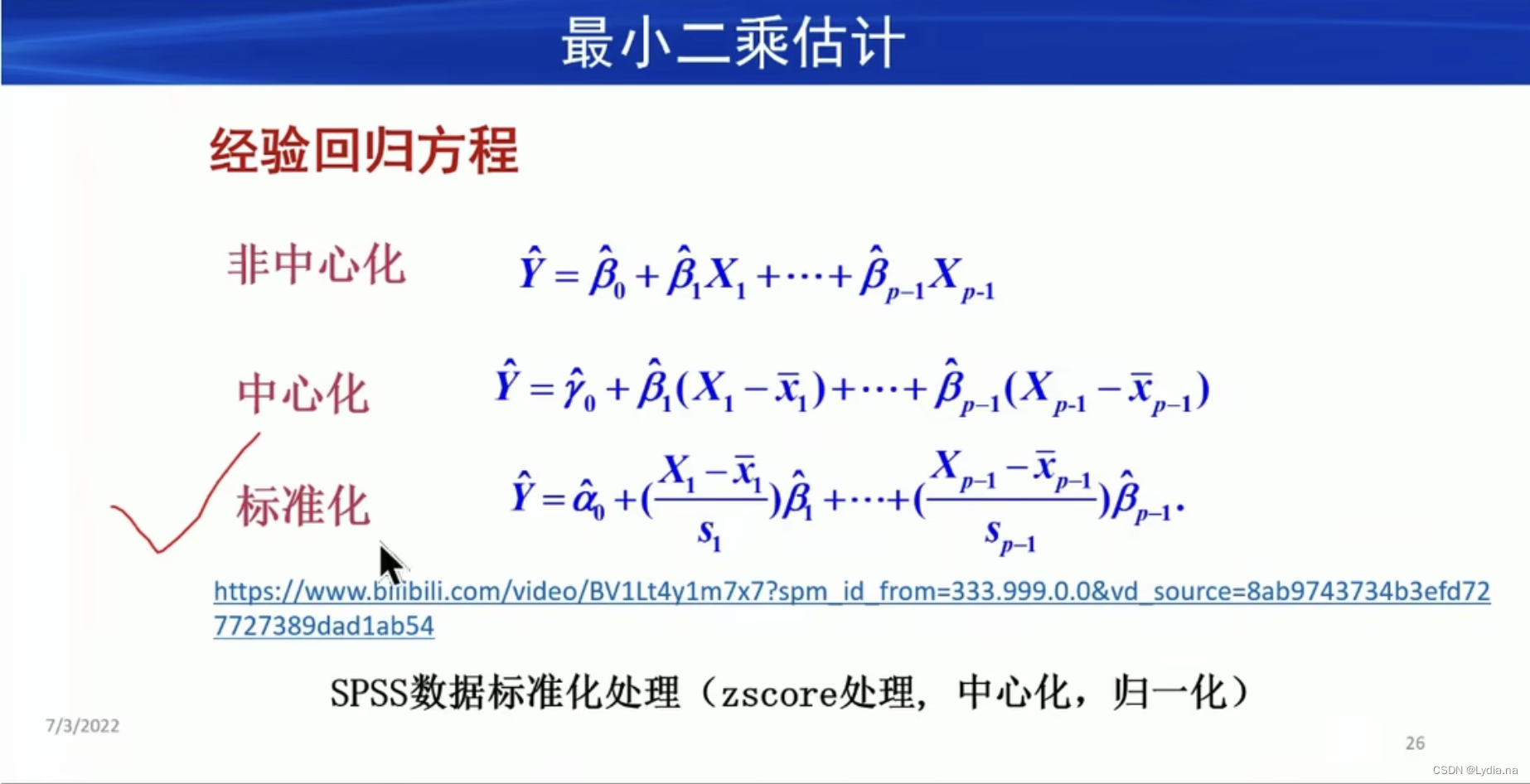

对于经验回归方程进行非中心化、中心化、标准化

step1 确定经验回归模型

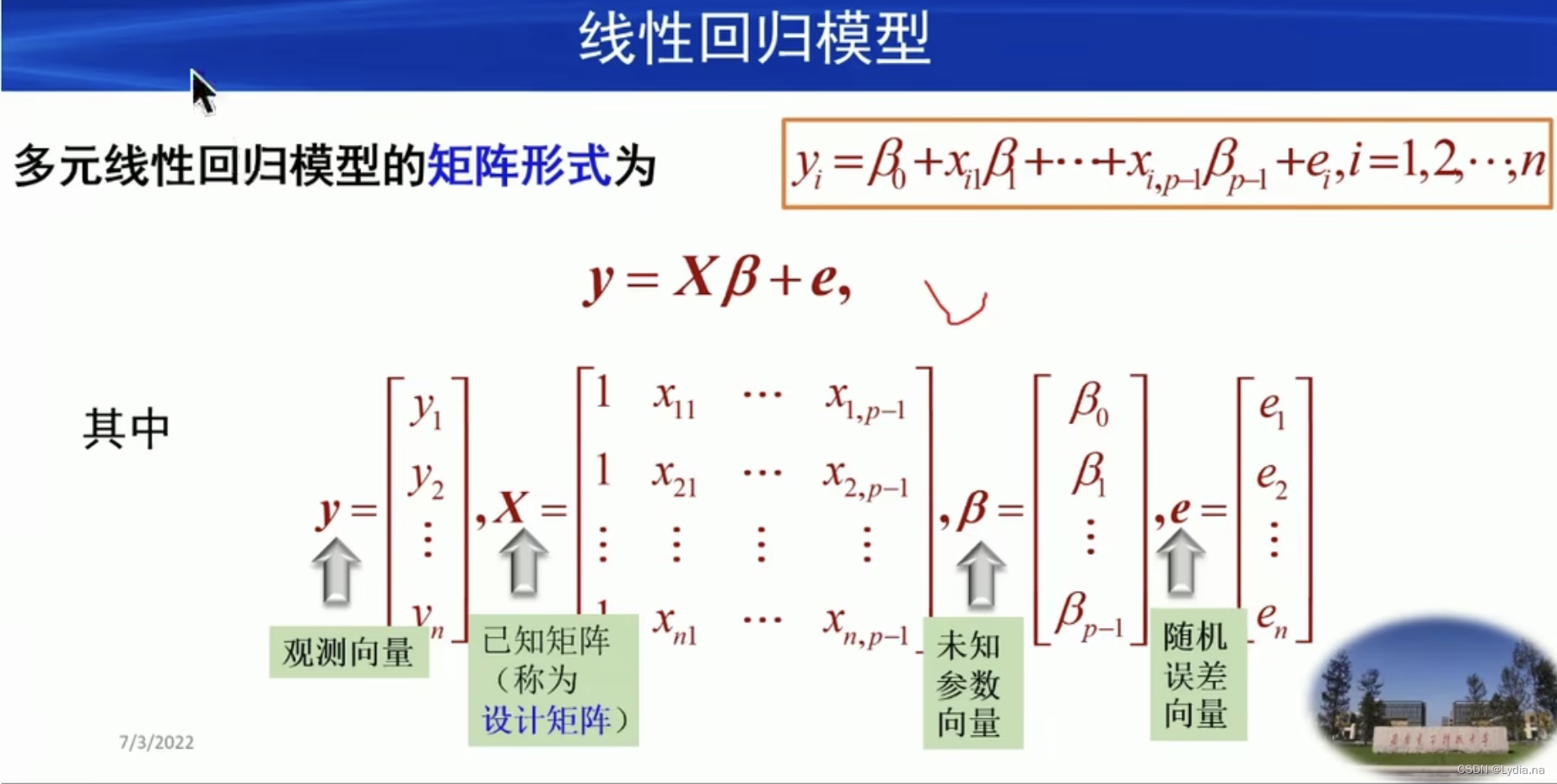

以多元线性回归模型为例

-

确定模型

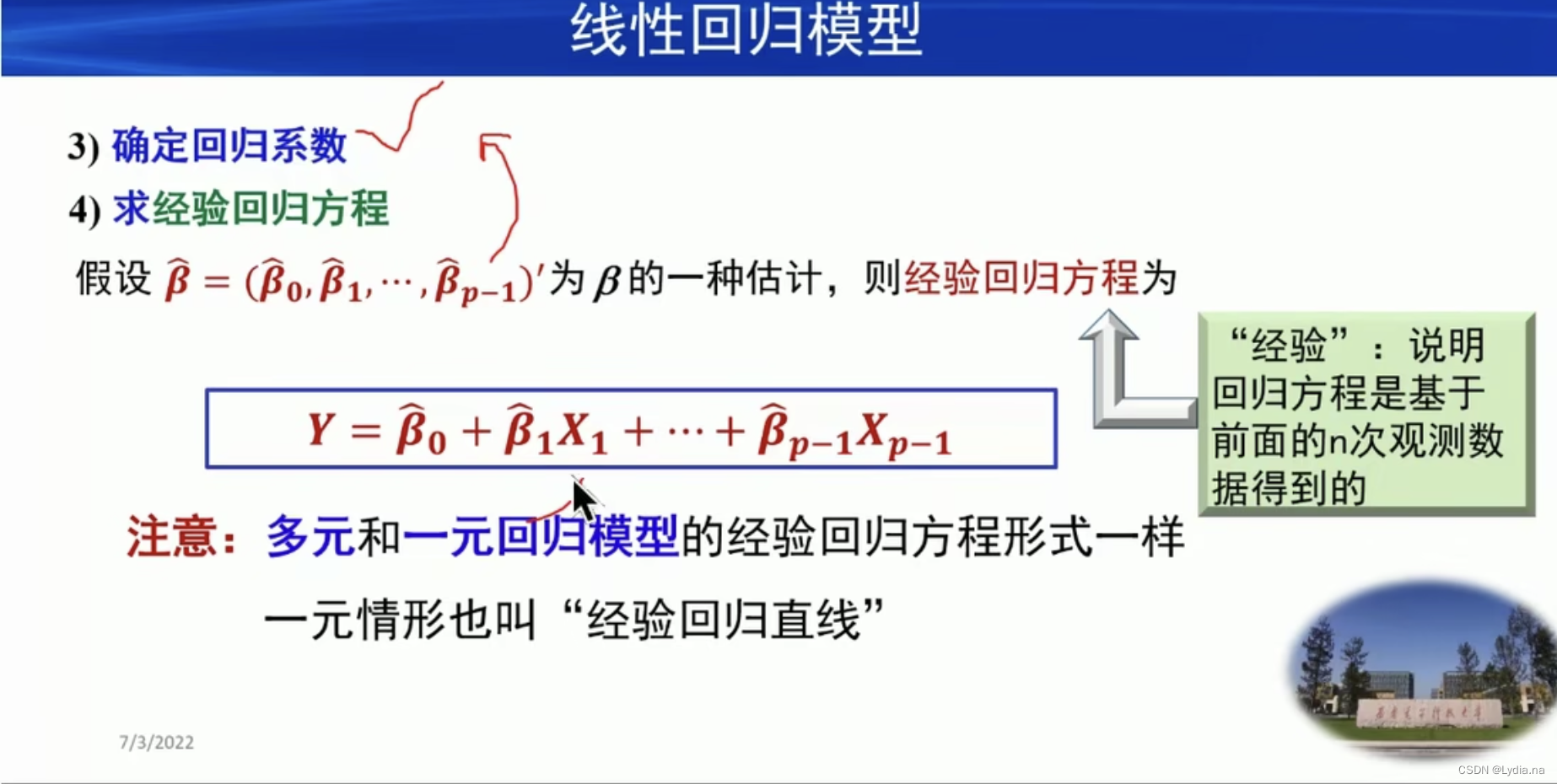

Y = β 0 + β 1 X 1 + . . . + β p − 1 X p − 1 + e Y=\beta_0+\beta_1X_1+...+\beta_{p-1}X_ {p-1}+e Y=β0+β1X1+...+βp−1Xp−1+e

其中 β 0 \beta_0 β0为常数项, β 1 , . . . , β p − 1 \beta_1,...,\beta_{p-1} β1,...,βp−1为回归系数,e为随机误差。 -

观测数据

高斯马尔可夫假设(备注)

-

确定位置参数估计值(最小二乘)

-

求经验回归方程

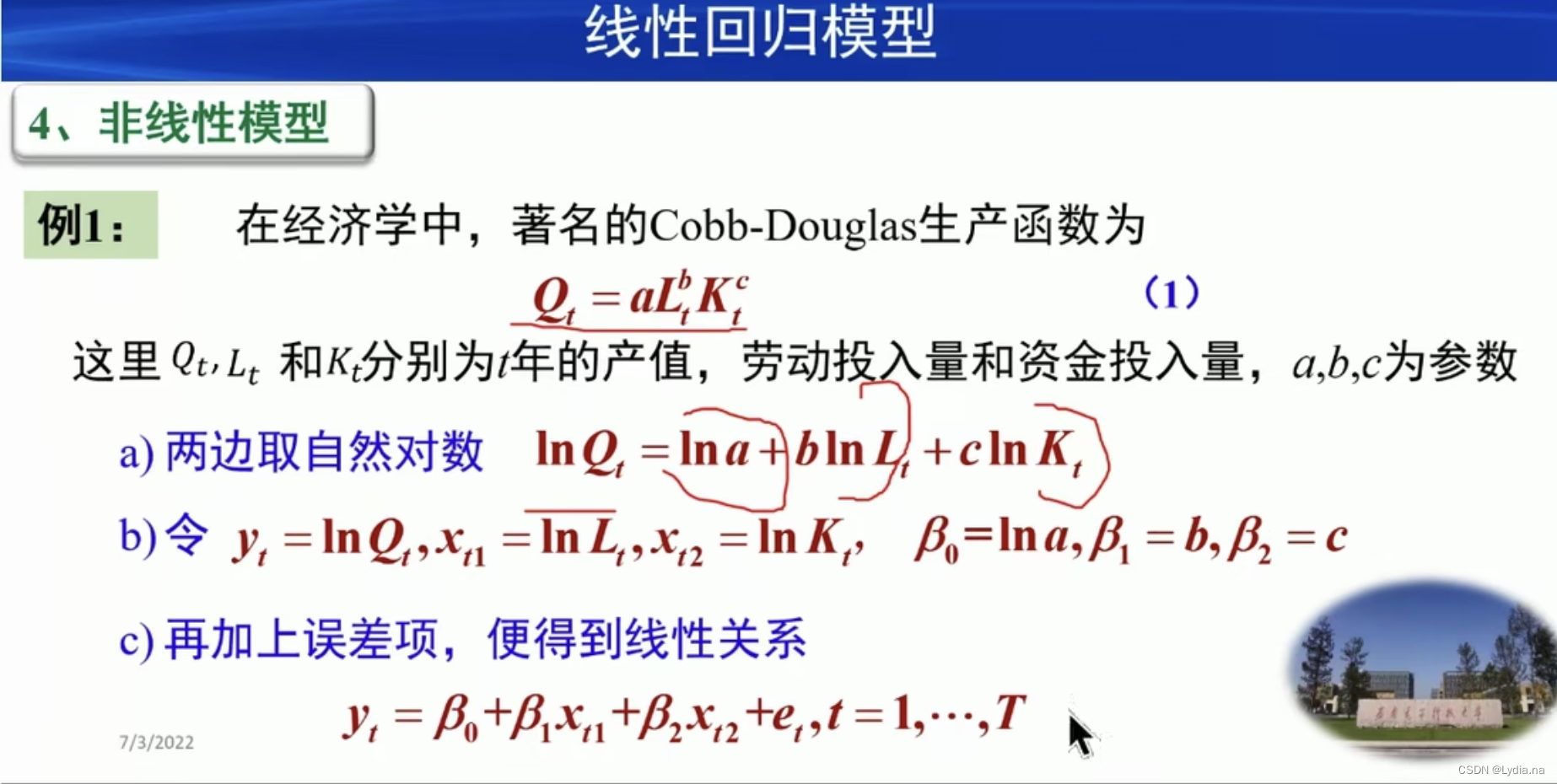

处理非线性问题

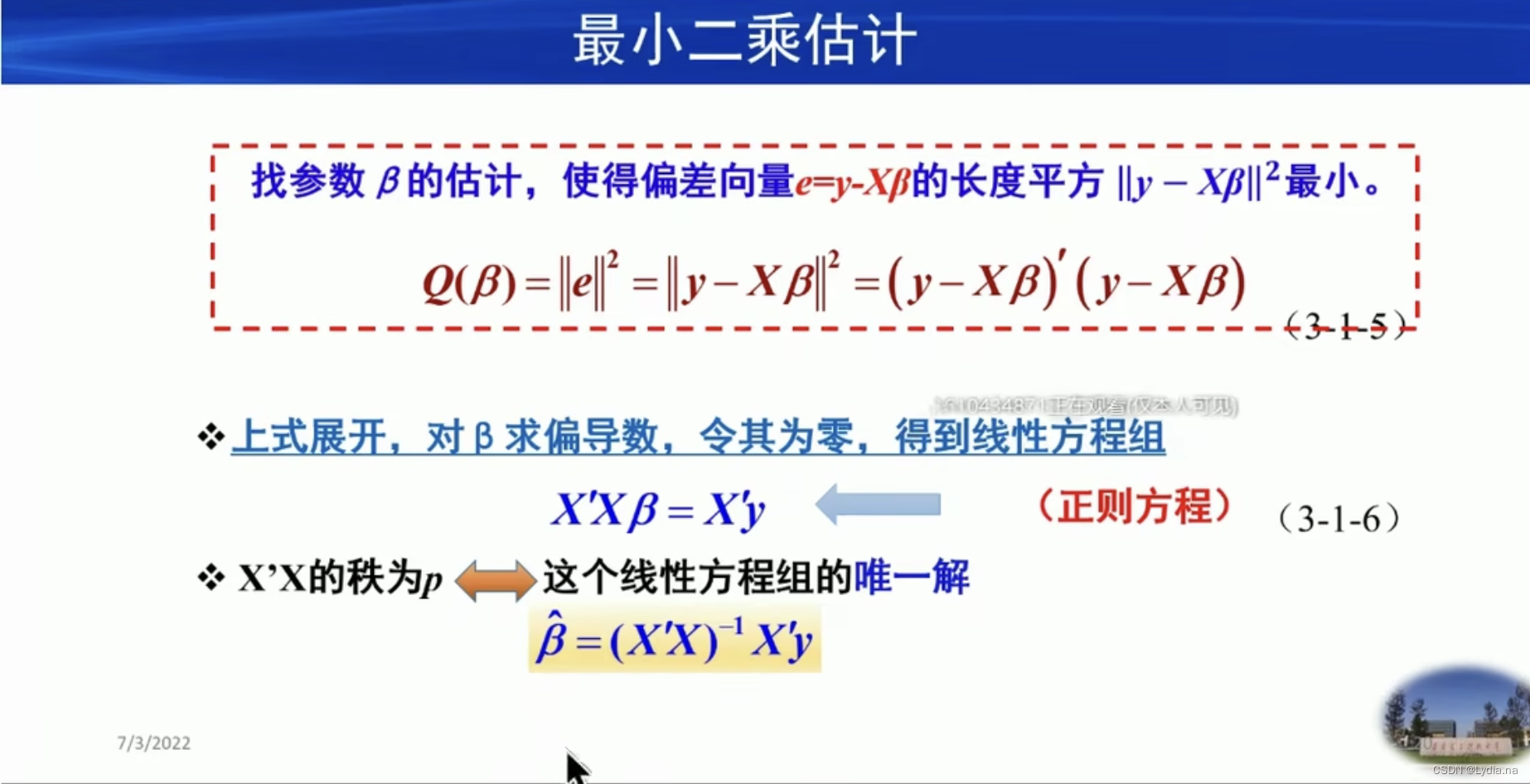

step2 最小二乘估计

红色方块体现在论文中

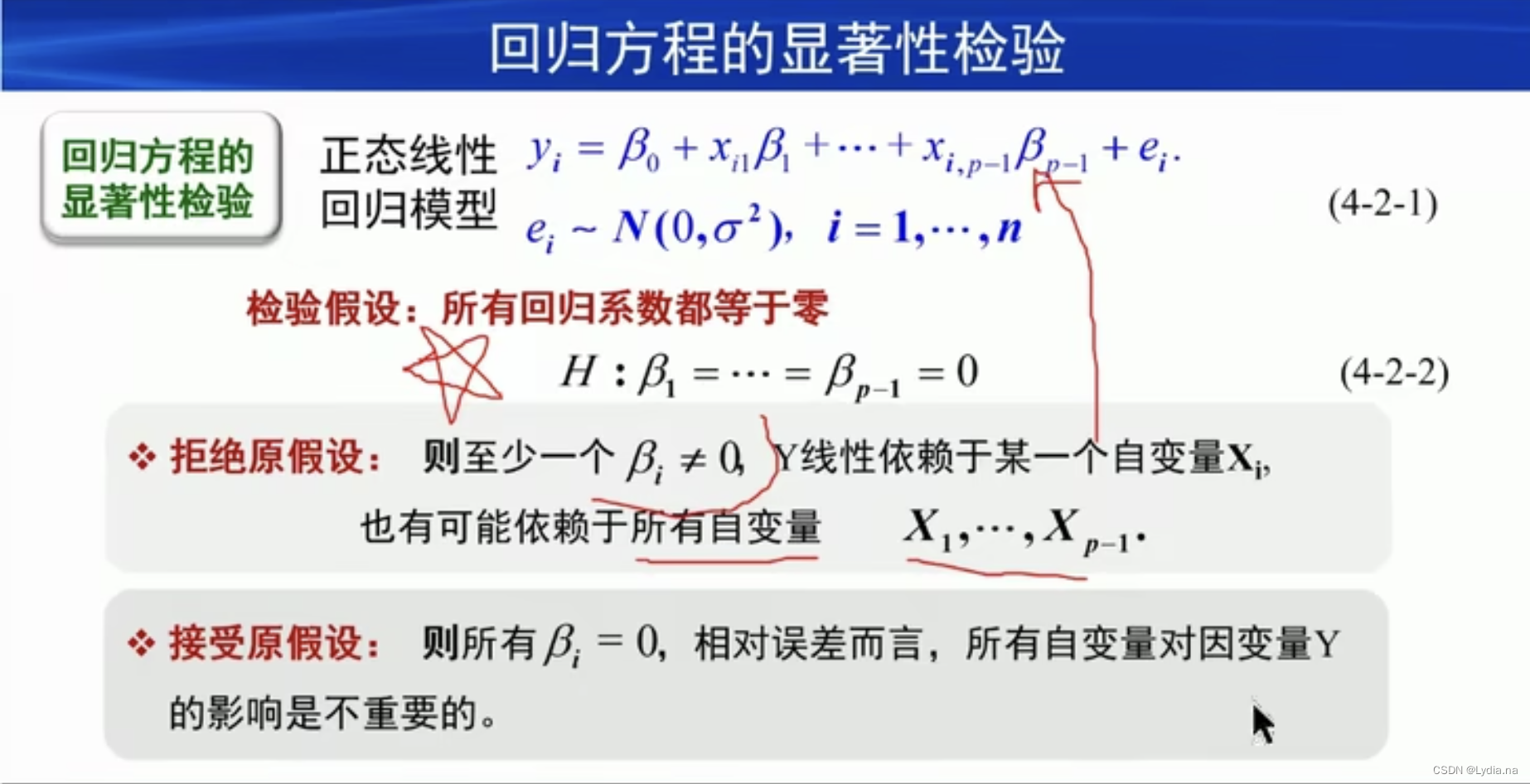

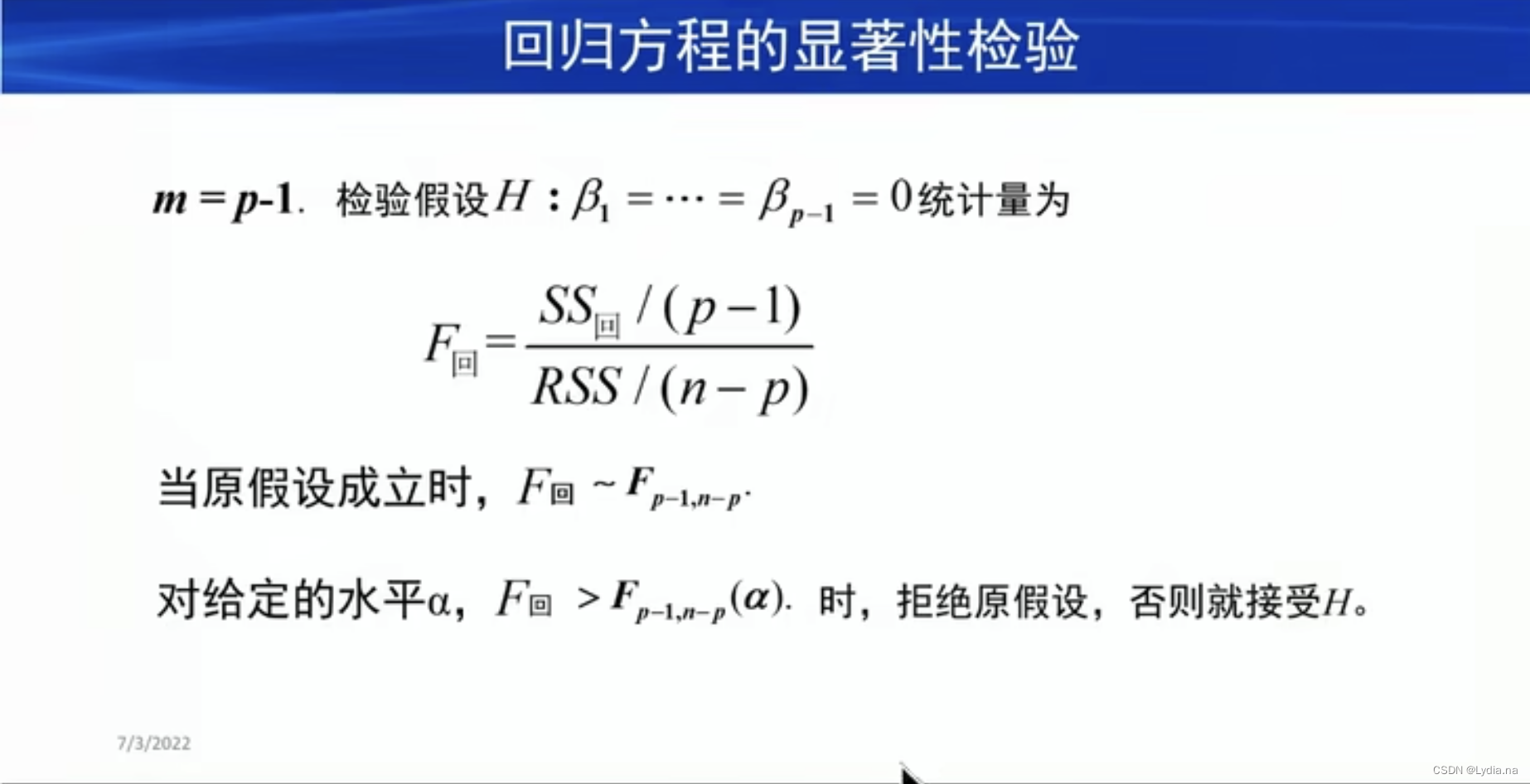

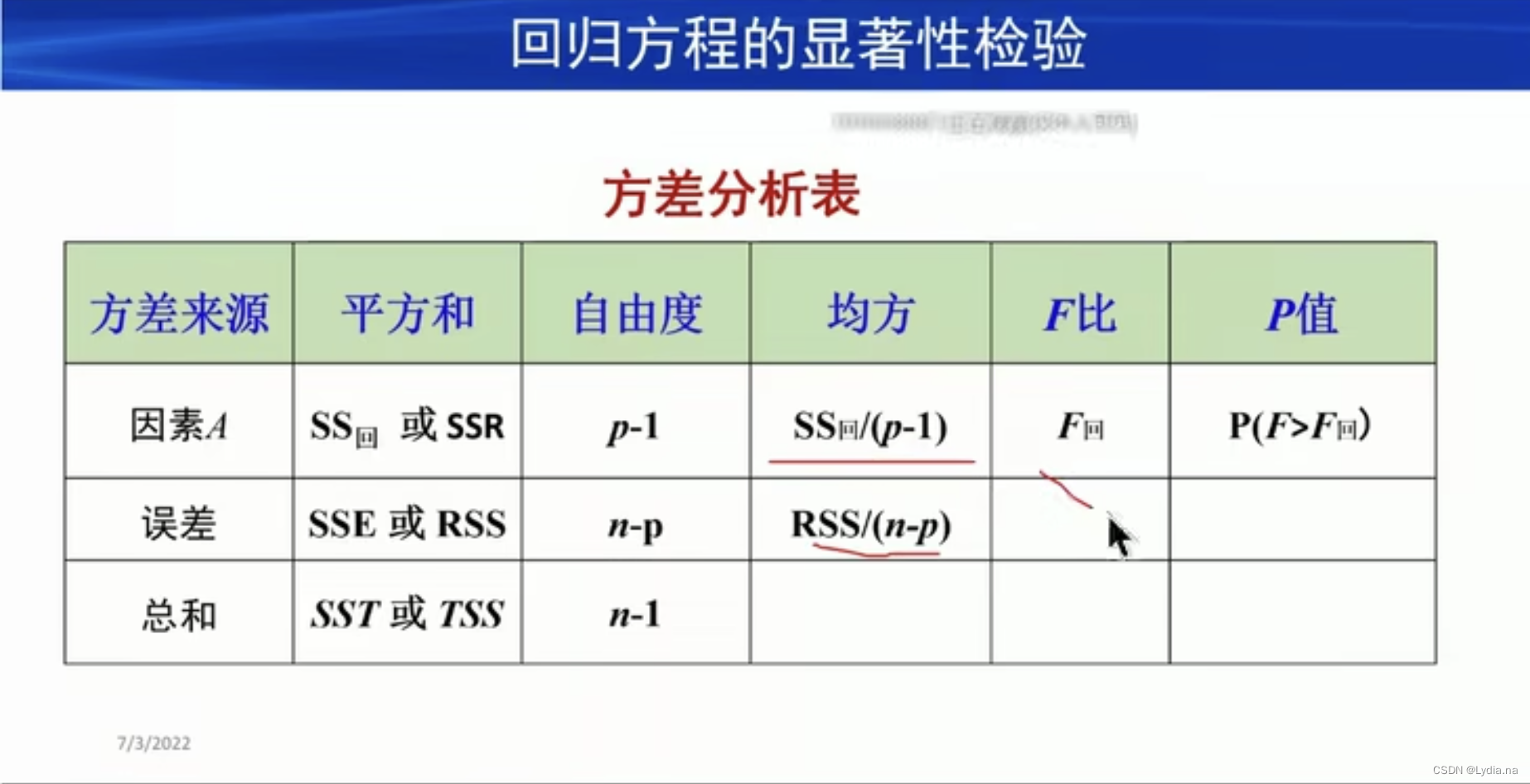

step3 回归方程的显著性检验(方程、系数)

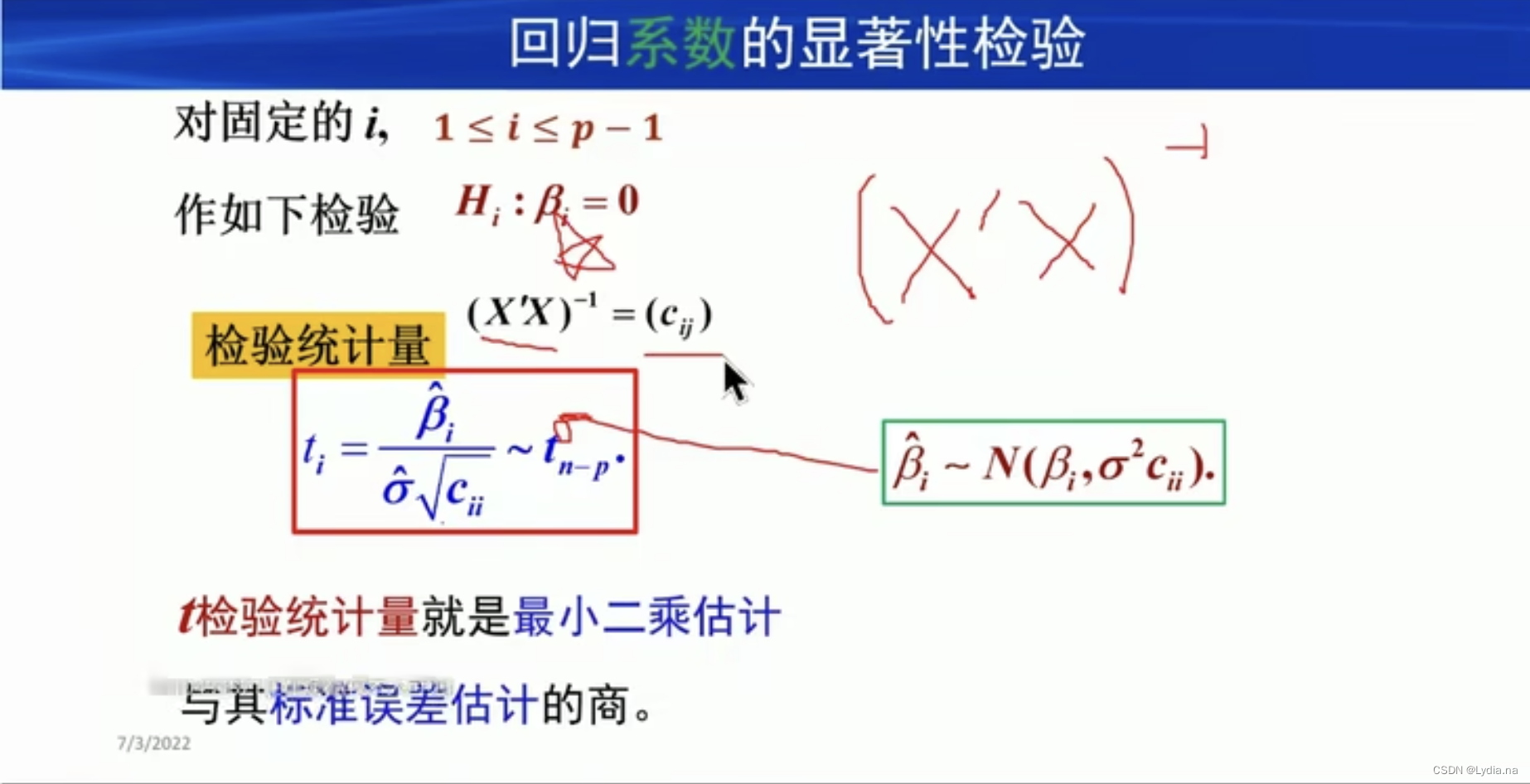

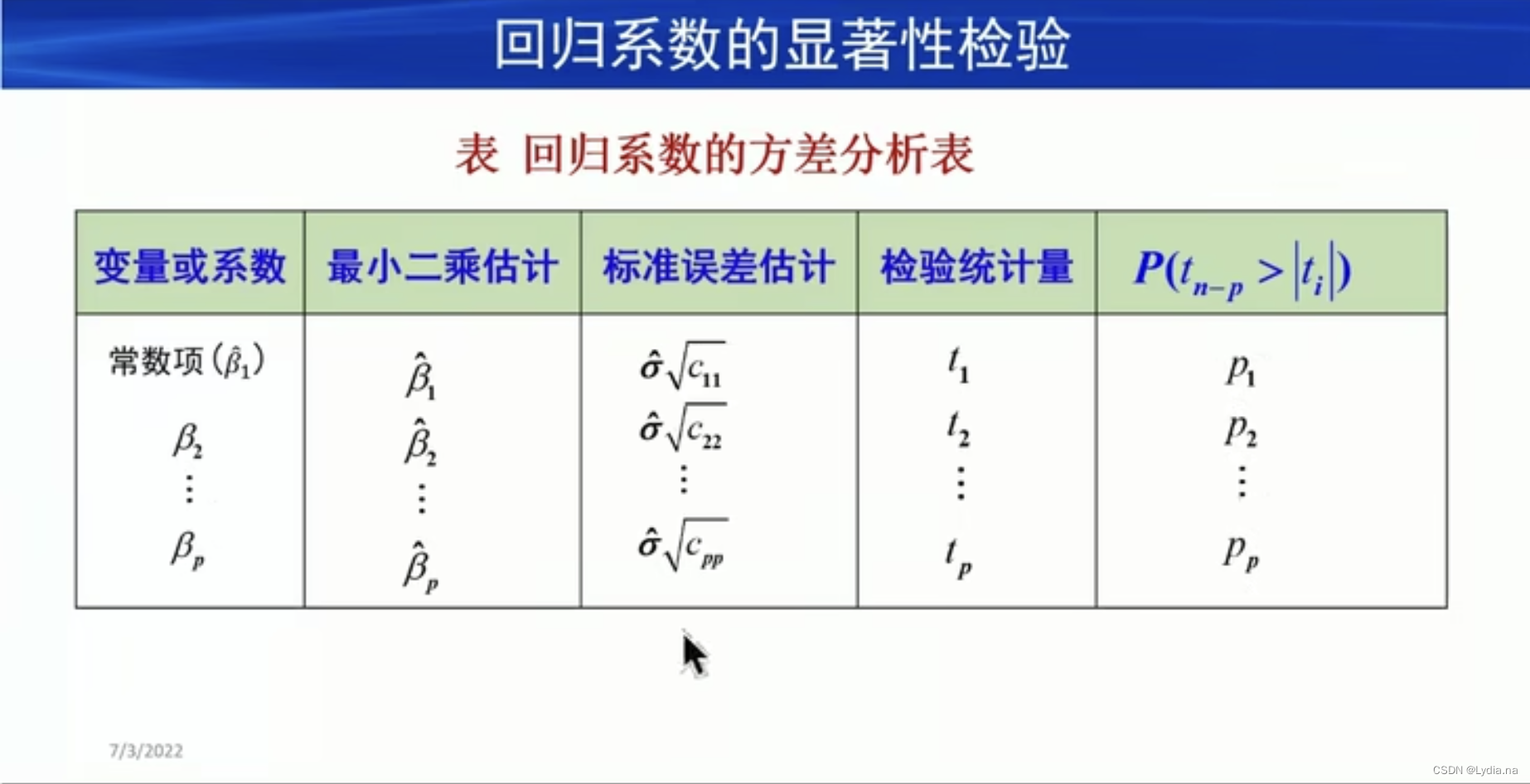

回归系数的显著性检验

拒绝原假设的时候进行回归系数的显著性检验

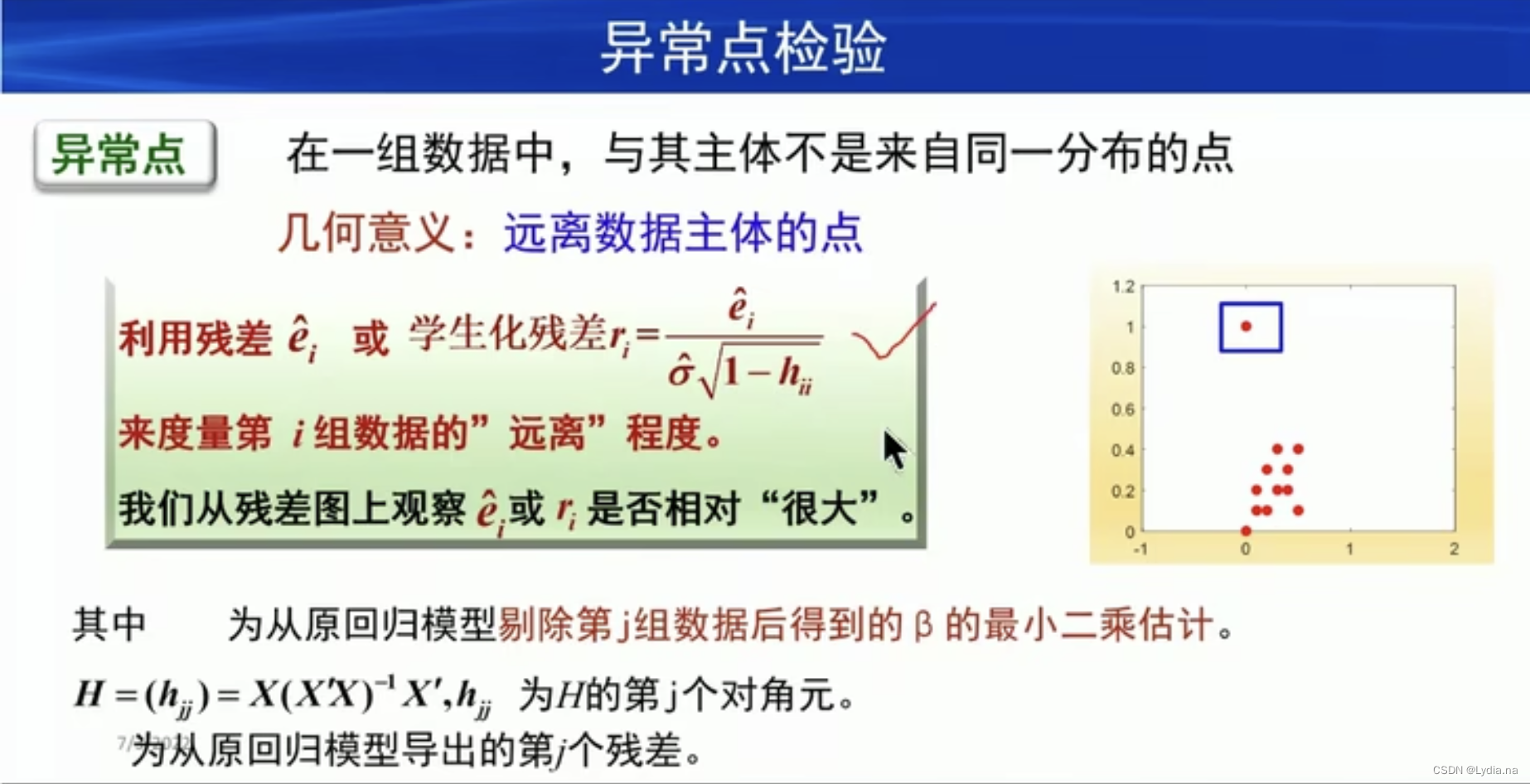

异常点(t检验)在这里插入图片描述

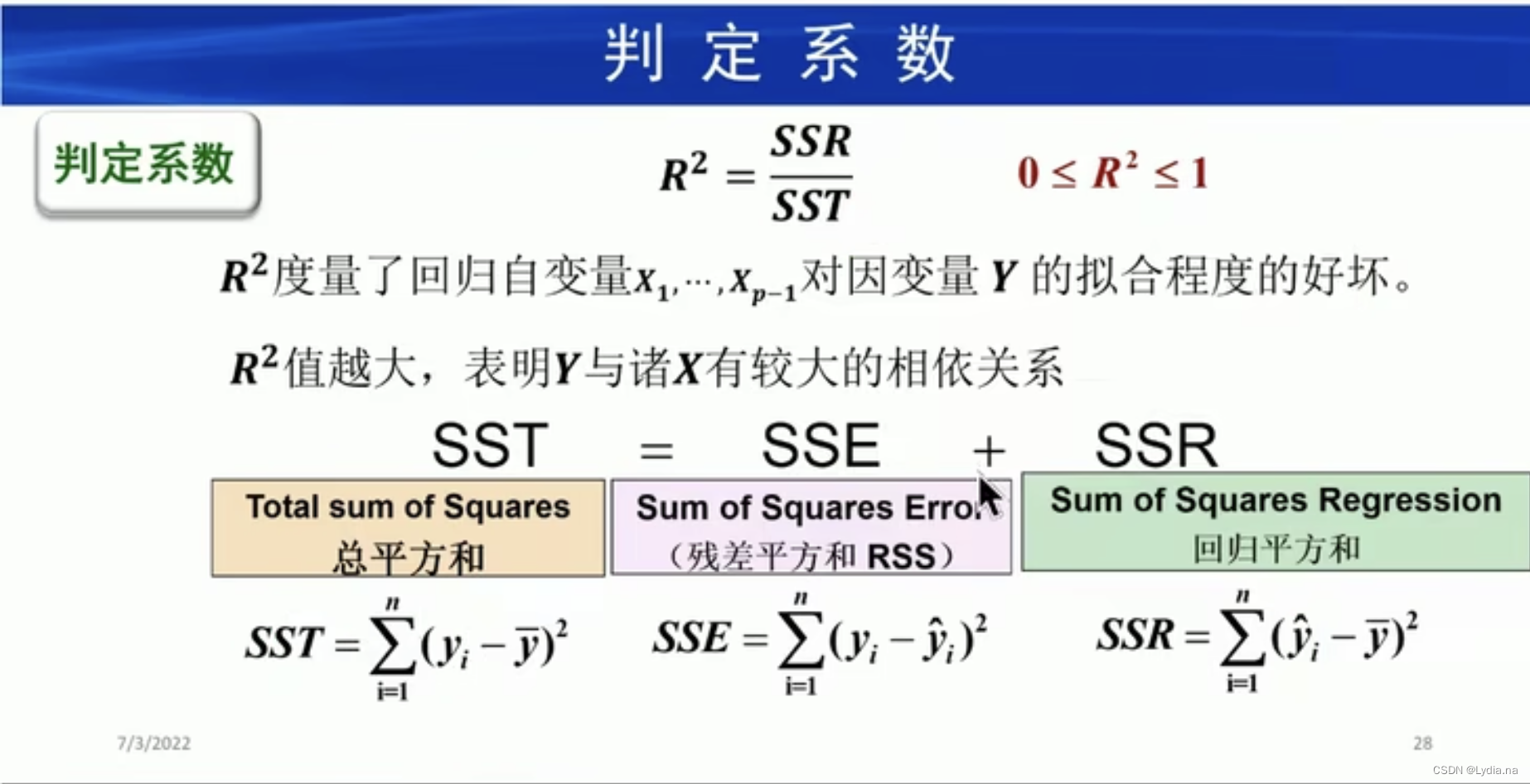

step4 衡量多重回归模型优劣的标准(判定系数、复相关系数、调整的判定系数)

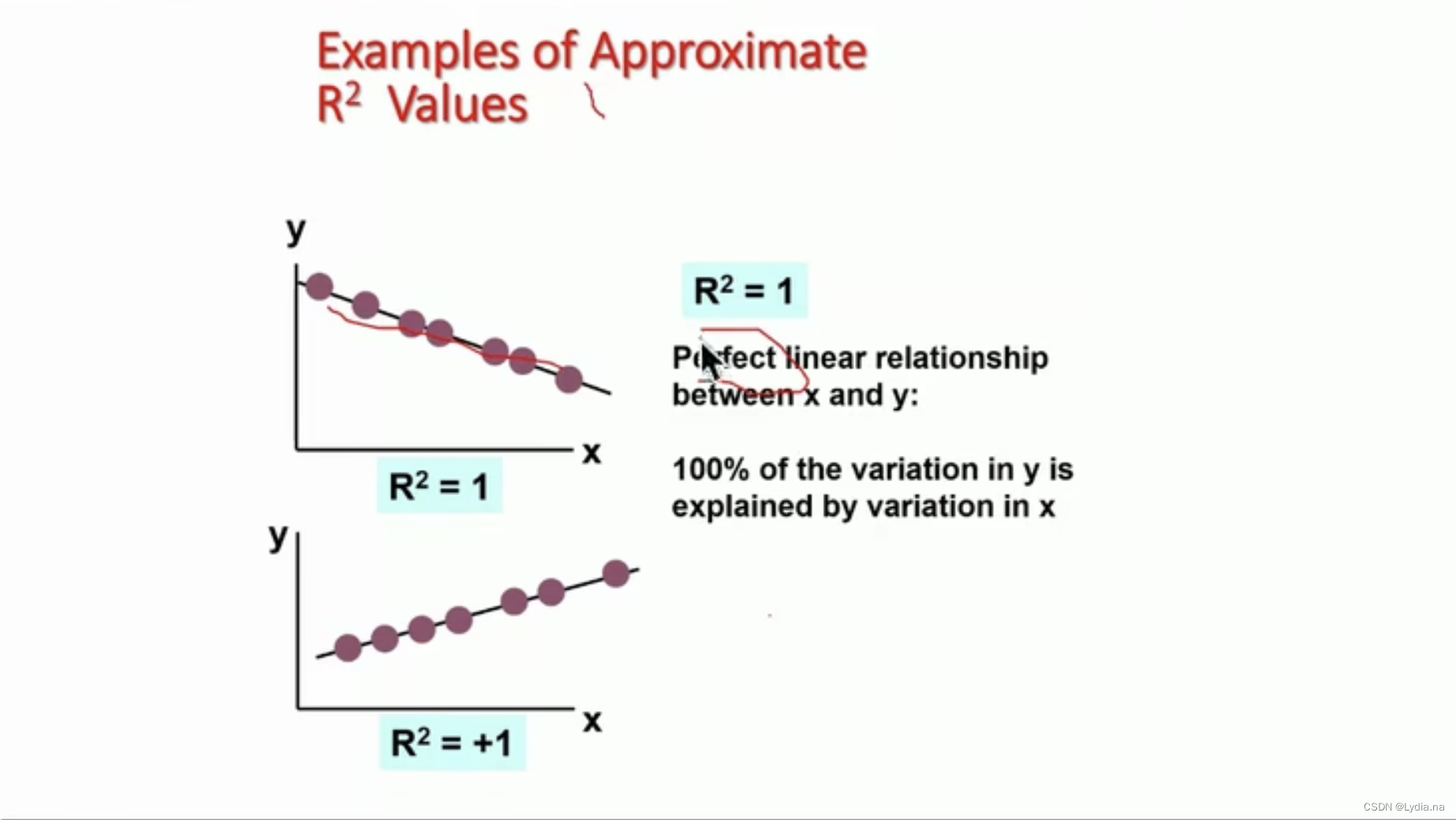

判定系数

当判定系数=1时,他的线性依赖关系很好,反之。

复共线性

一些大型线性回归问题(自变量较多),最小二乘估计有时表现不理想:有些回归系数的绝对值异常大;回归系数的符号与实际意义相违背。

定义:回归自变量之间存在着近似线性关系

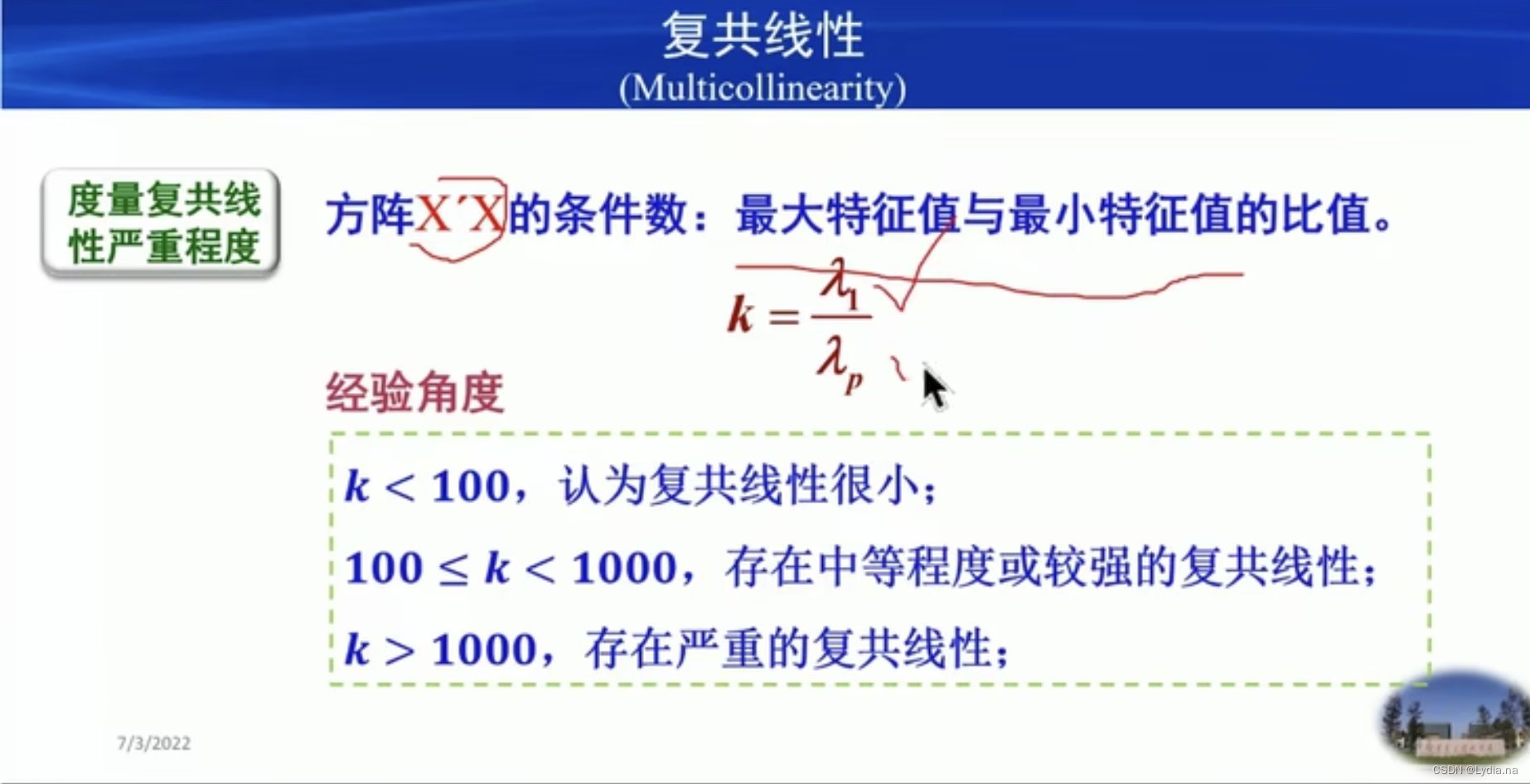

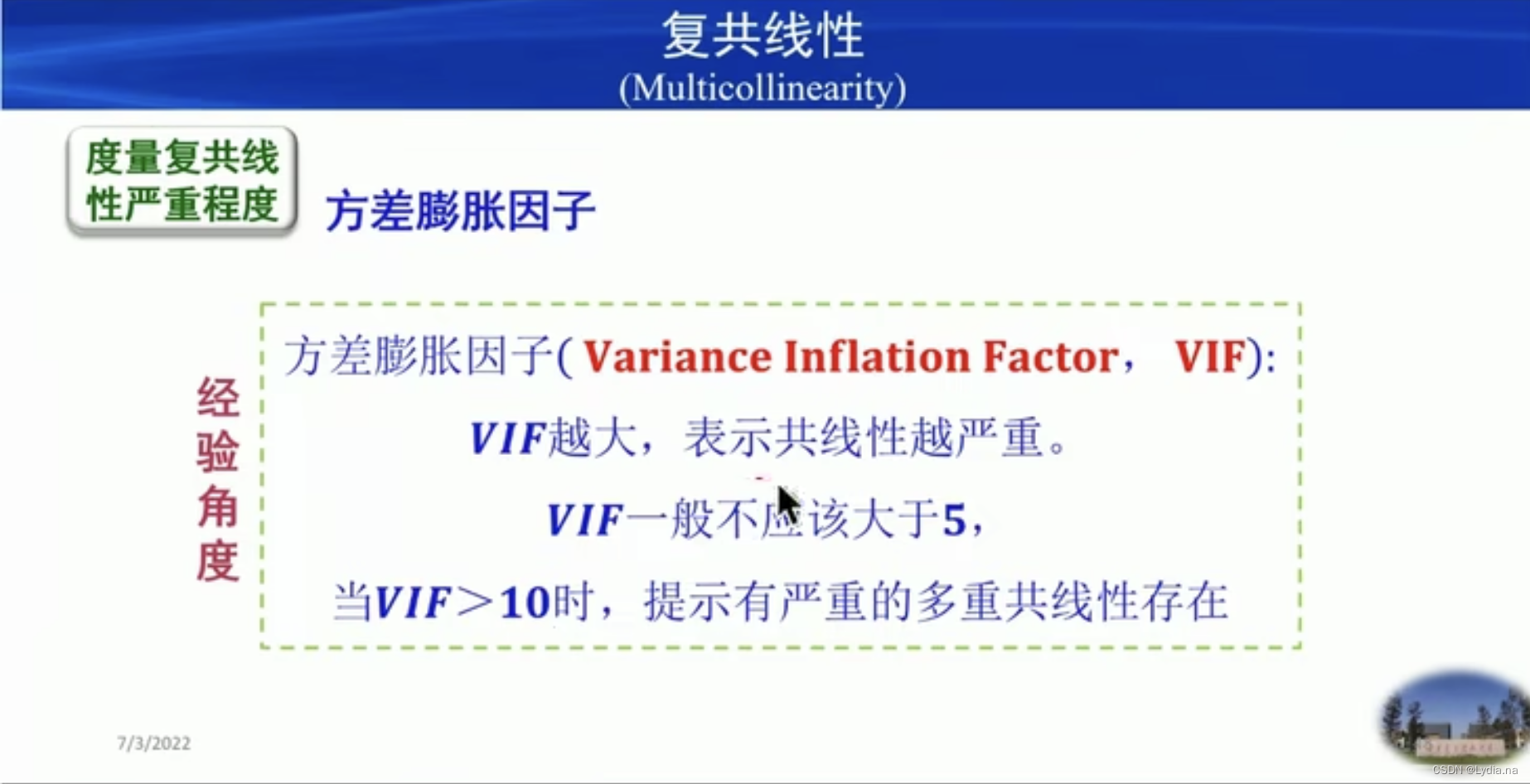

复共线性的严重程度的度量

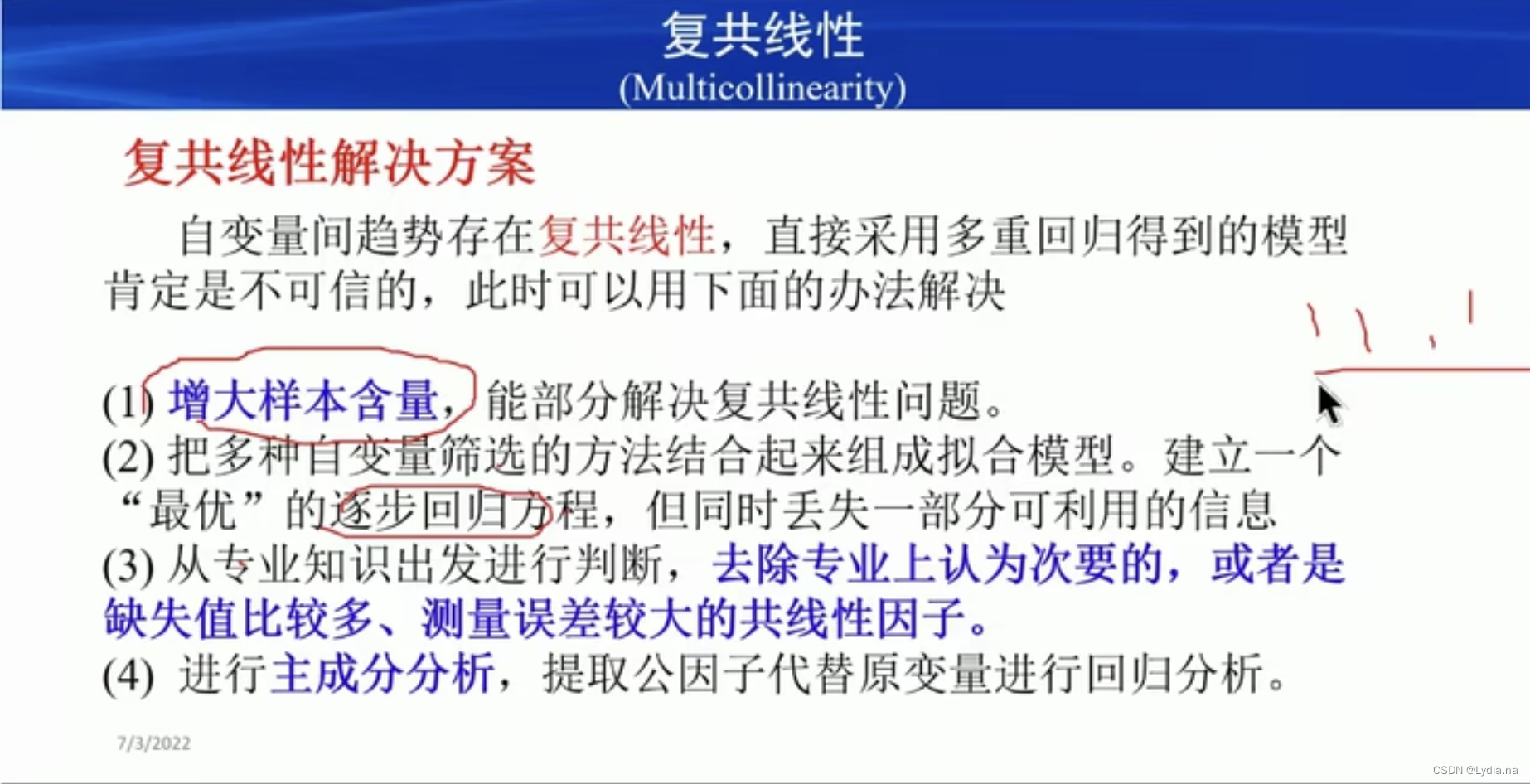

共线性的解决方案

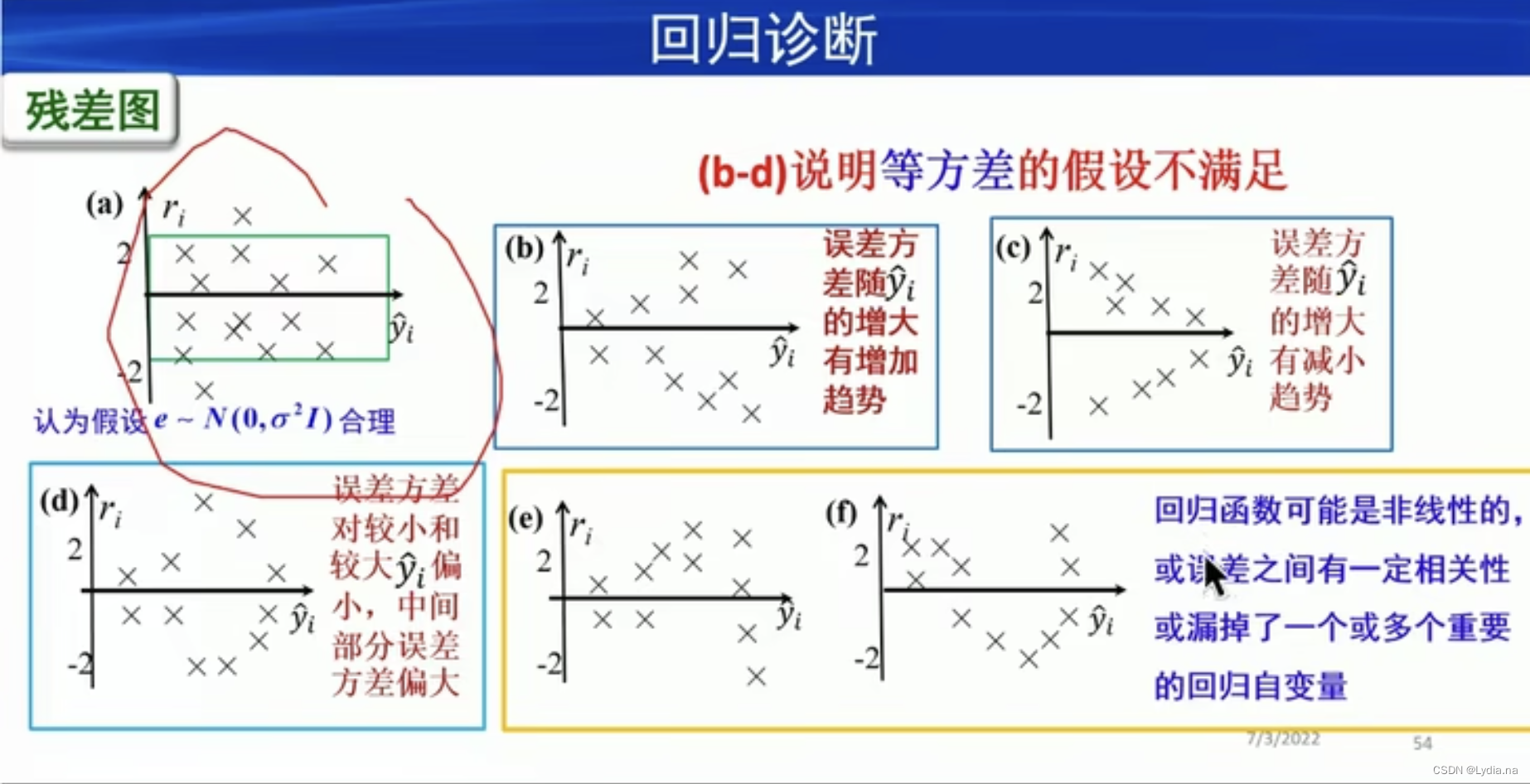

残差分析和回归假设

线性残差。

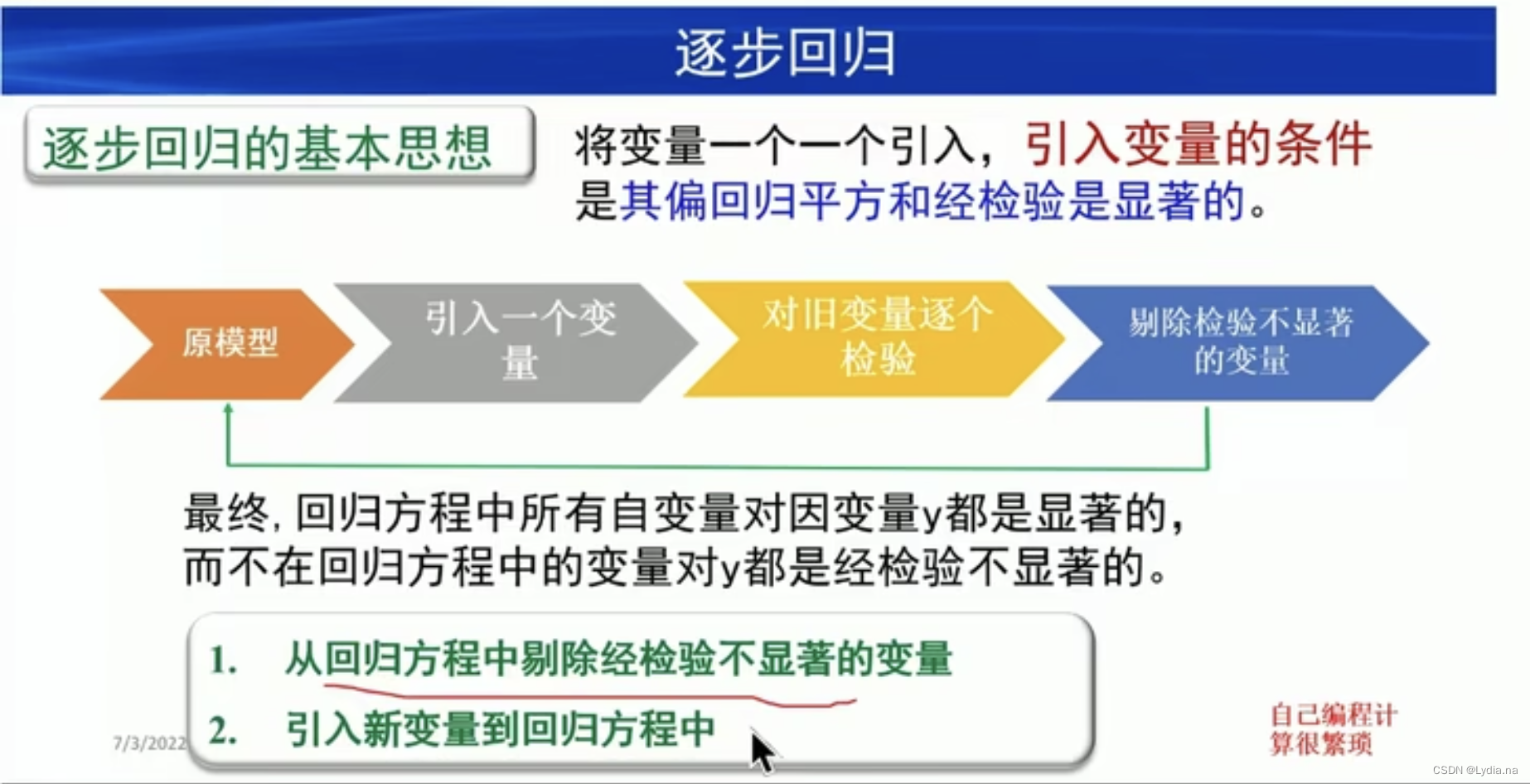

逐步回归

3413

3413

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?