训练目标是提高成对判别能力,并对三元组句子的蕴涵关系进行建模。

最近,随着预训练的基于transformer的语言模型的巨大成功和BERT一样,它们被广泛用于生成句子表示。一种直接的方法是利用[CLS]嵌入(Devlin等人,2019)或在类bert预训练语言模型的最后几层应用均值池(Reimers和Gurevych, 2019)。然而,未经进一步微调的预训练语言模型的句子嵌入不能很好地捕获句子的语义,有时甚至不如GloVe 等非上下文化嵌入。

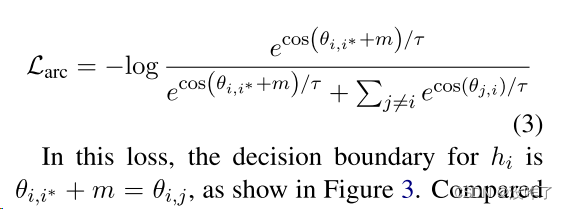

(Additive Angular Margin contrast Loss, ArcCon Loss),它通过最大化角空间中的决策边际来增强两两判别能力。

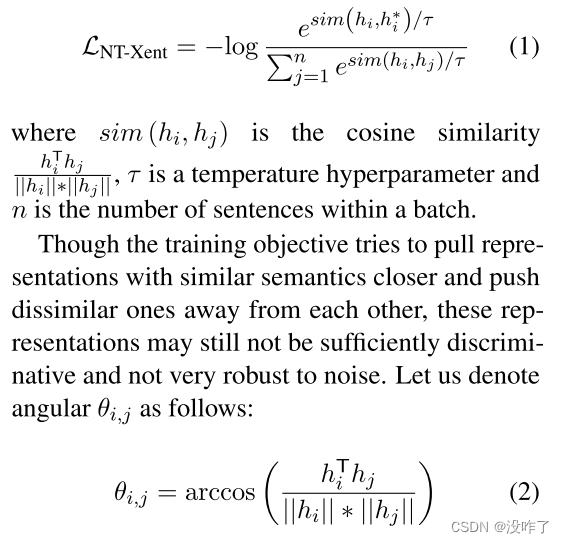

为了对句子之间的正负成对关系进行建模,我们首先需要生成句子表征,并将它们分组为正负对。然后将这些对输入到训练目标中进行优化。

droppout=0.1,m=10, tao=0.05

本文探讨了如何通过增强预训练Transformer模型的[CLS]嵌入和使用AngularMarginContrastLoss/ArcConLoss提升句子表示的语义捕捉能力,以更好地处理成对关系和三元组句子的蕴含关系,同时关注Dropout优化策略。

本文探讨了如何通过增强预训练Transformer模型的[CLS]嵌入和使用AngularMarginContrastLoss/ArcConLoss提升句子表示的语义捕捉能力,以更好地处理成对关系和三元组句子的蕴含关系,同时关注Dropout优化策略。

637

637

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?