背景介绍

LLM的局限性

·知识时效性受限:如何让LLM能够获取最新的知识

·专业能力有限:如何打造垂域大模型

·定制化成本高:如何打造个人专属的LLM应用

模型改进方式

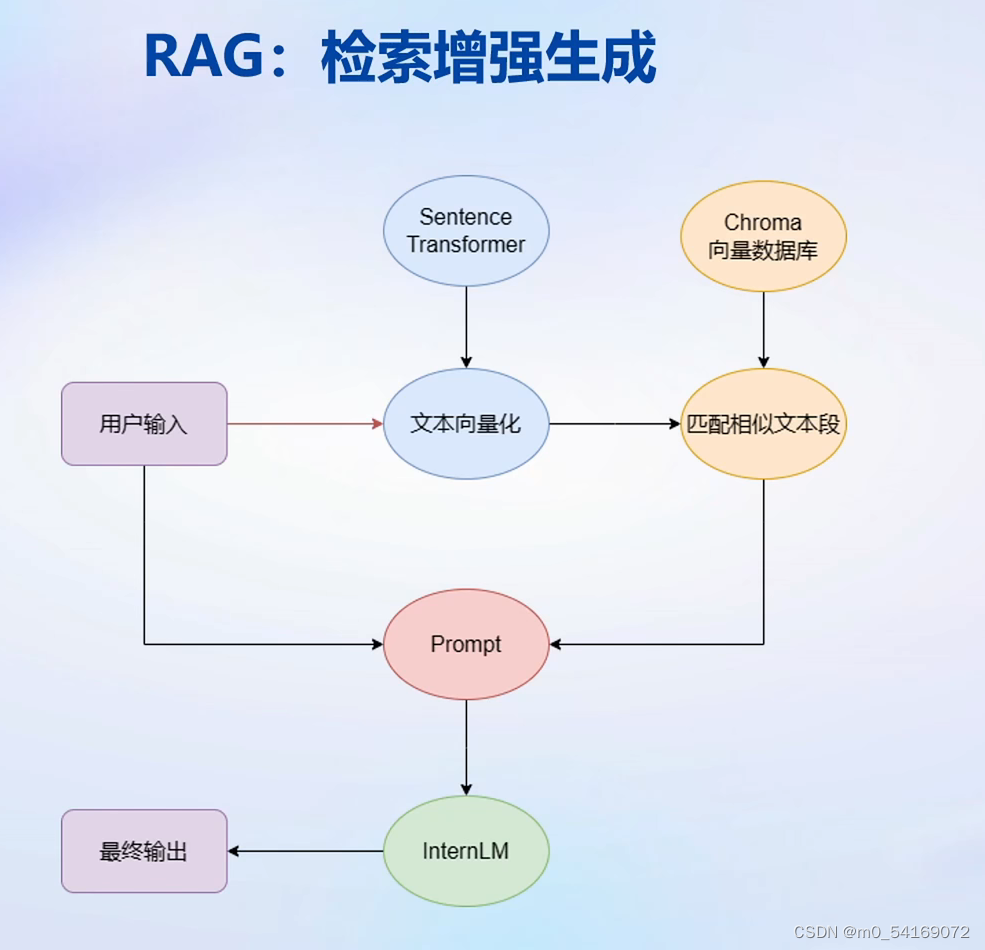

RAG

Retrieval-Augmented Generation是一个结合了检索和生成的模型架构,它是由Hugging Face提出的一种新型的语言生成模型。

RAG模型基于两种主要组件:一个是检索式模型(Retriever),用于从大量的文档中检索相关信息;另一个是生成式模型(Generator),用于基于检索结果生成文本。

RAG模型的工作流程通常如下:

1. 检索:通过Retriever模型,从大规模的文档中检索出与输入问题相关的文档片段。

2. 增强:将检索到的文档片段与原始输入进行融合,形成一个增强的输入。

3. 生成:通过Generator模型,基于增强的输入生成文本回复。

RAG模型的优势在于能够利用检索式的信息来辅助生成式的文本生成,从而提高了生成文本的相关性和质量。这种结合检索和生成的模型架构在问答系统、对话系统和文本生成任务中有着广泛的应用前景。Hugging Face在其transformers库中提供了RAG模型的实现,你可以使用这个库来构建和使用RAG模型来解决各种自然语言处理任务。

Finetune

在自然语言处理(NLP)中,微调(Finetune)是指在预训练模型的基础上,使用特定领域的数据进行进一步训练,以使模型能够更好地适应特定任务或领域的需求。

传统的自然语言处理算法通常指的是诸如TF-IDF、词袋模型、朴素贝叶斯、SVM等经典的机器学习算法,或者是基于规则的方法。这些传统算法在特定任务上可能效果不错,但当面对复杂的自然语言处理任务时,可能无法充分利用大规模语料库中学到的丰富语言特征。

通过微调预训练模型,我们可以利用大规模数据集上训练得到的语言表示能力,将这些表示能力迁移到特定任务上。例如,可以使用预训练的BERT、GPT、RoBERTa等模型,然后在特定领域的数据上进行微调,使得模型能够更好地理解领域特定的语言表达和语境。

微调的过程通常包括以下步骤:

1. 加载预训练模型:选择适合任务的预训练模型,如BERT、GPT等,并加载其参数。

2. 准备数据:准备特定任务的数据集,可能需要进行数据预处理、标记化等操作。

3. 定义模型结构:根据任务的特点,可能需要在预训练模型的基础上添加特定的网络层或调整模型结构。

4. 定义损失函数:根据任务类型(分类、生成等),选择合适的损失函数。

5. 训练模型:在特定任务的数据集上进行模型训练,并不断调整模型参数,使其适应任务需求。

通过微调,我们可以利用预训练模型在大规模语料库上学习到的语言表示能力,快速构建适用于特定任务的NLP模型,并且通常能够取得比从头训练模型更好的效果。

RAG VS Finetune

搭建知识库

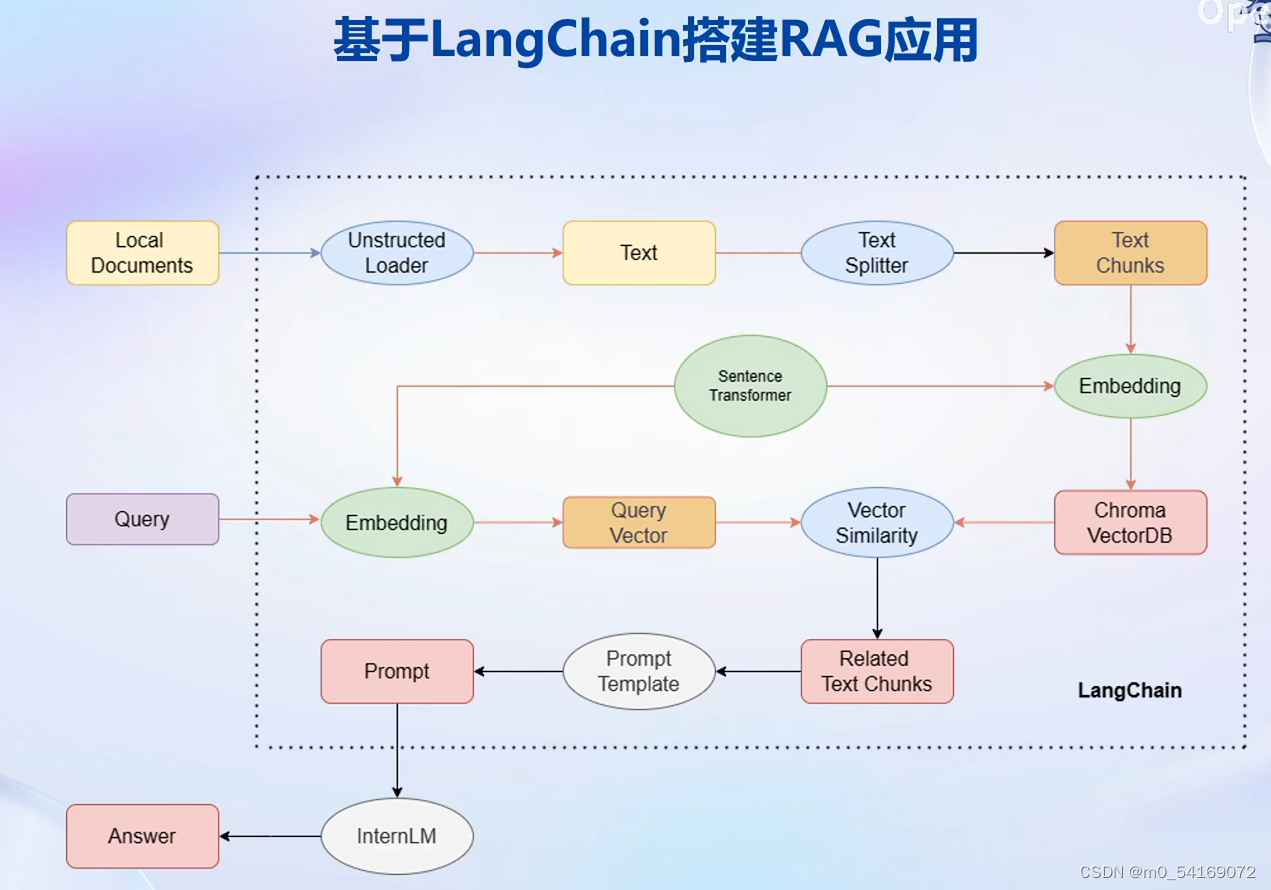

LangChain

LangChain框架是一个开源工具,通过为各种LLM提供通用接口来简化应用程序的开发流程,帮助开发者自由构建LLM应用。

LangChain 的核心组成模块:

·链(Chains):将组件组合实现端到端应用,通过一个对象封装实现一系列 LLM操作

·Eg.检索问答链,覆盖实现了RAG(检索增强生成)的全部流程

构建向量数据库

加载源文件→文档分块→文档向量化

·确定源文件类型,针对不同类型源文件选用不同的加载器

·核心在于将带格式文本转化为无格式字符串

·由于单个文档往往超过模型上下文上限,我们需要对加载的文档进行切分

·一般按字符串长度进行分割

·可以手动控制分割块的长度和重叠区间长度

·使用向量数据库来支持语义检索,需要将文档向量化存入向量数据库

·可以使用任一一种Embedding 模型来进行向量化 。

·可以使用多种支持语义检索的向量数据库,一般使用轻量级的Chroma

搭建知识库助手

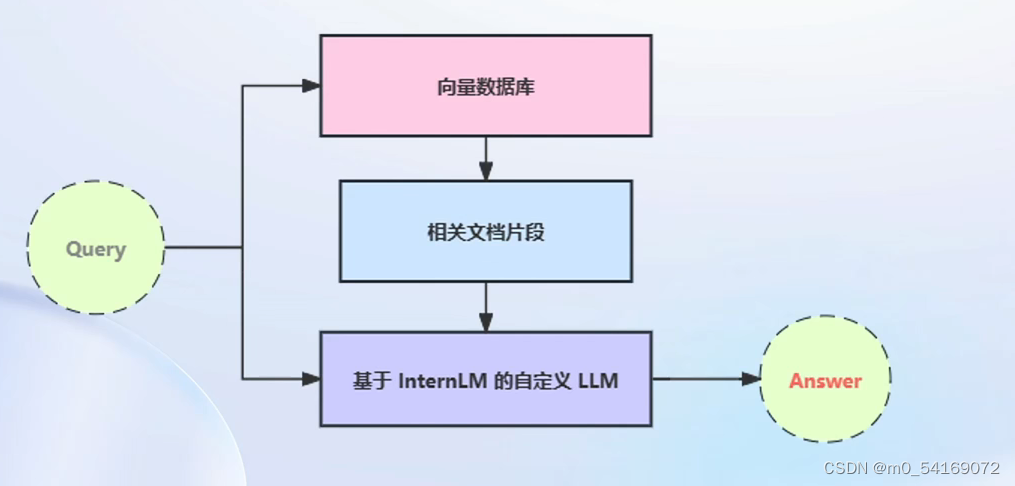

将InternLM接入LangChain

· LangChain支持自定义LLM,可以直接接入到框架中

· 我们只需将InternLM部署在本地,并封装一个自定义LLM类,调用本地InternLM即可

构建检索问答链

· LangChain提供了检索问答链模版,可以自动实现知识检索、Prompt嵌入、LLM问答的全部流程

·将基于InternLM的自定义LLM和已构建的向量数据库接入到检索问答链的上游

·调用检索问答链,即可实现知识库肋手的核心功能

RAG方案优化

基于RAG的问答系统性能核心受限于:

·检索精度

·Prompt性能。

一些可能的优化点:

·检索方面:

·基于语义进行分割,保证每一个chunk的语义完整

·给每一个chunk生成概括性索引,检索时匹配索引

·Prompt方面:

·迭代优化Prompt策略

项目实战作业

InternLM 和 LangChain 是两个研究领域的最新技术,它们都与自然语言处理和语言模型相关。LangChain 是一个基于区块链技术的去中心化知识库,而 InternLM 是一个面向互联网内容的大规模语言模型。

搭建知识库的过程一般包括以下几个步骤:

1. 数据收集:首先需要收集大量的语言数据,这可能包括文本、语音、图像等不同形式的数据。这些数据可以来自于互联网、书籍、期刊、论文等不同的来源。 我们选择由上海人工智能实验室开源的一系列大模型工具开源仓库作为语料库来源,包括: OpenCompass:面向大模型评测的一站式平台

IMDeploy:涵盖了 LLM 任务的全套轻量化、部署和服务解决方案的高效推理工具箱

XTuner:轻量级微调大语言模型的工具库

InternLM-XComposer:浦语·灵笔,基于书生·浦语大语言模型研发的视觉-语言大模型

Lagent:一个轻量级、开源的基于大语言模型的智能体(agent)框架

InternLM:一个开源的轻量级训练框架,旨在支持大模型训练而无需大量的依赖

2. 数据清洗与预处理:对于收集到的数据,需要进行清洗和预处理,以消除错误、不一致性、噪音等问题,并将其转化为适合模型训练的格式。

3. 模型训练:使用 InternLM 和 LangChain 提供的技术和工具,对清洗和预处理后的数据进行模型训练。这可能涉及到调参、模型组合、特征工程等工作。

4. 验证和评估:训练完成后,需要对模型进行验证和评估,以确保其在各种任务和场景下的性能。

5. 部署和应用:最后,将训练好的模型部署到实际应用中,例如构建一个基于 LangChain 的知识库平台,让用户可以使用该平台获取信息、提问问题等。

总的来说,搭建知识库的过程需要结合数据收集、预处理、模型训练、验证评估和应用部署等多个环节,同时需要结合 InternLM 和 LangChain 的相关技术和工具来完成。这是一个复杂且需要多方面专业知识的工程,需要深入的研究和实践。

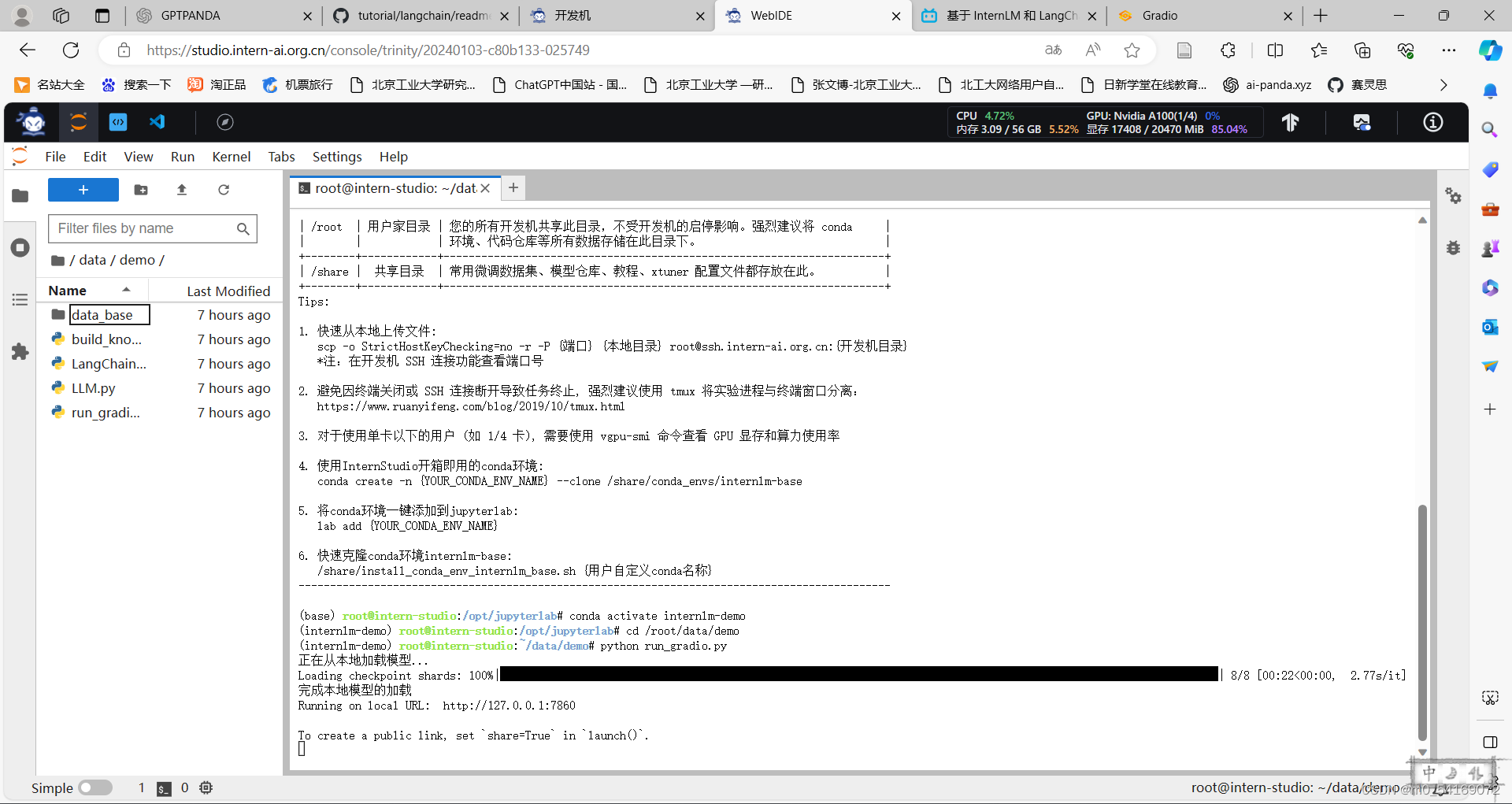

环境配置和模型下载请参考:tutorial/langchain/readme.md at main · InternLM/tutorial (github.com)

视频教学:基于 InternLM 和 LangChain 搭建你的知识库_哔哩哔哩_bilibili

构建向量数据库

# 首先导入所需第三方库

from langchain.document_loaders import UnstructuredFileLoader

from langchain.document_loaders import UnstructuredMarkdownLoader

from langchain.text_splitter import RecursiveCharacterTextSplitter

from langchain.vectorstores import Chroma

from langchain.embeddings.huggingface import HuggingFaceEmbeddings

from tqdm import tqdm

import os

# 获取文件路径函数

def get_files(dir_path):

# args:dir_path,目标文件夹路径

file_list = []

for filepath, dirnames, filenames in os.walk(dir_path):

# os.walk 函数将递归遍历指定文件夹

for filename in filenames:

# 通过后缀名判断文件类型是否满足要求

if filename.endswith(".md"):

# 如果满足要求,将其绝对路径加入到结果列表

file_list.append(os.path.join(filepath, filename))

elif filename.endswith(".txt"):

file_list.append(os.path.join(filepath, filename))

return file_list

# 加载文件函数

def get_text(dir_path):

# args:dir_path,目标文件夹路径

# 首先调用上文定义的函数得到目标文件路径列表

file_lst = get_files(dir_path)

# docs 存放加载之后的纯文本对象

docs = []

# 遍历所有目标文件

for one_file in tqdm(file_lst):

file_type = one_file.split('.')[-1]

if file_type == 'md':

loader = UnstructuredMarkdownLoader(one_file)

elif file_type == 'txt':

loader = UnstructuredFileLoader(one_file)

else:

# 如果是不符合条件的文件,直接跳过

continue

docs.extend(loader.load())

return docs

# 目标文件夹

tar_dir = [

"/root/data/InternLM",

"/root/data/InternLM-XComposer",

"/root/data/lagent",

"/root/data/lmdeploy",

"/root/data/opencompass",

"/root/data/xtuner"

]

# 加载目标文件

docs = []

for dir_path in tar_dir:

docs.extend(get_text(dir_path))

# 对文本进行分块

text_splitter = RecursiveCharacterTextSplitter(

chunk_size=500, chunk_overlap=150)

split_docs = text_splitter.split_documents(docs)

# 加载开源词向量模型

embeddings = HuggingFaceEmbeddings(model_name="/root/data/model/sentence-transformer")

# 构建向量数据库

# 定义持久化路径

persist_directory = 'data_base/vector_db/chroma'

# 加载数据库

vectordb = Chroma.from_documents(

documents=split_docs,

embedding=embeddings,

persist_directory=persist_directory # 允许我们将persist_directory目录保存到磁盘上

)

# 将加载的向量数据库持久化到磁盘上

vectordb.persist()InternLM 接入 LangChain

from langchain.llms.base import LLM

from typing import Any, List, Optional

from langchain.callbacks.manager import CallbackManagerForLLMRun

from transformers import AutoTokenizer, AutoModelForCausalLM

import torch

class InternLM_LLM(LLM):

# 基于本地 InternLM 自定义 LLM 类

tokenizer : AutoTokenizer = None

model: AutoModelForCausalLM = None

def __init__(self, model_path :str):

# model_path: InternLM 模型路径

# 从本地初始化模型

super().__init__()

print("正在从本地加载模型...")

self.tokenizer = AutoTokenizer.from_pretrained(model_path, trust_remote_code=True)

self.model = AutoModelForCausalLM.from_pretrained(model_path, trust_remote_code=True).to(torch.bfloat16).cuda()

self.model = self.model.eval()

print("完成本地模型的加载")

def _call(self, prompt : str, stop: Optional[List[str]] = None,

run_manager: Optional[CallbackManagerForLLMRun] = None,

**kwargs: Any):

# 重写调用函数

system_prompt = """You are an AI assistant whose name is InternLM (书生·浦语).

- InternLM (书生·浦语) is a conversational language model that is developed by Shanghai AI Laboratory (上海人工智能实验室). It is designed to be helpful, honest, and harmless.

- InternLM (书生·浦语) can understand and communicate fluently in the language chosen by the user such as English and 中文.

"""

messages = [(system_prompt, '')]

response, history = self.model.chat(self.tokenizer, prompt , history=messages)

return response

@property

def _llm_type(self) -> str:

return "InternLM"实例化 Web 界面

将上文的代码内容封装为一个返回构建的检索问答链对象的函数,并在启动 Gradio 的第一时间调用该函数得到检索问答链对象,后续直接使用该对象进行问答对话,从而避免重复加载模型:

from langchain.vectorstores import Chroma

from langchain.embeddings.huggingface import HuggingFaceEmbeddings

import os

from LLM import InternLM_LLM

from langchain.prompts import PromptTemplate

from langchain.chains import RetrievalQA

def load_chain():

# 加载问答链

# 定义 Embeddings

embeddings = HuggingFaceEmbeddings(model_name="/root/data/model/sentence-transformer")

# 向量数据库持久化路径

persist_directory = 'data_base/vector_db/chroma'

# 加载数据库

vectordb = Chroma(

persist_directory=persist_directory, # 允许我们将persist_directory目录保存到磁盘上

embedding_function=embeddings

)

# 加载自定义 LLM

llm = InternLM_LLM(model_path = "/root/data/model/Shanghai_AI_Laboratory/internlm-chat-7b")

# 定义一个 Prompt Template

template = """使用以下上下文来回答最后的问题。如果你不知道答案,就说你不知道,不要试图编造答

案。尽量使答案简明扼要。总是在回答的最后说“谢谢你的提问!”。

{context}

问题: {question}

有用的回答:"""

QA_CHAIN_PROMPT = PromptTemplate(input_variables=["context","question"],template=template)

# 运行 chain

qa_chain = RetrievalQA.from_chain_type(llm,retriever=vectordb.as_retriever(),return_source_documents=True,chain_type_kwargs={"prompt":QA_CHAIN_PROMPT})

return qa_chain

class Model_center():

"""

存储检索问答链的对象

"""

def __init__(self):

# 构造函数,加载检索问答链

self.chain = load_chain()

def qa_chain_self_answer(self, question: str, chat_history: list = []):

"""

调用问答链进行回答

"""

if question == None or len(question) < 1:

return "", chat_history

try:

chat_history.append(

(question, self.chain({"query": question})["result"]))

# 将问答结果直接附加到问答历史中,Gradio 会将其展示出来

return "", chat_history

except Exception as e:

return e, chat_history

import gradio as gr

# 实例化核心功能对象

model_center = Model_center()

# 创建一个 Web 界面

block = gr.Blocks()

with block as demo:

with gr.Row(equal_height=True):

with gr.Column(scale=15):

# 展示的页面标题

gr.Markdown("""<h1><center>InternLM</center></h1>

<center>书生浦语</center>

""")

with gr.Row():

with gr.Column(scale=4):

# 创建一个聊天机器人对象

chatbot = gr.Chatbot(height=450, show_copy_button=True)

# 创建一个文本框组件,用于输入 prompt。

msg = gr.Textbox(label="Prompt/问题")

with gr.Row():

# 创建提交按钮。

db_wo_his_btn = gr.Button("Chat")

with gr.Row():

# 创建一个清除按钮,用于清除聊天机器人组件的内容。

clear = gr.ClearButton(

components=[chatbot], value="Clear console")

# 设置按钮的点击事件。当点击时,调用上面定义的 qa_chain_self_answer 函数,并传入用户的消息和聊天历史记录,然后更新文本框和聊天机器人组件。

db_wo_his_btn.click(model_center.qa_chain_self_answer, inputs=[

msg, chatbot], outputs=[msg, chatbot])

gr.Markdown("""提醒:<br>

1. 初始化数据库时间可能较长,请耐心等待。

2. 使用中如果出现异常,将会在文本输入框进行展示,请不要惊慌。 <br>

""")

gr.close_all()

# 直接启动

demo.launch()运行过程如下

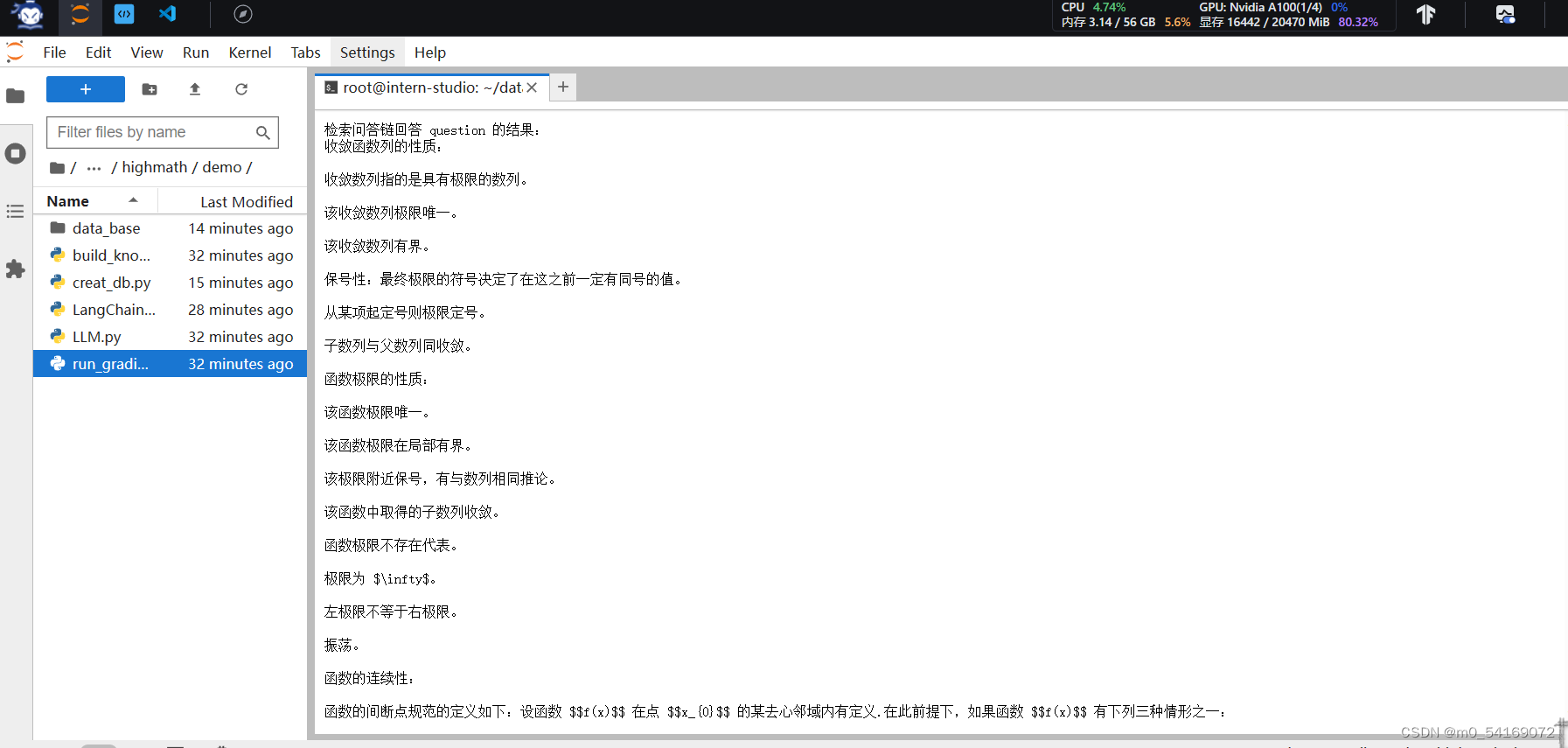

结果如下图所示

进阶作业

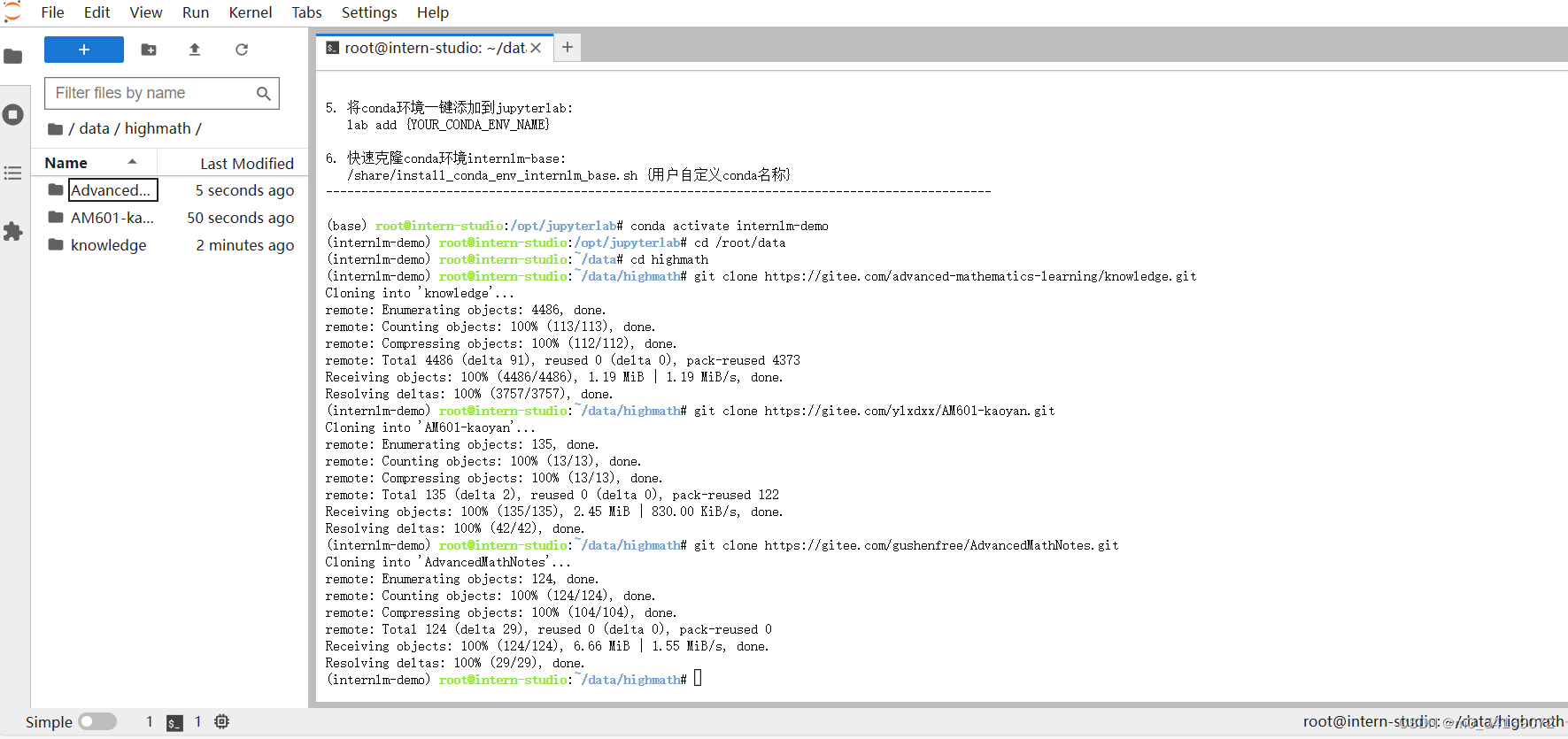

数据集(高等数学)

git clone https://gitee.com/advanced-mathematics-learning/knowledge.git

git clone https://gitee.com/ylxdxx/AM601-kaoyan.git

git clone https://gitee.com/gushenfree/AdvancedMathNotes.git

运行方式与上面知识库搭建运行相同

注意修改目标文件夹

# 目标文件夹

tar_dir = [

"/root/data/highmath/AdvancedMathNotes",

"/root/data/highmath/AM601-kaoyan",

"/root/data/highmath/knowledge"

]运行结果如下图所示

2371

2371

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?