1.数据准备

本文的实验是进行目标检测,数据集以及相关代码我放在了一起,方便今后相似数据集的制作。

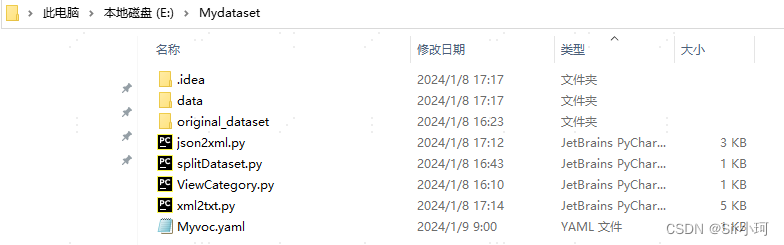

在E盘新建一个Mydataset文件夹(可自定义),如图所示放置四个.py文件,两个数据集文件夹以及一个数据加载配置文件,名称如图所示,.py中的代码下文将逐一给出,.yaml中的内容下文也会给出。

1.1原始数据

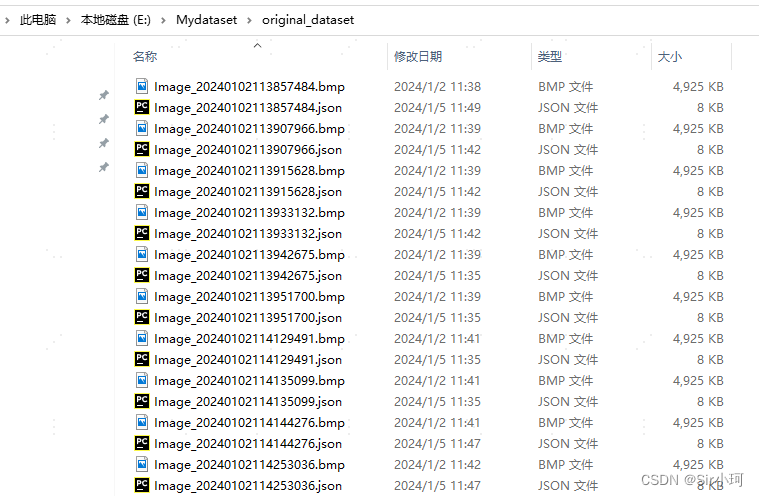

原始数据集如图所示,存放在original_dataset文件夹(可自定义)下,包含了原始图片和利用labelme标注得到的json文件。

1.2待制作数据集(yolov8加载的数据集)

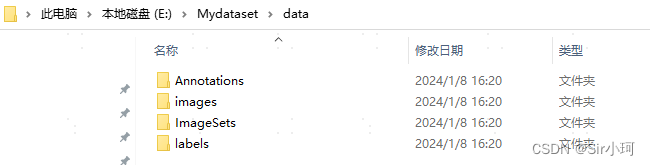

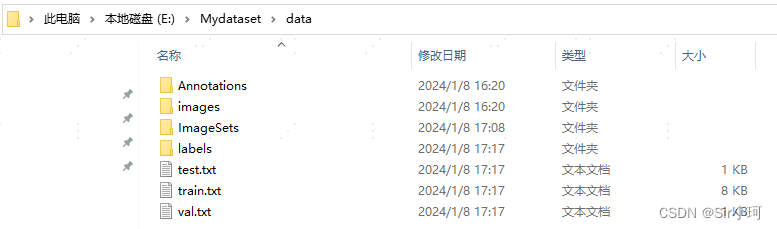

Mydataset文件夹下新建data文件夹(可自定义),再在data目录下新建Annotations, images, ImageSets, labels 四个文件夹。

📌Annotations:存放转换之后图片的xml文件

📌images:存放数据集的图片文件

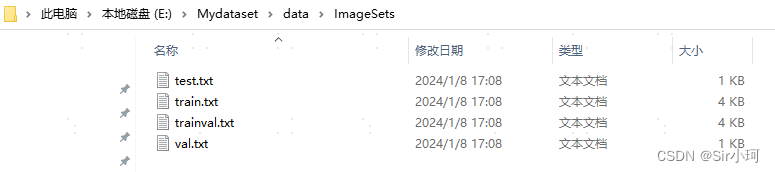

📌ImageSets :存放数据集按比例分割之后自动生成的train.txt,val.txt,test.txt和trainval.txt四个文件

📌labels:存放xml文件转换后的txt标准格式标签

下文将详细介绍每一个文件夹中存放的文件及其制作流程。

2.标签格式转化(json转xml)

由于使用labelme进行标注得到的label是json格式的文件,故需将原始数据集json格式的标签转换为xml格式。

在Mydataset目录下新建一个文件json2xml.py,运行。

📌注意代码第12行中地址labelme_path为原始json、bmp标注数据路径,需要更换成自己的数据集名称。

❗❗❗代码中默认的是读取bmp格式的图像,如果你的原始数据集中是jpg或png格式的图像,需要把json2xml.py代码中所有的“bmp”修改为你自己图像对应的格式,如“jpg”,“png”,该部分代码中有两处需要修改。

📌注意代码第13行中地址saved_path为转换后xml文件的保存路径。

代码如下:

import os

import xml.dom

import numpy as np

import codecs

import json

import glob

import cv2

import shutil

# 1.标签路径

labelme_path = r"E:\Mydataset\original_dataset" # 原始json、bmp标注数据路径,需要更换成自己的数据集名称

saved_path = r"E:\Mydataset\data\Annotations" # 保存路径

# 2.获取待处理文件

files = glob.glob("%s/*.json" % (labelme_path))

# 3.读取标注信息并写入 xml

for json_filename in files:

json_file = json.load(open(json_filename, "r", encoding="utf-8"))

i = 0

# 图像名字,若图像格式不是bmp,需要修改此处

img_name = json_filename.replace(".json", ".bmp")

height, width, channels = cv2.imread(img_name).shape

# xml名字

xmlName = os.path.join(saved_path, json_filename.split("\\")[-1].replace(".json", ".xml"))

with codecs.open(xmlName, "w", "utf-8") as xml:

print(2)

xml.write('<annotation>\n')

xml.write('\t<folder>' + 'bmp' + '</folder>\n')

xml.write('\t<filename>' + img_name + '</filename>\n')

# -------------------------------------------------

xml.write('\t<source>\n')

xml.write('\t\t<database>hulan</database>\n')

# --------------------------------------------------

xml.write('\t</source>\n')

# -----------------------------------------------------------

xml.write('\t<size>\n')

xml.write('\t\t<width>' + str(width) + '</width>\n')

xml.write('\t\t<height>' + str(height) + '</height>\n')

xml.write('\t\t<depth>' + str(channels) + '</depth>\n')

# ------------------------------------------------

xml.write('\t</size>\n')

xml.write('\t\t<segmented>0</segmented>\n')

# 节点判断

for multi in json_file["shapes"]:

points = np.array(multi["points"])

xmin = min(points[:, 0])

xmax = max(points[:, 0])

ymin = min(points[:, 1])

ymax = max(points[:, 1])

label = multi["label"]

if xmax <= xmin:

pass

elif ymax <= ymin:

pass

else:

xml.write('\t<object>\n')

xml.write('\t\t<name>' + json_file["shapes"][i]["label"] + '</name>\n')

xml.write('\t\t<pose>Unspecified</pose>\n')

xml.write('\t\t<truncated>0</truncated>\n')

xml.write('\t\t<difficult>0</difficult>\n')

xml.write('\t\t<bndbox>\n')

xml.write('\t\t\t<xmin>' + str(xmin) + '</xmin>\n')

xml.write('\t\t\t<ymin>' + str(ymin) + '</ymin>\n')

xml.write('\t\t\t<xmax>' + str(xmax) + '</xmax>\n')

xml.write('\t\t\t<ymax>' + str(ymax) + '</ymax>\n')

xml.write('\t\t</bndbox>\n')

xml.write('\t</object>\n')

print(json_filename, xmin, ymin, xmax, ymax, label)

i = i + 1

xml.write('</annotation>')

# 复制图片

newImgName = os.path.join('E:/Mydataset/data/images', img_name.split("\\")[-1])

shutil.copy(img_name, newImgName)

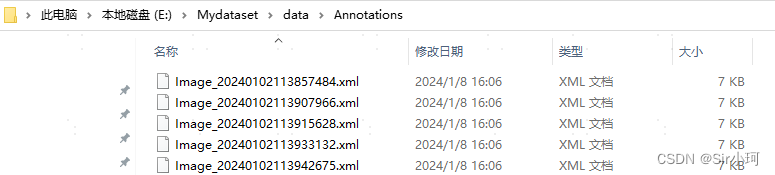

生成的标签存放在Annotations目录下,如图所示。

3.按比例划分数据集

在Mydataset目录下新建一个文件splitDataset.py,运行。

代码如下所示:

import os

import random

trainval_percent = 0.9

train_percent = 0.9

xmlfilepath = 'data/Annotations'

total_xml = os.listdir(xmlfilepath)

num = len(total_xml)

list = range(num)

tv = int(num * trainval_percent)

tr = int(tv * train_percent)

trainval = random.sample(list, tv)

train = random.sample(trainval, tr)

ftrainval = open('data/ImageSets/trainval.txt', 'w')

ftest = open('data/ImageSets/test.txt', 'w')

ftrain = open('data/ImageSets/train.txt', 'w')

fval = open('data/ImageSets/val.txt', 'w')

for i in list:

name = total_xml[i][:-4] + '\n'

if i in trainval:

ftrainval.write(name)

if i in train:

ftrain.write(name)

else:

fval.write(name)

else:

ftest.write(name)

ftrainval.close()

ftrain.close()

fval.close()

ftest.close()

随机分配训练/验证/测试集图片,会在ImageSet 目录下生成四个txt文件,存放训练集、验证集、测试集的划分文件(各集合包含的图片),生成文件如图所示。

4.标签格式转化(xml转txt)

由于yolov8使用的labels是txt格式的文件,故需将原始数据集xml格式的标签转换为txt格式。

即将每个xml标注提取box信息为txt格式,每个图像对应一个txt文件,文件每一行为一个目标的信息,包括class, x_center, y_center, width, height格式。

📌如果数据集中的类别不知道或者比较多不想手敲,可以使用如下脚本直接获取类别,如果不需要可以直接跳过。

数据集类别获取脚本如下:

import xml.dom.minidom as xmldom

import os

# voc数据集获取所有标签的所有类别数"

annotation_path = "./data/Annotations/"

annotation_names = [os.path.join(annotation_path, i) for i in os.listdir(annotation_path)]

labels = list()

for names in annotation_names:

xmlfilepath = names

domobj = xmldom.parse(xmlfilepath)

# 得到元素对象

elementobj = domobj.documentElement

# 获得子标签

subElementObj = elementobj.getElementsByTagName("object")

for s in subElementObj:

label = s.getElementsByTagName("name")[0].firstChild.data

# print(label)

if label not in labels:

labels.append(label)

print(labels)在脚本运行的输出中即可获取数据集的所有类别。

在Mydataset目录下新建一个文件xml2txt.py,运行。

📌注意代码第10行,classes = ['…']一定需要填写自己数据集的类别,在这里我是九个类别:'round', 'square', 'rectangular', 'flat_elliptical', 'mantou', 'groove', 'regular_triangle', 'd_shaped', 'angle'。可从上述脚本输出中将所有种类粘贴至xml2txt.py的对应位置。

📌注意代码第101行,list_file.write('E:/Mydataset/data/images/%s.bmp\n' % (image_id))中的地址要与自己数据所在的地址一致。

❗❗❗代码中默认的是读取bmp格式的图像,如果你的原始数据集中是jpg或png格式的图像,需要把xml2txt.py代码中所有的“bmp”修改为你自己图像对应的格式,如“jpg”,“png”,该部分代码中有一处需要修改,在第101行。

xml2txt.py代码如下:

# xml解析包

import xml.etree.ElementTree as ET

import pickle

import os

from os import listdir, getcwd

from os.path import join

sets = ['train', 'test', 'val']

classes = ['round', 'square', 'rectangular', 'flat_elliptical', 'mantou', 'groove', 'regular_triangle', 'd_shaped', 'angle']

# 进行归一化操作

def convert(size, box): # size:(原图w,原图h) , box:(xmin,xmax,ymin,ymax)

dw = 1./size[0] # 1/w

dh = 1./size[1] # 1/h

x = (box[0] + box[1])/2.0 # 物体在图中的中心点x坐标

y = (box[2] + box[3])/2.0 # 物体在图中的中心点y坐标

w = box[1] - box[0] # 物体实际像素宽度

h = box[3] - box[2] # 物体实际像素高度

x = x*dw # 物体中心点x的坐标比(相当于 x/原图w)

w = w*dw # 物体宽度的宽度比(相当于 w/原图w)

y = y*dh # 物体中心点y的坐标比(相当于 y/原图h)

h = h*dh # 物体宽度的宽度比(相当于 h/原图h)

return (x, y, w, h) # 返回 相对于原图的物体中心点的x坐标比,y坐标比,宽度比,高度比,取值范围[0-1]

# year ='2012', 对应图片的id(文件名)

def convert_annotation(image_id):

'''

将对应文件名的xml文件转化为label文件,xml文件包含了对应的bunding框以及图片长款大小等信息,

通过对其解析,然后进行归一化最终读到label文件中去,也就是说

一张图片文件对应一个xml文件,然后通过解析和归一化,能够将对应的信息保存到唯一一个label文件中去

labal文件中的格式:calss x y w h 同时,一张图片对应的类别有多个,所以对应的bunding的信息也有多个

'''

# 对应的通过year 找到相应的文件夹,并且打开相应image_id的xml文件,其对应bund文件

in_file = open('data/Annotations/%s.xml' % (image_id), encoding='utf-8')

# 准备在对应的image_id 中写入对应的label,分别为

# <object-class> <x> <y> <width> <height>

out_file = open('data/labels/%s.txt' % (image_id), 'w', encoding='utf-8')

# 解析xml文件

tree = ET.parse(in_file)

# 获得对应的键值对

root = tree.getroot()

# 获得图片的尺寸大小

size = root.find('size')

# 如果xml内的标记为空,增加判断条件

if size != None:

# 获得宽

w = int(size.find('width').text)

# 获得高

h = int(size.find('height').text)

# 遍历目标obj

for obj in root.iter('object'):

# 获得difficult ??

difficult = obj.find('difficult').text

# 获得类别 =string 类型

cls = obj.find('name').text

# 如果类别不是对应在我们预定好的class文件中,或difficult==1则跳过

if cls not in classes or int(difficult) == 1:

continue

# 通过类别名称找到id

cls_id = classes.index(cls)

# 找到bndbox 对象

xmlbox = obj.find('bndbox')

# 获取对应的bndbox的数组 = ['xmin','xmax','ymin','ymax']

b = (float(xmlbox.find('xmin').text), float(xmlbox.find('xmax').text), float(xmlbox.find('ymin').text),

float(xmlbox.find('ymax').text))

print(image_id, cls, b)

# 带入进行归一化操作

# w = 宽, h = 高, b= bndbox的数组 = ['xmin','xmax','ymin','ymax']

bb = convert((w, h), b)

# bb 对应的是归一化后的(x,y,w,h)

# 生成 calss x y w h 在label文件中

out_file.write(str(cls_id) + " " + " ".join([str(a) for a in bb]) + '\n')

# 返回当前工作目录

wd = getcwd()

print(wd)

for image_set in sets:

'''

对所有的文件数据集进行遍历

做了两个工作:

1.将所有图片文件都遍历一遍,并且将其所有的全路径都写在对应的txt文件中去,方便定位

2.同时对所有的图片文件进行解析和转化,将其对应的bundingbox 以及类别的信息全部解析写到label 文件中去

最后再通过直接读取文件,就能找到对应的label 信息

'''

# 先找labels文件夹如果不存在则创建

if not os.path.exists('data/labels/'):

os.makedirs('data/labels/')

# 读取在ImageSets/Main 中的train、test..等文件的内容

# 包含对应的文件名称

image_ids = open('data/ImageSets/%s.txt' % (image_set)).read().strip().split()

# 打开对应的2012_train.txt 文件对其进行写入准备

list_file = open('data/%s.txt' % (image_set), 'w')

# 将对应的文件_id以及全路径写进去并换行

for image_id in image_ids:

list_file.write('E:/Mydataset/data/images/%s.bmp\n' % (image_id))

# 调用 year = 年份 image_id = 对应的文件名_id

convert_annotation(image_id)

# 关闭文件

list_file.close()

生成的标签存放在labels目录下,并且在data目录下生成三个txt文件,文件内是训练集、验证集、测试集的图片路径,如图所示。

至此YOLOv8目标检测数据集制作完成。

5.数据集训练

只需在YOLOv8工程中创建数据加载配置文件并配置相关训练参数即可。

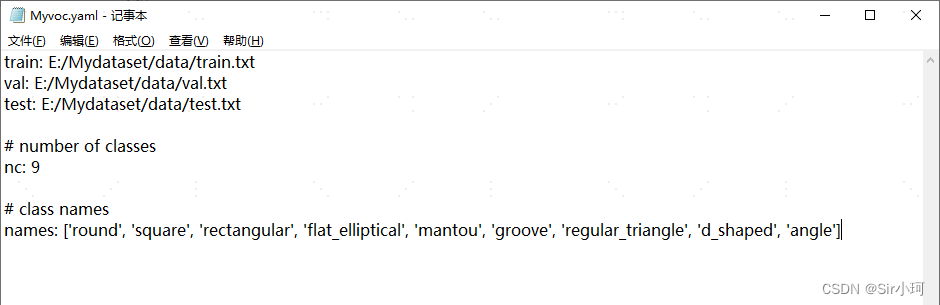

5.1创建数据加载配置文件

在Mydataset文件夹下新建一个Myvoc.yaml文件(可以自定义命名),用来存放训练集、验证集、测试集的路径文件(train.txt、val.txt、test.txt),以上三个文件是在步骤4中生成的路径文件(存放在Mydataset目录下),然后是目标的类别数目和具体类别列表。

Myvoc.yaml文件内容如下:❗❗❗注意txt需要使用绝对路径。

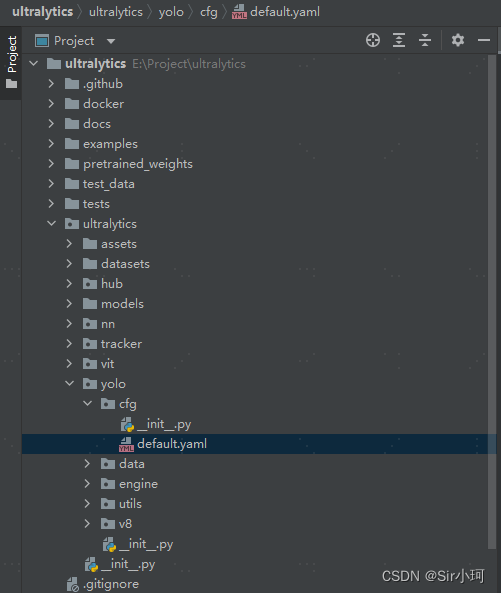

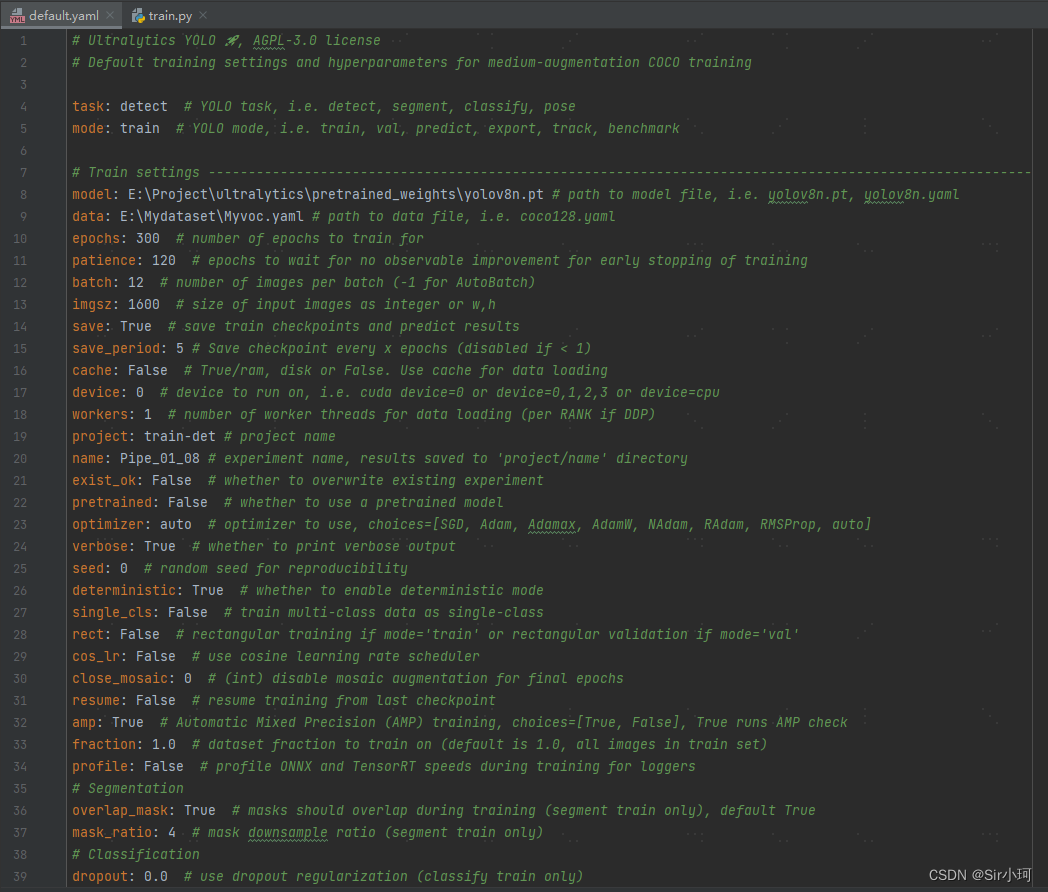

5.2训练参数配置

训练参数文件为yolov8自带的default.yaml文件,在不同版本的yolov8中该文件的位置也略有不同,在本实验中default.yaml文件位置如下图所示。

default.yaml文件内容如下:

以上常用参数解释如下:

📌task:选择任务类型,可选['detect', 'segment', 'classify', 'pose']。

📌mode: 选择是训练、验证、预测和导出模型等,可选['train', 'val', 'predict', 'export', 'track', 'benchmark']。

📌model: 选择yolov8不同的模型配置文件,可选yolov8s.pt、yolov8m.pt、yolov8x.pt等(提供了n、s、m、l、x版本,随着架构的增大,训练时间也是逐渐增大,需要根据自身设备硬件配置合理选择)。

❗❗❗注意model最好去github上提前下载好,放在如图所示的指定位置,如果没提前下载运行时会自动下载,但是下载速度可能非常非常慢。

yolov8目标检测权重合集下载地址:

https://download.csdn.net/download/m0_57010556/89214755?spm=1001.2014.3001.5503

📌data: 选择生成的数据集配置文件。

📌epochs:训练过程中整个数据集的迭代次数。

📌batch:一次看完多少张图片才进行权重更新,梯度下降的mini-batch,提示爆显存就需要调小一点。

📌imgsz:输入图片的尺寸大小。

📌workers:用于数据加载的工作线程数。

📌project:训练工程名称。

📌name:保存训练结果的文件夹名称。

📌resume:从最后一个检查点恢复训练,即模型训练的断点接续,可选False或True。

5.3Yolov8详细参数逐行解读

# YOLO 🚀, AGPL-3.0 许可证

# 用于中等增强COCO训练的默认训练设置和超参数

task: detect # (str) YOLO任务,例如检测、分割、分类、姿态

mode: train # (str) YOLO模式,例如训练、验证、预测、导出、跟踪、基准测试

# 训练设置 -------------------------------------------------------------------------------------------------------

model: # (str, 可选) 模型文件路径,例如 yolov8n.pt, yolov8n.yaml

data: # (str, 可选) 数据文件路径,例如 coco128.yaml

epochs: 100 # (int) 训练轮次数

time: # (float, 可选) 训练时间,如果提供,将覆盖epochs

patience: 50 # (int) 早停等待轮次,对于没有可观察改进的训练早期停止

batch: 16 # (int) 每批次的图像数量(-1表示自动批次)

imgsz: 640 # (int | list) 训练和验证模式的输入图像大小为int,或预测和导出模式的list[w,h]

save: True # (bool) 保存训练检查点和预测结果

save_period: -1 # (int) 每x轮次保存一次检查点(如果<1则禁用)

cache: False # (bool) True/ram, disk 或 False。使用缓存加载数据

device: # (int | str | list, 可选) 运行设备,例如 cuda device=0 或 device=0,1,2,3 或 device=cpu

workers: 8 # (int) 数据加载的工作线程数(如果DDP,则为每个RANK)

project: # (str, 可选) 项目名称

name: # (str, 可选) 实验名称,结果保存在'project/name'目录

exist_ok: False # (bool) 是否覆盖现有实验

pretrained: True # (bool | str) 是否使用预训练模型(bool)或从中加载权重的模型(str)

optimizer: auto # (str) 使用的优化器,可选项=[SGD, Adam, Adamax, AdamW, NAdam, RAdam, RMSProp, auto]

verbose: True # (bool) 是否打印详细输出

seed: 0 # (int) 可重复性的随机种子

deterministic: True # (bool) 是否启用确定模式

single_cls: False # (bool) 将多类数据作为单类训练

rect: False # (bool) 如果模式为'train'则矩形训练,如果模式为'val'则矩形验证

cos_lr: False # (bool) 使用余弦学习率调度器

close_mosaic: 10 # (int) 在最后几轮禁用mosaic增强(0表示禁用)

resume: False # (bool) 从最后一个检查点恢复训练

amp: True # (bool) 自动混合精度(AMP)训练,可选项=[True, False],True表示运行AMP检查

fraction: 1.0 # (float) 训练数据集的分数(默认为1.0,训练集中的所有图像)

profile: False # (bool) 在训练期间为记录器分析ONNX和TensorRT速度

freeze: None # (int | list, 可选) 在训练期间冻结前n层,或冻结层索引列表

multi_scale: False # (bool) 训练期间是否使用多尺度

# 分割

overlap_mask: True # (bool) 训练期间掩码应重叠(仅限分割训练)

mask_ratio: 4 # (int) 掩码降采样比率(仅限分割训练)

# 分类

dropout: 0.0 # (float) 使用dropout正则化(仅限分类训练)

# 验证/测试设置 ----------------------------------------------------------------------------------------------------

val: True # (bool) 在训练期间进行验证/测试

split: val # (str) 用于验证的数据集分割,例如 'val', 'test' 或 'train'

save_json: False # (bool) 将结果保存为JSON文件

save_hybrid: False # (bool) 保存标签的混合版本(标签 + 额外预测)

conf: # (float, 可选) 检测的对象置信度阈值(预测默认0.25,验证默认0.001)

iou: 0.7 # (float) NMS的交并比(IoU)阈值

max_det: 300 # (int) 每张图片的最大检测数量

half: False # (bool) 使用半精度(FP16)

dnn: False # (bool) 使用OpenCV DNN进行ONNX推理

plots: True # (bool) 在训练/验证期间保存图表和图像

# 预测设置 -----------------------------------------------------------------------------------------------------

source: # (str, 可选) 图像或视频的源目录

vid_stride: 1 # (int) 视频帧率步长

stream_buffer: False # (bool) 缓冲所有流媒体帧(True)或返回最近的帧(False)

visualize: False # (bool) 可视化模型特征

augment: False # (bool) 对预测源应用图像增强

agnostic_nms: False # (bool) 类不可知NMS

classes: # (int | list[int], 可选) 通过类过滤结果,例如 classes=0, 或 classes=[0,2,3]

retina_masks: False # (bool) 使用高分辨率分割掩码

embed: # (list[int], 可选) 从给定层返回特征向量/嵌入

# 可视化设置 ---------------------------------------------------------------------------------------------------

show: False # (bool) 如果环境允许,显示预测的图像和视频

save_frames: False # (bool) 保存预测的视频帧

save_txt: False # (bool) 将结果保存为.txt文件

save_conf: False # (bool) 保存带有置信度分数的结果

save_crop: False # (bool) 保存带有结果的裁剪图像

show_labels: True # (bool) 显示预测标签,例如 'person'

show_conf: True # (bool) 显示预测置信度,例如 '0.99'

show_boxes: True # (bool) 显示预测框

line_width: # (int, 可选) 边框的线宽。如果为None,则根据图像大小缩放。

# 导出设置 ------------------------------------------------------------------------------------------------------

format: torchscript # (str) 导出的格式,选项参考 https://docs.ultwithzeyu.com/modes/export/#export-formats

keras: False # (bool) 使用Keras

optimize: False # (bool) TorchScript:为移动端优化

int8: False # (bool) CoreML/TF INT8量化

dynamic: False # (bool) ONNX/TF/TensorRT:动态轴

simplify: False # (bool) ONNX:简化模型

opset: # (int, 可选) ONNX:opset版本

workspace: 4 # (int) TensorRT:工作空间大小(GB)

nms: False # (bool) CoreML:添加NMS

# 超参数 ------------------------------------------------------------------------------------------------------

lr0: 0.01 # (float) 初始学习率(例如SGD=1E-2, Adam=1E-3)

lrf: 0.01 # (float) 最终学习率(lr0 * lrf)

momentum: 0.937 # (float) SGD动量/Adam beta1

weight_decay: 0.0005 # (float) 优化器权重衰减5e-4

warmup_epochs: 3.0 # (float) 预热轮数(小数可)

warmup_momentum: 0.8 # (float) 预热初始动量

warmup_bias_lr: 0.1 # (float) 预热初始偏差学习率

box: 7.5 # (float) 盒子损失增益

cls: 0.5 # (float) 分类损失增益(与像素比例)

dfl: 1.5 # (float) dfl损失增益

pose: 12.0 # (float) 姿态损失增益

kobj: 1.0 # (float) 关键点对象损失增益

label_smoothing: 0.0 # (float) 标签平滑(比例)

nbs: 64 # (int) 名义批次大小

hsv_h: 0.015 # (float) 图像HSV-色调增强(比例)

hsv_s: 0.7 # (float) 图像HSV-饱和度增强(比例)

hsv_v: 0.4 # (float) 图像HSV-值增强(比例)

degrees: 0.0 # (float) 图像旋转(+/-度)

translate: 0.1 # (float) 图像平移(+/-比例)

scale: 0.5 # (float) 图像缩放(+/-增益)

shear: 0.0 # (float) 图像剪切(+/-度)

perspective: 0.0 # (float) 图像透视(+/-比例),范围0-0.001

flipud: 0.0 # (float) 图像上下翻转(概率)

fliplr: 0.5 # (float) 图像左右翻转(概率)

mosaic: 1.0 # (float) 图像马赛克(概率)

mixup: 0.0 # (float) 图像混合(概率)

copy_paste: 0.0 # (float) 分割复制粘贴(概率)

auto_augment: randaugment # (str) 分类的自动增强策略(randaugment, autoaugment, augmix)

erasing: 0.4 # (float) 分类训练期间随机擦除的概率(0-1)

crop_fraction: 1.0 # (float) 分类评估/推理的图像裁剪比例(0-1)

# 自定义config.yaml ---------------------------------------------------------------------------------------------------

cfg: # (str, 可选) 用于覆盖defaults.yaml

# 跟踪器设置 ------------------------------------------------------------------------------------------------------

tracker: botsort.yaml # (str) 跟踪器类型,选项=[botsort.yaml, bytetrack.yaml]5.4模型训练

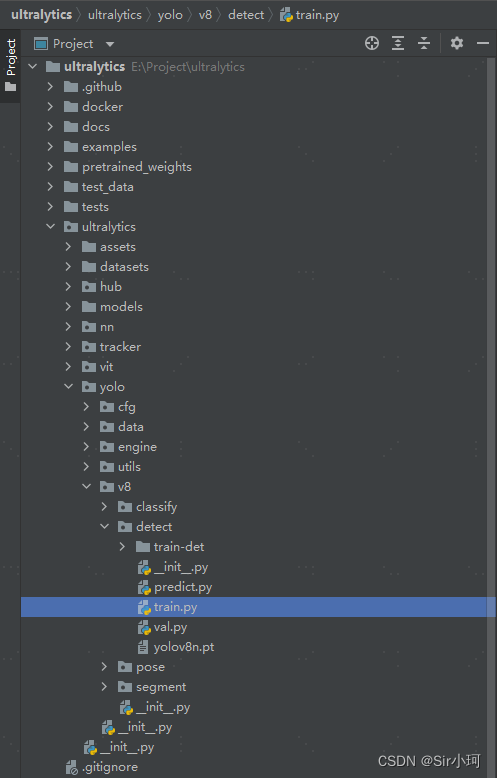

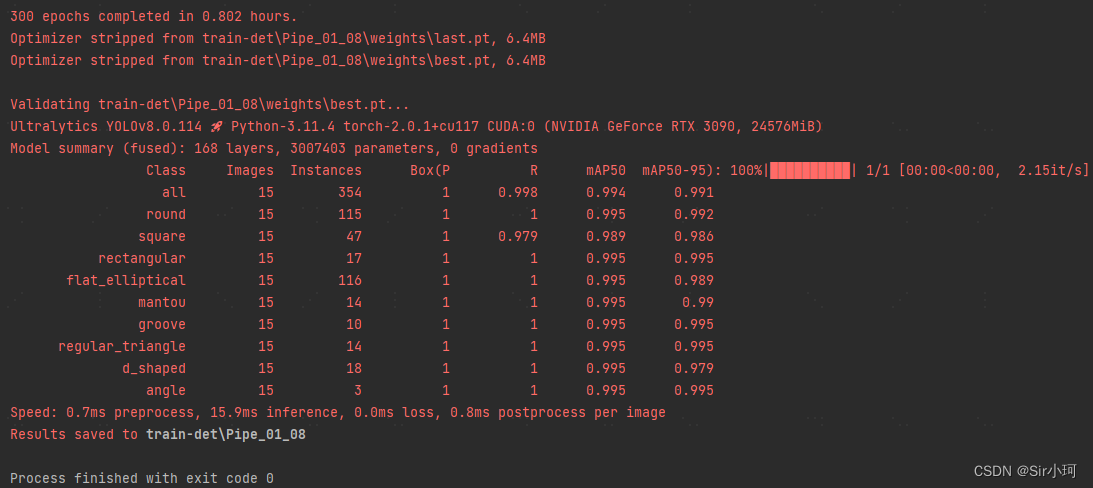

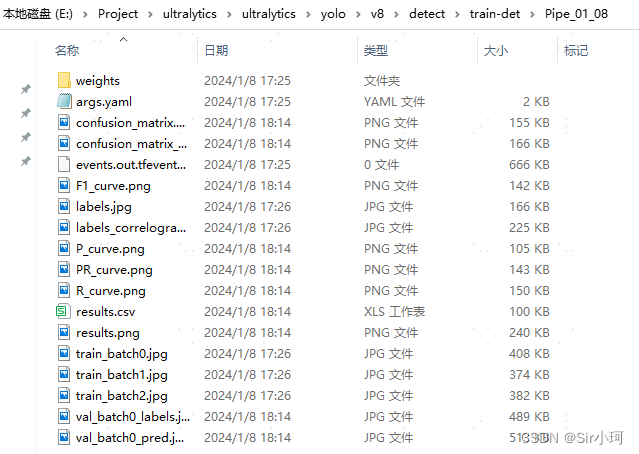

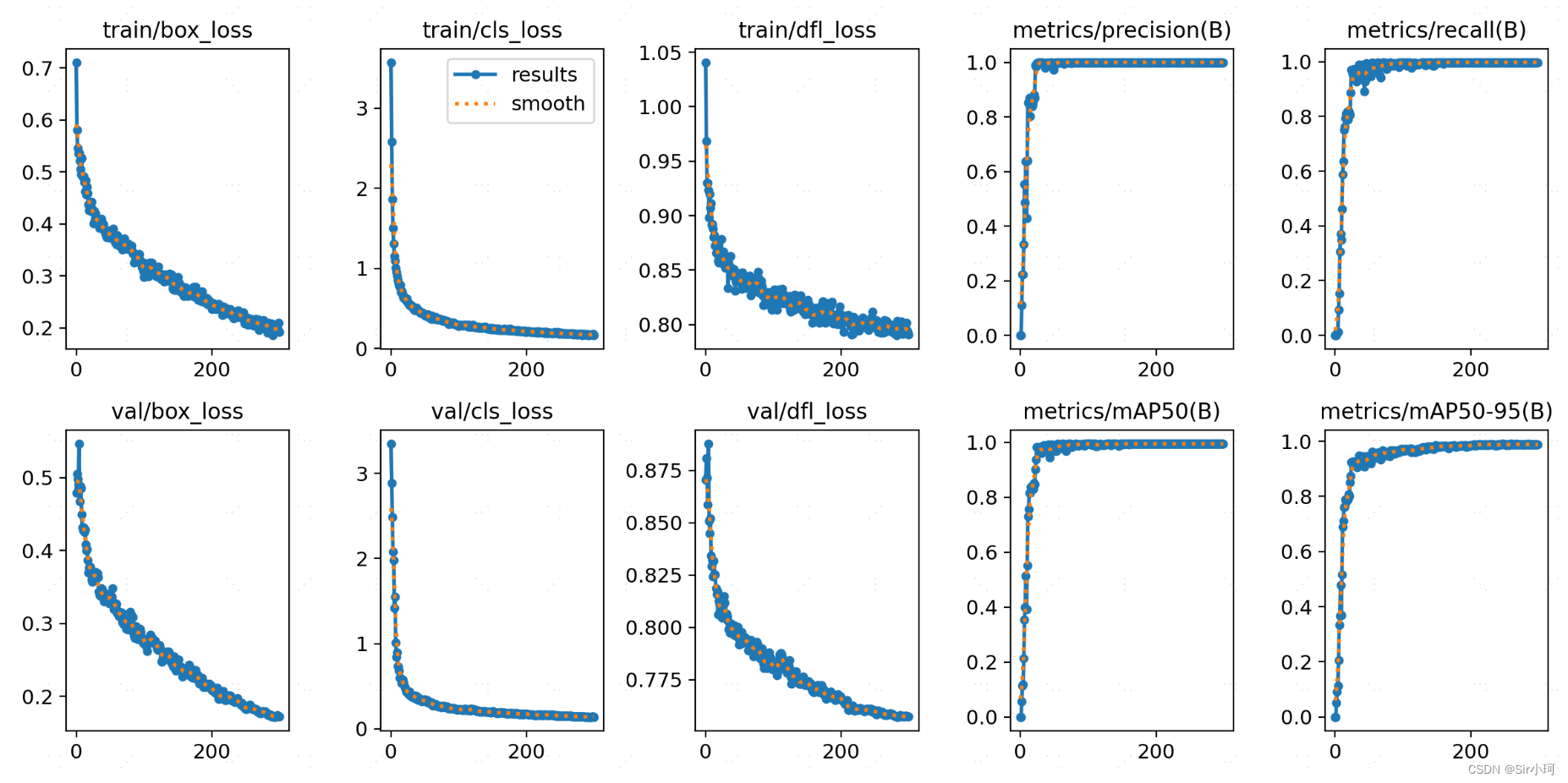

在配置好上述参数后,找到detect下的train.py文件,运行(文件路径如图所示,不同版本文件位置有所差异,也可使用命令行进行运行)。

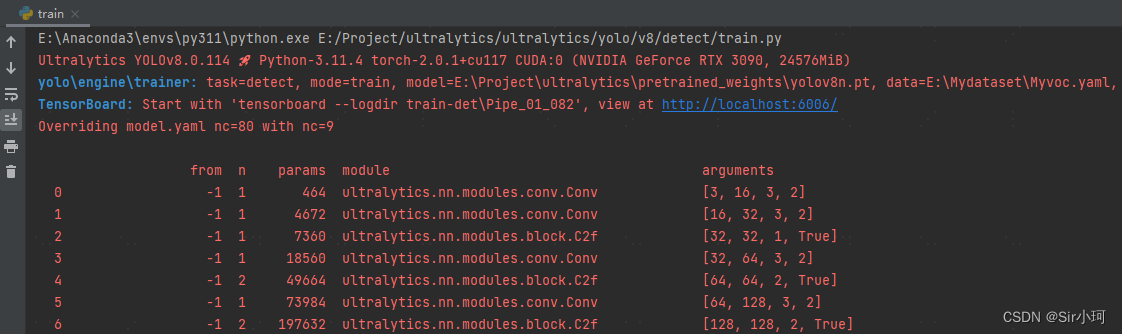

开始训练

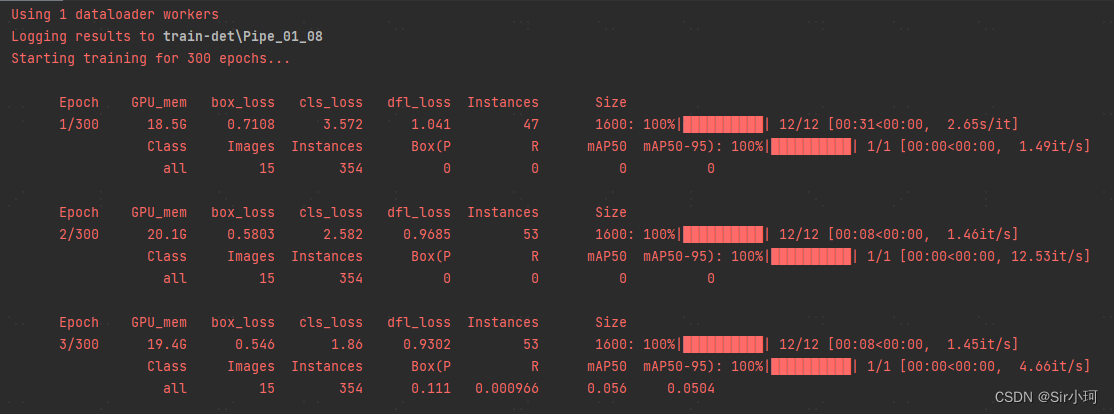

训练过程

查看结果

nice,结束!

另外,如果有想了解yolov8实例分割数据集制作以及YOLOv8目标检测 opencv模型部署的小伙伴可以移步我的其他文章

5万+

5万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?