目录

一、简单线性回归

简单线性回归,即样本特征只有一个,二维空间就是横轴为特征,纵轴为标签。如果有多个特征,则需要在三维或更高维的空间显示。简单线性回归问题就是找到一个最小化二乘法问题,即最小化误差的平方,目标是找到a和b,使得最小化误差的平方尽可能小。

二、简单线性回归实现

1、导入相关包

import numpy as np

import matplotlib.pyplot as plt

2、传入数据集

x = np.array([1.,2.,3.,4.,5.])

y = np.array([1.,3.,2.,3.,5.])

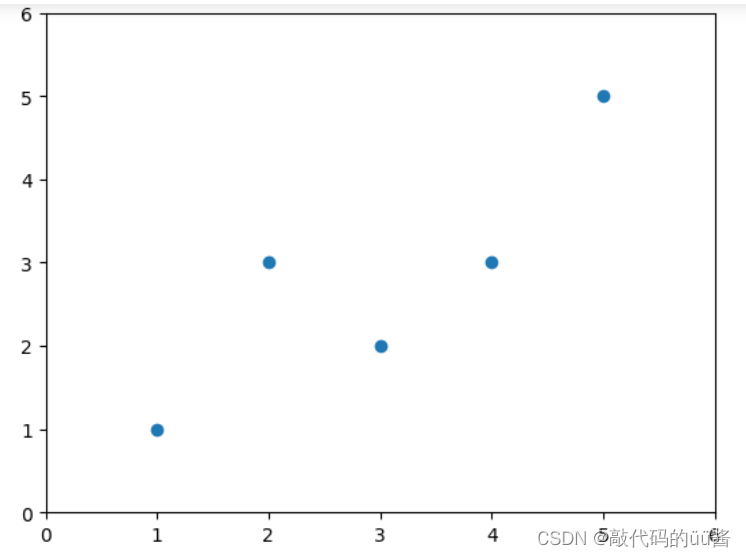

3、查看数据集分散情况

plt.scatter(x,y)

plt.axis([0,6,0,6])

plt.show()

执行结果:

4、求均值

x_mean = np.mean(x)

y_mean = np.mean(y)

num = 0.0 #分子

d = 0.0 #分母

for x_i,y_i in zip(x,y): #表示每次从该向量中各取一个值

num += (x_i - x_mean) * (y_i - y_mean)

d += (x_i - x_mean) ** 2

5、找到a和b

a = num / d

b = y_mean - a * x_mean

y_hat = a * x + b

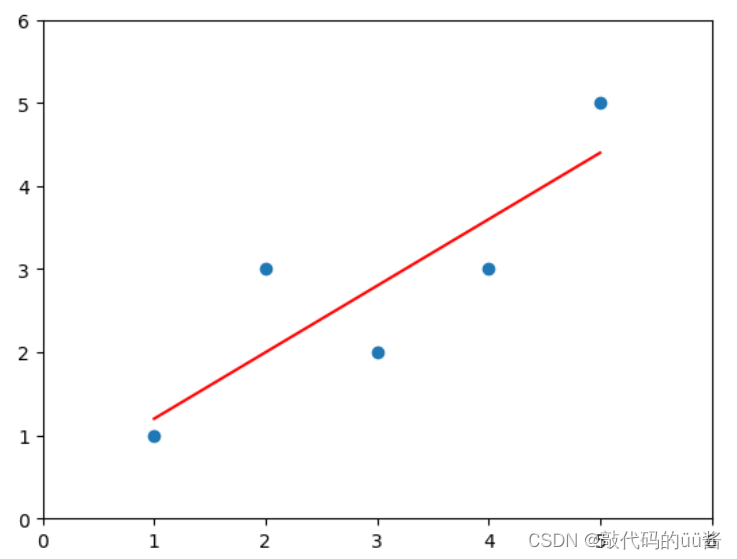

6、查看线性回归分布情况

plt.scatter(x,y)

plt.plot(x,y_hat,color='r')

plt.axis([0,6,0,6])

plt.show()

执行结果:

6、预测

x_predict = 6

y_predict = a * x_predict + b

三、向量化实现性能测试

1、数据集准备

m = 1000000

big_x = np.random.random(size=m)

big_y = big_x * 2.0 + 3.0 + np.random.normal(size=m)

x_mean = np.mean(big_x)

y_mean = np.mean(big_y)

2、最小二乘法

%%time

num = 0.0 #分子

d = 0.0 #分母

for x_i,y_i in zip(big_x,big_y): #表示每次从该向量中各取一个值

num += (x_i - x_mean) * (y_i - y_mean)

d += (x_i - x_mean) ** 2

运行结果:

3、向量化

%%time

num = (big_x - x_mean).dot(big_y - y_mean) #分子进行点乘

d = (big_x - x_mean).dot(big_x - x_mean) #分母

运行结果:

对比两者运行结果可知,经过向量化算法性能会更好。

3524

3524

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?