当我们在图片进行处理的时候,把图片中某一部分进行替换,是一个非常常见的需求。今天就结合Flux和最新的FILL模型来讲一讲局部重绘。

我们先来“搞点艺术”,以戴珍珠耳环的少女为素材来做一个流程演示!最后“上点技能”给复联女神来设计一下发型,服装和…

下面我就一步一步来说,你一点一点看,只要稍微花点时间,所有人都能做到。

这份完整版的comfyui整合包已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

准备工作

软件

开始之前,需要先准备好ComfyUI软件本体,可以网页版也可以是桌面版。

确保把版本升级到最新。

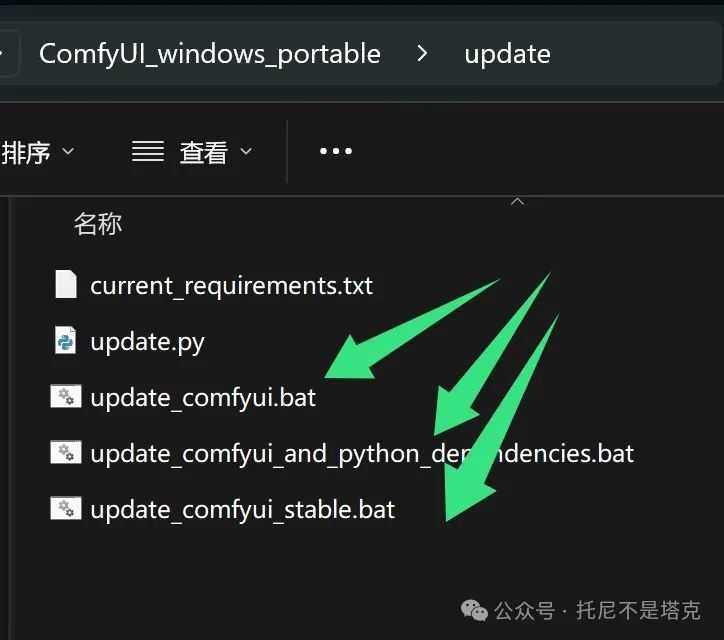

我这次使用的是ComfyUI网页版,可以通过软件目录下update中的bat脚本进行升级。

基本上点箭头中的三个升级脚本都可以。

我是点击第二个,升级代码和依赖。

模型

模型是核心部分,用的是黑森林在21号发布的FLUX.1 Tools中的fill模型。

这个模型全名为:flux1-fill-dev.safetensors,大小为22GB左右。

FILL最先进的图像修复和图像外绘模型,能够在给定文本描述和遮罩的情况下对真实图像和生成图像进行编辑和扩展。

从描述中可以知道,他的功能有两个,一个是修复(局部重绘),一个是外绘(扩图)。

FILL的操作对象可以是生成图和也可以是真实图片。这个就很强,很好用!

具体有多强,可以往下看。

今天主要讲局部重绘。

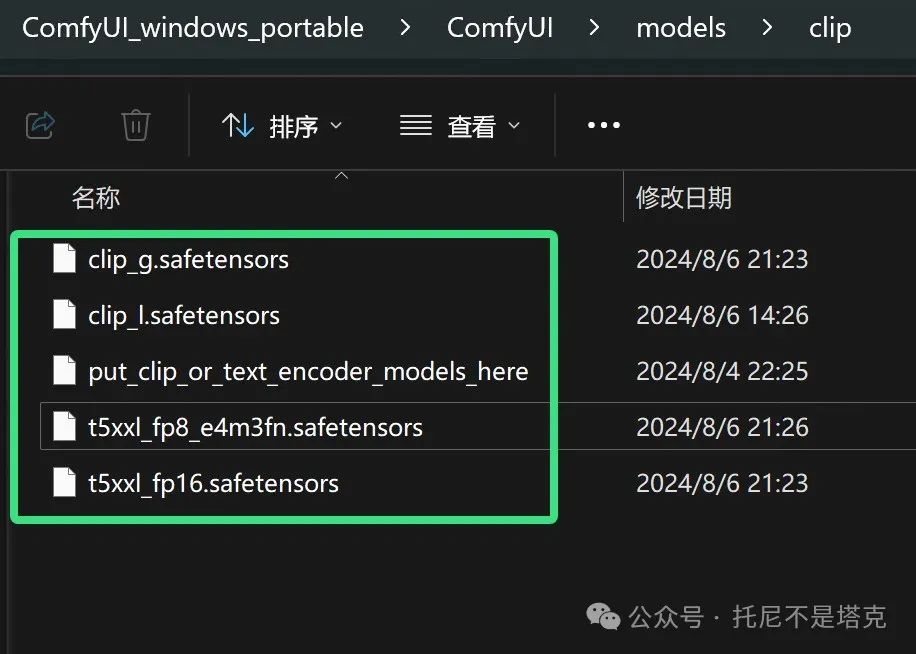

除了FILL模型之外,还需要配套的CLIP和VAE模型。如果之前运行过FLUX工作流,肯定已经有了这个模型。如果没有运行过,就需要单独去下载一下。

工作流

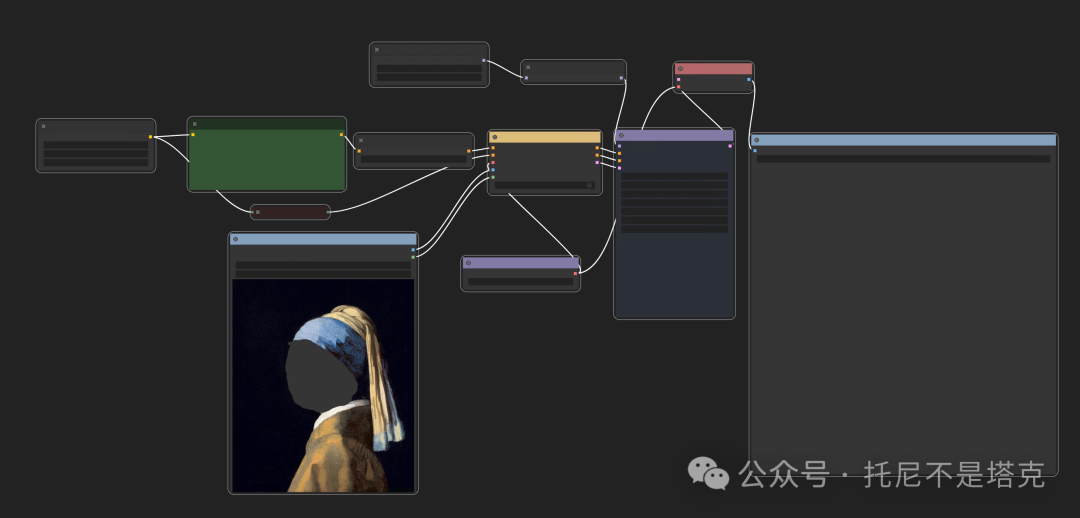

FILL的工作流并不复杂。

主要的输入为Fill和Clip模型,以及文字描述和需要重绘的图片。输出就是重绘完成之后的图片。工作流可以保存在图片和JSON文件中。

开始干活

软件,模型,工作流都准备好之后,就可以开始干活了。

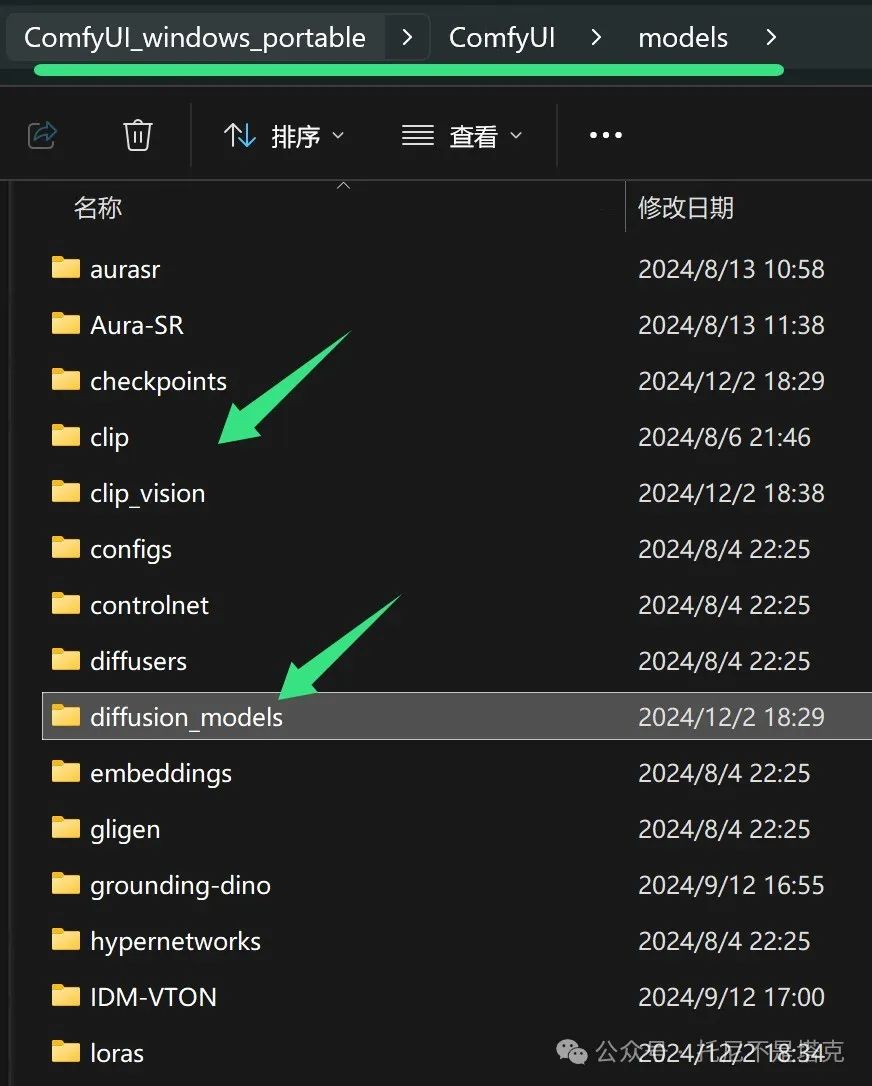

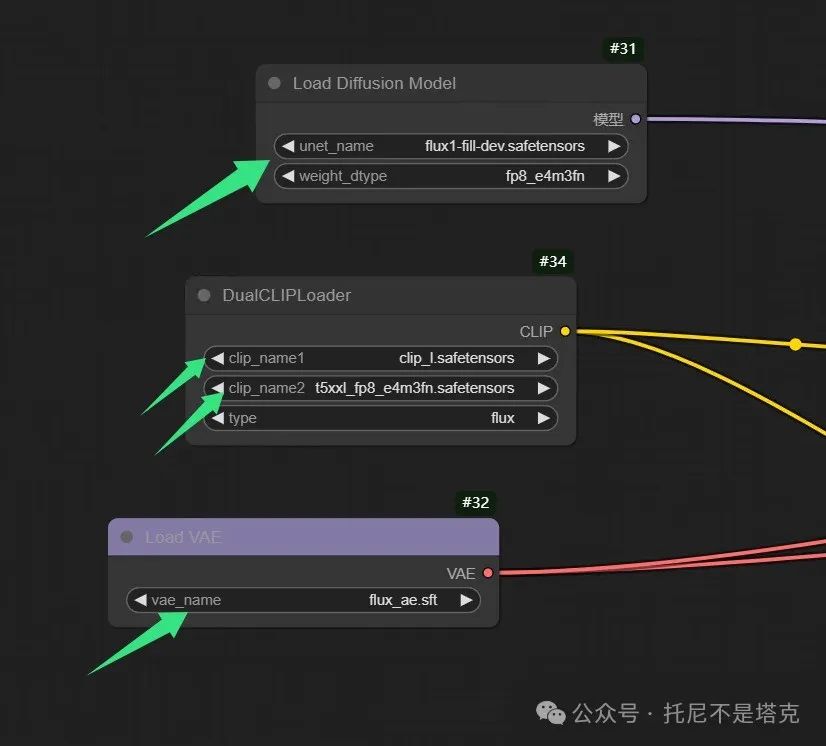

1️⃣模型归位

把flux1-fill-dev.safetensors放到diffusion_models文件夹里面。

把flux_ae.sft模型放到Vae文件夹里面。

把clip模型,放到clip文件夹下面。

简简单单,复制黏贴,模型就的放置就搞定了。

2️⃣模型选择

模型放好后,双击run_nvidia_gpu启动软件,启动成功后导入工作流。只需要把工作流的JSON文件拖到软件上即可导入。

导入工作流流之后,其实默认就帮你设置好了模型。但是本地模型的名称和工作流里的模型名称可能不一致,所以需要检查一下,选择正确的模型。点击选项或者左右三角形可以选择模型。

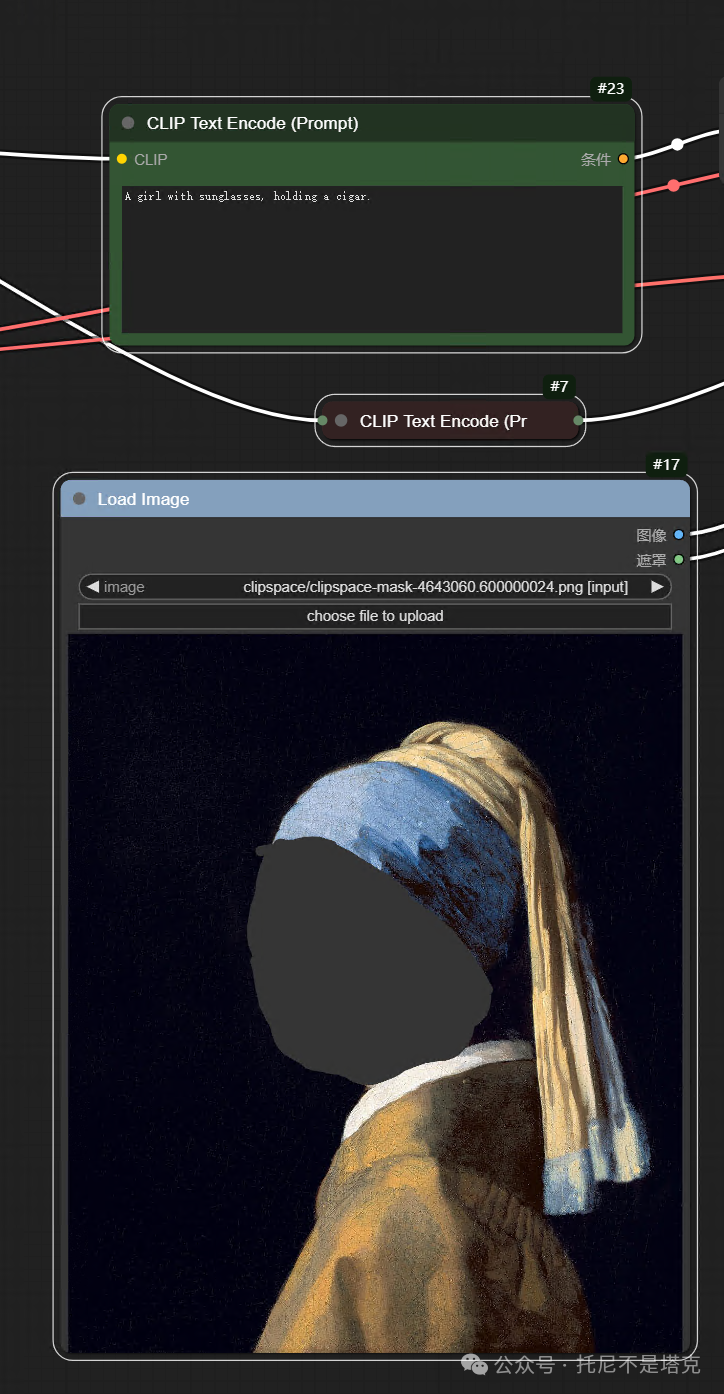

3️⃣图片和提示词

我们的目标是修改图片,自然要先选择好图片,另外需要用文字描述去控制修改的内容,所以也要准备好提示词。

图片直接从网上拉一张就好了,提示词很简单:“A girl with sunglasses,holding a ciger.”。

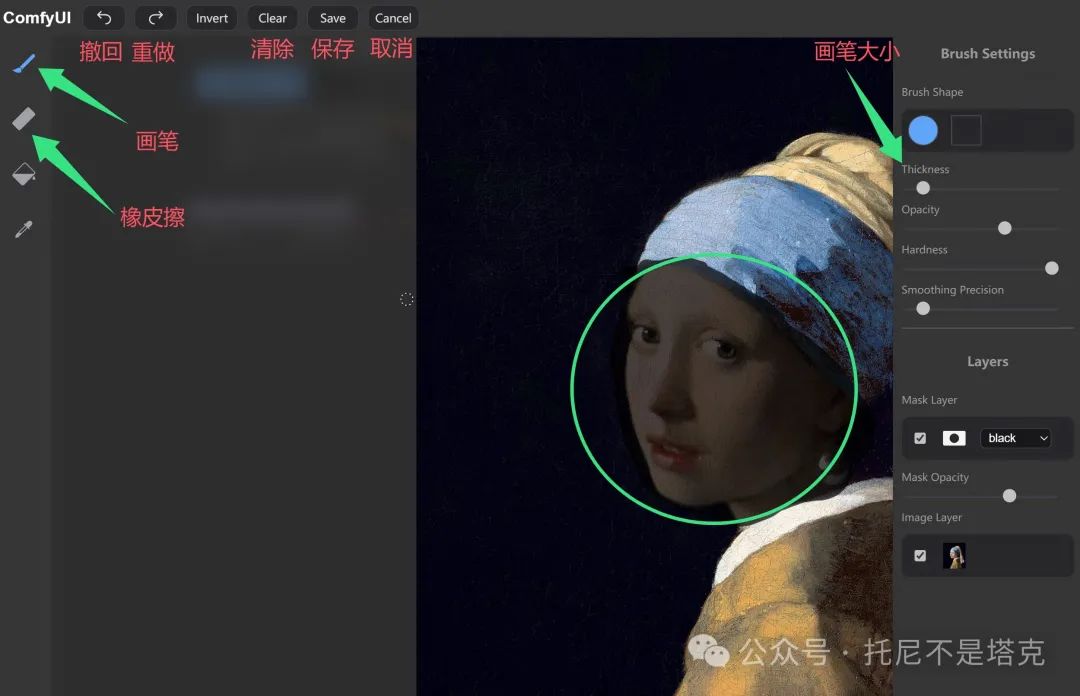

因为是局部替换,所以还需要标注替换区域。

在图片节点上右键,点击Open in MuskEditor, 打开遮罩编辑器。点击左键涂抹需要替换的区域。如果涂错了可以选择橡皮擦擦除。涂好后,点击Save保存。

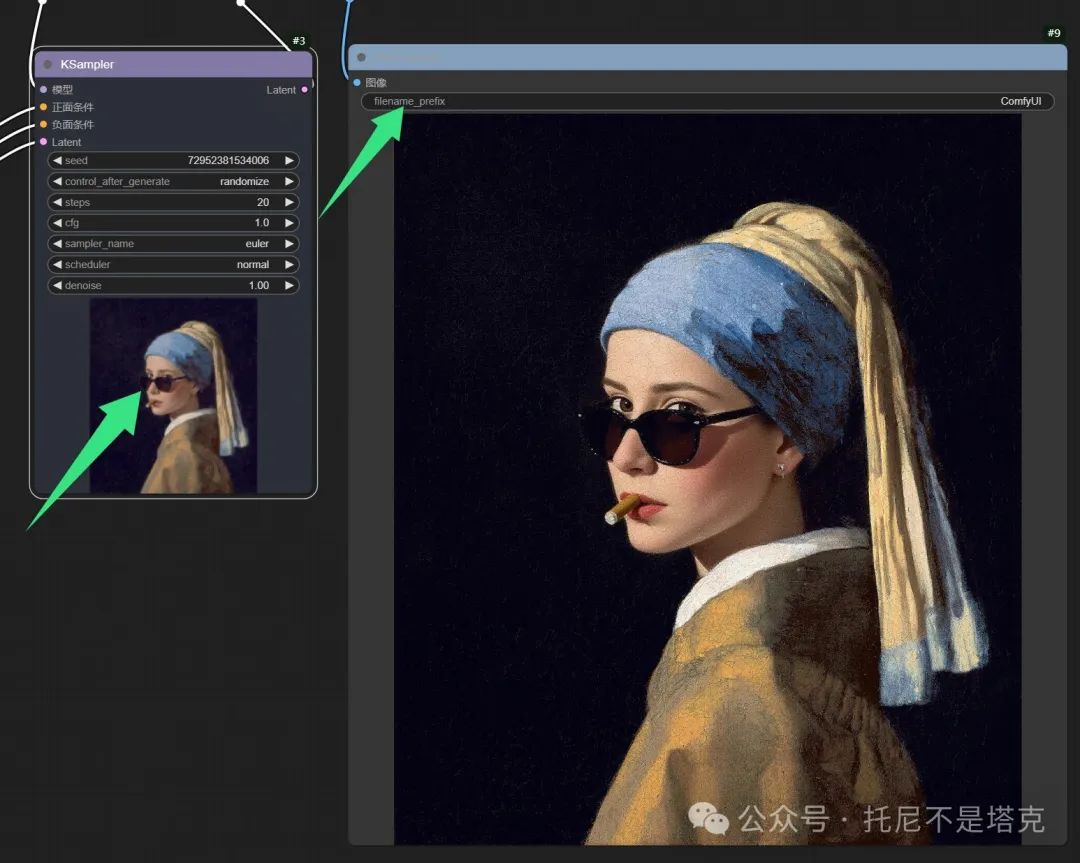

4️⃣开始生成

设置全部完成,开始一键出图,反复抽卡。

点击蓝色的Queqe按钮,开始生成图片。

我这里用的图片分辨率是1200x1400,还是挺大的。

这张图片在3090上生重绘时间大概是82秒左右。

5️⃣查看结果

图片生成过程会实时显示在左边的节点中。

运行完全结束之后,右边的节点会显示最终的图片。同时把图片保存到了output文件中。

下面来看下细节。

边缘毫无PS痕迹,完美融合。

物理裂痕都完美的复刻了。

稳定性很高,不需要抽太多次,就能抽到效果不错的图片。

这张图唯一的瑕疵是,嘴巴叼雪茄这里不太自然。但是因为这个眼睛不错,我就用这张图做演示了。

除了可以戴眼镜,叼雪茄之外,也可以:

变小孩,变中年妇女,变非洲人,也可以给脸上来点小蝴蝶印记。

除了无法保证角色一致性之外,就生成效果来说真的是非常棒👍。

流程的演示就到这里了。

只要软件,模型,工作流到位,接下来就是点一下的问题了。

其他全部交给强大的FLUX FILL模型了。

下面再做一些其他图片的效果演示,给大家一个参考!

我用AI生成的图片试了下,效果如下:

能看出来是都是什么小动物么?

最后用真人图片来试一下,模特是我们妇联女神“黑寡妇”的扮演者斯嘉丽·约翰逊。

我的ID叫托尼,但是我一般不让人叫我“老师”。这两个词一连起来就有一股奇怪的味道😄

今天破个例,给寡姐弄点造型。

先从头发做起。

发型,发色都要搞一搞。

衣服也要换一下:

不同场合,可以用不同深度的衣服。

这个短裙和腿也可以换一换:

皮裤,黑丝,小碎花。可纯可性感。

换一点不得劲儿,那就来个套装:

材质,颜色,款式,大小,任君把握!

为了给她做全套造型,我整整抽了一天的图,抽得头晕眼花。

能发出来的我就发出来了,不能发出来的就自己收藏了啊!

软件怎么用我全部说了,使用场景我只是演示了很小的一部分,其他就靠大家发挥想象了。

FLUX这次发布的模型除了Fill之外,还有Canny,Depth,Redux。每一个都有特定的应用场景,每一个都要比之前的强很多,配合上comfyUI,就可以做到出图“自主可控”了。

这份完整版的comfyui整合包已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

2408

2408

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?