High-Resolution Image Synthesis with Latent Diffusion Models

论文相关信息:

文章基本结构:

High-Resolution Image Synthesis with Latent Diffusion Models Abstract

1.Introduction Democratizing High-Resolution Image Synthesis

Departure to Latent Space

2.Related Work

Generative Models for Image Synthesis

Diffusion Probabilistic Models (DM)

Two-Stage Image Synthesis

3.Method

3.1Perceptual Image Compression

3.2Latent Diffusion Models

3.3Conditioning Mechanisms

4.Experiments

4.1On Perceptual Compression Tradeoffs

4.2Image Generation with Latent Diffusion

4.3Conditional Latent Diffusion

4.4Super-Resolution with Latent Diffusion

4.5Inpainting with Latent Diffusion

5.Conclusion

References

文章背景:

稳定扩散生成模型(Stable Diffusion)是一种潜在的文本到图像扩散模型,能够在给定任何文本输入的情况下生成照片般逼真的图像 Stable Diffusion 是基于latent-diffusion 并与 Stability AI and Runway合作实现的;本文是Stable Diffusion的基础论文。

需要先了解的概念

扩散模型如何应用在图像中(Diffusion Models) 扩散模型包括两个过程:前向过程(forward process)和反向过程(reverse process), 其中前向过程又称为扩散过程(diffusion process)。 扩散过程是指的对数据逐渐增加高斯噪音直至数据变成随机噪音的过程。

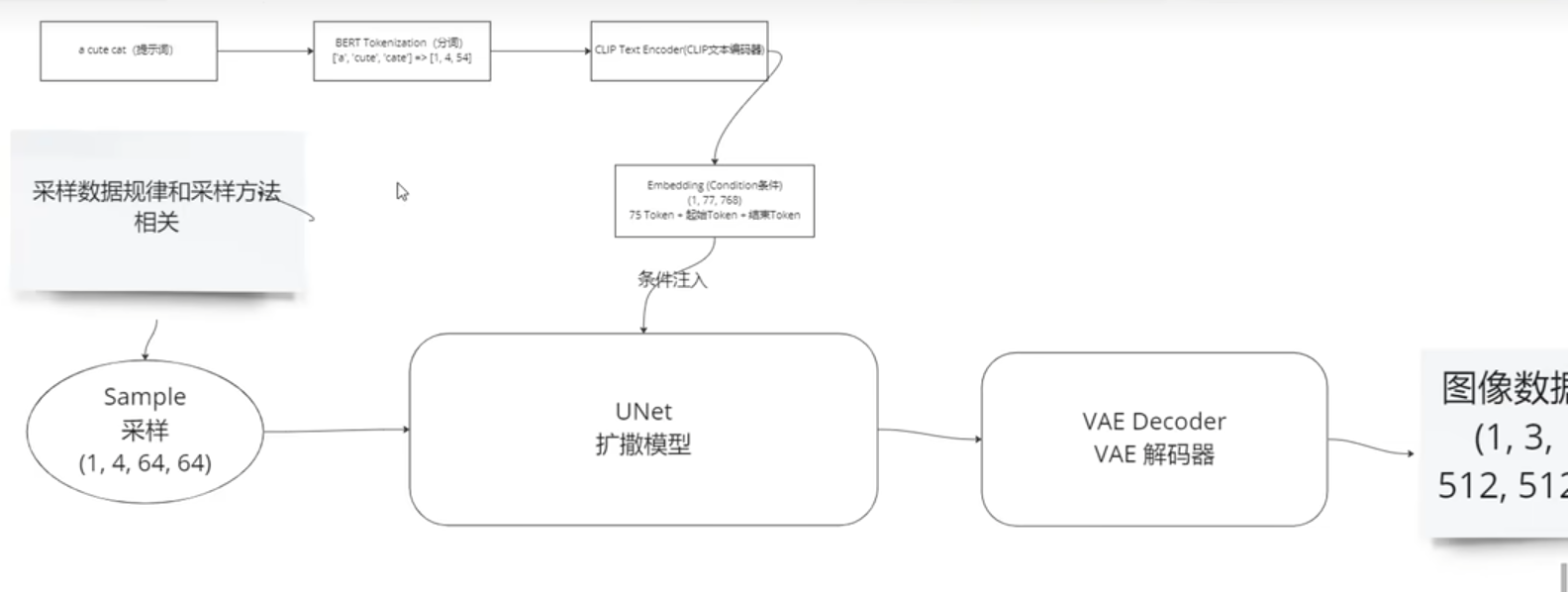

什么是 latent-diffusion模型? diffusion 与 latent-diffusion的区别,可以理解为 diffusion直接在原图进行图片的去噪处理,是基于像素空间的,而 latend-diffusion 是图像经过VAE编码器压缩的图像,进行diffusion处理,然后再通过解码器,对压缩后的latent 编码还原为图像。

VAE 自编码器是一类相似的模型,它们通过编码器Encoder将输入数据映射到低维的潜在表示空间,然后再通过解码器Decoder将这个低维表示还原回原始数据。整个编码-解码的过程旨在学习输入数据的潜在结构,以便于重建数据和生成新的样本。

变分自编码器VAE则是自编码器的一种变体,它使用了贝叶斯定理,通过学习潜在变量Latent variable的分布,从而学习原始数据的分布。为了训练 VAE,需要最大化一个较复杂的目标函数,它由一个最大化数据似然的项和一个正则化项组成。正则化项通常使用KL散度来度量潜在变量的分布和标准正态分布之间的差异。

文章解读:

Abstract:

通过将图像生成过程分解为去噪编码器的迭代应用,扩散模型(DMs)在图像数据和其他数据上实现了最先进的合成结果。此外,它们的表述还提供了一种引导机制来控制图像生成过程,而无需再训练。然而,由于这些模型通常直接在像素空间中操作,优化功能强大的dm通常会消耗数百个GPU天,而且由于顺序计算,推理是昂贵的(耗时)。为了在有限的计算资源上进行DM训练,同时保持其质量和灵活性,我们将其应用于强大的预训练预编码的潜在空间。与以前的工作相比,在这种表示上训练扩散模型首次允许在复杂性减少和细节保留之间达到一个接近最优点,极大地提高了视觉保真度。通过在模型架构中引入交叉注意层,我们将扩散模型转变为强大而灵活的生成器,用于文本或边界框等一般条件反射输入,并以卷积方式实现高分辨率合成。我们的潜在扩散模型(ldm)在图像嵌入和类条件图像合成方面取得了最新的分数,在各种任务上具有极具竞争力的性能,包括文本到图像合成、无条件图像生成和超分辨率,同时与基于单像素的DMs相比显著减少了计算需求。

1.Introduction

目前的大背景:

目前复杂自然场景的高分辨率图像合成,主要由基于似然模型进行缩放,其中自回归(AR)和tranformer包含数十亿个参数,参数量太大 ;GAN的对抗性学习过程不容易扩展到建模复杂的多模态分布,仅限于变异性相对有限的数据分布。

扩散模型,这是建立在一个去噪自动编码器的层次,已经表明令人不可思议的成果。 作为基于似然的模型,它们不像GAN那样表现出模式崩溃和训练不稳定性,并且通过大量利用参数共享,它们可以模拟自然图像的高度复杂的分布,而不像AR模型那样涉及数十亿个参数。

不足之处: 此前的高分辨率图像合成DMs属于基于似然的模型,其模式行为使其易于在建模数据的不可感知细节上花费过多的容量(以及计算资源)。尽管重加权变分目标旨在通过对初始去噪步骤采样不足来解决这一问题,DMs仍然需要大量的计算,因为训练和评估这样的模型需要在RGB图像的高维空间中重复函数评估(和梯度计算)。 例如,训练最强大的dm通常需要数百个GPU/天,并且在输入空间渲染的噪声版本上重复计算也非常昂贵。在单个A100 GPU上生成50k样本大约需要5天。评估一个已经准备好的训练模型在时间和内存上也是昂贵的,因为相同的模型架构必须按顺序运行大量的步骤。

提出问题: 为了提高这种强大的模型的可访问性,同时降低其巨大的资源消耗,需要一种降低训练和采样计算复杂度的方法。因此,减少 DM 的计算需求而不影响其性能是提高其可访问性的关键。

解决方法:

Departure to Latent Space(脱离并去往潜在空间)

与任何基于似然的模型一样,学习大致可以分为两个阶段: 第一阶段是感知压缩阶段,它去除了高频细节,但仍然学习到很少的语义变化。在第二阶段,实际的生成模型学习数据的语义和概念组成(语义压缩)。因此,我们的目标是首先找到一个感知上等同,但计算上更合适的空间,在这里我们将为高分辨率图像合成训练扩散模型。

方法的优点: 只需要训练通用自动编码阶段一次,因此可以重用它进行多个 DM 训练或探索可能完全不同的任务。这使得对各种图像到图像和文本到图像任务的大量扩散模型的有效探索成为可能。对于后者,我们设计了一个架构,将transformer连接到 DM 的 UNet 主干 ,并支持任意类型的基于条件的调节机制。

Contributions: 1、与纯粹基于transformer的方法相比,我们的方法可以更优雅地扩展到更高维数据,因此可以在压缩级别上工作,其提供比以前的工作更有效的应用于高分辨率图像生成方面。

2、我们在多任务(无条件图像合成、修补、随机超分辨率)数据集上获得了具有竞争力的性能,同时显著降低了计算成本。与基于像素的扩散方法相比,我们也显著降低了推理成本。

3、我们的结果表明,与之前的工作相比,我们的方法不需要对重构和生成能力进行精确的加权。这确保了非常忠实的重建,需要非常少的潜空间正则化。

4、我们发现,对于超分辨率、修补和语义合成等高密度条件任务,我们的模型可以以卷积的方式应用,渲染出大的、一致的1024*1024像素的高分图像。

5、此外,我们设计了一个基于交叉注意的通用条件反射机制,使得多模态训练成为可能。我们使用它来训练类条件模型、文本到图像模型和布局到图像模型。

2.Related Work

Generative Models for Image Synthesis

Diffusion Probabilistic Models (DM)

DM在密度估计和样品质量方面取得了最先进的结果。这些模型的生成能力源于对类图像数据的归纳偏差的自然拟合,当其底层神经主干作为UNet实现时。当使用重新加权的目标进行训练时,通常可以获得最佳的合成质量。在这种情况下,DM对应于有损压缩器,并允许以图像质量换取压缩能力。然而,在像素空间中评估和优化这些模型具有推理速度低和训练成本高的缺点。虽然前者可以通过高级采样策略和分层方法部分解决,但在高分辨率图像数据上进行训练总是需要计算昂贵的梯度。我们用我们提出的ldm解决了这两个缺点,它在低维的压缩潜在空间上工作。这使得训练在计算上更便宜,并且在几乎不降低合成质量的情况下加速了推理。

生成图的效果与Dalle-e 、VQGAN比较

IS分数(Inception Score):衡量图像质量和多样性 IS分数,越高越好

FID距离(弗雷彻特初始距离):衡量图像质量和多样性 FID值,越小越好

Two-Stage Image Synthesis

为了缓解单个生成方法的缺点,大量研究通过两阶段方法将不同方法的优点结合成更有效的生成模型。

3.Method

Perceptual Image Compression

由于扩散模型需要复杂昂贵的损失函数来在像素空间评估效果,所以仍然需要很大的计算时间和计算资源。

我们通过引入压缩和生成学习阶段的显式分离来规避这一缺陷。为了实现这一目标,我们使用了一个自编码模型,该模型学习的空间在感知上与图像空间等效,但显著降低了计算复杂度。

所以,对潜在模型空间的要求:

-

和像素空间在感知上等价

-

计算量更低

-

能够用于训练可以实现高分辨率图生成的扩散模型

-

-

类似于其他的基于概率的模型,前缀空间的学习也分为两个阶段

-

第一个阶段是【感知压缩阶段,Perceptual Compression】:用于去除高频细节,学习少量的语义信息

-

第二个阶段是【语义压缩阶段,Semantic Compression】:使用生成模型学习数据的语义和概念

使用潜在空间的优势:

-

显著降低了复杂度

-

通过将图像转换到低维空间,可以获得计算更高效的扩散模型

-

能够利用从 UNet 架构中继承而来的扩散模型的归纳偏差,使得对具有特殊结构的数据很有效

-

得到的通用的压缩模型可用于训练多种不同的生成模型,也可以用于下游任务

Latent Diffusion Models

Conditioning Mechanisms(调节机制)

第一阶段:训练VAE

第二阶段:训练UNet扩散模型

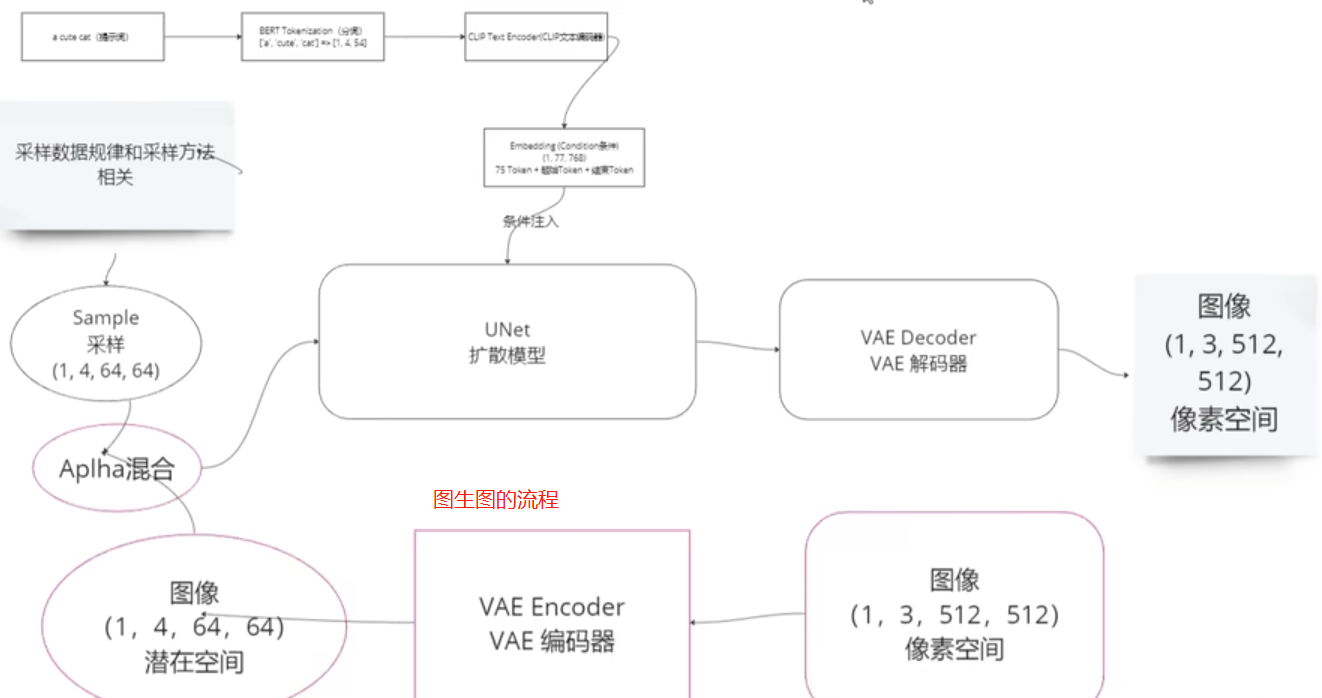

文生图:

CLIP工作原理:

图生图:

优点:

通过自动编码器(Autoencoder, AE)压缩数据,将扩散过程在隐空间(Latent Space)进行,极大地减小了扩散模型的计算量,并保持生成图片的质量不变。

这种方法的另一个显著优势是,自编码器只需训练一次或采用预训练的模型,因此可以将其用于训练多次DM完全不同的任务。这使得对各种图像到图像和文本到图像任务的大量扩散模型的有效探索成为可能。

4.Experiments

本文实验主要验证了LDMs(Latent Diffusion Models)模型的性能。本文设计了大量的对比实验,分别对压缩比率因子、隐空间有效性、条件扩散进行了验证。并测试了该模型在超分辨率、图像修复等任务中的表现。

实验一:感知压缩权衡(Perceptual Compression Tradeoffs)

调整AE中encoder下采样f,如果f=1那就等于没有对输入进行压缩,本文对比了f在{1,2,4, 8, 16, 32}下的效果,如果f越大,则信息压缩越严重,会造成图片失真,但是训练资源则占用越少,反之f约小则训练的会越慢。对比实验的结果如下图所示。

可见,f在{4-16}之间可以比较好的平衡效率与视觉感知效果。作者重点推荐了LDM-4和LDM-8。

实验二:对比生成图片的质量(Image Generation with Latent Diffusion)

本文对LDMs的样本生成能力从两方面进行对比实验,一是生成样本的质量,二是生成样本的多样性。实验数据使用的是CelebA-HQ、FFHQ和LSUN-Churches/Bedrooms,实验结果如下图所示。

其效果超过了GANs和LSGM,并且对于比同为扩散模型的DDPM效果要好,与ADM的效果接近,说明了隐空间的确保留了主要的特征信息。

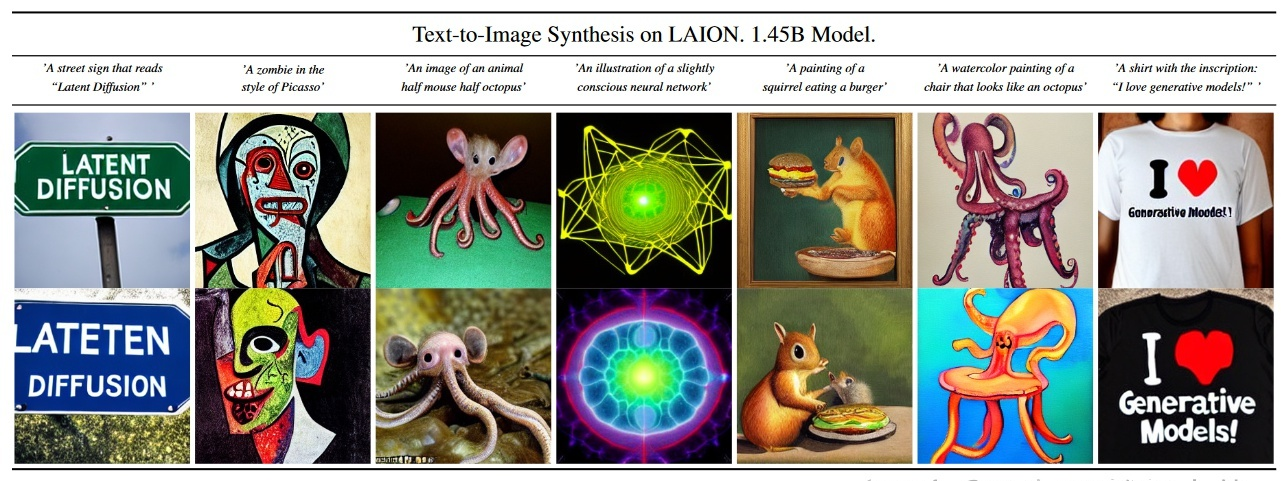

实验三:条件扩散(Conditional Latent Diffusion)

本文通过在Unet模型结构上添加交叉注意力机制的方式可以适配多类条件的图像生成任务,例如text-to-image任务上,训练数据为LAION-400M,文章展示了实验结果如下:

text-to-image图像生成:

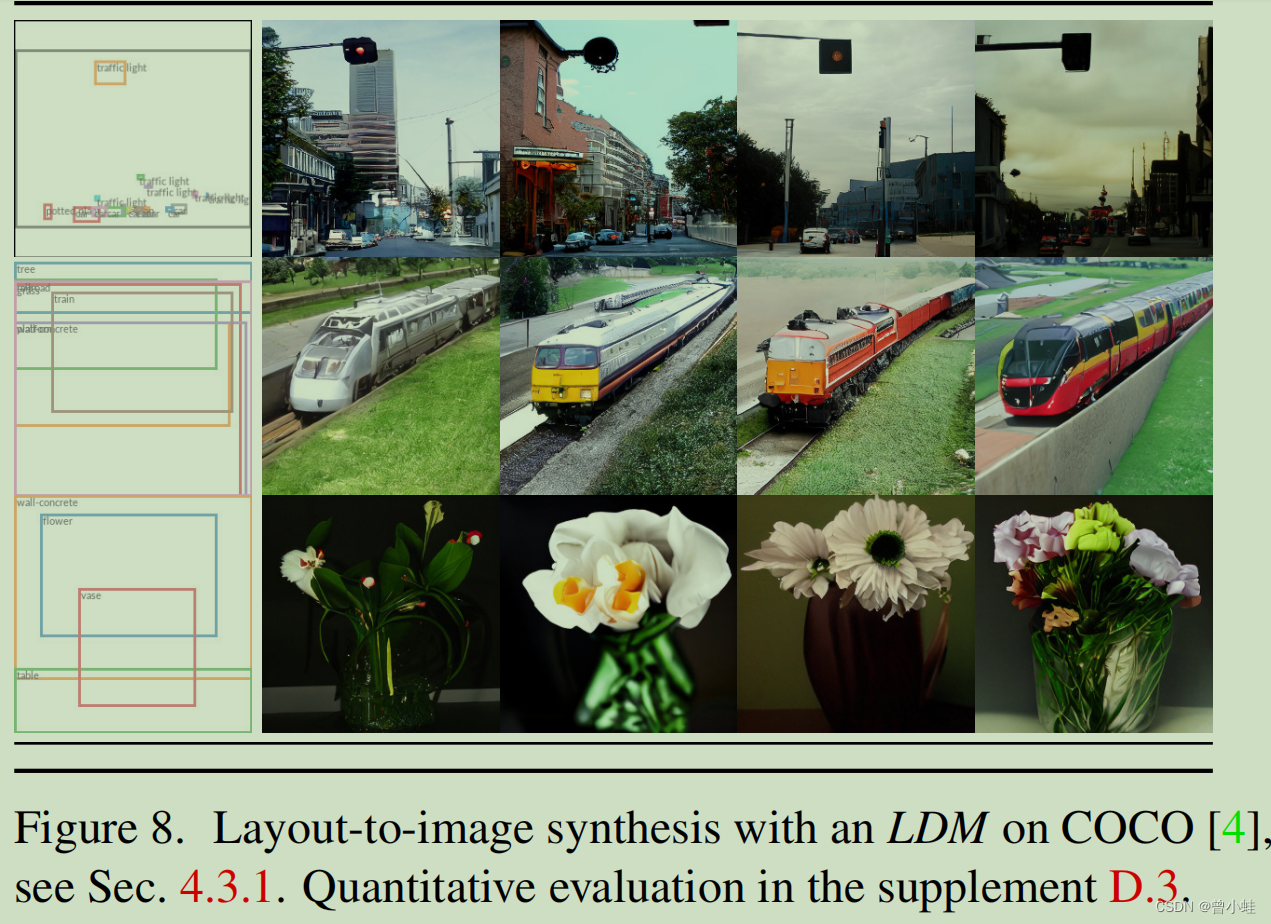

使用 layout 来指导图像生成:

实验四:模型的通用性(Super-Resolution with Latent Diffusion、Inpainting with Latent Diffusion)

作者测试了LDMs在根据语义信息生成图像、图像超分辨率及图像修复等应用方向上的性能,均取得了极佳的效果。

使用语义像素图来生成更大分辨率的真实图像:

从 64x64 px 超分辨重建 256x256px 的图像:

大众偏好:

任务1:向受试者展示基本事实和生成的图像,并询问他们的偏好。

任务2:受试者必须在两个生成的图像之间做出选择。

图像修复、移除目标的效果:

LPIPS(Learned Perceptual Image Pattern Similarity,学习感知图像模式相似性)是一种用于评估图像质量的客观指标。它是一种基于深度学习的方法,用于衡量两幅图像之间的相似性。

图像修复结果:

5.Conclusion

-

LDMs可以显著提高去噪扩散模型的训练和采样效率,而不降低模型的质量。

-

LDMs可以在诸多图像生成任务中显示出优于先有方法的性能。

简而言之,潜在扩散模型:

-

将图像从像素空间转换到更低维的潜在空间

-

在潜在空间进行相关计算所需的计算量更少,效率更高

-

最后使用解码器从潜在空间复原到像素空间即可

总结不足之处:

LDMs模型仍是一个大模型,有着高达859M的参数量。 模型生成的图片中存在许多“似是而非”的物体,说明模型并不真正理解各个物体的形态,可以通过更细致的标签或是引入先验的物体结构模型解决这一问题。 生成的图片中有的并不符合在空间结构上的客观规律。针对这一问题,可以将扩散模型与NeRF相结合,将二维图像升维成三维结构后再投影到二维来解决遮挡等空间推理问题。

413

413

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?