是的,深度学习需要大量的计算资源,尤其是对于大规模的数据集和复杂的神经网络模型。使用GPU(图形处理器)是深度学习中非常常见的做法,因为GPU可以并行处理大量的计算操作,提高计算速度和效率。

深度学习用什么显卡?

通常,深度学习需要使用专业的显卡,例如NVIDIA公司的CUDA显卡。这些显卡具有高度的并行计算能力,能够在计算机上执行高效的并行计算,提供更快的训练速度和更好的性能。

然而,如果你仅仅是进行一些小规模的深度学习实验或者使用较简单的神经网络模型,那么使用CPU也是可以的。但是,对于更大规模和更复杂的任务,使用GPU会更加高效。

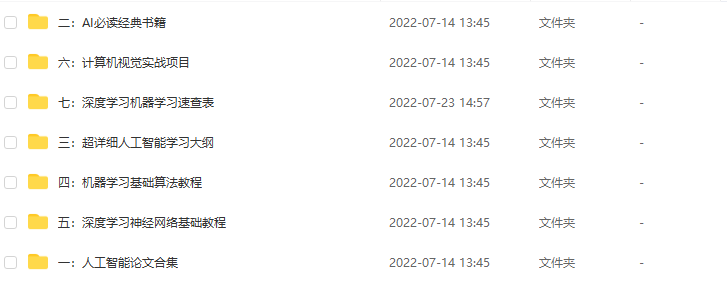

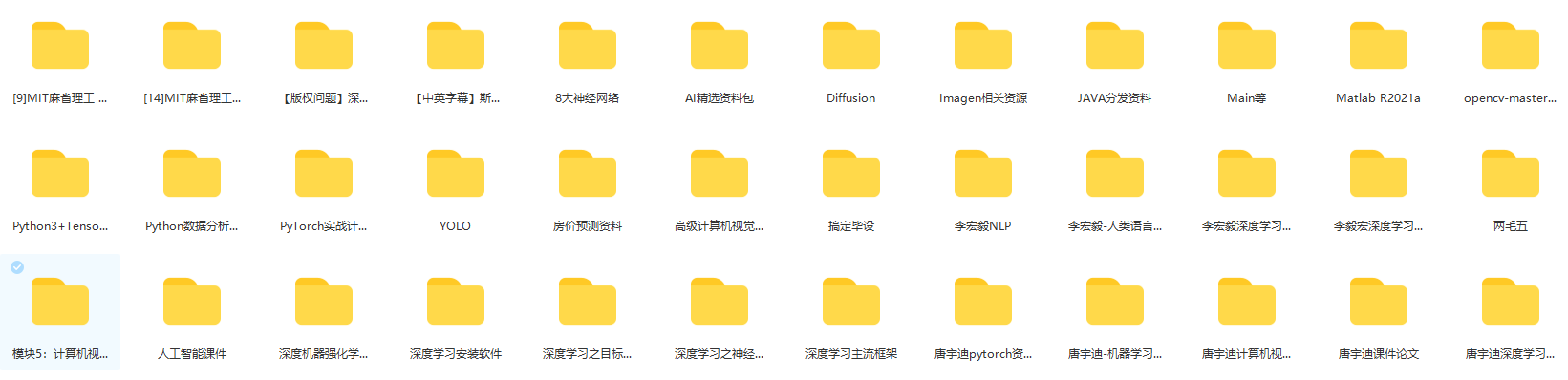

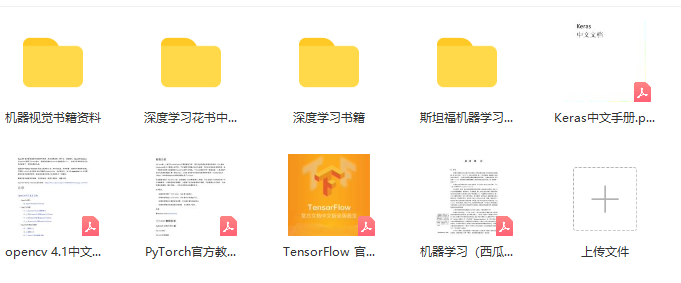

免费分享一些我整理的人工智能学习资料给大家,整理了很久,非常全面。包括一些人工智能基础入门视频+AI常用框架实战视频、图像识别、OpenCV、NLP、YOLO、机器学习、pytorch、计算机视觉、深度学习与神经网络等视频、课件源码、国内外知名精华资源、AI热门论文等。

下面是部分截图,点击文末名片关注我的公众号【AI技术星球】发送暗号 321 领取(一定要发暗号 321)

目录

一、人工智能免费视频课程和项目

二、人工智能必读书籍

三、人工智能论文合集

四、机器学习+计算机视觉基础算法教程

五、深度学习机器学习速查表(共26张)

学好人工智能,要多看书,多动手,多实践,要想提高自己的水平,一定要学会沉下心来慢慢的系统学习,最终才能有所收获。

1105

1105

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?