题目描述:

为了方便表述,对于作用于矩阵的激活函数,本文中如果无特殊说明,表示它分别作用于矩阵的每个元素,即f(X)i,j=f(Xi,j)。

如果没有非线性函数作为激活函数,那么无论多层感知机(MLP)有多少层,都相当于没有隐藏层。比如,具有一个隐藏层的多层感知机y=f2(f1(X×A)×B),如果f1(x)=kx+b,即它是一个线性函数,我们将其带入公式中可以得到y=f2((kX×A+b×1)×B)=f2(kX×A×B+b×1×B),其中1表示所有元素都是1的矩阵。令C=kA×B,cˉ=b×1×B,那么y=f2(X×C+cˉ),显然又变成了单层神经网络,网络的表达能力被大大的削弱了,由此可见非线性激活函数对于神经网络的重要性。

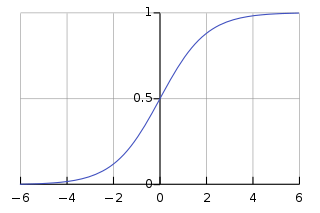

最经典的激活函数莫过于Sigmoid函数σ(x)=1/(1+exp(−x)),它在x=0附近从0到1剧烈变化,通常用于0-1分类任务。它的导函数也十分容易求得,请你自己推导。

Sigmoid函数图形,来自Wikipedia - Sigmoid function

现在给出矩阵A∈Rm×n和矩阵B∈Rn×p,记它们的积为C=A*B,求σ(C)以及它分别对C、A、B的梯度∇Cσ、∇Aσ、∇Bσ。

输入格式:

第一行给出三个整数m,n和p,均不大于102。然后跟随着一个空行。

随后m行以行主序给出矩阵A中的元素,每行n个元素,元素间用空格分隔。然后跟随着一个空行。

随后n行以行主序给出矩阵B中的元素,每行p个元素,元素间用空格分隔。

输出格式:

首先输出作用Sigmoid函数后的乘积矩阵σ(C),共m行,每行p个元素, 每个元素间后都紧随着一个空格,每行以换行结尾。最后额外输出一个空行。

然后输出矩阵∇Cσ,共m行,每行p个元素, 每个元素间后都紧随着一个空格,每行以换行结尾。最后额外输出一个空行。

接着输出矩阵∇Aσ,共m行,每行n个元素, 每个元素间后都紧随着一个空格,每行以换行结尾。最后额外输出一个空行。

最后输出矩阵∇Bσ,共n行,每行p个元素, 每个元素间后都紧随着一个空格,每行以换行结尾。最后额外输出一个空行。

输出元素均保留小数点后2位。

输入样例:

2 2 3

0.1 0.2

-0.3 0.4

1 2 3

3 2 1输出样例:

0.67 0.65 0.62

0.71 0.55 0.38

0.22 0.23 0.24

0.21 0.25 0.24

1.38 1.36

1.41 1.35

-0.04 -0.05 -0.05

0.13 0.14 0.14 参考代码:

#include <stdio.h>

#include <stdlib.h>

#include <math.h>

double **MatrixTranspose(double **a, int m, int n);//矩阵转置

double **MatrixMultiplication(double **a, double **b, int m, int n, int p);//矩阵乘法

double **Derivation(double **a, int m, int n);

double **Gradient(double **a, int m, int n);

double **MatrixTranspose(double **a, int m, int n){

double **x = (double **)malloc(sizeof(double *)*n);

int i, j;

for(i = 0; i < n; i++){

x[i] = (double *)malloc(sizeof(double)*m);

}

for(i = 0; i < m; i++){

for(j = 0; j < n; j++){

x[j][i] = a[i][j];

}

}

return x;

}

double **MatrixMultiplication(double **a, double **b, int m, int n, int p){

//使用指针的指针返回矩阵

double **x, sum = 0;

int i, j, k;

x = (double **)malloc(sizeof(double*)*m);

for(i = 0; i < m; i++) {

x[i] = (double*)malloc(sizeof(double)*p);

}

for(i = 0; i < m; i++){

for(k = 0; k < p; k++){

sum = 0;

for(j = 0; j < n; j++){

sum = sum + a[i][j] * b[j][k];

}

x[i][k] = sum;

}

}

return x;

}

double **Derivation(double **a, int m, int n){

double **x, t;

int i, j;

x = (double **)malloc(sizeof(double*)*m);

for(i = 0; i < m; i++){

x[i] = (double*)malloc(sizeof(double)*n);

for(j = 0; j < n; j++){

t = 1.0 / (1 + exp(-a[i][j]));//Sigmoid函数σ(x)= 1.0/(1+exp(-x)),exp(-x) => e的-x次方

x[i][j] = t * (1 - t);//Sigmoid函数的导数= σ(x)*(1-σ(x))

}

}

return x;

}

double **Gradient(double **a, int m, int n){

double **x = (double**)malloc(sizeof(double*)*m);

int i, j;

for(i = 0; i < m; i++){

x[i] = (double *)malloc(sizeof(double)*n);

for(j = 0; j < n; j++){

x[i][j] = 1.0 / (1 + exp(-a[i][j]));

}

}

return x;

}

int main(){

int m, n, p, i, j;

double **a, **b, **c, **d;

scanf("%d %d %d\n", &m, &n, &p);

a = (double **)malloc(sizeof(double*)*m);

for(i = 0; i < m; i++){

a[i] = (double*)malloc(sizeof(double)*n);

for (j = 0; j < n; j++) {

scanf("%lf", &a[i][j]);

}

}

b = (double**)malloc(sizeof(double*)*n);

for(i = 0; i < n; i++){

b[i] = (double*)malloc(sizeof(double)*p);

for(j = 0; j < p; j++){

scanf("%lf", &b[i][j]);

}

}

c = MatrixMultiplication(a, b, m, n, p);

d = Gradient(c, m, p);

for(int i = 0; i < m; i++){

for(int j = 0; j < p; j++){

printf("%.2lf ", d[i][j]);

}

printf("\n");

}

printf("\n");

double **cD = Derivation(c, m, p);//计算c的梯度:将c的值带入Sigmoid的导函数

for(i = 0; i < m; i++){

for(j = 0; j < p; j++){

printf("%.2lf ", cD[i][j]);

}

printf("\n");

}

printf("\n");

double **bT = MatrixTranspose(b, n, p);

double **dbT = MatrixMultiplication(cD, bT, m, p, n);//σ(C)对a的梯度=a(C)*b的转置

for(i = 0; i < m; i++){

for(j = 0; j < n; j++){

printf("%.2lf ", dbT[i][j]);

}

printf("\n");

}

printf("\n");

double **aT = MatrixTranspose(a, m, n);

double **daT = MatrixMultiplication(aT, cD, n, m , p);//σ(C)对b的梯度=σ(C)*a的转置

for(i = 0; i < n; i++){

for(j = 0; j < p; j++){

printf("%.2lf ", daT[i][j]);

}

printf("\n");

}

}

1477

1477

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?