目录

梯度:各个变量的偏导组成的向量

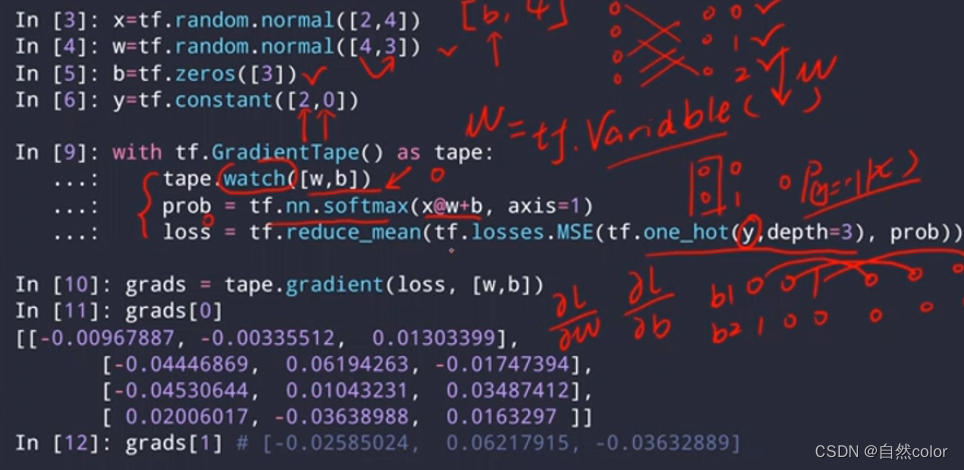

tensorflow自动求梯度

计算过程封装到这里面

正常计算完梯度后会自动释放(因为占GPU显存),如果想调用两次求梯度要传一个参数进去

建议及时释放资源

with tf.GradientTape(persistent=True) as tape:

二阶求导(初学者几乎用不到)

激活函数及其梯度

sigmoid

解决 阶梯激活函数无法求导的问题,出现了sigmoid函数,导数是已知的

![]()

sigmoid函数致命缺陷:无穷的时候导数趋近于0,出现梯度弥散

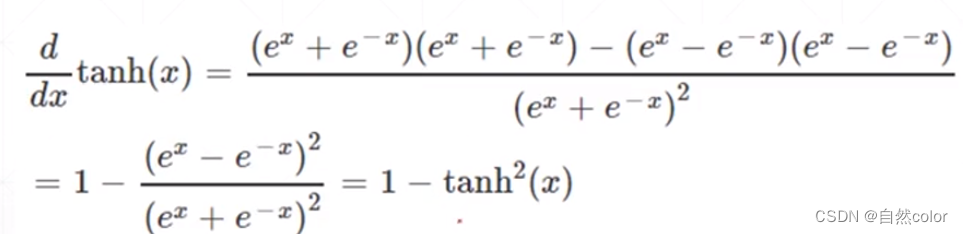

Tanh

relu

广泛使用 适合深度学习

损失函数及其梯度

MSE均方差

tape.watch([w,b]) 指定要观测的变量,运算过程中需要对w和b求导

如果w直接定义成tf.Variable()则不需要加tape.watch

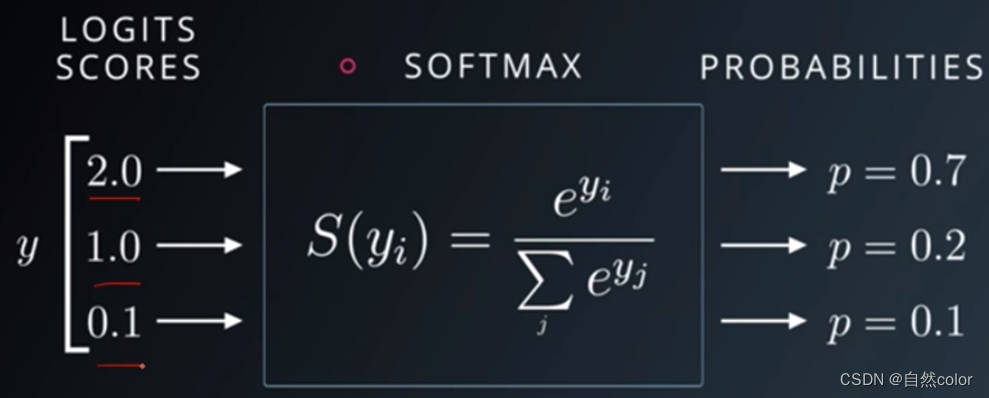

Softmax 求导

放缩后,差距更大

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

192

192

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?