神经元模型

神经元模型是神经网络中的基本单元。它是一种数学模型,可以接收输入信号,对其进行加权处理并施加一个激活函数,最终输出一个结果。神经元模型通常由多个输入和一个输出组成,每个输入都有一个权重参数,用于表示该输入对输出的重要程度。输入信号与权重相乘后相加,再通过激活函数进行处理,得到最终的输出结果。

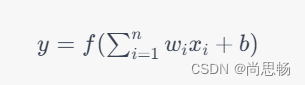

神经元模型的数学表达式为:

其中,表示神经元的输入,

表示每个输入对应的权重,b表示偏置,

表示激活函数,y表示神经元的输出。在训练神经网络时,我们需要对权重和偏置进行调整,以使得神经元的输出尽可能接近目标输出。

感知机与多层网络

感知机是一种最简单的神经网络模型,它由一层或多层神经元组成,用于解决二分类问题。而多层网络则是指由多个神经元组成的多层神经网络模型,通常用于解决更为复杂的分类或回归问题。

感知机模型最早由Frank Rosenblatt于1958年提出,它由一个单一的神经元组成,接受一些输入信号,并产生一个二元输出,表示输入属于某一类或另一类。感知机的基本思想是将输入向量与权值向量的内积加上偏置,然后使用一个激活函数进行判断,以得出分类结果。

多层神经网络则包含多个神经元组成的层次结构,通常包含输入层、隐藏层和输出层。其中输入层和输出层的神经元数目是固定的,隐藏层的神经元数目可以根据需要进行设置。多层神经网络通常使用反向传播算法进行训练,该算法利用随机梯度下降法来最小化损失函数,以更新权重和偏置。

相对于感知机,多层神经网络可以通过更深的层数和更多的神经元来学习更为复杂的特征和模式,从而提高了模型的准确性和泛化能力。同时,多层神经网络还可以使用各种不同的激活函数、正则化技术和优化算法来提高性能。

误差逆传播算法

误差逆传播算法(Backpropagation Algorithm)是一种常用的人工神经网络训练算法,用于求解多层前馈网络中的权重参数,以使网络输出对输入的拟合误差最小。误差逆传播算法通过梯度下降法,根据输出误差对网络参数进行更新,以逐步优化网络模型的拟合能力。

具体地,误差逆传播算法使用了链式法则(Chain Rule)来计算输出误差对各层权重的偏导数,然后使用梯度下降法更新权重。算法的基本步骤如下:

-

随机初始化网络中各层的权重参数。

-

输入一个样本,通过前向传播计算网络的输出结果。

-

计算输出结果与真实值之间的误差。

-

反向传播误差,计算每层的误差信号,以及每个权重对误差的贡献。

-

使用梯度下降法更新每个权重。

-

重复步骤2-5,直至满足停止条件(例如达到最大迭代次数或误差降低到一定程度)。

需要注意的是,误差逆传播算法对于网络中的非线性激活函数,如sigmoid、tanh等,采用了近似求解的方式,即使用导数的链式法则来近似计算复合函数的导数,而不是精确求解。

标准BP算法vs累积BP算法

标准反向传播算法和累积反向传播算法都是误差反向传播算法的变体。

标准反向传播算法每次更新权重都是基于单个样本的误差计算,这可能会导致权重更新不稳定、过度拟合或者收敛速度过慢的问题。相比之下,累积反向传播算法则是累积了多个样本的误差梯度,并在每个周期结束时一次性更新权重,因此更加稳定,通常可以获得更好的训练效果。

具体来说,标准反向传播算法的权重更新公式为:

其中,w_{ij}表示从第i个神经元到第j个神经元的连接权重,表示学习率,E_n表示第n个样本的误差。可以看到,权重更新仅基于单个样本的误差。

累积反向传播算法则是在每个周期结束时,先将多个样本的误差梯度累加起来,然后再更新权重。具体来说,权重更新公式为:

其中,N表示训练样本数。可以看到,权重更新是基于多个样本的误差。

相比标准反向传播算法,累积反向传播算法通常需要更多的计算资源和训练时间,但可以获得更好的泛化性能。

全局最小与局部最小

全局最小是指在整个参数空间中找到的损失函数取值最小的点。这个点是所有可能的参数组合中使得损失函数最小的点,因此是最优解。然而,全局最小可能在高维空间中非常难以找到,因为搜索空间非常大。

局部最小是指在某个局部区域内找到的损失函数取值最小的点。在高维空间中,存在许多局部最小值。这些局部最小值是损失函数的局部最优解,但不一定是全局最优解。如果模型被困在一个局部最小值中,那么模型的性能可能会受到影响。

297

297

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?