一.背景介绍

机器翻译的历史可以追溯到1950年代,当时的翻译方法主要基于规则和词汇表。1960年代,研究人员开始尝试使用自然语言处理技术来解决机器翻译的问题。1970年代,研究人员开始使用统计方法来进行机器翻译,这一方法在1980年代和1990年代得到了进一步发展。2000年代,随着计算机的发展,机器翻译技术开始使用深度学习方法,这一方法在2010年代得到了广泛应用。

机器翻译是自然语言处理领域的一个重要分支,它旨在将一种自然语言翻译成另一种自然语言。因为一段文本序列在不同语言中的长度不一定相同,所以我们使用机器翻译为例来介绍编码器—解码器和注意力机制的应用。

二.读取和预处理数据

我们先定义一些特殊符号。其中“<pad>”(padding)符号用来添加在较短序列后,直到每个序列等长,而“<bos>”和“<eos>”符号分别表示序列的开始和结束。

!tar -xf d2lzh_pytorch.tar

import collections # 导入collections模块,用于特定的容器数据类型

import os # 导入os模块,用于操作系统功能

import io # 导入io模块,用于处理流

import math # 导入 math模块,提供数学函数

import torch # 导入PyTorch库

from torch import nn # 从PyTorch导入神经网络模块

import torch.nn.functional as F # 从PyTorch导入神经网络模块的函数接口

import torchtext.vocab as Vocab # 导入TorchText的词汇表工具

import torch.utils.data as Data # 导入PyTorch的数据工具

import sys # 导入sys模块,用于系统特定参数和函数

# sys.path.append("..") #可选:将父目录添加到 sys.path 中

import d2lzh_pytorch as d2l # 导入自定义库/模块 'd2lzh_pytorch',并命名为 'd2l'

PAD, BOS, EOS = '<pad>', '<bos>', '<eos>' # 定义特殊标记:填充、序列开始、序列结束

os.environ["CUDA_VISIBLE_DEVICES"] = "0" # 设置使用的CUDA设备(GPU0)

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu') #检查并设置设备为CUDA GPU(如可用),否则为CPU

print(torch.__version__, device) # 打印PyTorch版本和设备(CUDA 或 CPU)在此我们导入d2l数据集作为机器翻译的数据集样例,接着定义两个辅助函数对后面读取的数据进行预处理。

def process_one_seq(seq_tokens, all_tokens, all_seqs, max_seq_len):

all_tokens.extend(seq_tokens) # 将当前序列的词添加到 all_tokens 中

seq_tokens += [EOS] + [PAD] * (max_seq_len - len(seq_tokens) - 1) # 在当前序列末尾添加 EOS 标记和 PAD 填充,使序列长度达到 max_seq_len

all_seqs.append(seq_tokens) # 将处理后的序列添加到 all_seqs 中

def build_data(all_tokens, all_seqs):

vocab = Vocab.Vocab(collections.Counter(all_tokens),#使用Vocab类构造函数创建词汇表vocab,使用 collections.Counter 统计 all_tokens 中每个词出现的次数,得到词频字典

specials=[PAD, BOS, EOS])

indices = [[vocab.stoi[w] for w in seq] for seq in all_seqs]#stoi方法将每个词转换为索引

return vocab, torch.tensor(indices)前一个辅助函数的作用是将一个序列中所有的词记录在all_tokens中以便之后构造词典,然后在该序列后面添加PAD直到序列长度变为max_seq_len,然后将序列保存在all_seqs中。

第二个辅助函数作用是使用所有的词来构造词典。并将所有序列中的词变换为词索引后构造Tensor。

为了演示方便,我们在这里使用一个很小的法语—英语数据集。在这个数据集里,每一行是一对法语句子和它对应的英语句子,中间使用'\t'隔开。在读取数据时,我们在句末附上“<eos>”符号,并可能通过添加“<pad>”符号使每个序列的长度均为max_seq_len。我们为法语词和英语词分别创建词典。法语词的索引和英语词的索引相互独立。

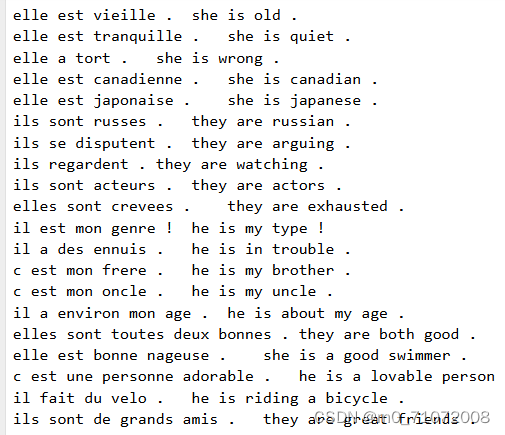

以下为法语英语——数据集内容

编译代码如下:

def read_data(max_seq_len):

# in和out分别是input和output的缩写

in_tokens, out_tokens, in_seqs, out_seqs = [], [], [], []

with io.open('fr-en-small.txt') as f:

lines = f.readlines()#读取所有行,并存储在 lines 列表中

for line in lines:

in_seq, out_seq = line.rstrip().split('\t')#使用制表符分隔符\t分割每行数据为输入序列in_seq和输出序列out_seq

in_seq_tokens, out_seq_tokens = in_seq.split(' '), out_seq.split(' ')#将输入和输出序列分割为单词列表,存储在in_seq_tokens和out_seq_tokens中

if max(len(in_seq_tokens), len(out_seq_tokens)) > max_seq_len - 1:

continue # 如果加上EOS后长于max_seq_len,则忽略掉此样本

process_one_seq(in_seq_tokens, in_tokens, in_seqs, max_seq_len) #将输入序列单词列表in_seq_tokens处理后添加到in_tokens和in_seqs中。

process_one_seq(out_seq_tokens, out_tokens, out_seqs, max_seq_len)#将输出序列单词列表out_seq_tokens处理后添加到out_tokens和out_seqs中

in_vocab, in_data = build_data(in_tokens, in_seqs)#使用build_data函数构建输入数据的词汇表和索引数据

out_vocab, out_data = build_data(out_tokens, out_seqs)#使用build_data函数构建输出数据的词汇表和索引数据

return in_vocab, out_vocab, Data.TensorDataset(in_data, out_data)此函数为读取数据集函数,使用到了前文定义的两个辅助函数,从文件中读取双语数据(法语和英语),预处理并构建词汇表及索引数据。

将序列的最大长度设成7,然后查看读取到的第一个样本。该样本分别包含法语词索引序列和英语词索引序列。

max_seq_len = 7

in_vocab, out_vocab, dataset = read_data(max_seq_len)

dataset[0]![]()

成功的构建词汇表以及索引数据。

三.含注意力机制的编码器——解码器

我们将使用含注意力机制的编码器—解码器来将一段简短的法语翻译成英语。下面我们来介绍模型的实现。

3.1 编码器

在编码器中,我们将输入语言的词索引通过词嵌入层得到词的表征,然后输入到一个多层门控循环单元中。正如我们在6.5节(循环神经网络的简洁实现)中提到的,PyTorch的nn.GRU实例在前向计算后也会分别返回输出和最终时间步的多层隐藏状态。其中的输出指的是最后一层的隐藏层在各个时间步的隐藏状态,并不涉及输出层计算。注意力机制将这些输出作为键项和值项。

以下为构造编码器的程序:

class Encoder(nn.Module):

def __init__(self, vocab_size, embed_size, num_hiddens, num_layers,

drop_prob=0, **kwargs):

super(Encoder, self).__init__(**kwargs)

# 初始化词嵌入层,输入大小为词汇表大小,输出大小为嵌入大小

self.embedding = nn.Embedding(vocab_size, embed_size)

# 初始化GRU循环神经网络层,输入大小为嵌入大小,隐藏单元大小为num_hiddens,层数为num_layers,可选dropout

self.rnn = nn.GRU(embed_size, num_hiddens, num_layers, dropout=drop_prob)

def forward(self, inputs, state):

# 输入形状是(批量大小, 时间步数)。将输入进行词嵌入,并调整维度顺序以适应GRU的输入要求

embedding = self.embedding(inputs.long()).permute(1, 0, 2) # (seq_len, batch, input_size)

# 使用GRU进行前向传播,返回输出和最终的隐藏状态

return self.rnn(embedding, state)

def begin_state(self):

# 开始状态的方法,这里简单地返回None,可以根据需要进行修改

return None下面我们来创建一个批量大小为4、时间步数为7的小批量序列输入。设门控循环单元的隐藏层个数为2,隐藏单元个数为16。编码器对该输入执行前向计算后返回的输出形状为(时间步数, 批量大小, 隐藏单元个数)。门控循环单元在最终时间步的多层隐藏状态的形状为(隐藏层个数, 批量大小, 隐藏单元个数)。对于门控循环单元来说,state就是一个元素,即隐藏状态;如果使用长短期记忆,state是一个元组,包含两个元素即隐藏状态和记忆细胞。

直接调用上述函数并赋值即可:

encoder = Encoder(vocab_size=10, embed_size=8, num_hiddens=16, num_layers=2)

output, state = encoder(torch.zeros((4, 7)), encoder.begin_state())

output.shape, state.shape # GRU的state是h, 而LSTM的是一个元组(h, c)![]()

根据输出结果可以看出创建的输入符合预想设计。

3.2 注意力机制

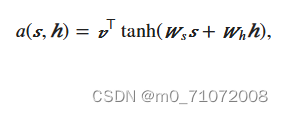

我们将实现10.11节(注意力机制)中定义的函数𝑎:将输入连结后通过含单隐藏层的多层感知机变换。其中隐藏层的输入是解码器的隐藏状态与编码器在所有时间步上隐藏状态的一一连结,且使用tanh函数作为激活函数。输出层的输出个数为1。两个Linear实例均不使用偏差。其中函数𝑎𝑎定义里向量𝑣𝑣的长度是一个超参数,即attention_size

def attention_model(input_size, attention_size):

model = nn.Sequential(nn.Linear(input_size, attention_size, bias=False),#创建一个线性层,将大小为input_size的输入张量映射到大小为attention_size的输出张量。

nn.Tanh(),#对上一个线性层的输出应用双曲正切激活函数

nn.Linear(attention_size, 1, bias=False))#另一个线性层,接收双曲正切激活函数的输出,并将其映射到一个标量值

return model注意力机制的输入包括查询项、键项和值项。设编码器和解码器的隐藏单元个数相同。这里的查询项为解码器在上一时间步的隐藏状态,形状为(批量大小, 隐藏单元个数);键项和值项均为编码器在所有时间步的隐藏状态,形状为(时间步数, 批量大小, 隐藏单元个数)。注意力机制返回当前时间步的背景变量,形状为(批量大小, 隐藏单元个数)。

def attention_forward(model, enc_states, dec_state):

"""

enc_states: (时间步数, 批量大小, 隐藏单元个数)

dec_state: (批量大小, 隐藏单元个数)

"""

# 将解码器隐藏状态广播到和编码器隐藏状态形状相同后进行连结

dec_states = dec_state.unsqueeze(dim=0).expand_as(enc_states)

enc_and_dec_states = torch.cat((enc_states, dec_states), dim=2)##enc_and_dec_states的形状变为 (时间步数, 批量大小, 2*隐藏单元个数)

e = model(enc_and_dec_states) # 形状为(时间步数, 批量大小, 1)

alpha = F.softmax(e, dim=0) # 在时间步维度做softmax运算

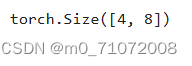

return (alpha * enc_states).sum(dim=0) # 返回背景变量在下面的例子中,编码器的时间步数为10,批量大小为4,编码器和解码器的隐藏单元个数均为8。注意力机制返回一个小批量的背景向量,每个背景向量的长度等于编码器的隐藏单元个数。因此输出的形状为(4, 8)。

seq_len, batch_size, num_hiddens = 10, 4, 8

model = attention_model(2*num_hiddens, 10) # 创建一个注意力模型,输入维度为2*num_hiddens,输出维度为10

enc_states = torch.zeros((seq_len, batch_size, num_hiddens)) # 编码器的隐藏状态,形状为 (时间步数,批量大小,隐藏单元个数)

dec_state = torch.zeros((batch_size, num_hiddens)) #解码器的隐藏状态,形状为 (批量大小,隐藏单元个数)

# 调用 attention_forward 函数计算注意力结果,并获取其形状

result_shape = attention_forward(model, enc_states, dec_state).shape

print(result_shape) # 输出计算得到的注意力结果的形状

3.3含注意力机制的解码器

我们直接将编码器在最终时间步的隐藏状态作为解码器的初始隐藏状态。这要求编码器和解码器的循环神经网络使用相同的隐藏层个数和隐藏单元个数。

在解码器的前向计算中,我们先通过刚刚介绍的注意力机制计算得到当前时间步的背景向量。由于解码器的输入来自输出语言的词索引,我们将输入通过词嵌入层得到表征,然后和背景向量在特征维连结。我们将连结后的结果与上一时间步的隐藏状态通过门控循环单元计算出当前时间步的输出与隐藏状态。最后,我们将输出通过全连接层变换为有关各个输出词的预测,形状为(批量大小, 输出词典大小)。

class Decoder(nn.Module):

def __init__(self, vocab_size, embed_size, num_hiddens, num_layers,

attention_size, drop_prob=0):

super(Decoder, self).__init__()

self.embedding = nn.Embedding(vocab_size, embed_size)

self.attention = attention_model(2*num_hiddens, attention_size)

# GRU的输入包含attention输出的c和实际输入, 所以尺寸是 num_hiddens+embed_size

self.rnn = nn.GRU(num_hiddens + embed_size, num_hiddens,

num_layers, dropout=drop_prob)

self.out = nn.Linear(num_hiddens, vocab_size)

def forward(self, cur_input, state, enc_states):

"""

cur_input shape: (batch, )

state shape: (num_layers, batch, num_hiddens)

"""

# 使用注意力机制计算背景向量

c = attention_forward(self.attention, enc_states, state[-1])

# 将嵌入后的输入和背景向量在特征维连结, (批量大小, num_hiddens+embed_size)

input_and_c = torch.cat((self.embedding(cur_input), c), dim=1)

# 为输入和背景向量的连结增加时间步维,时间步个数为1

output, state = self.rnn(input_and_c.unsqueeze(0), state)

# 移除时间步维,输出形状为(批量大小, 输出词典大小)

output = self.out(output).squeeze(dim=0)

return output, state

def begin_state(self, enc_state):

# 直接将编码器最终时间步的隐藏状态作为解码器的初始隐藏状态

return enc_state四.模型训练

我们先实现batch_loss函数计算一个小批量的损失。解码器在最初时间步的输入是特殊字符BOS。之后,解码器在某时间步的输入为样本输出序列在上一时间步的词,即强制教学。此外,同10.3节(word2vec的实现)中的实现一样,我们在这里也使用掩码变量避免填充项对损失函数计算的影响。

def batch_loss(encoder, decoder, X, Y, loss):

batch_size = X.shape[0]

enc_state = encoder.begin_state()

enc_outputs, enc_state = encoder(X, enc_state)

# 初始化解码器的隐藏状态

dec_state = decoder.begin_state(enc_state)

# 解码器在最初时间步的输入是BOS

dec_input = torch.tensor([out_vocab.stoi[BOS]] * batch_size)

# 我们将使用掩码变量mask来忽略掉标签为填充项PAD的损失, 初始全1

mask, num_not_pad_tokens = torch.ones(batch_size,), 0

l = torch.tensor([0.0])

for y in Y.permute(1,0): # Y shape: (batch, seq_len)

dec_output, dec_state = decoder(dec_input, dec_state, enc_outputs)

l = l + (mask * loss(dec_output, y)).sum()

dec_input = y # 使用强制教学

num_not_pad_tokens += mask.sum().item()

# EOS后面全是PAD. 下面一行保证一旦遇到EOS接下来的循环中mask就一直是0

mask = mask * (y != out_vocab.stoi[EOS]).float()

return l / num_not_pad_tokens在训练函数中,我们需要同时迭代编码器和解码器的模型参数。

def train(encoder, decoder, dataset, lr, batch_size, num_epochs):

enc_optimizer = torch.optim.Adam(encoder.parameters(), lr=lr) #定义编码器的Adam优化器

dec_optimizer = torch.optim.Adam(decoder.parameters(), lr=lr) #定义解码器的Adam优化器

loss = nn.CrossEntropyLoss(reduction='none') #定义交叉熵损失函数,reduction='none'表示不对每个样本求平均

data_iter = Data.DataLoader(dataset, batch_size, shuffle=True) #创建数据迭代器,用于批量加载数据集

for epoch in range(num_epochs): #遍历每个epoch

l_sum = 0.0 #初始化损失累加器

for X, Y in data_iter: #遍历每个mini-batch

enc_optimizer.zero_grad() #梯度清零,准备计算编码器的梯度

dec_optimizer.zero_grad() #梯度清零,准备计算解码器的梯度

l = batch_loss(encoder, decoder, X, Y, loss) #计算当前mini-batch的损失

l.backward() # 反向传播,计算梯度

enc_optimizer.step() #更新编码器参数

dec_optimizer.step() #更新解码器参数

l_sum += l.item() #累加当前mini-batch的损失值到总损失中

if (epoch + 1) % 10 == 0: #每10个epoch打印一次损失

print("epoch %d, loss %.3f" % (epoch + 1, l_sum / len(data_iter)))接下来,创建模型实例并设置超参数。可以开始训练模型。

embed_size, num_hiddens, num_layers = 64, 64, 2

attention_size, drop_prob, lr, batch_size, num_epochs = 10, 0.5, 0.01, 2, 50

encoder = Encoder(len(in_vocab), embed_size, num_hiddens, num_layers,

drop_prob)

decoder = Decoder(len(out_vocab), embed_size, num_hiddens, num_layers,

attention_size, drop_prob)

train(encoder, decoder, dataset, lr, batch_size, num_epochs)epoch 10, loss 0.506 epoch 20, loss 0.232 epoch 30, loss 0.097 epoch 40, loss 0.064 epoch 50, loss 0.016

五.预测不定长的序列

使用最简单的贪婪搜索生成解码器在每个时间步的输出。

def translate(encoder, decoder, input_seq, max_seq_len):

in_tokens = input_seq.split(' ') #将输入序列按空格分割为单词列表

in_tokens += [EOS] + [PAD] * (max_seq_len - len(in_tokens) - 1) #将输入序列补齐到最大序列长度,并添加结束符 EOS

enc_input = torch.tensor([[in_vocab.stoi[tk] for tk in in_tokens]]) #将输入序列转换为对应的索引序列,并转换为Tensor,维度为[1, max_seq_len]

enc_state = encoder.begin_state() #初始化编码器的初始状态

enc_output, enc_state = encoder(enc_input, enc_state) #对输入序列进行编码,得到编码器的输出和最终状态

dec_input = torch.tensor([out_vocab.stoi[BOS]]) #初始化解码器的输入为起始符 BOS 的索引

dec_state = decoder.begin_state(enc_state) #使用编码器的最终状态初始化解码器的初始状态

output_tokens = [] #初始化输出的单词序列

for _ in range(max_seq_len): #循环生成每个输出单词,最多不超过最大序列长度

dec_output, dec_state = decoder(dec_input, dec_state, enc_output) #使用解码器生成当前时刻的输出和更新解码器状态

pred = dec_output.argmax(dim=1) #获取当前时刻预测概率最高的单词的索引

pred_token = out_vocab.itos[int(pred.item())] #将预测的单词索引转换为对应的单词

if pred_token == EOS: #如果预测的单词是结束符 EOS,则停止生成

break

else:

output_tokens.append(pred_token) #将预测的单词添加到输出序列中

dec_input = pred #更新解码器的输入为当前预测的单词的索引

return output_tokens #返回生成的输出单词序列

input_seq = 'ils regardent .'

translate(encoder, decoder, input_seq, max_seq_len)

['they', 'are', 'watching', '.']

输出结果符合预期。

六.评价翻译结果

评价机器翻译结果通常使用BLEU(Bilingual Evaluation Understudy)[1]。对于模型预测序列中任意的子序列,BLEU考察这个子序列是否出现在标签序列中。

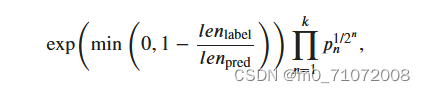

具体来说,设词数为𝑛𝑛的子序列的精度为𝑝𝑛𝑝𝑛。它是预测序列与标签序列匹配词数为𝑛𝑛的子序列的数量与预测序列中词数为𝑛𝑛的子序列的数量之比。举个例子,假设标签序列为𝐴𝐴、𝐵𝐵、𝐶𝐶、𝐷𝐷、𝐸𝐸、𝐹𝐹,预测序列为𝐴𝐴、𝐵𝐵、𝐵𝐵、𝐶𝐶、𝐷𝐷,那么𝑝1=4/5,𝑝2=3/4,𝑝3=1/3,𝑝4=0𝑝1=4/5,𝑝2=3/4,𝑝3=1/3,𝑝4=0。设𝑙𝑒𝑛(label)和𝑙𝑒𝑛pred分别为标签序列和预测序列的词数,那么,BLEU的定义

其中𝑘𝑘是我们希望匹配的子序列的最大词数。可以看到当预测序列和标签序列完全一致时,BLEU为1。

因为匹配较长子序列比匹配较短子序列更难,BLEU对匹配较长子序列的精度赋予了更大权重。例如,当𝑝𝑛𝑝𝑛固定在0.5时,随着𝑛𝑛的增大,0.51/2≈0.7,0.51/4≈0.84,0.51/8≈0.92,0.51/16≈0.960.51/2≈0.7,0.51/4≈0.84,0.51/8≈0.92,0.51/16≈0.96。另外,模型预测较短序列往往会得到较高𝑝𝑛𝑝𝑛值。因此,上式中连乘项前面的系数是为了惩罚较短的输出而设的。举个例子,当𝑘=2𝑘=2时,假设标签序列为𝐴𝐴、𝐵𝐵、𝐶𝐶、𝐷𝐷、𝐸𝐸、𝐹𝐹,而预测序列为𝐴𝐴、𝐵𝐵。虽然𝑝1=𝑝2=1𝑝1=𝑝2=1,但惩罚系数exp(1−6/2)≈0.14exp(1−6/2)≈0.14,因此BLEU也接近0.14。

下面来实现BLEU的计算。

import math

import collections

def bleu(pred_tokens, label_tokens, k):

#计算预测和参考标签的长度

len_pred, len_label = len(pred_tokens), len(label_tokens)

#初始分数,考虑了长度惩罚

score = math.exp(min(0, 1 - len_label / len_pred))

#逐个计算从1到k的n-gram

for n in range(1, k + 1):

num_matches, label_subs = 0, collections.defaultdict(int)

#统计参考标签中每个n-gram的出现次数

for i in range(len_label - n + 1):

label_subs[''.join(label_tokens[i: i + n])] += 1

#统计预测和参考标签之间匹配的n-gram数量

for i in range(len_pred - n + 1):

if label_subs[''.join(pred_tokens[i: i + n])] > 0:

num_matches += 1

label_subs[''.join(pred_tokens[i: i + n])] -= 1

#计算当前n-gram大小的精确度

precision = num_matches / (len_pred - n + 1)

#应用修改后的精确度,包括长度惩罚和权重

score *= math.pow(precision, math.pow(0.5, n))

return score

def score(input_seq, label_seq, k):

#使用编码器和解码器生成预测的标记序列

pred_tokens = translate(encoder, decoder, input_seq, max_seq_len)

#将参考标签序列拆分为标记列表

label_tokens = label_seq.split(' ')

#计算预测序列和参考序列之间的BLEU分数

bleu_score = bleu(pred_tokens, label_tokens, k)

#打印BLEU分数和预测的标记序列

print('BLEU Score: %.3f, Predicted Sequence: %s' % (bleu_score, ' '.join(pred_tokens)))同时也定义了一个辅助函数score, 预测正确则分数为1。

score('ils regardent .', 'they are watching .', k=2)bleu 1.000, predict: they are watching .

score('ils sont canadienne .', 'they are canadian .', k=2)bleu 0.658, predict: they are actors .

1402

1402

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?