作业:1.300字小故事 2.badcase

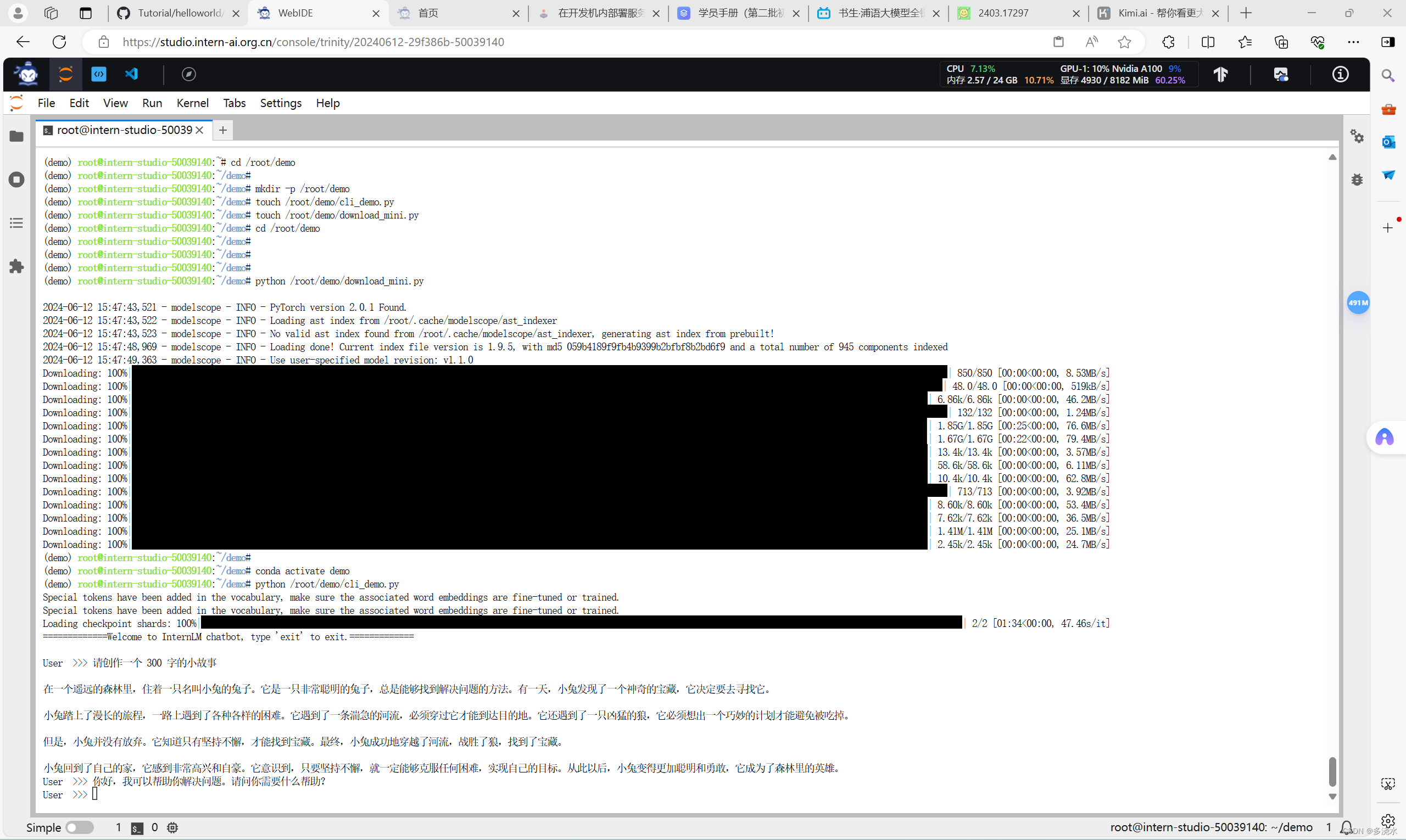

看一看整个流程:开发机->选镜像->环境配置->下载1.8B模型

环境配置要点:

studio-conda -o internlm-base -t demo

# 与 studio-conda 等效的配置方案

# conda create -n demo python==3.10 -y

# conda activate demo

# conda install pytorch==2.0.1 torchvision==0.15.2 torchaudio==2.0.2 pytorch-cuda=11.7 -c pytorch -c nvidia

-

-n demo或--name demo:这个参数指定了新创建的环境的名称,在这个例子中,环境被命名为demo。 -

-y:这个参数用于自动接受 Conda 的提示,无需手动确认。在自动化脚本或批量创建环境中非常有用,因为它避免了在每次提示时都需要用户输入。

路径创建要点:

mkdir -p /root/demo

touch /root/demo/cli_demo.py

touch /root/demo/download_mini.py

cd /root/demo

1. `mkdir -p /root/demo`:这个命令创建一个名为`demo`的目录在`/root`下。`-p`参数确保即使父目录不存在,也会创建父目录,并且如果目录已经存在,命令也不会报错。

2. `touch /root/demo/cli_demo.py`:这个命令会在`/root/demo`目录下创建一个名为`cli_demo.py`的空文件。

3. `cd /root/demo`:这个命令会将当前工作目录切换到`/root/demo`。

模型下载要点:

import os

from modelscope.hub.snapshot_download import snapshot_download

# 创建保存模型目录

os.system("mkdir /root/models")

# save_dir是模型保存到本地的目录

save_dir="/root/models"

snapshot_download("Shanghai_AI_Laboratory/internlm2-chat-1_8b",

cache_dir=save_dir,

revision='v1.1.0')

demo要点:

import torch

from transformers import AutoTokenizer, AutoModelForCausalLM

model_name_or_path = "/root/models/Shanghai_AI_Laboratory/internlm2-chat-1_8b"

tokenizer = AutoTokenizer.from_pretrained(model_name_or_path, trust_remote_code=True, device_map='cuda:0')

model = AutoModelForCausalLM.from_pretrained(model_name_or_path, trust_remote_code=True, torch_dtype=torch.bfloat16, device_map='cuda:0')

model = model.eval()

system_prompt = """You are an AI assistant whose name is InternLM (书生·浦语).

- InternLM (书生·浦语) is a conversational language model that is developed by Shanghai AI Laboratory (上海人工智能实验室). It is designed to be helpful, honest, and harmless.

- InternLM (书生·浦语) can understand and communicate fluently in the language chosen by the user such as English and 中文.

"""

messages = [(system_prompt, '')]

print("=============Welcome to InternLM chatbot, type 'exit' to exit.=============")

while True:

input_text = input("\nUser >>> ")

input_text = input_text.replace(' ', '')

if input_text == "exit":

break

length = 0

for response, _ in model.stream_chat(tokenizer, input_text, messages):

if response is not None:

print(response[length:], flush=True, end="")

length = len(response)

BFloat16的精度之所以比Float16高,是因为:

-

更多的指数位:BFloat16拥有8位指数位,而Float16只有5位。这意味着BFloat16可以表示更广泛的数值范围,包括更大的值和更小的非零值。

-

更多的尾数位:尽管BFloat16和Float16都有7位尾数位,但BFloat16的指数位更多,这使得它可以更有效地使用这些尾数位来表示更精确的数值。

然而,与32位浮点数(Float32)相比,BFloat16的精度较低,因为:

- Float32有23位尾数位,而BFloat16只有7位。

- Float32有8位指数位,与BFloat16相同,但由于尾数位更多,它可以表示更多的有效数字。

872

872

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?