LSTM概念

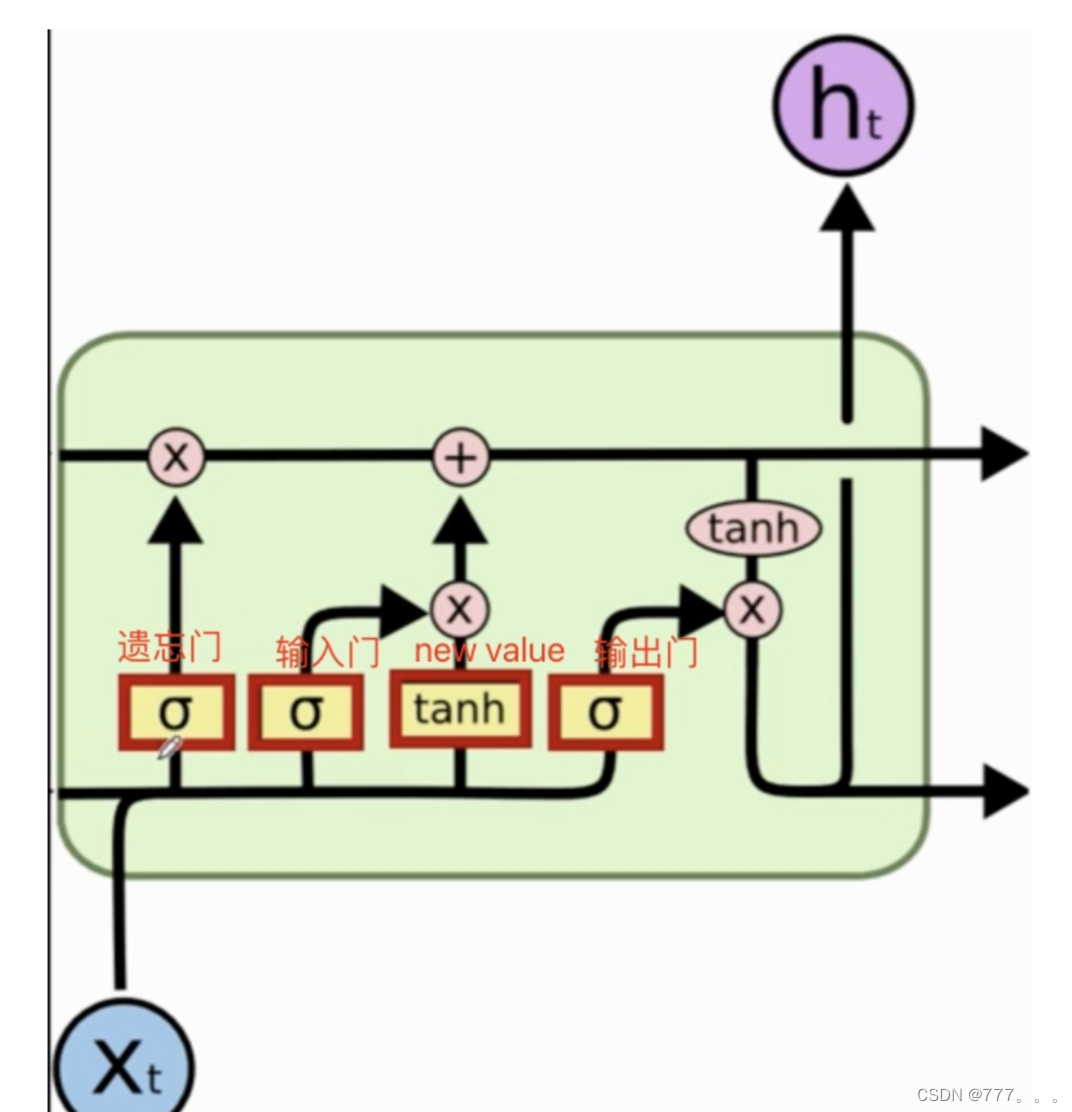

LSTM(长短时记忆网络)是一种常用于处理序列数据的深度学习模型,与传统的 RNN(循环神经网络)相比,LSTM引入了三个门( 输入门、遗忘门、输出门,如下图所示)和一个 细胞状态(cell state),这些机制使得LSTM能够更好地处理序列中的长期依赖关系。

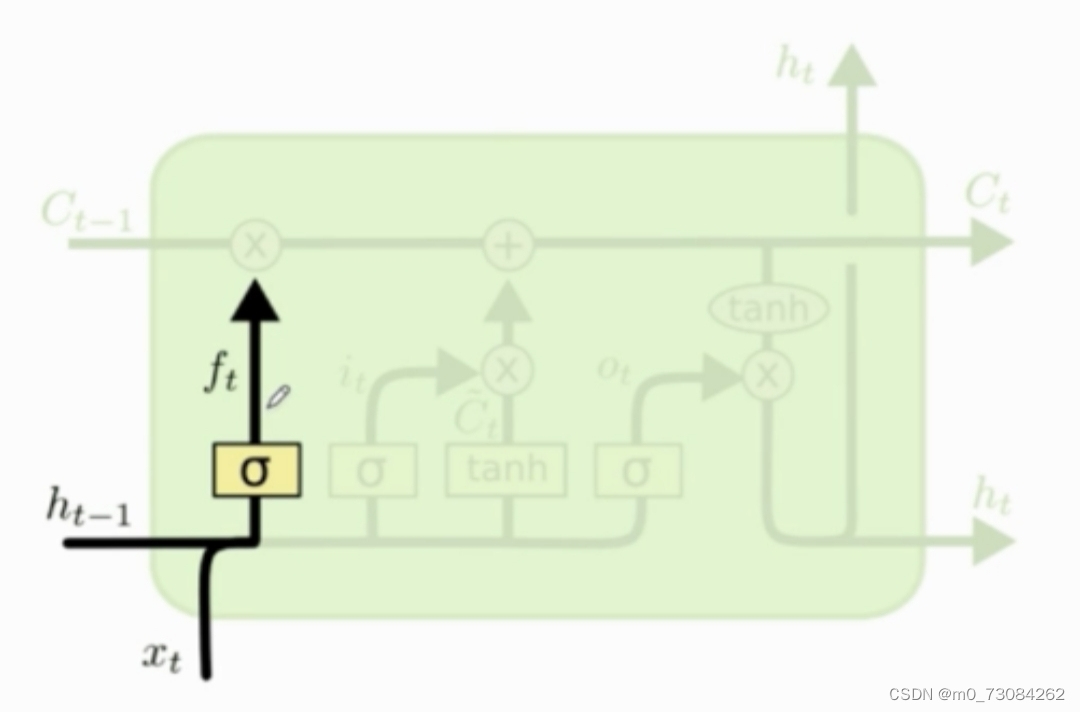

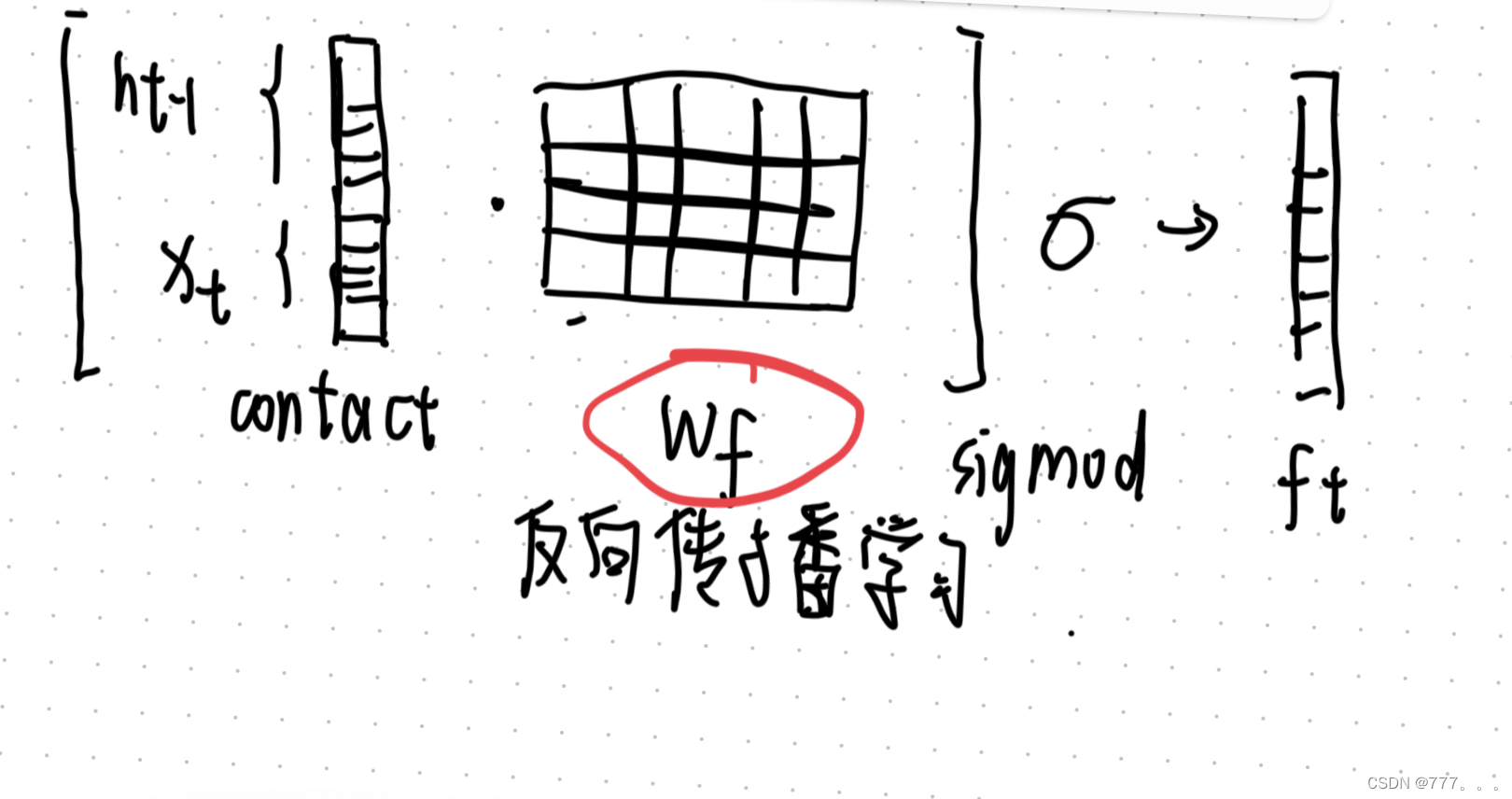

1.遗忘门

通过x和ht-1的contact,并经过sigmoid函数,得到0,1的向量,0对应的就代表之前的记忆某一部分要忘记,1对应的就代表之前的记忆需要留下

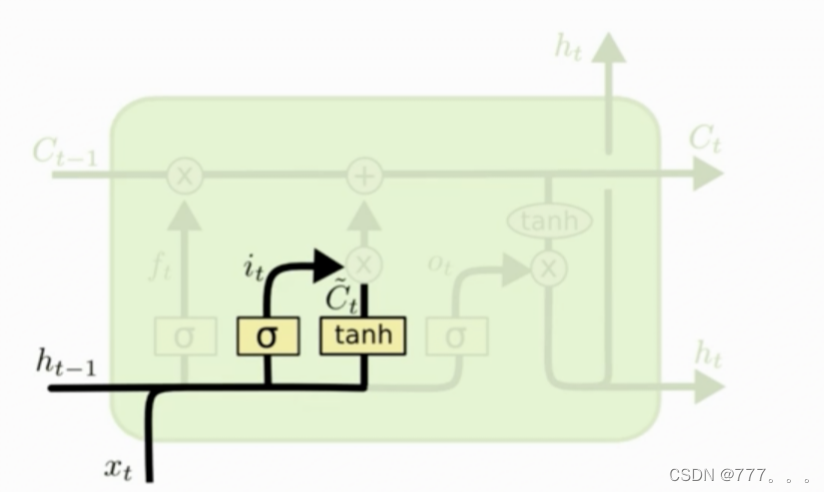

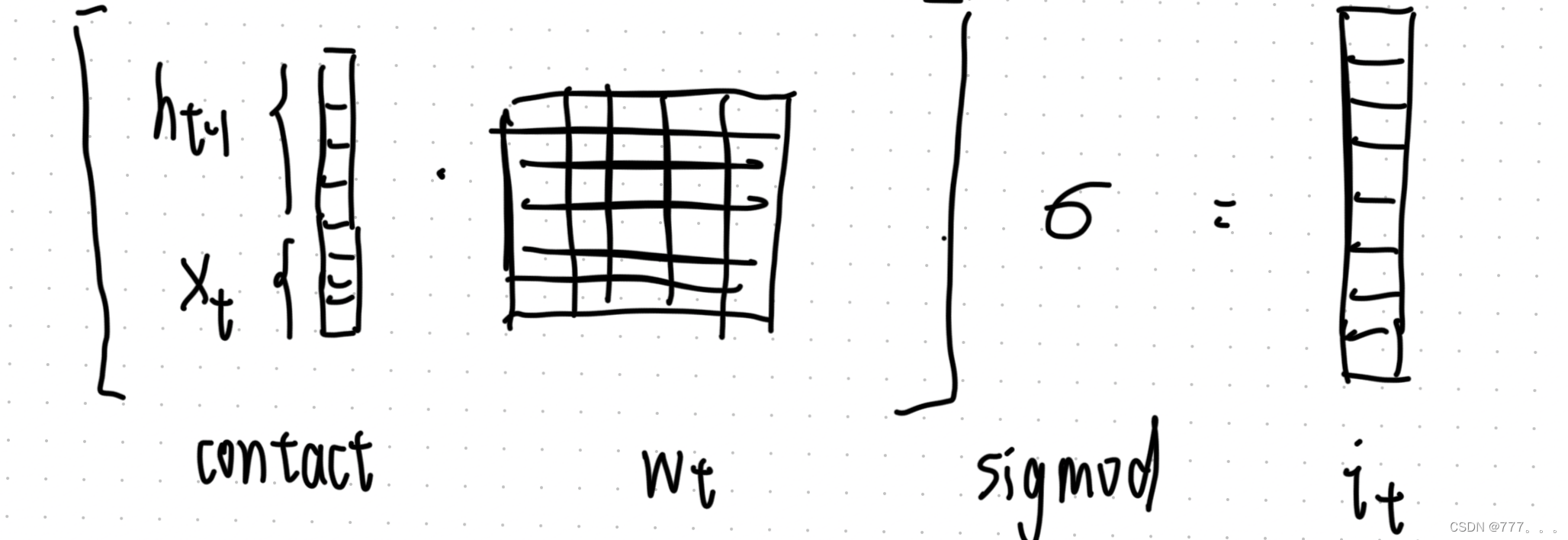

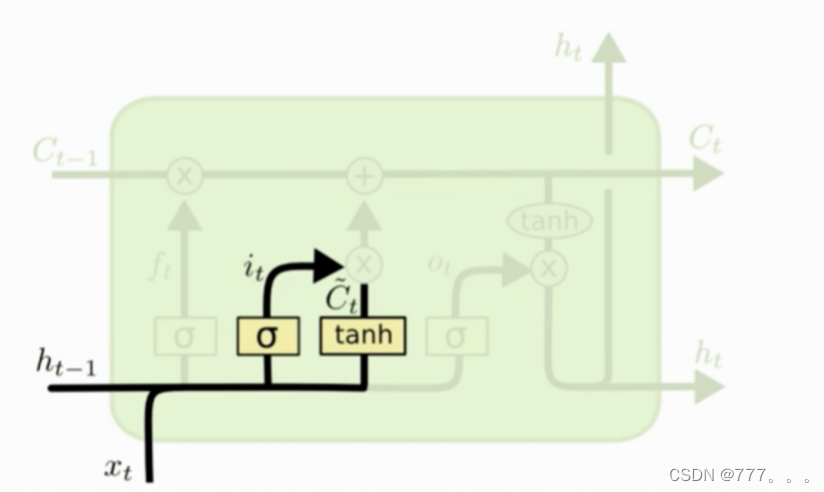

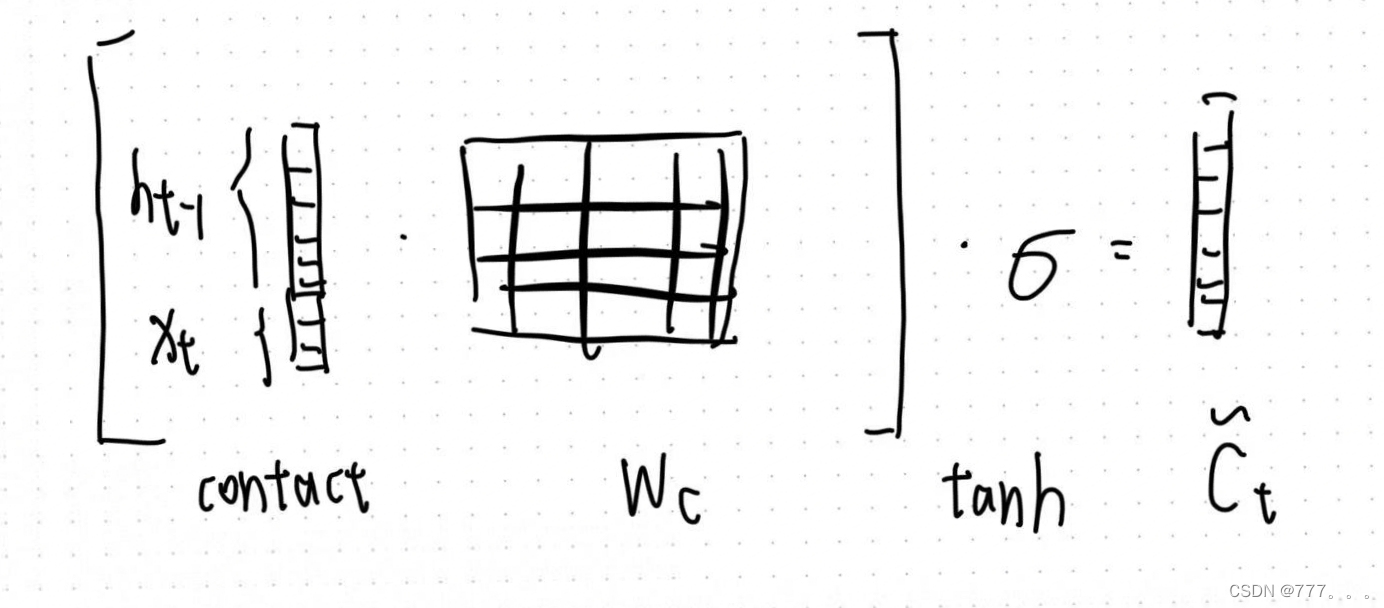

2.输入门

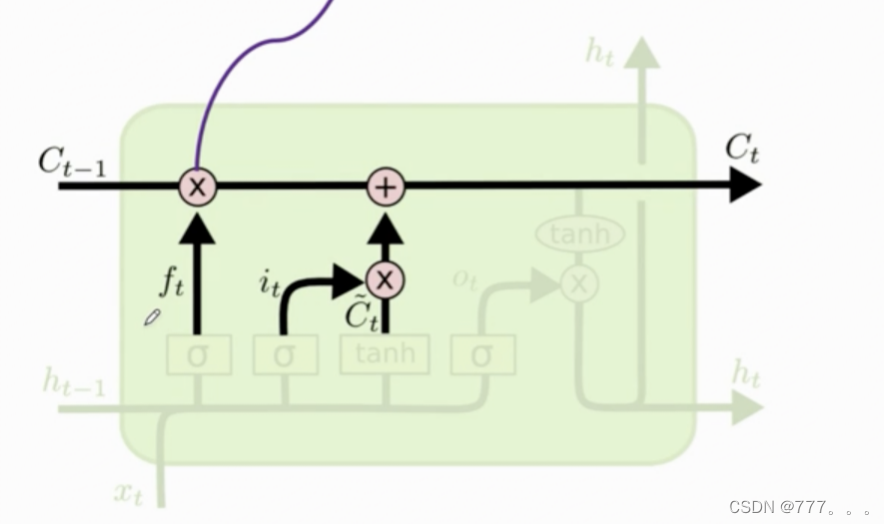

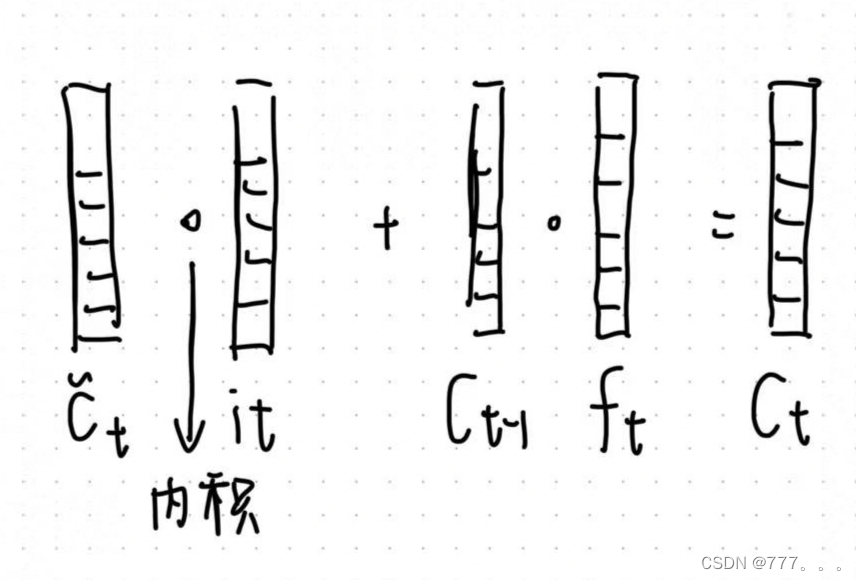

3.细胞状态

下图的空心圈表示内积

通过将之前的需要留下的信息和现在需要记住的信息相加,也就是得到了新的记忆状态

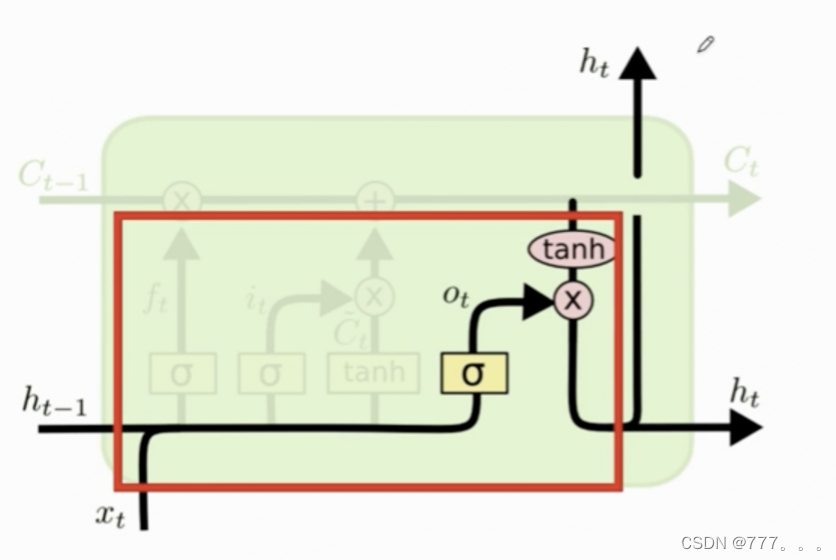

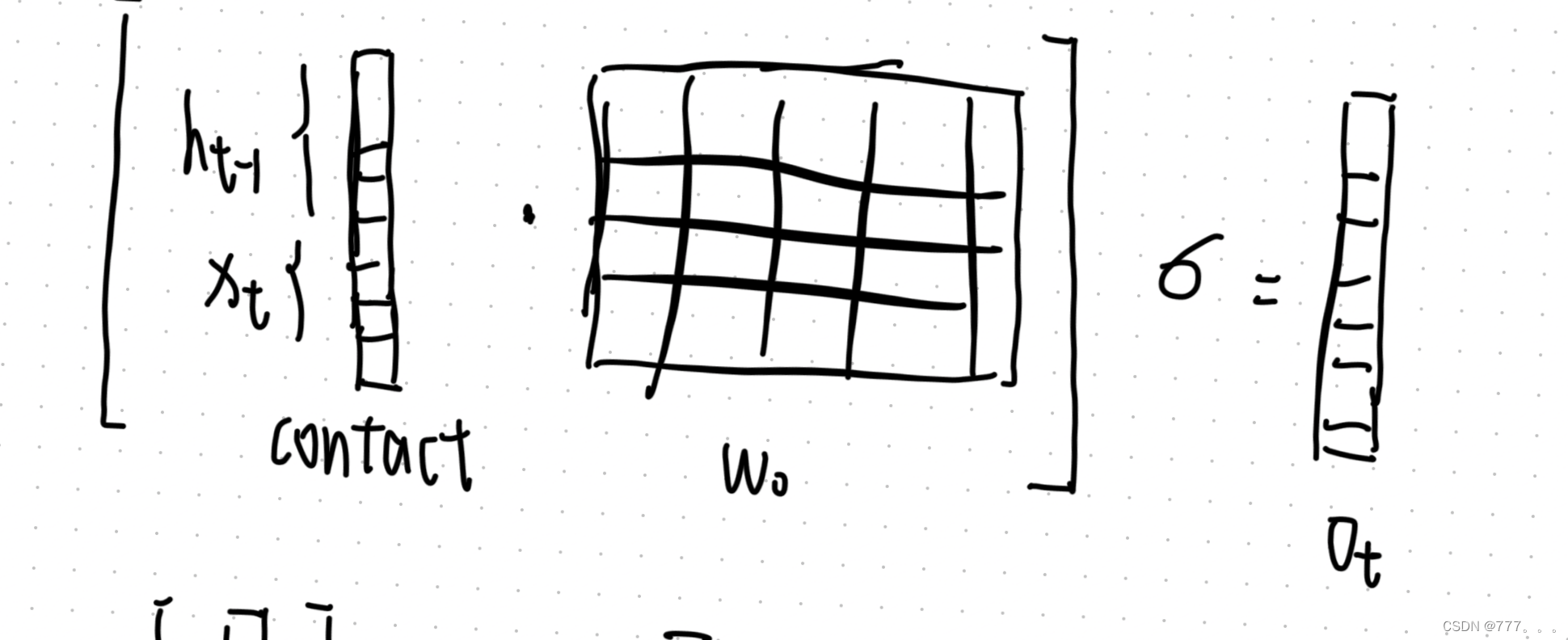

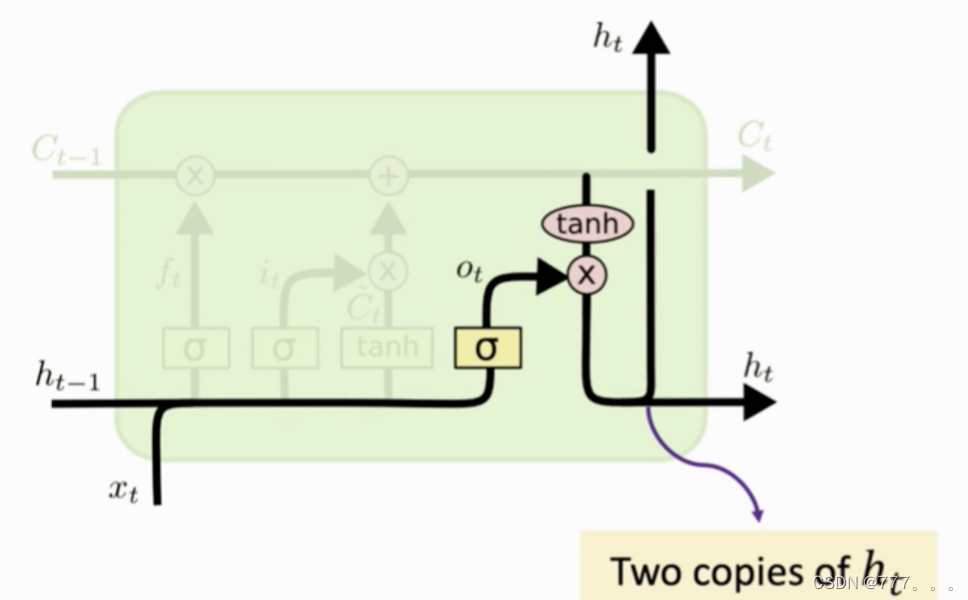

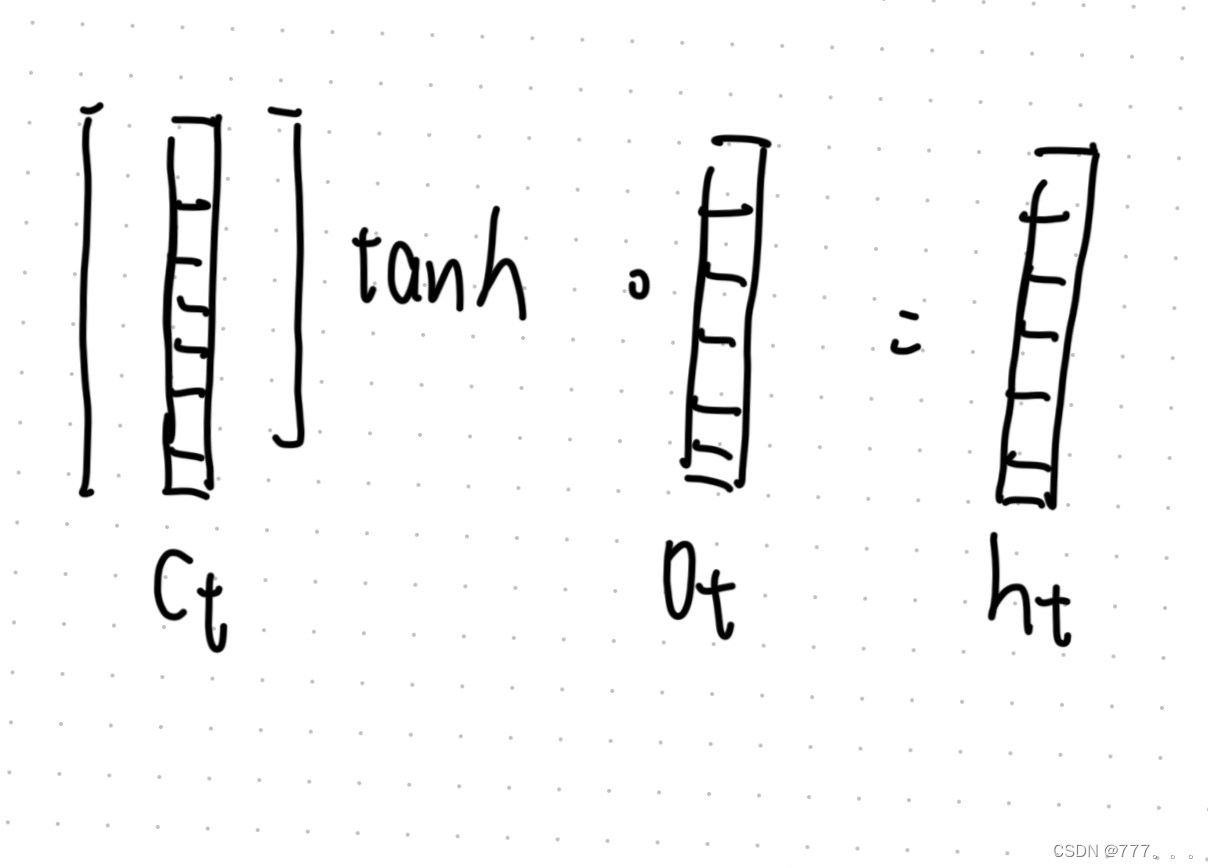

4.输出门

LSTM能解决的问题(和rnn相比)

一定程度上解决梯度消失和梯度爆炸的问题(

RNN的连乘主要是W的连乘,而W是一样的,因此就是一个指数函。)

能记住较长的序列

本文介绍了LSTM(长短时记忆网络),一种处理序列数据的深度学习模型,其独特设计包括遗忘门、输入门和细胞状态,有效解决了传统RNN的梯度问题,允许处理更长的依赖关系。

本文介绍了LSTM(长短时记忆网络),一种处理序列数据的深度学习模型,其独特设计包括遗忘门、输入门和细胞状态,有效解决了传统RNN的梯度问题,允许处理更长的依赖关系。

3093

3093

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?