支持向量机

支持向量机基本型

前情回顾

- 基本型:原来问题是线性可分的,找到线性可分问题的正中间的划分,在划分过程中找一个简单的优化技术(拉格朗日乘子法得到闭式解的问题,在通过SMO得到一个迭代的解法)。

- 但是现实问题中并不都是线性可分问题,那就要在线性可分基本型之上加一些变换。

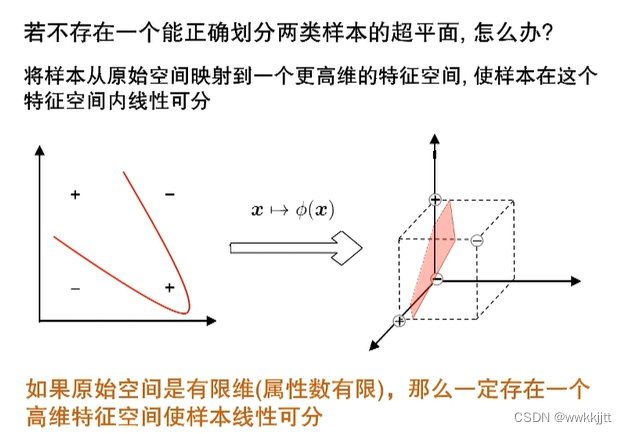

特征空间映射

- 在很多问题,在原始空间并不能得到线性划分的结果,并不是线性超平面所能划分的。

- 支持向量机要找,线性超平面离样本间隔最大。

- 样本在低维空间线性不可分,通过x→Φ(x),将样本映射到更高位空间中,使样本在更高维空间线性可分。

- 如果原始空间是有限维(属性数有限),

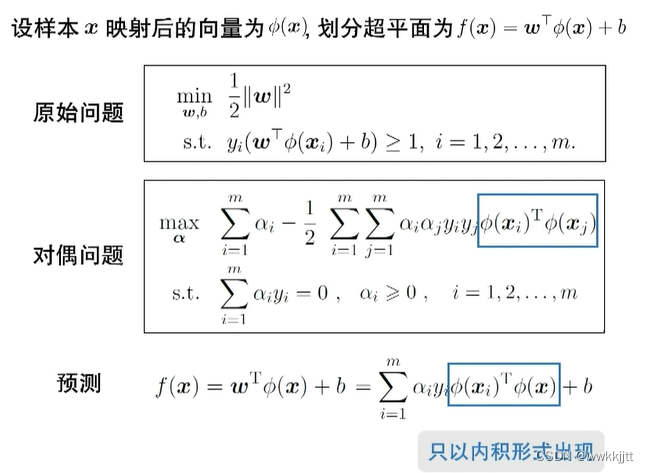

一定存在一个高维特征空间使样本线性可分。 - x映射成,向量Φ(x),则支持向量机基本型求解的所有过程的所有形式,将x换成Φ(x)。

- 同样使用拉格朗日乘子法→求ω和b的偏导→回代→最大化→得到对偶问题,与原始空间的支持向量机的形式类似,只有

原始:xT x,高维:Φ(x)T Φ(x)不同。 - 然而映射到高维空间后,会出现计算难度加大的问题。

(Φ(x)是甚高维向量。Φ(x)T Φ(x)是两个甚高维向量做内积,计算量很大。) - 假设我们无需直接计算两个非常高维向量的内积,而是用一个简单好算的东西代替内积。甚至于无需计算单个向量本身是什么,而是直接得到内积的结果。

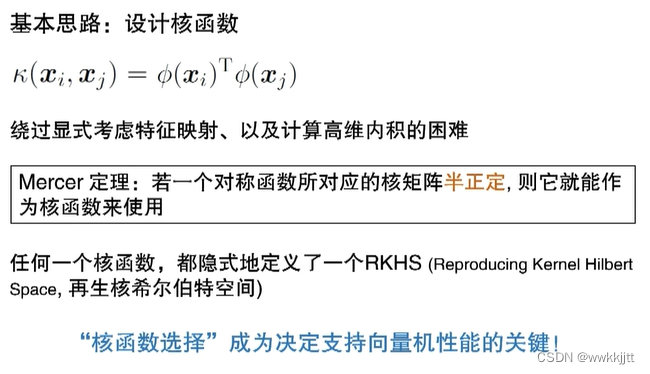

核函数

- 核函数

- 在低维空间中将xi,xj作为核函数的输入,计算结果相当于在某个高维空间中,

xi,xj映射于高维空间中向量Φ(xi),Φ(xj)的内积。 - 求高维向量内积—→在低维空间中对核函数求值。

- 在低维空间中将xi,xj作为核函数的输入,计算结果相当于在某个高维空间中,

- Mercer定理

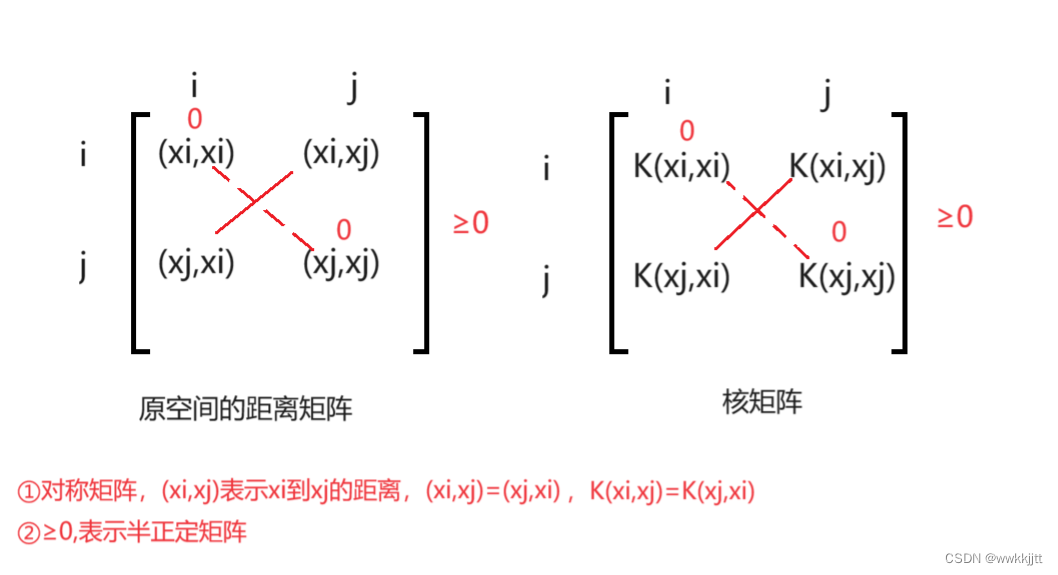

- 某个空间的任何两点间距离确定,则该空间确定。

- 核矩阵,正好满足距离矩阵的含义

(满足对称、半正定),就对应了一个向量空间,可以作为核函数使用。

- RKHS

- 由核函数对应的核矩阵,确定了该向量空间

(RKHS)的每两点间的距离关系。

- 由核函数对应的核矩阵,确定了该向量空间

- 核函数的选择

- 由

Φ得到的甚高维空间1,和由K得到的甚高维空间2,并不一定是相同。 - 我们要从得到的核函数集合

{k1,k2,...,k∞}中,找出K*(最优核函数)对应Φ得到的甚高维空间1。 - 核函数的选择,成为决定支持向量机性能的关键!

- 由

如何使用SVM

-

以回归学习为例

-

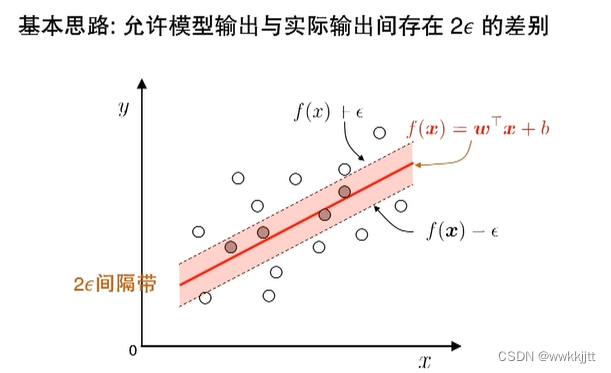

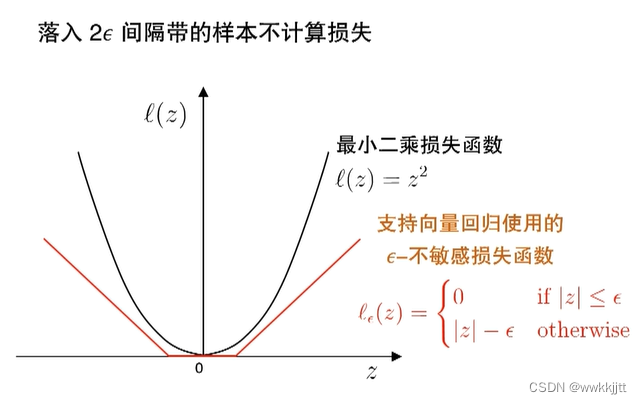

ε-不敏感损失函数

-

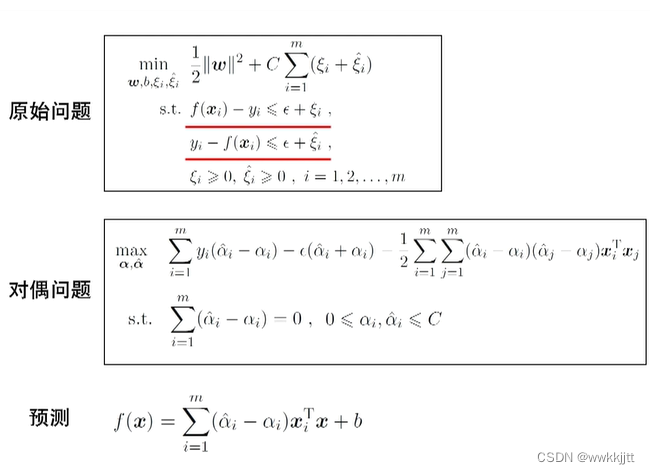

求解过程:同样使用拉格朗日乘子法→求偏导→回代→最大化→得到对偶问题

-

在现实应用中如何使用SVM

以上就是本文的全部内容,感谢各位的阅读与支持!

16万+

16万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?