神经网络

- 神经网络是由具有适应性的

简单单元组成的广泛并行互联的网络。它的组织能够模拟生物神经系统对真实世界物体的交互反应。 - 神经网络是一个很大的学科领域,这里仅讨论神经网络与机器学习的交集,即“神级网络学习”或“连接主义”学习。

神经元

“简单单元”神级元模型

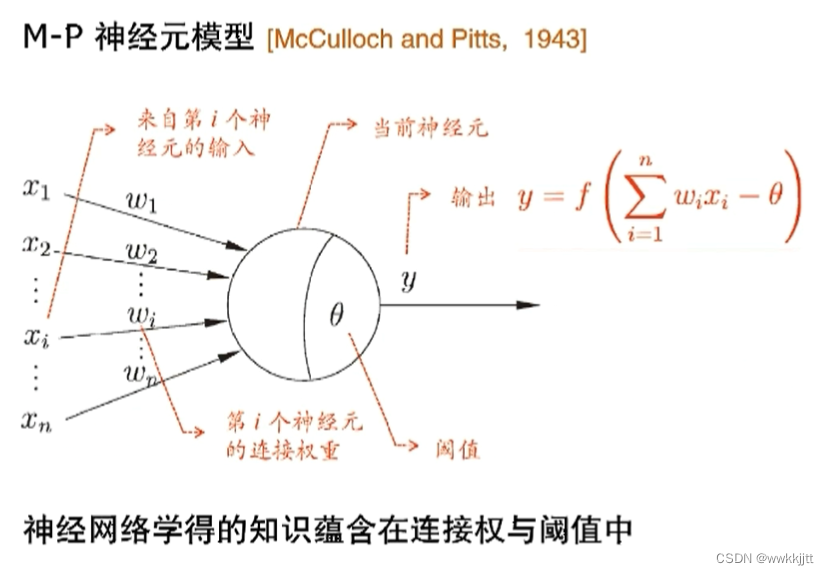

- 在今天应用最多的模型仍然是

M-P神经元模型。 M-P神经元模型它刻画的现象是:生物的神经细胞会接受来自其他细胞的信号。信号(x1,x2...,xn)通过连接突触增强(x1*w1,x2*w2...,x3*w3)到达该神经细胞。传过来的实际是一种电位,当接收到的电位大于阈值θ,就激活该神经元,从而向外传出一个信号y。

- 对神经网络模型的学习,就是要学习

w和θ。y=f(∑wi*xi-θ)中 ∑wi*xi-θ是一个线性模型。f(∑wi*xi-θ)可以处理非线性的数据,那么f函数一定要做某种变换。f函数就是激活函数。

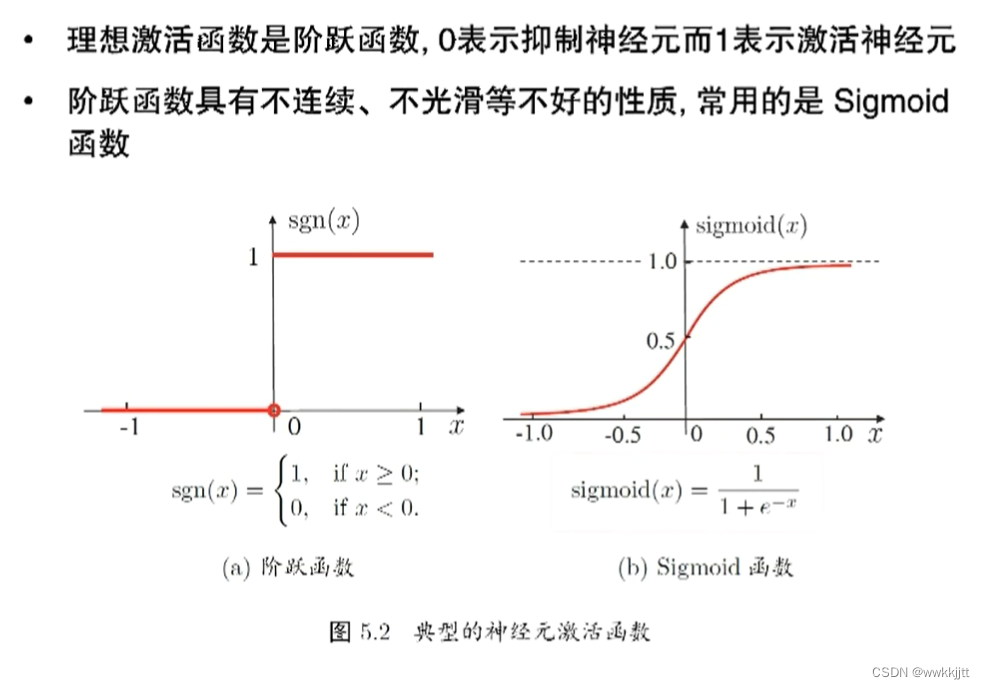

神经元的“激活函数”

- 激活函数也称为响应函数或挤压函数

(输入是-∞ ~ +∞,输出挤压成了0 ~ 1)。

- sigmoid函数是指一类S型的函数,最常用的是对率函数

1/(1+e^-x)。对率函数具有很好的性质,f(x)=1/(1+e^-x),f'(x)=f(x)*(1-f(x)),f(x)可以表示为正类的概率,1-f(x)表示反类的概率。

网络

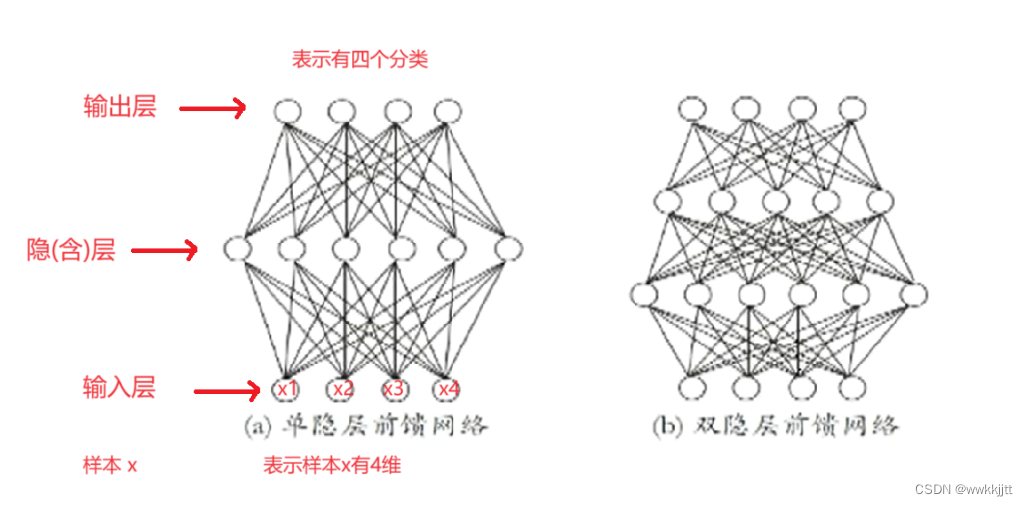

多层前馈网络结构

- 多层网络:包含隐层的网络

- 前馈网络:神经元间不存在同层的连接也不存在跨层的连接,即不存在环。

- 隐层和输出层神经元,亦称“功能单元”。

- 为了便于描述,用隐层的数量来描述是几层模型。

- 若每一个神经元,都是M-P神经元,多层前馈网络–>多层前馈神经网络。

- 万有逼近能力

- 多层前馈网络有强大的表示能力

(万有逼近性)。 - 仅需要一个包含足够多神经元的隐层,多层前馈神经网络就能以任意精度逼近任意复杂度的连续函数。

- 但是如何设置隐层神经元数是未决问题,实际常用“试错法”。

- 具有万有逼近能力是能够作为机器学习模型的前提。

- 因为神经网络的数学基础比较薄弱,所以特别证明以保证它具有万有逼近能力。

- 多层前馈网络有强大的表示能力

以上就是本文的全部内容,感谢各位的阅读与支持!

7486

7486

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?