draw.io绘制流程图-示例

一款好用的在线绘图工具——draw.io ,高效绘制出专业且清晰的流程图,同时还会解锁 AI 画图技能。

draw.io 简介

draw.io 是一款免费的在线图表工具,支持多种图表类型,包括流程图、网络图、UML 图、ER 图等。它支持导入多种文件格式,如 .vsdx、Gliffy™ 和 Lucidchart™ 文件。

访问 draw.io 网站

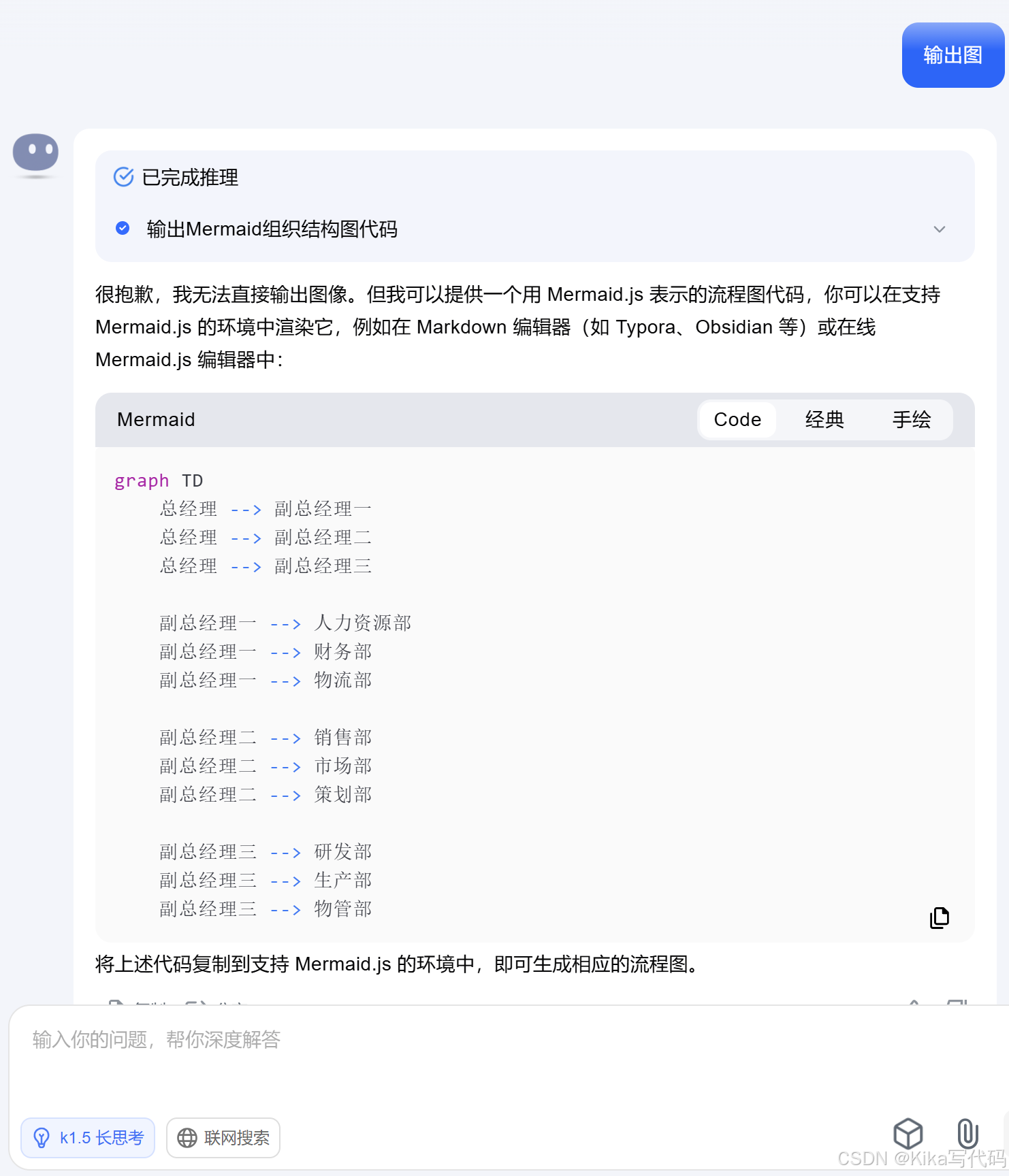

kimi 的 AI 画图功能赋能

kimi 支持多达 17 种图表的 AI 绘制,其中就包括我们关注的流程图。使用方法极为简单,只需进入 kimi 官网(Kimi - 会推理解析,能深度思考的AI助手) ,在输入框中输入规范的提示词,如 “请你用 mermaid 画一个流程图。

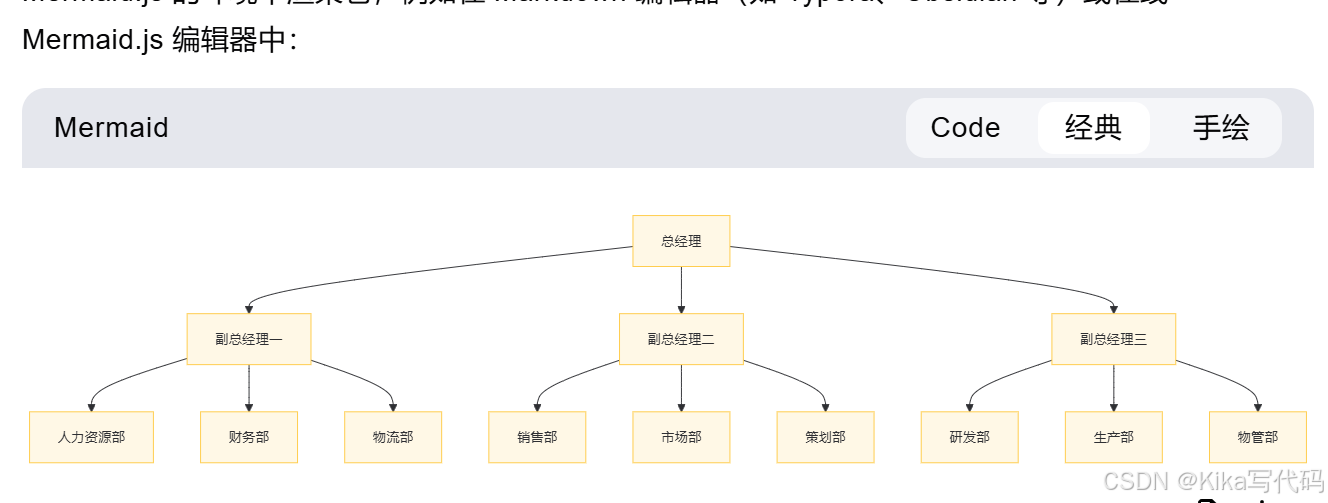

示例

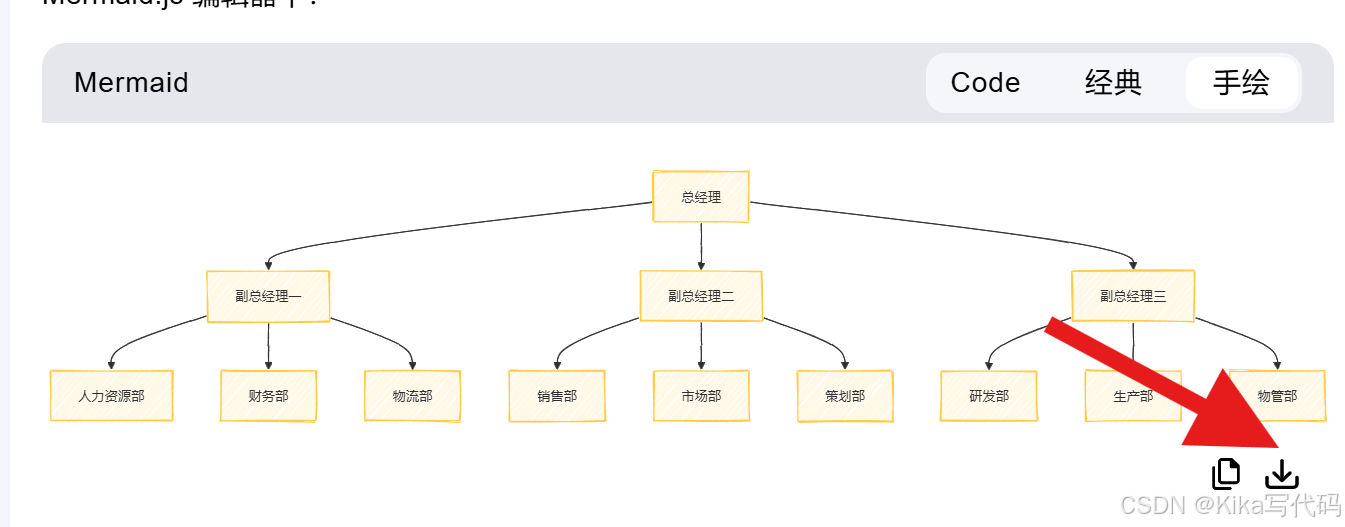

kimi也会提供直接的图片生成,会有经典和手绘两种:

我们点击下载即可得到一个png图片:

如果对kimi生成的流程图内容不满意,但是一直调试还是问不出想要的答案,最好的方法就是放进draw.io在线绘图工具自己进行简单操作

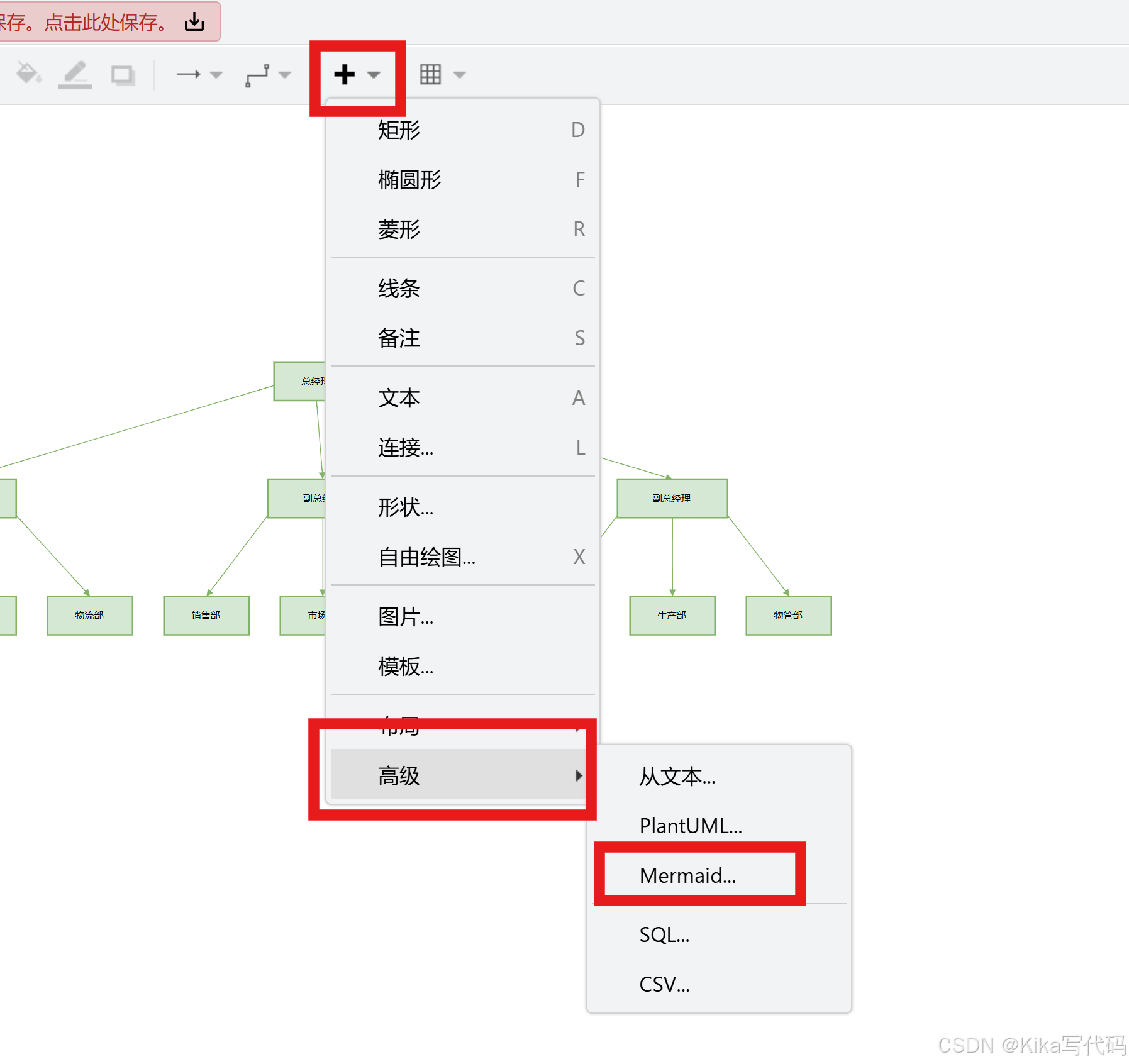

点击加号,高级,Mermaid...

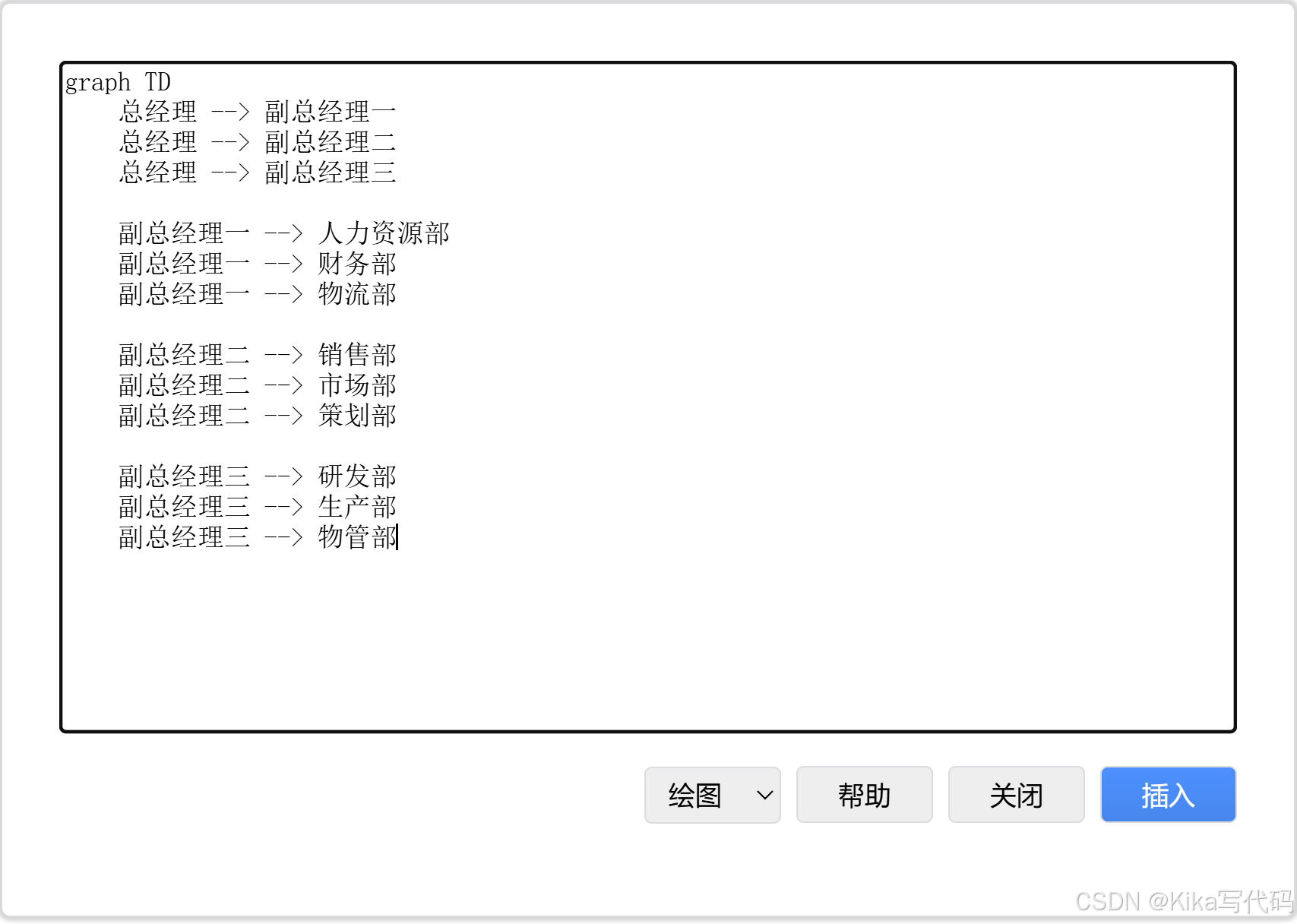

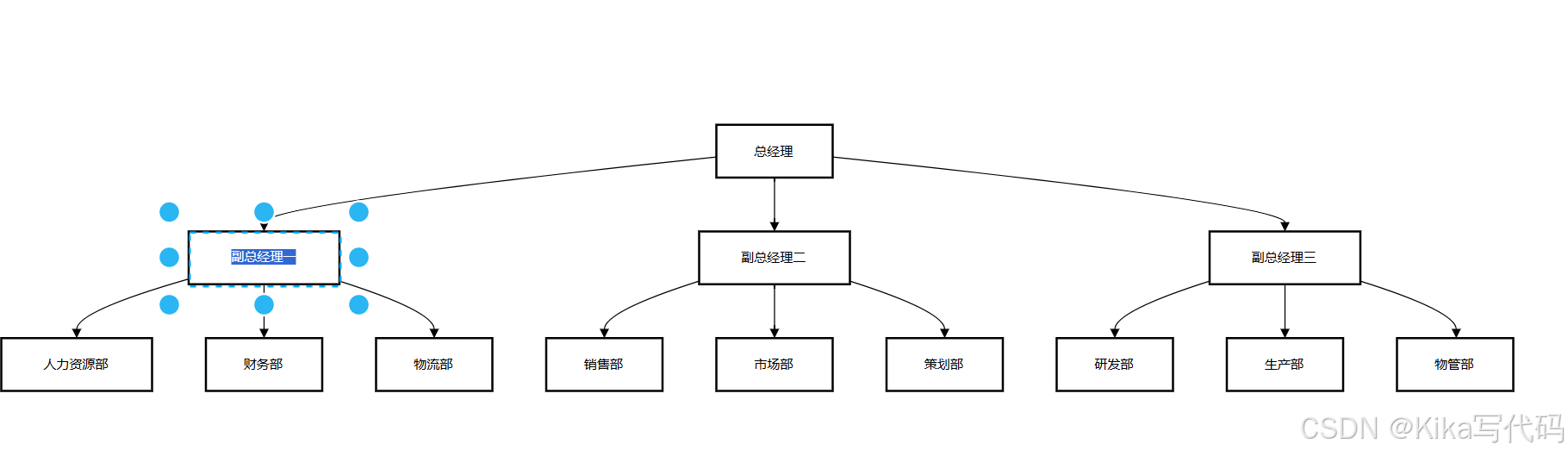

输入想要绘制的图形,点击插入,即可生成想要的流程图

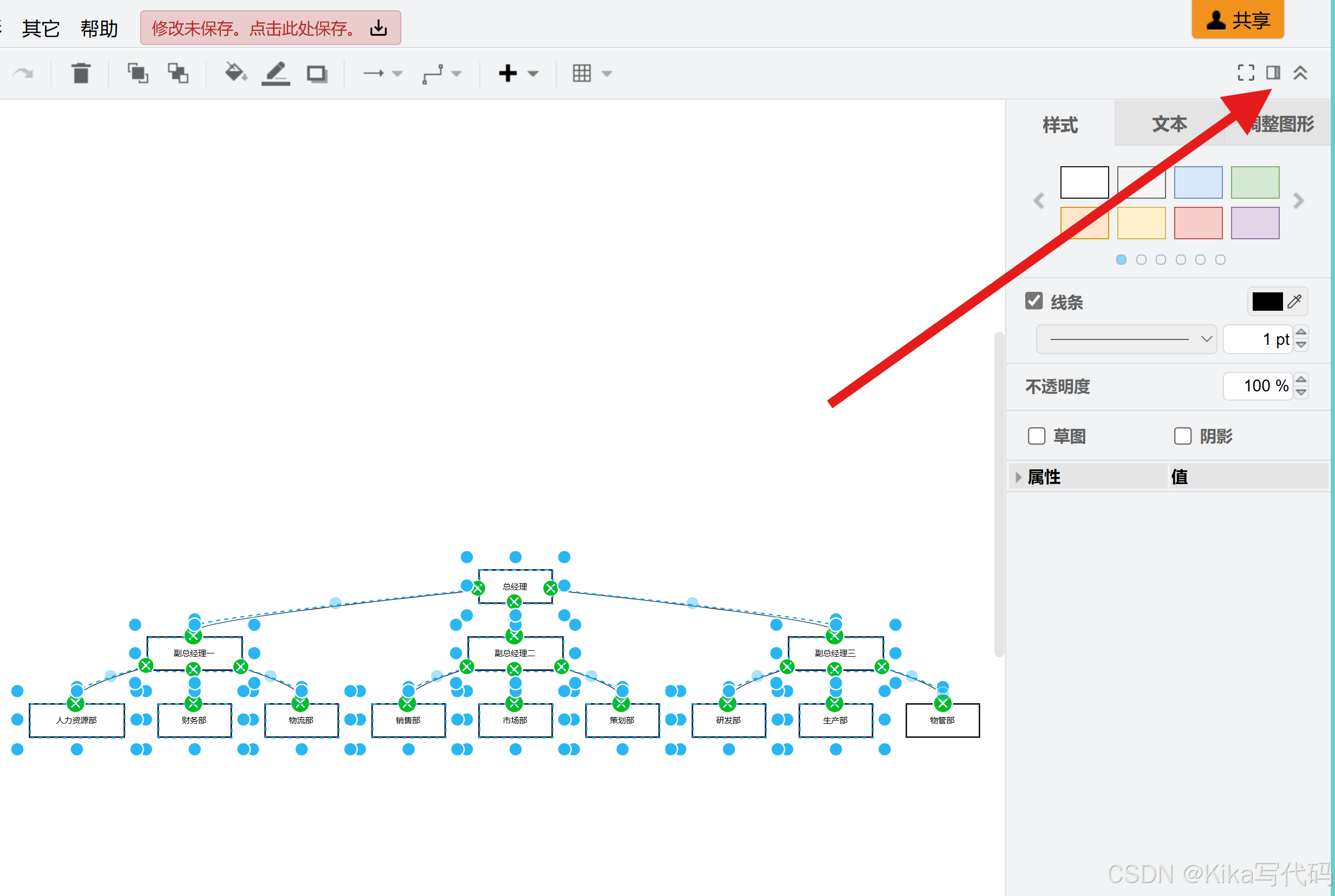

如果对图形不满意可以更改内容还有样式

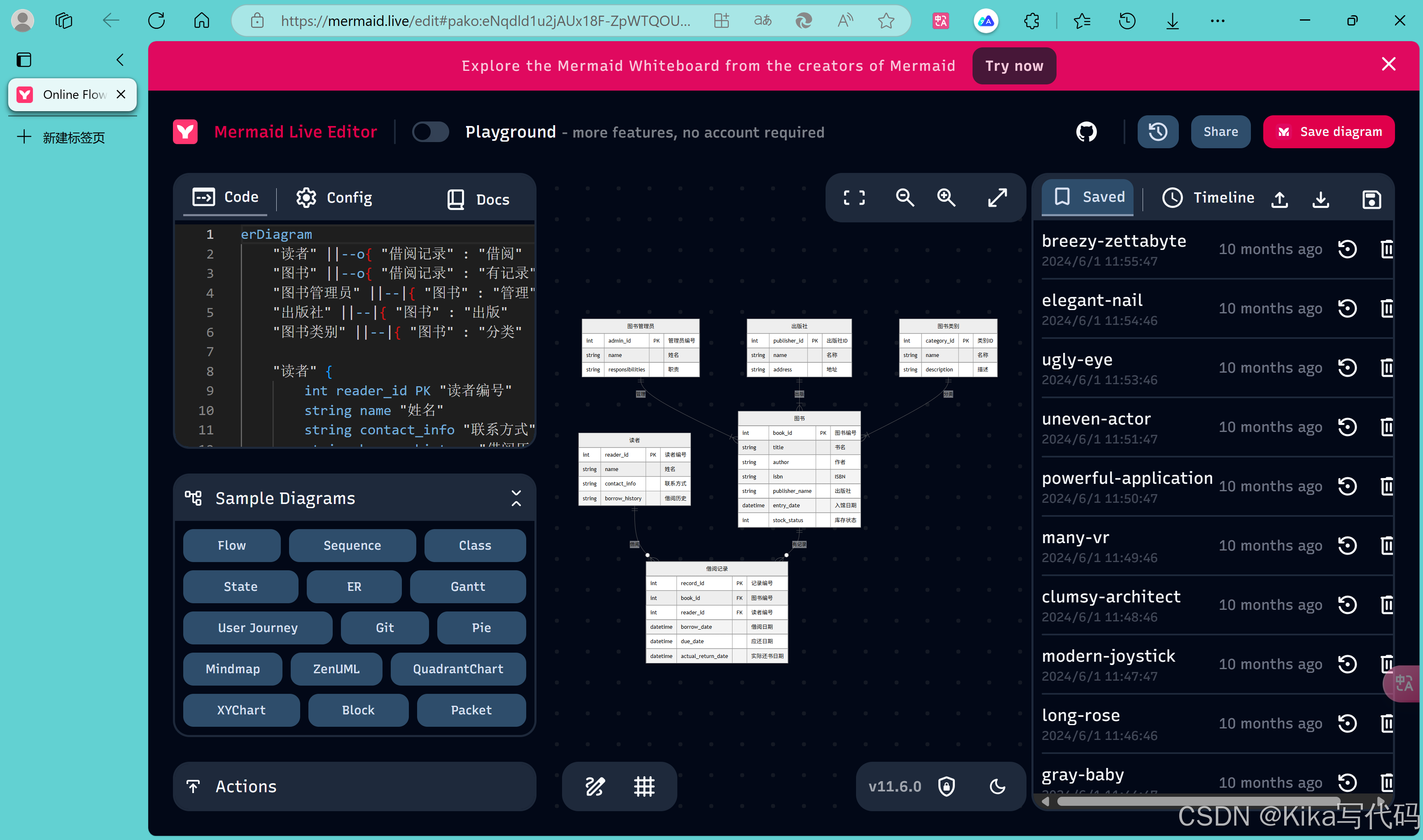

Mermaid文本驱动图表在线工具

另一款好用的在线绘图工具,通过简洁的类 Markdown 语法生成专业级图表,尤其适合技术文档、项目管理和团队协作场景。

Online FlowChart & Diagrams Editor - Mermaid Live Editor

4769

4769

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?