【回归算法解析系列】弹性网络回归(Elastic Net)

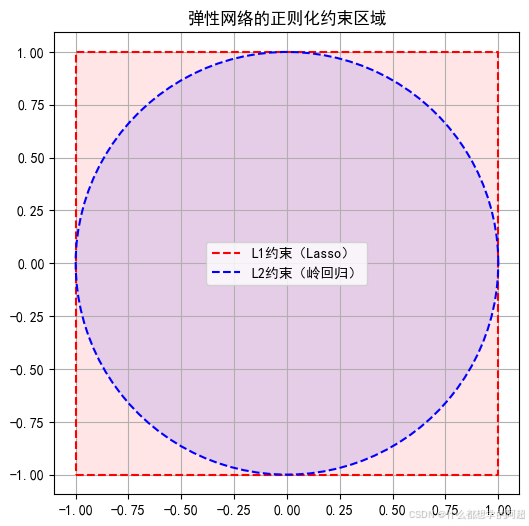

1. 弹性网络:平衡L1与L2正则化的艺术

在机器学习的回归分析领域,弹性网络(Elastic Net)作为一种强大的线性回归技术,是岭回归(L2正则化)与Lasso回归(L1正则化)的融合版本。这种融合并非简单的叠加,而是为了解决两类回归方法在实际应用中所面临的局限性。

1.1 Lasso的局限性

当特征之间存在高度相关性时,Lasso回归会面临一个棘手的问题:它倾向于随机选择其中一个相关特征,而忽略其他相关特征。这一特性使得Lasso回归在处理高度相关特征时,模型的稳定性大打折扣。例如,在金融风控场景中,如果收入和负债这两个高度相关的特征同时存在,Lasso可能只会随机选择其中一个,从而导致模型无法全面考虑相关因素,影响预测的准确性。

1.2 岭回归的冗余性

与Lasso回归不同,岭回归会保留所有的特征,无论这些特征是否对目标变量有显著影响。虽然这种方法可以保证模型的稳定性,但却无法有效地筛选出关键变量,导致模型可能包含大量冗余信息,增加了模型的复杂度和计算成本。

1.3 弹性网络的核心优势

弹性网络结合了Lasso和岭回归的优点,在特征高度相关时能够稳定地选择变量。它通过双重正则化,实现了特征选择与权重收缩的平衡。具体来说,弹性网络的双重正则化机制使得它既能像Lasso一样进行特征选择,又能像岭回归一样保证模型的稳定性。这种平衡使得弹性网络在处理复杂数据集时表现出色,尤其适用于特征高度相关且需要稀疏解的场景。

2. 数学原理与优化方法

2.1 目标函数

弹性网络的损失函数结合了L1和L2正则化项,其数学表达式如下:

[

\text{Loss} = \frac{1}{2N} |\mathbf{y} - \mathbf{X}\mathbf{w}|_2^2 + \lambda \left( \rho |\mathbf{w}|_1 + \frac{1-\rho}{2} |\mathbf{w}|_2^2 \right)

]

在这个公式中,各个参数具有重要的意义:

- ( \lambda ) 控制整体正则化强度。(\lambda) 值越大,正则化的效果越强,模型越简单,对特征的约束也越大。例如,当(\lambda) 趋近于无穷大时,所有的特征权重都将趋近于零,模型将变得非常简单。

- ( \rho )(

l1_ratio)调节L1与L2的权重。当( \rho=1 )时,弹性网络退化为Lasso回归;当( \rho=0 )时,弹性网络退化为岭回归。通过调整(\rho) 的值,我们可以在L1和L2正则化之间找到一个合适的平衡点。

2.2 优化:坐标下降法

与Lasso回归类似,弹性网络使用坐标下降法逐维度更新权重。这种方法的核心思想是在每次迭代中,固定其他维度的权重,只更新一个维度的权重。在弹性网络中,由于需要同时处理L1和L2正则化项,权重更新公式变得更加复杂:

[

w_j = \frac{S\left( \sum_{i=1}^N x_{ij}(y_i - \tilde{y}i^{(j)}) , \lambda \rho \right)}{\sum{i=1}^N x_{ij}^2 + \lambda (1-\rho)}

]

其中 ( S(\cdot) ) 是软阈值函数,分母中的 ( \lambda(1-\rho) ) 项来自L2正则化。坐标下降法的优点是计算复杂度较低,尤其适用于高维数据集。

3. 超参数调优:λ与ρ的选择

3.1 参数作用

- λ(alpha):整体正则化强度。(\lambda) 越大,模型越简单,对特征的约束越强。在实际应用中,我们需要根据数据集的复杂度和样本数量来选择合适的(\lambda) 值。如果数据集比较复杂,包含大量的特征和噪声,我们可以选择较大的(\lambda) 值来防止过拟合;如果数据集比较简单,我们可以选择较小的(\lambda) 值来提高模型的拟合能力。

- ρ(l1_ratio):L1正则化的比例。(\rho) 越接近1,特征选择越激进,模型越倾向于选择较少的特征;(\rho) 越接近0,模型越倾向于保留所有的特征,类似于岭回归。

3.2 网格搜索与交叉验证

在实际应用中,我们通常使用网格搜索结合交叉验证的方法来选择最优的(\lambda) 和(\rho) 值。Scikit-Learn提供了ElasticNetCV 类来自动化这个过程。以下是一个示例代码:

from sklearn.linear_model import ElasticNetCV

import numpy as np

# 生成具有相关特征的数据

X = np.random.rand

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1868

1868

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?