一、概述

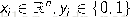

线性模型中的“线性”是一系列一次特征的线性组合,在二维空间中是一条直线,在三维空间中是一个平面,推广到n维空间可以理解为广义线性模型。常见的广义线性模型有岭回归、Lasso回归、Elastic Net、逻辑回归、线性判别分析。

二、算法笔记

1. 普通线性回归

线性回归是一种回归分析技术,回归分析本质上就是一个函数估计问题。

根据给定的数据集,定义模型和模型的损失函数,我们的目标是损失函数最小化。可以用梯度下降法求解使损失函数最小化的参数w和b,要注意的是,使用梯度下降时,必须要进行特征归一化(Feature Scaling)。特征归一化有两个好处:一是提升模型的收敛速度,二是提升模型精度,它可以让各个特征对结果做出的贡献相同。

2. 广义线性模型

令h(y)=wTx + b,这样就得到了广义线性模型,例如lny=wTx+ b,它是通过exp(wTx + b)来拟合y的 ,实质上是非线性的。

3. 逻辑回归

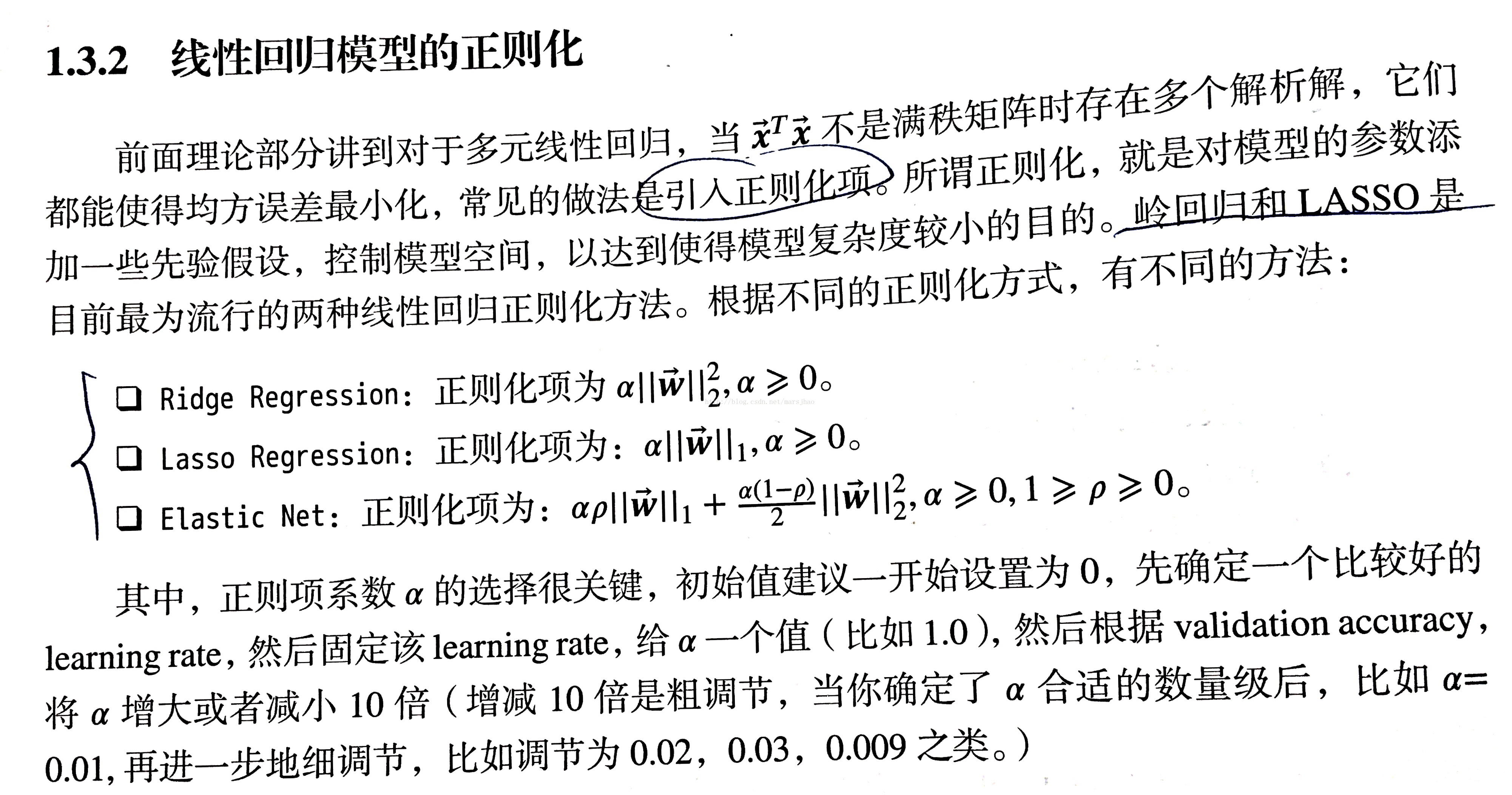

逻辑回归模型是:

其中w和x可以为扩充的形式。

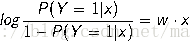

一个事件的几率(odds)是指该事件发生的概率与该事件不发生的概率的比值。设事件发生的概率是p,那么该事件的几率是p/(1-p),该事件的对数几率(log odds)或logit函数是:

对逻辑回归而言,可得

这就是说,在逻辑回归模型中,输出Y=1的对数几率是输入x的线性函数。

对于给定的训练数据集

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

440

440

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?